Académique Documents

Professionnel Documents

Culture Documents

EsperanzaMatematica PDF

Transféré par

Eduardo UrdialesTitre original

Copyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

EsperanzaMatematica PDF

Transféré par

Eduardo UrdialesDroits d'auteur :

Formats disponibles

Esperanza Matemtica

UCR ECCI CI-1352 Probabilidad y Estadstica Prof. M.Sc. Kryscia Daviana Ramrez Benavides

Media de una Variable Aleatoria

Sea X una variable aleatoria con distribucin de probabilidad f(x). La media o valor esperado de X es

Si X es discreta

= X = E ( X ) = xf (x )

x

Si X es continua

= X = E ( X ) = xf (x )dx

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

Media de una Variable Aleatoria (cont.)

Teorema. Sea X una variable aleatoria con distribucin de probabilidad f(x). La media o valor esperado de la variable aleatoria g(X) es

Si X es discreta

g ( X ) = E [g ( X )] = g (x ) f (x )

x

+

Si X es continua

g ( X ) = E [g ( X )] = g (x ) f (x )dx

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

Media de una Variable Aleatoria (cont.)

Sean X y Y variables aleatorias con distribucin de probabilidad conjunta f(x,y). La media o valor esperado de la variable aleatoria g(X,Y) es

Si X y Y son discretas

g ( X ,Y ) = E [g ( X , Y )] = g (x, y ) f (x, y )

y x

Si X y Y son continuas

g ( X ,Y ) = E [g ( X , Y )] =

+ +

g (x, y ) f (x, y )dxdy

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

Media de una Variable Aleatoria (cont.)

Sean X y Y variables aleatorias con distribucin de probabilidad conjunta f(x,y). La media o valor esperado de la variable aleatoria X es

Si X y Y son discretas

y

X = E ( X ) = xf (x, y ) = xg (x )

x x

Si X y Y son continuas

X = E(X ) =

+ +

xf (x, y )dxdy = xg (x )dx

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

Media de una Variable Aleatoria (cont.)

Sean X y Y variables aleatorias con distribucin de probabilidad conjunta f(x,y). La media o valor esperado de la variable aleatoria Y es

Si X y Y son discretas

y x

Y = E (Y ) = yf (x, y ) = yh( y )

y

Si X y Y son continuas

Y = E (Y ) =

+ +

yf (x, y )dxdy = yh( y )dy

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

Varianza y Covarianza

Sea X una variable aleatoria con distribucin de probabilidad f(x) y la media . La varianza de X es

2 = 2 = Var ( X ) = E ( X )2 = (x )2 f (x )

X

Si X es discreta

Si X es continua

2 2

X

= = Var ( X ) = E ( X ) =

2

2 ( x ) f ( x )dx

La raz cuadrada positiva de la varianza, , se llama desviacin estndar de X.

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

Varianza y Covarianza (cont.)

La cantidad x se llama desviacin estndar de una observacin respecto a su media. Cuando estas desviaciones se elevan al cuadrado y despus se promedian, 2 ser mucho menor para un conjunto de valores x que sean cercanos a , que para un conjunto de valores que vare de forma considerable de .

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

Varianza y Covarianza (cont.)

Teorema. La varianza de una variable aleatoria X es 2 2 ( ) 2 = 2 = Var X = E X X Prueba. Caso discreto (el caso continuo es igual, pero en vez de sumatorias son integrales). 2 = 2 = Var ( X ) = ( x )2 f ( x )

( )

2 = (x 2 2x + 2 ) f ( x ) 2 = x 2 f ( x ) 2 xf ( x ) + 2 f (x ) = xf (x ) y

x x x x x x

f (x ) = 1

x x

2 = x 2 f (x ) 2 2 + 2 = x 2 f (x ) 2

UCR-ECCI CI-1352 Probabilidad y Estadstica 2 2 2 E X = Esperanza Matemtica

( )

Varianza y Covarianza (cont.)

Teorema. Sea X una variable aleatoria con distribucin de probabilidad f(x). La varianza de la variable aleatoria g(X) es

2( ) = Var [g ( X )] = E (g ( X ) g ( X ) )2 = (g (x ) g ( X ) )2 f (x )

g X

Si X es discreta

2

g(X

= Var [g ( X )] = E (g ( X ) g ( X ) ) =

2

Si X es continua

(g (x ) ( ) ) f (x )dx

2 g X

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

10

Varianza y Covarianza (cont.)

Sean X y Y variables aleatorias con distribucin de probabilidad conjunta f(x,y). La covarianza de X y Y es

XY = cov( X , Y ) = E [( X X )(Y Y )] = (x X )( y Y ) f (x, y )

y x

Si X y Y son discretas

Si X y Y son continuas

+ +

XY = cov( X , Y ) = E [( X X )(Y Y )] =

(x )( y ) f (x, y )dxdy

X Y

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

11

Varianza y Covarianza (cont.)

La covarianza de dos variables aleatorias es una medida de la naturaleza de la asociacin entre las dos. La covarianza slo describe la relacin lineal entre dos variables aleatorias.

Describe la naturaleza de la relacin. Si la covarianza es positiva significa que X y Y son linealmente ascendentes (valores grandes de X estarn relacionados con valores grandes de Y, y valores pequeos de X estarn relacionados con valores pequeos de Y). Si la covarianza es negativa significa que X y Y son linealmente descendentes (valores grandes de X estarn relacionados con valores pequeos de Y, y viceversa). 12

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

Varianza y Covarianza (cont.)

Cuando X y Y son estadsticamente independientes la covarianza es cero. Lo opuesto, sin embargo, por lo general no es cierto. Dos variables pueden tener covarianza cero e incluso as no ser estadsticamente independientes. Una covarianza entre X y Y es cero, quiz indica que X y Y no tiene una relacin lineal, pero no que sean independientes.

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

13

Varianza y Covarianza (cont.)

Teorema. La covarianza de dos variables aleatorias X y Y con medias X y Y, respectivamente, est dada por XY = cov( X , Y ) = E ( XY ) X Y Prueba. Caso discreto (el caso continuo es igual, pero en vez de sumatorias son integrales).

XY = cov( X , Y ) = (x X )( y Y ) f (x, y )

x y

XY = (xy X y Y x + X Y ) f (x, y )

x y

XY = xyf (x, y ) X yf (x, y ) Y xf (x, y ) + X Y f (x, y )

x y x y x y x y

X = xf (x, y ), Y = yf (x, y ) y XY = E ( XY ) X Y X Y + X Y XY ) X Y y Estadstica XY = E ( UCR-ECCI CI-1352 Probabilidad

Esperanza Matemtica

x y

f (x, y ) = 1

x y

14

Varianza y Covarianza (cont.)

Sean X y Y variables aleatorias con covarianza XY y desviacin estndar X y Y, respectivamente. El coeficiente de correlacin X y Y es

XY

XY = XY

El coeficiente de correlacin satisface la desigualdad -1 XY 1 El coeficiente de correlacin describe la fuerza de la relacin.

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

15

Medias y Varianzas de Combinaciones Lineales de Variables Aleatorias

Teorema. Si a y b son constantes, entonces E(aX b) = aE(X) b Corolario. Al hacer a = 0, se ve que E(b) = b Corolario. Al hacer b = 0, se ve que E(aX) = aE(X) Prueba. Caso continuo (el caso discreto es igual, pero en vez de integrales son sumatorias).

E (aX b ) =

+ +

(ax b ) f (x )dx

+

E (aX b ) = a xf ( x )dx b f ( x )dx E ( X ) = xf ( x )dx y

UCR-ECCI CI-1352 Probabilidad y Estadstica E aX b = aE Esperanza Matemtica

(X ) b

f (x )dx = 1

16

Medias y Varianzas de Combinaciones Lineales de Variables Aleatorias

Teorema. El valor esperado de la suma o diferencia de dos o ms funciones de una variable aleatoria X, es la suma o diferencia de los valores esperados de las funciones. Es decir, E[g(X) h(X)] = E[g(X)] E[h(X)] Prueba. Caso continuo (el caso discreto es igual, pero en vez de integrales son sumatorias).

E ( g ( x ) h( x )) =

+

(g (x ) h(x )) f (x )dx

+

E ( g ( x ) h( x )) = E (g ( x )) E (h( x ))

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

E ( g ( x ) h( x )) = g ( x ) f ( x )dx h( x ) f ( x )dx

17

Medias y Varianzas de Combinaciones Lineales de Variables Aleatorias (cont.)

Teorema. El valor esperado de la suma o diferencia de dos o ms funciones de las variables aleatorias X y Y, es la suma o diferencia de los valores esperados de las funciones. Es decir, E[g(X,Y) h(X,Y)] = E[g(X,Y)] E[h(X,Y)] Corolario. Al hacer g(X,Y) = g(X) y h(X,Y) = h(Y), se ve que E[g(X) h(Y)] = E[g(X)] E[h(Y)] Corolario. Al hacer g(X,Y) = X y h(X,Y) = Y, se ve que E(X Y) = E(X) E(Y)

E (g (x, y ) h(x, y )) =

UCR-ECCI CI-1352 Probabilidad y Estadstica E Matemtica g x, y h x, y = E g x, y E Esperanza

(g (x, y ) h(x, y )) f (x, y )dxdy E (g (x, y ) h(x, y )) = g (x, y ) f (x, y )dxdy h(x, y ) f (x, y )dxdy

+ + + +

+ +

( (

))

( (

))

(h(x, y ))

18

Medias y Varianzas de Combinaciones Lineales de Variables Aleatorias (cont.)

Teorema. Sean X y Y dos variables aleatorias independientes. Entonces E(XY) = E(X)E(Y) Prueba. Caso continuo (el caso discreto es igual, pero en vez de integrales son sumatorias).

E ( XY ) = E ( XY ) =

+ +

f (x, y ) = g (x )h( y )

+ + +

xyf (x, y )dxdy xyg (x )h( y )dxdy

+

E ( XY ) = xg (x )dx yh( y )dy E ( XY ) = E ( X )E (Y )

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

19

Medias y Varianzas de Combinaciones Lineales de Variables Aleatorias (cont.)

Teorema. Si a y b son constantes, entonces 2aX + b = a22X = a22 Corolario. Al hacer a = 1, se ve que 2X + b = 2X = 2 Corolario. Al hacer b = 0, se ve que 2aX = a22X = a22 Prueba.

= E (aX + b aX +b ) aX +b = E (aX + b ) = aE ( X ) + b = a X + b

2 aX + b 2 2 aX +b 2

2

2 2 2 ( ) ( ) ( ) [ ] aX = E aX + b a + b = E aX + b a b +b X X 2

2

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

{ } [ = E [(aX a ) ] = a E [( X ) ] = a

X X

2 X

20

Medias y Varianzas de Combinaciones Lineales de Variables Aleatorias (cont.)

Teorema. Si X y Y son variables aleatorias con distribucin de probabilidad conjunta f(x,y), entonces 2aX + bY = a22X + b22Y + 2abXY Teorema. Si X y Y son variables aleatorias con distribucin de probabilidad conjunta f(x,y), entonces 2aX bY = a22X + b22Y 2abXY Prueba. 2 2 [ ] ( ) = + aX E aX bY + bY aX + bY aX +bY = E (aX + bY ) = aE ( X ) + bE (Y ) = a X + bY 2 [(aX + bY ) (a X + bY )]2 }= E [(aX + bY a X bY )2 ] aX + bY = E { 2 [a( X X ) + b(Y Y )]2 }= a 2 E [( X X )2 ]+ b 2 E [(Y Y )2 ]+ 2abE[( X X )(Y Y )] aX + bY = E {

2 aX + bY

UCR-ECCI CI-1352 Probabilidad y Estadstica 2 2 = a 2 X + + 2ab XY b 2 Y Esperanza Matemtica

21

Medias y Varianzas de Combinaciones Lineales de Variables Aleatorias (cont.)

Corolario. Si X y Y son variables aleatorias independientes, entonces 2aX + bY = a22X + b22Y Corolario. Si X y Y son variables aleatorias independientes, entonces 2aX bY = a22X + b22Y Corolario. Si X1, X2, , Xn son variables aleatorias independientes, entonces 2a1X1 + a2X2 + + anXn = a212X1 + a222X2 + + a2n2Xn

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

22

Teorema de Chebyshev

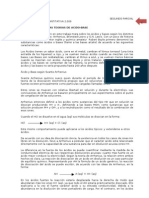

Si una V.A. tiene una varianza o desviacin estndar pequea, se esperara que la mayora de los valores se agruparan alrededor de la media.

Ver las figuras de las filminas 24 y 25.

El matemtico ruso P.L. Chebyshev descubri que la fraccin del rea entre cualesquiera dos valores simtricos alrededor de la media est relacionada con la desviacin estndar. Como el rea bajo una curva de distribucin de probabilidad, o en un histograma de probabilidad, suma 1, el rea entre cualesquiera dos nmeros es la probabilidad de que la V.A. tome un valor entre estos nmeros.

23

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

Teorema de Chebyshev (cont.)

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

24

Teorema de Chebyshev (cont.)

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

25

Teorema de Chebyshev (cont.)

La probabilidad de que cualquier variable aleatoria X tome un valor dentro de k desviaciones estndar de la media es al menos 1 1/k2. Es decir, 1 P( k < X < + k ) 1 2 k Este teorema tiene validez para cualquier distribucin de observaciones y, por esta razn, los resultados por lo general son dbiles.

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

26

Teorema de Chebyshev (cont.)

El valor que el teorema proporciona es slo un lmite inferior; es decir, la probabilidad de una variable aleatoria caiga dentro de dos desviaciones estndar de la media no puede ser menor a 1 1/k2. Slo cuando se conoce la distribucin de probabilidad, se puede determinar probabilidades exactas. Por esta razn el teorema se conoce por el nombre de distribucin libre. El uso de este teorema se relega a situaciones donde se desconoce la forma de la distribucin.

27

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

Referencias Bibliogrficas

Walpole, R.E.; Myers, R.H.; Myers, S.L. & Ye, K. Probabilidad y estadstica para ingeniera y ciencias. Octava Edicin. Pearson Prentice-Hall. Mxico, 2007.

UCR-ECCI CI-1352 Probabilidad y Estadstica Esperanza Matemtica

28

Vous aimerez peut-être aussi

- Ventanas de AluminioDocument31 pagesVentanas de Aluminioomar minaya100% (2)

- A Calculo de Ballestas de Suspension para CamionDocument10 pagesA Calculo de Ballestas de Suspension para CamionalexyzzzPas encore d'évaluation

- Topologia PDFDocument128 pagesTopologia PDFDiego MoralesPas encore d'évaluation

- Ensayos en Obra-1Document12 pagesEnsayos en Obra-1Jhanina TitoPas encore d'évaluation

- Informe Sistema de AlumbradoDocument22 pagesInforme Sistema de AlumbradoEduardo Urdiales100% (1)

- Calado Bomba Linea.Document46 pagesCalado Bomba Linea.Eduardo Urdiales100% (1)

- Matriz Riesgos GT 45Document16 pagesMatriz Riesgos GT 45AlejandroÁngel100% (1)

- Clase 3 InstrumentacionDocument70 pagesClase 3 InstrumentacionArturo Tapia100% (1)

- Sistemas de Tren de RodajeDocument18 pagesSistemas de Tren de RodajeEduardo Urdiales0% (1)

- Taqués HidráulicosDocument7 pagesTaqués HidráulicosEduardo UrdialesPas encore d'évaluation

- Analisis de La Mancha ESDocument6 pagesAnalisis de La Mancha ESEduardo UrdialesPas encore d'évaluation

- Geometria de La DireccionDocument52 pagesGeometria de La DireccionEduardo Urdiales100% (1)

- Comportamiento Dinamico SuspensionDocument22 pagesComportamiento Dinamico SuspensionEduardo UrdialesPas encore d'évaluation

- Materiales para ResortesDocument4 pagesMateriales para ResortesEduardo UrdialesPas encore d'évaluation

- Eslabonamiento de Mas de Cuatro BarrasDocument8 pagesEslabonamiento de Mas de Cuatro BarrasEduardo UrdialesPas encore d'évaluation

- TERMOCOMPRESORDocument6 pagesTERMOCOMPRESORJuan Jimenez HuamaniPas encore d'évaluation

- Proyecto-Conexiones Special Moment Frames and IntermediateDocument337 pagesProyecto-Conexiones Special Moment Frames and IntermediateIsaias Corza100% (1)

- Trabajo de FisicaDocument15 pagesTrabajo de Fisicapaula beltranPas encore d'évaluation

- Tema 4 Vectores en Los Espacios Bi y TriDocument10 pagesTema 4 Vectores en Los Espacios Bi y TriValero JuanPas encore d'évaluation

- Distrubucion NormalDocument34 pagesDistrubucion NormalMarce PazmiñoPas encore d'évaluation

- MelvinDocument4 pagesMelvinMelvinMariaKingPas encore d'évaluation

- Clase Modelo Ecuaciones Diferenciales ExactasDocument10 pagesClase Modelo Ecuaciones Diferenciales Exactasjuancalp81Pas encore d'évaluation

- Práctica 5. Observando El EquilibrioDocument5 pagesPráctica 5. Observando El EquilibrioBrayan GuttierrezPas encore d'évaluation

- Pulimento Acelarado en Materiales Pétreos y Resistencia A La FricciónDocument3 pagesPulimento Acelarado en Materiales Pétreos y Resistencia A La FricciónCarmen ManzanoPas encore d'évaluation

- 04 Análisis DImensional MFDocument15 pages04 Análisis DImensional MFEdward CapePas encore d'évaluation

- Practica 2 Q.O. IIDocument5 pagesPractica 2 Q.O. IICarolina MezaPas encore d'évaluation

- Interpolación CircularDocument16 pagesInterpolación CircularHector LoperaPas encore d'évaluation

- Separata Nº01 Analisis DimensionalDocument2 pagesSeparata Nº01 Analisis DimensionalAnonymous kshVE1Wsq3Pas encore d'évaluation

- Dewart - Actuadores - Lineares - 2011Document16 pagesDewart - Actuadores - Lineares - 2011josefmvPas encore d'évaluation

- Sin TítuloDocument4 pagesSin TítuloSTEVEN KELLYPas encore d'évaluation

- Limites Ejercicios PDFDocument11 pagesLimites Ejercicios PDFandrea MendozaPas encore d'évaluation

- 5 Mov. CompuestoDocument5 pages5 Mov. CompuestoMamerto Calizaya CalizayaPas encore d'évaluation

- Cielo MarDocument11 pagesCielo MarMarco Ibarra SoñezPas encore d'évaluation

- 02-Cm 211-Silabo Dosificado Por ClasesDocument4 pages02-Cm 211-Silabo Dosificado Por ClasesLuis fiat luxPas encore d'évaluation

- ReflexiónDocument2 pagesReflexiónMiguel Sebastian MendozaPas encore d'évaluation

- Taller9 EPN LatexDocument1 pageTaller9 EPN LatexVanne OroscoPas encore d'évaluation

- Teoria Segundo Parcial Analitica IIDocument34 pagesTeoria Segundo Parcial Analitica IIdiegogui8850% (4)

- FIG. 8.147-Inclinación y Dirección de La Fuerza LateralDocument16 pagesFIG. 8.147-Inclinación y Dirección de La Fuerza LateralAlcon Ichuta JhocelynePas encore d'évaluation

- Laboratorio 3 Calibracion de Un RotámetroDocument13 pagesLaboratorio 3 Calibracion de Un RotámetroYasna Elgueta Cea100% (5)