Académique Documents

Professionnel Documents

Culture Documents

Redes Neuronales Artificiales

Transféré par

luis_sa_tecTitre original

Copyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

Redes Neuronales Artificiales

Transféré par

luis_sa_tecDroits d'auteur :

Formats disponibles

25 Autores cientfico-tcnicos y acadmicos

INTRODUCCIN

Si tuviramos que definir la principal caracterstica

que nos separa del resto de animales seguramente, la

gran mayora de nosotros, responderamos la capaci-

dad de raciocinio. Esta capacidad nos ha permitido

desarrollar una tecnologa propia de tal manera que, en

estos momentos, esta tecnologa se orienta a descubrir

su origen. Cmo funciona el cerebro? se pueden

construir modelos artificiales que lo emulen? se pue-

den desarrollar mquinas inteligentes? Todas estas pre-

guntas han conducido a un rpido desarrollo de un

campo multidisciplinar del conocimiento conocido

como Inteligencia Artificial (I.A.). Este campo se podra

dividir en dos clases que podramos definir como

macroscpico y microscpico.

En el primero de ellos se intenta modelizar el fun-

cionamiento del cerebro en base a reglas del tipo si

ocurre esto entonces..., el nombre de macroscpico se

debe a que no se toma en cuenta en ningn momento

la estructura interna del cerebro sino que modeliza su

comportamiento en base a un funcionamiento que

podramos definir como global.

En la segunda aproximacin se parte de la estructu-

ra que presenta el cerebro de tal forma que se constru-

yen modelos que tienen en cuenta dicha estructura. De

esta forma aparecen neuronas artificiales que se com-

binan entre s para formar estructuras multicapas

que, a su vez, pueden combinarse para formar

comits de expertos, etc. Esta forma de combinacin

recuerda la estructura en niveles del cerebro. Esta apro-

ximacin de la I.A conocida como redes neuronales

ha sufrido, en los ltimos aos, un incremento especta-

cular en publicaciones, aplicaciones comerciales, nme-

ro de congresos celebrados, etc.

QU SON LAS REDES NEURONALES?

El punto de partida en el estudio del cerebro lo

podramos fijar en pleno siglo XX con los trabajos de

Santiago Ramn y Cajal, uno de nuestros ms grandes

cientficos. Fue l quien desarrolla la idea de neurona

como el componente ms pequeo en la estructura del

cerebro. En casi todos los textos sobre redes neuronales

se establece una analoga entre estos elementos y los

componentes bsicos de un ordenador: las puertas de

silicio. En rdenes de velocidad las neuronas son en

varios rdenes de magnitud ms lentas que las puertas

lgicas de silicio. No obstante, el cerebro suple esta

menor velocidad con un mayor nmero de intercone-

xiones. Tambin hay que destacar la eficiencia del cere-

Emilio Soria, Antonio Blanco

Redes

neuronales

artificiales

Redes

neuronales

artificiales

26 Autores cientfico-tcnicos y acadmicos

bro desde un punto de vista energtico; a pesar del

gran nmero de operaciones realizadas el cerebro no

necesita de un ventilador como las modernas CPUs.

Si hubiera que destacar alguna caracterstica del

cerebro frente al ordenador se destacara la alta inter-

conexin de sus elementos constituyentes ms

pequeos: las neuronas. Esta capacidad de operar en

paralelo le permite realizar tareas que necesitan una

gran cantidad de clculos y tiempo en potentes orde-

nadores. Un ejemplo cotidiano de esta caracterstica es

el reconocimiento de una cara en una fotografa; aun-

que se haya tomado mal y la persona est un poco

girada, la identificacin de dicha persona no nos puede

llevar mucho tiempo. Sin embargo, este giro puede

poner en un serio aprieto a un ordenador. Otro ejem-

plo a destacar es el sistema de identificacin de objetos

de un murcilago. En su cerebro, del tamao de un

garbanzo, alberga un sistema que determina perfecta-

mente la evolucin de un obstculo (velocidad relativa,

posicin, tamao, etc) y todo en cuestin de milisegun-

dos. Sobre este ejemplo sobran las analogas con los

sistemas de radar y sonar creados por el hombre.

No existe una definicin general de red neuronal

artificial, existiendo diferentes segn el texto o artculo

consultado. As nos encontramos con las siguientes

definiciones:

Una red neuronal es un modelo computacional,

paralelo, compuesto de unidades procesadoras

adaptativas con una alta interconexin entre

ellas.

Sistemas de procesado de la informacin que

hacen uso de algunos de los principios que orga-

nizan la estructura del cerebro humano.

Modelos matemticos desarrollados para emular

el cerebro humano.

Sistema de procesado de la informacin que

tiene caractersticas de funcionamiento comunes

con las redes neuronales biolgicas.

Sistema caracterizado por una red adaptativa

combinada con tcnicas de procesado paralelo

de la informacin.

Desde la perspectiva del reconocimiento de

patrones las redes neuronales son una extensin

de mtodos clsicos estadsticos.

Las definiciones expuestas son un botn de mues-

tra pues cada autor las define de una manera. Parece

ser que en todas ellas aparece el componente de simu-

lacin del comportamiento biolgico; veremos ms

adelante (concretamente al tratar el perceptrn multica-

pa) que no todas las redes emulan una determinada

estructura neuronal. Lo que s tienen en comn estos

elementos con el cerebro humano es la distribucin de

las operaciones a realizar en una serie de elementos

bsicos que, por analoga con los sistemas biolgicos,

se conocen como neuronas. Estos elementos estn

interconectados entre s mediante una serie de cone-

xiones que, siguiendo con la analoga biolgica, se

conocen como pesos sinpticos. Estos pesos varan con

el tiempo mediante un proceso que se conoce como

aprendizaje. As pues podemos definir el aprendizaje

de una red como el proceso por el cual modifica las

conexiones entre neuronas, pesos sinpticos, para rea-

lizar la tarea deseada. Veremos ms adelante los dife-

rentes tipos de aprendizaje que existen.

REVISIN HISTRICA

Cuando se narra la corta pero intensa historia de

las redes neuronales tambin conocidas como modelos

conexionistas se suele fijar el origen en los trabajos de

McCulloch y Pitts. Sin embargo, existen trabajos ante-

riores que abrieron el camino a estos investigadores.

Entre estos trabajos podemos destacar el realizado por

Karl Lashley en los aos 20. En su trabajo de 1950 se

resume su investigacin de 30 aos; en su trabajo des-

taca que el proceso de aprendizaje es un proceso distri-

buido y no local a una determinada rea del cerebro.

Un estudiante de Lashley, D. Hebb recoge el testigo de

su maestro y determina una de las reglas de aprendiza-

je ms usadas en la regla del conexionismo y que, lgi-

camente, se conoce con el nombre de aprendizaje heb-

biano. Las contribuciones de este investigador apare-

cen publicadas en su libro The Organization of the

Behavior. En el captulo 4 se da, por primera vez, una

regla para la modificacin de las sinapsis, es decir, una

regla de aprendizaje fisiolgica. Adems propone que

la conectividad del cerebro cambia continuamente con-

forme un organismo aprende cosas nuevas, crendose

asociaciones neuronales con estos cambios. En su pos-

tulado de aprendizaje, Hebb sigue lo sugerido por

Ramn y Cajal al afirmar que la efectividad de una

sinapsis variable entre dos neuronas se incrementa por

una repetida activacin de una neurona sobre otra a

travs de esta sinapsis. Desde un punto de vista neuro-

fisiolgico la regla planteada por Hebb sera una regla

variante-temporal, con un alto mecanismo interactivo

Redes neuronales artificiales

27 Autores cientfico-tcnicos y acadmicos

que incrementa las eficacia sinptica como una funcin

de la actividad pre y post sinptica. Desde un punto de

vista conexionista la regla de Hebb es un tipo de

aprendizaje no supervisado (no se necesita ningn

maestro) en el que las conexiones entre dos neuronas

se incrementan si ambas se activan al mismo tiempo.

La siguiente gran contribucin a considerar es el

trabajo de McCulloch y Pitts. En este trabajo, se fijan

las caractersticas de trabajo de lo que, posteriormente,

se va a conocer como neurona de McCulloch-Pitts.

Este tipo de neurona es un dispositivo binario (salida 0

1), tiene un umbral de funcionamiento por debajo

del cual est inactiva y puede recibir entradas excitado-

ras o inhibitorias cuya accin es absoluta: si existe algu-

na de estas entradas la neurona permanece inactiva. El

modo de trabajo es simple, si no existe ninguna entra-

da inhibidora se determina la resultante de las entradas

excitadoras y si sta es mayor que el umbral, la salida

es 1 y si no, la salida es 0. Se puede observar que, con

un elemento tan simple como el que se acaba de defi-

nir, se pueden implementar un gran nmero de funcio-

nes lgicas mediante su combinacin con elementos

similares. Adems, dado el estado de la neurofisiologa

en 1943, el modelo de McCulloch-Pitts se acercaba a lo

conocido por esa poca acerca de la actividad sinpti-

ca neuronal. Esta capacidad de modelizar funciones

lgicas desat la euforia por estos elementos individua-

les; si se pueden modelizar funciones lgicas, por qu

no implementar un sistema de conocimiento mediante

el uso de estas neuronas? Veremos ms adelante cmo

acab este sueo.

En 1956, Rochester, Holland, Haibt y Duda presen-

tan un trabajo en el que, por primera vez, se verifica

mediante simulaciones una teora neuronal basada en

el postulado de Hebb. Para realizar este trabajo emi-

nentemente prctico, se tuvieron que hacer varias

suposiciones que, inicialmente, no estaban en el traba-

jo de Hebb. Por ejemplo se acot el valor de las sinap-

sis que, en principio, poda crecer sin lmite.

Otro gran genio matemtico, J ohn Von Neumann,

se plante ideas conexionistas: en una recopilacin de

sus trabajos posterior a su muerte sugiere como posible

camino para mejorar los ordenadores, de los cuales se

puede considerar como uno de los padres, el estudio

del sistema nervioso central. En 1958 se producen las

aportaciones de Selfridge y Rosenblatt. Estas contribu-

ciones plantean implementaciones fsicas de sistemas

conexionistas. En su trabajo Selfridge plantea el siste-

ma conocido como Pandemonium. Este sistema consta

de una serie de capas compuestas por lo que se cono-

cen como demonios. Cada una de las diferentes

capas de este sistema se reparten las diferentes tareas a

realizar.

Por su parte, Rosenblatt, quince aos despus del

estudio de McCulloch-Pitts, presenta una nueva aproxi-

macin al problema de reconocimiento de patrones

mediante la introduccin del perceptrn. Rosenblatt,

plante un dispositivo que realizara tareas que le inte-

resaran a los psiclogos (l lo era). El hecho que fuera

una mquina capaz de aprender la haca irresistible-

mente atractiva para los ingenieros.

En 1960 Widrow y Hoff presentan su ADALINE.

Estas siglas tienen una historia curiosa: cuando las

redes neuronales estaban en su mximo apogeo eran

el acrnimo de Adaptive Linear Neuron; cuando las

cosas empezaron a ir mal para las redes neuronales

pero este sistema se segua usando por los buenos

resultados obtenidos con l se cambi a Adaptive Line-

ar Element. El sistema planteado por Widrow estaba

regido por un algoritmo de aprendizaje muy sencillo

denominado LMS (Least Mean Square). Con este tra-

bajo se propone un sistema adaptativo que puede

aprender de forma ms precisa y rpida que los per-

ceptrones existentes. El trabajo de Widrow posibilit el

desarrollo de un rea del procesado digital de seales

(control de sistemas) que se conoce con el nombre de

procesado (control) adaptativo.

Block presenta en 1962 un trabajo que estudia los

perceptrones ms concretamente, presenta resultados

sobre el perceptrn MARK I con 400 dispositivos

receptores fotosensitivos dispuestos en una matriz 20

por 20 con un conjunto de 8 unidades de salida.

Llegamos al trabajo de Minsky y Papert titulado

Perceptrons que paraliz durante 10 aos el avance de

este campo de la inteligencia artificial. Este trabajo, que

fue escrito y expuesto brillantemente, puso de manifies-

to las limitaciones de los perceptrones. Estas limitacio-

nes hacan referencia a la clase de problemas que se

podan resolver usando estos elementos. Minsky y

Papert demostraron que un perceptrn slo poda

resolver problemas linealmente separables que, para

desgracia de los conexionistas, son los menos. Adems

los autores expusieron, y por esto se les ha criticado,

sus opiniones sobre las extensiones de los perceptrones

(a sistemas multicapa); ellos plantearon su absoluta

inutilidad prctica. Tambin hay que tener en cuenta

que, en el momento de la publicacin de su trabajo,

Minsky y Papert trabajaban en otro campo de la inteli-

gencia artificial. Sin embargo, como se demostr ms

tarde, se equivocaron en sus conjeturas.

Redes neuronales artificiales

28 Autores cientfico-tcnicos y acadmicos

El trabajo de Minsky y Papert supuso una paraliza-

cin de los trabajos sobre temas conexionistas, sin

embargo algunos investigadores continuaron trabajando.

Kohonen y Anderson proponen el mismo modelo

de memoria asociativa de forma simultnea. A modo

de demostracin de los diferentes campos de conoci-

miento que engloban los sistemas conexionistas estos

autores tienen una formacin diferente (Kohonen es

ingeniero elctrico y Anderson es neurofisilogo). En el

modelo artificial planteado la neurona es un sistema

lineal que usa como regla de aprendizaje la regla de

Hebb modificada

1

: estamos ante un asociador lineal.

En 1980, Stephen Grossberg, uno de los autores

ms prolficos en el campo de las redes neuronales,

establece un nuevo principio de auto-organizacin

desarrollando las redes neuronales conocidas como

ART (Adaptive Resonance Theory). Grossberg ha plan-

teado diferentes modelos neuronales que han presenta-

do una gran utilidad prctica (principalmente en el

campo del reconocimiento de patrones).

En 1982 J . Hopfield publica un trabajo clave para

el resurgimiento de las redes neuronales. Gran parte

del impacto de este trabajo se debi a la fama de Hop-

field como distinguido fsico terico. En l, desarrolla la

idea del uso de una funcin de energa para compren-

der la dinmica de una red neuronal recurrente con

uniones sinpticas simtricas. En este primer trabajo,

Hopfield slo permite salidas bipolares (0 1). En un

trabajo posterior ampla la funcin energa planteada

para estos sistemas permitiendo la salida continua de

las neuronas. El principal uso de estas redes ha sido

como memorias y como instrumento para resolver pro-

blemas de optimizacin como el problema del viajante.

En el mismo ao de 1982 Kohonen publica un

importante artculo sobre mapas autoorganizativos que

se ordenan de acuerdo a unas simples reglas. El apren-

dizaje que se da en el modelo planteado no necesita de

un maestro; estamos ante un aprendizaje de tipo no

supervisado.

Al ao siguiente, en el nmero especial sobre

modelos neuronales de la revista especializada IEEE

Transactions on Systems, Man and Cybernetics, apare-

cen dos trabajos de gran importancia en el desarrollo

de las redes neuronales. Fukushima, Miyake e Ito pre-

sentan una red neuronal, el Neocognitron, de tal forma

que combinando ideas del campo de la fisiologa, inge-

niera y de la teora neuronal crean un dispositivo que

es capaz de ser aplicado con xito en problemas de

reconocimiento de patrones. Este trabajo, y de ah lo

de Neo, supone un perfeccionamiento de un modelo

anterior presentado por los mismos autores y conocido

como Cognitron. Este sistema fue probado con la tarea

de identificar nmeros escritos a mano.

El segundo trabajo, presentado por Barto, Sutton y

Anderson estudia el aprendizaje reforzado y su aplica-

cin en control. En este trabajo se plantea este nuevo

tipo de aprendizaje en el que, a diferencia de trabajos

anteriores sobre modelos supervisados, no es necesario

un conocimiento total del error cometido por la red; lo

nico que se necesita es conocer el signo del error.

En 1986 aparece un trabajo que, junto al de Hop-

field, resucitar el inters por las redes neuronales. En

este trabajo Rumelhart, Hinton y Williams, desarrollan

el algoritmo de aprendizaje de retropropagacin (back-

propagation) para redes neuronales multicapa dando

una serie de ejemplos en los que se muestra la poten-

cia del mtodo desarrollado. A partir de ese ao, el

nmero de trabajos sobre redes neuronales ha aumen-

tado exponencialmente apareciendo un gran nmero

de aportaciones tanto a los mtodos de aprendizaje

como a las arquitecturas y aplicaciones de las redes

neuronales. Se podra destacar de entre todas estas

aportaciones el trabajo de Broomhead y Lowe y el de

Poggio y Girosi sobre el diseo de redes neuronales en

capas usando RBF (Radial Basis Functions), el trabajo

intensivo desarrollado sobre las mquinas de vectores

soporte, el desarrollo de la unin entre elementos neu-

ronales y difusos y, por ltimo, los trabajos sobre neu-

ronas de pulsos (spike neurons), sobre este tema se

recomienda visitar la pgina WEB

http://diwww.epfl.ch/lami/team/gerstner/wg_pub.html.

Finalmente hay que hacer mencin a uno de los

motores en el desarrollo de las redes neuronales: la

prediccin en series temporales. Una generalizacin de

las redes TDNN (orientadas especialmente para ser

usadas con series temporales) la realiz Eric Wan. En

su trabajo los pesos sinpticos, conexiones sinpticas,

eran filtros digitales.

VENTAJ AS DE LAS REDES NEURONALES

Acabamos de ver el desarrollo histrico de los siste-

mas conexionistas; se ha comprobado que, es una

ciencia multidisciplinar donde ingenieros, psiclogos,

Redes neuronales artificiales

1

El cambio en la sinapsis es proporcional al producto entre la entrada y la salida de la neurona.

29 Autores cientfico-tcnicos y acadmicos

mdicos, matemticos y fsicos tericos han aportado

algn elemento a estas teoras, pero, por qu ese

inters en estos sistemas? qu tienen en especial frente

a otros que podramos denominar clsicos? en definiti-

va qu cosas nuevas nos ofrecen?

Al principio de este captulo se ha comentado que

la potencia computacional de una red neuronal deriva,

principalmente, de su estructura de clculo distribuido

paralelo. Esta estructura le permite la resolucin de

problemas que necesitaran gran cantidad de tiempo

en ordenadores clsicos. Pero aparte de este hecho

aparecen otras propiedades que las hacen especial-

mente atractivas para ser usadas en una gran cantidad

de problemas prcticos:

a) Son sistemas distribuidos no lineales: Una neuro-

na es un elemento no lineal por lo que una inter-

conexin de ellas (red neuronal) tambin ser un

dispositivo no lineal. Esta propiedad permitir la

simulacin de sistemas no lineales y caticos,

simulacin que, con los sistemas clsicos lineales,

no se puede realizar.

b) Son sistemas tolerantes a fallos Una red neuro-

nal, al ser un sistema distribuido, permite el fallo

de algunos elementos individuales (neuronas) sin

alterar significativamente la respuesta total del

sistema. Este hecho las hace especialmente atrac-

tivas frente a los computadoras actuales que, por

lo general, son sistemas secuenciales de tal forma

que un fallo en uno de sus componentes conlle-

va que el sistema total no funcione.

c) Adaptabilidad: Una red neuronal tiene la capaci-

dad de modificar los parmetros de los que

depende su funcionamiento de acuerdo con los

cambios que se produzcan en su entorno de tra-

bajo (cambios en las entradas, presencia de ruido,

etc...). Con respecto a la capacidad de adaptacin

hay que tener en cuenta que sta no puede ser

tampoco excesivamente grande ya que conducira

a tener un sistema inestable respondiendo a

pequeas perturbaciones. Este es el problema

conocido como el dilema plasticidad-estabilidad.

e) Establecen relaciones no lineales entre datos. Las

redes neuronales son capaces de relacionar dos

conjuntos de datos mediante relaciones complejas.

f) Posibilidad de implementacin en VLSI: Esta

posibilidad permite que estos sistemas puedan

ser aplicados en sistemas de tiempo real, simu-

lando sistemas biolgicos mediante elementos de

silicio.

Todas estas ventajas hacen el uso de las redes neu-

ronales especialmente atractivo en un gran nmero de

aplicaciones. Sin embargo antes de enunciar algunas

(no todas!) de estas aplicaciones pasaremos a describir

los diferentes modelos que nos podemos encontrar.

En el campo de las redes neuronales se conoce con

el nombre de arquitectura la forma en la que se unen

los diferentes elementos, neuronas, mediante una serie

de conexiones, pesos sinpticos. En principio podemos

distinguir tres niveles, en cuanto a arquitectura se refie-

re, que los podemos definir como:

Microestructura: Este nivel hace referencia al ele-

mento ms pequeo: la neurona. Este es el nivel

ms pequeo pero no por ello es el menos

importante; aqu se fijan caractersticas tan

importantes como la funcin de activacin que

se explicar a continuacin.

Mesoestructura: Una vez sobrepasado el nivel

neuronal llegamos a este nivel donde se fija la

forma de conexin y la disposicin de los ele-

mentos explicados anteriormente.

Macroestructura: Las diferentes redes planteadas

en el nivel anterior se pueden combinar entre s

para dar estructuras mayores alcanzndose

mejores prestaciones.

Veamos ms detenidamente todos estos niveles.

MODELOS NEURONALES

En todo modelo artificial de neurona se tienen cua-

tro elementos bsicos:

a) Un conjunto de conexiones, pesos o sinapsis que

determinan el comportamiento de la neurona.

Estas conexiones pueden ser excitadoras (pre-

sentan un signo positivo), o inhibidoras (cone-

xiones negativas).

b) Un sumador que se encarga de sumar todas las

entradas multiplicadas por las respectivas sinap-

sis.

c) Una funcin de activacin no lineal para limitar

la amplitud de la salida de la neurona.

d) Un umbral exterior que determina el umbral por

encima del cual la neurona se activa.

Esquemticamente, una neurona artificial quedara

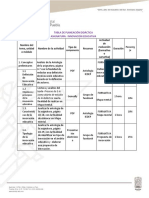

representada por la figura 1:

Redes neuronales artificiales

30 Autores cientfico-tcnicos y acadmicos

Ilustracin 1. Esquema de un modelo neuronal

Matemticamente las operaciones a realizar seran:

y:

salida = (U

n

- umbral)

donde es una funcin no lineal conocida como fun-

cin de activacin. Las funciones definidas varan entre

0 y 1; se pueden definir a partir de ellas otras funciones

que varan entre -1 y 1 simplemente escalando las sali-

das entre estos lmites.

ARQUITECTURAS NEURONALES

Los elementos bsicos comentados anteriormente

se pueden conectar entre s para dar lugar a las estruc-

turas neuronales o modelos conexionistas que podra-

mos clasificar de diferentes formas segn el criterio

usado. As se tendra:

Segn el nmero de capas

Redes neuronales monocapas Se corresponde con

la red neuronal ms sencilla ya que se tiene una capa

de neuronas que proyectan las entradas a una capa de

neuronas de salida donde se realizan diferentes clcu-

los. La capa de entrada, por no realizar ningn clculo,

no se cuenta de ah el nombre de redes neuronales con

una sola capa. Una aplicacin tpica de este tipo de

redes es como memorias asociativas.

Ilustracin 2. Red neuronal monocapa.

Redes neuronales multicapa Es una generalizacin

de la anterior existiendo un conjunto de capas interme-

dias entre la entrada y la salida (capas ocultas). Este

tipo de red puede estar total o parcialmente conectada.

Ilustracin 3. Esquema de una red neuronal multicapa.

Segn el tipo de conexiones

Redes neuronales no recurrentes. En esta red la pro-

pagacin de las seales se produce en un sentido sola-

mente, no existiendo la posibilidad de realimentaciones.

Lgicamente estas estructuras no tienen memoria.

Redes neuronales recurrentes. Esta red viene carac-

terizada por la existencia de lazos de realimentacin.

Estos lazos pueden ser entre neuronas de diferentes

capas, neuronas de la misma capa o, ms sencillamen-

te, entre una misma neurona. Esta estructura recurren-

te la hace especialmente adecuada para estudiar la

dinmica de sistemas no lineales. La siguiente figura

representa el esquema de una red recurrente.

=

=

k

j

nj n

) j ( x . W U

1

Redes neuronales artificiales

31 Autores cientfico-tcnicos y acadmicos

Ilustracin 4. Red neuronal recurrente.

Segn el grado de conexin

Redes neuronales totalmente conectadas. En este

caso todas las neuronas de una capa se encuentran

conectadas con las de la capa siguiente (redes no recu-

rrentes) o con las de la anterior (redes recurrentes).

Redes parcialmente conectadas. En este caso no se

da la conexin total entre neuronas de diferentes capas.

Estas estructuras neuronales se podran conectar

entre s para dar lugar a estructuras mayores: estamos

en el nivel de la mesoestructura. Esta conexin se

puede llevar a cabo de diferentes formas siendo las

ms usuales las estructuras en paralelo y jerrquicas.

En la primera estructura se plantea un consenso

entre las diferentes redes para obtener la salida mien-

tras que en la estructura jerrquica existen redes subor-

dinadas a otras que actan como elementos centrales

en la salida final de la red.

APLICACIONES DE LAS REDES

NEURONALES

Las aplicaciones de las redes neuronales las podra-

mos dividir segn el campo del conocimiento donde se

aplican.

Medicina. Las aplicaciones en medicina encuentran

su reflejo en problemas de diagnstico mdico. Es uno

de los campos con ms futuro y, hoy por hoy, uno de

los menos desarrollados. Aplicaciones en este campo

seran:

1. Diagnstico de cardiopatas. Este tipo de aplica-

ciones nos clasifican el electrocardiograma en

diferentes tipos o clases.

2. Deteccin de tumores cancergenos. Una red

neuronal entrenada localiza y clasifica en imge-

nes mdicas la posible existencia de tumores

cancergenos.

3. Caracterizacin de la dinmica en la variabilidad

cardaca. La regulacin del ritmo cardaco se

lleva a cabo por un sistema dinmico operando

bajo un rgimen catico.

4. Compresin de seales electrocardiogrficas.

Uno de los temas ms activos actualmente en el

campo de la ingeniera biomdica es la telemedi-

cina. Esta disciplina consiste en el desarrollo de

algoritmos que permitan el diagnstico de una

determinada enfermedad sin que el paciente se

tenga que desplazar al centro mdico. Las dife-

rentes seales que necesita el mdico se transmi-

ten va telefnica. Para aumentar la eficacia de

esta transmisin se podra pensar en la compre-

sin de la seal que consiste en aplicar diferentes

algoritmos para reducir su tamao. Uno de los

mtodos de compresin es con redes neuronales.

5. Prediccin de enfermedades degenerativas

cardacas. Pacientes que han sufrido un infarto

recientemente presentan un cierto factor de ries-

go de sufrir otro. Se puede usar una red para

modelizar el comportamiento de las arterias

coronarias.

6. Prediccin del riesgo de intoxicacin por digoxi-

na. En esta aplicacin la tarea de la red neuronal

es predecir el posible riesgo de intoxicacin por

digoxina que es un frmaco usado en problemas

de corazn.

7. Prediccin de la respuesta emtica. En esta apli-

cacin la red neuronal determina como salida la

respuesta emtica. Esta respuesta est relaciona-

da con el nmero de naseas y vmitos que

siente un paciente oncolgico tras un tratamiento

con quimioterapia.

8. Prediccin del nivel de Tacrolimus en sangre.

Este frmaco se utiliza en la terapia post-tras-

plante. Presenta un estrecho mbito terapetico

(la concentracin en sangre se debe mantener

entre 5 y 15 ng/ml) . Una red neuronal ha

Redes neuronales artificiales

32 Autores cientfico-tcnicos y acadmicos

demostrado su utilidad en la prediccin del nivel

de este frmaco en sangre.

9. Prediccin del nivel de ciclosporina. La ciclospo-

rina es un frmaco usado habitualmente para

evitar la reaccin de rechazo en transplantes de

rin, corazn, pulmn e hgado. Predecir la

concentracin de este frmaco a corto plazo

ayudara a la optimizacin de la dosis siguiente.

Esta prediccin se puede hacer con una red neu-

ronal.

Procesado de la seal. En este campo las redes

neuronales han encontrado un gran hueco de tal forma

que ya existe una sociedad internacional sobre la apli-

cacin de redes neuronales en problemas de procesado

de la seal. Algunos problemas de clasificacin donde

se aplican las redes neuronales seran:

1. Ecualizacin de canales de comunicacin. Ecua-

lizar un canal consiste en recuperar la seal que,

al pasar a travs de un canal de comunicaciones,

sufre una distorsin. Esta aplicacin tiene enton-

ces gran importancia con el auge de las comuni-

caciones mviles. La aplicacin de redes neuro-

nales se ha mostrado ms efectiva que el uso de

otros sistemas.

2. Reconocimiento de patrones en imgenes. Esta

aplicacin evidencia la capacidad de las redes

neuronales ya que se trata de una tarea relativa-

mente sencilla para un ser humano pero tremen-

damente costosa de implementar en un sistema

artificial.

3. Reconocimiento de voz. Esta aplicacin, de gran

importancia de cara a la implementacin de sis-

temas controlados por la voz, ha encontrado en

las redes neuronales un camino para su desarro-

llo.

4. Sonar y Radar. La capacidad de las redes neuro-

nales para clasificar determinados objetos (im-

genes, sonidos, seles unidimensionales, ...) les

permite su aplicacin en este campo como dis-

positivos para discernir los diferentes objetivos.

5. Eliminacin activa de ruido. Cuando el ruido y la

seal de inters tienen los espectros frecuenciales

solapados un filtrado selectivo en frecuencia no

tiene sentido. En este caso hay que intentar otras

aproximaciones. Una de estas es la cancelacin

activa de ruido aplicando sistemas adaptativos y

redes neuronales.

6. Control. En este caso el sistema a controlar se

modeliza para poder realizar predicciones de su

comportamiento y, de esta forma poder contro-

larlo ms fcilmente

Economa. En esta disciplina, donde hay que tomar

decisiones entre un nmero de opciones, las redes neu-

ronales son directamente aplicables frente a otros

mtodos por sus caractersticas intrnsecamente no line-

ales. As algunas de estas aplicaciones seran:

1. Concesin de crditos. En esta aplicacin las

redes neuronales en virtud de determinados

marcadores econmicos de la persona que pide

el prstamo decide su viabilidad o no .

2. Deteccin de posibles fraudes en tarjetas de cr-

dito. Las redes neuronales pueden ser usadas

como elementos discriminativos para conceder o

no una determinada cantidad en un cajero

automtico

3. Determinacin de la posibilidad de quiebra de

un banco. En esta aplicacin la red neuronal

determina el riesgo de quiebra de un banco en

virtud de determinados parmetros econmicos.

4. Prediccin del gasto elctrico de empresas y cen-

trales. Mediante el uso de una red neuronal

podemos estimar el consumo de una empresa y,

por tanto, podemos administrar mejor los recur-

sos elctricos de dicha empresa. Extensiones de

este trabajo abarcan otros recursos como, por

ejemplo, el consumo de aguas.

5. Cambio de moneda. Las redes neuronales se

han usado para la prediccin del cambio entre el

dlar americano y el marco alemn [ref-].

6. Tendencias a corto y medio plazo en bolsas de

valores. Si se buscan por Internet los productos

derivados de las redes neuronales que se comer-

cializan se encontrar rpidamente que la gran

mayora de ellos se orientan a aplicaciones de

este tipo

7. Prediccin de stocks. Uno de los mayores proble-

mas que se puede encontrar una fbrica es la

falta o un exceso de suministros. En el primer

caso no puede producir y, en el segundo, si no

dispone de un buen almacen, se puede producir

el caos. Una buena previsin de la cantidad

necesaria justa podra evitar muchos problemas

Medio Ambiente. Que vivimos en un ambiente

dinmico y no lineal nadie lo puede negar; cualquier

Redes neuronales artificiales

33 Autores cientfico-tcnicos y acadmicos

mtodo aplicado a este campo necesariamente debe

tener en cuenta estos hechos irrefutables. Tenemos,

pues, otro campo importante de aplicacin de las redes

neuronales. Algunas aplicaciones de stas seran:

1. Prediccin de irradiacin solar.

2. Prediccin de niveles txicos de ozono en zonas

urbanas y rurales. Este gas nos protege de la

radiacin ultavioleta del sol, sin embargo, un

exceso de este gas puede conducir a problemas.

Una prediccin de su concentracin en la atms-

fera a corto plazo (uno o dos das) podra condu-

cir a la aplicacin de medidas para evitar posi-

bles incrementos indeseados en la concentracin

de este gas.

3. Prediccin de variaciones globales de temperatura.

RESUMEN

En esta comunicacin se ha intentado presentar un

rpido resumen a un tema tan de actualidad en el

campo de la inteligencia artificial como son las redes

neuronales. A resaltar que no es un tema acadmico

sino que se utilizan en un nmero de aplicaciones que

crece da a da.

Redes neuronales artificiales

Vous aimerez peut-être aussi

- Encoders JVR v01Document3 pagesEncoders JVR v01luis_sa_tecPas encore d'évaluation

- Rotary Encoder VentasDocument22 pagesRotary Encoder VentasdannysionPas encore d'évaluation

- Rotary Encoder VentasDocument22 pagesRotary Encoder VentasdannysionPas encore d'évaluation

- 0058 J37 RDocument74 pages0058 J37 RAntonio PastranaPas encore d'évaluation

- 3Document4 pages3luis_sa_tecPas encore d'évaluation

- ÍndiceDocument2 pagesÍndiceluis_sa_tecPas encore d'évaluation

- 1Document3 pages1luis_sa_tecPas encore d'évaluation

- Control de Velocidad de Un Motor de CD Con Un Controlador PID WavenetDocument18 pagesControl de Velocidad de Un Motor de CD Con Un Controlador PID Wavenetluis_sa_tecPas encore d'évaluation

- Implementación de Neurocontroladores en LíneaDocument14 pagesImplementación de Neurocontroladores en LíneaAnyiCorderoPas encore d'évaluation

- Unidad 2 Economía de Los HCBDocument16 pagesUnidad 2 Economía de Los HCBLuis PorcelPas encore d'évaluation

- Libreto Titulación 2023Document9 pagesLibreto Titulación 2023Soledad CanquilPas encore d'évaluation

- Cyber Admin 5Document209 pagesCyber Admin 5Ainalite AinaPas encore d'évaluation

- Ética Profesional en EducaciónDocument13 pagesÉtica Profesional en EducaciónCristian Javier Moguel RamírezPas encore d'évaluation

- Manual de Taller 8plus4 Siena Light PDFDocument229 pagesManual de Taller 8plus4 Siena Light PDFVicente Paz100% (2)

- El Derecho Ruso Hasta 1900Document5 pagesEl Derecho Ruso Hasta 1900Agustín DávilaPas encore d'évaluation

- MICROBIOLOGÍADocument2 pagesMICROBIOLOGÍAAngely ArévaloPas encore d'évaluation

- Fundamentos ISO 9001 Semana 03 2021Document44 pagesFundamentos ISO 9001 Semana 03 2021Laura RosalesPas encore d'évaluation

- Innovacion Educativa PDFDocument17 pagesInnovacion Educativa PDFGabriela CruzPas encore d'évaluation

- Presas de FabricaDocument39 pagesPresas de FabricaChoque R. AlberthPas encore d'évaluation

- Copia ExamenDocument27 pagesCopia ExamenSolmuri VePas encore d'évaluation

- Análisis MarginalDocument2 pagesAnálisis Marginalrichardlivemore88% (8)

- ADM-For-001 Acta de Reunion Ver.01 - GerenciaDocument3 pagesADM-For-001 Acta de Reunion Ver.01 - GerenciaMARINAPas encore d'évaluation

- Sara JutoranDocument13 pagesSara JutoranNatalia HernándezPas encore d'évaluation

- Capítulos I II III RuthDocument22 pagesCapítulos I II III RuthOscar KaehlPas encore d'évaluation

- Los RevestimientosDocument4 pagesLos RevestimientosAmbulantisAeternusYajoPas encore d'évaluation

- Fisiología RenalDocument30 pagesFisiología RenalFatima AcostaPas encore d'évaluation

- Chat de WhatsApp Con Mama de MitoDocument4 pagesChat de WhatsApp Con Mama de Mitojvchuky986Pas encore d'évaluation

- Interpretación Geológica de Fotografías AéreasDocument30 pagesInterpretación Geológica de Fotografías AéreasOscar Huallpa VilcaPas encore d'évaluation

- Fase 4 - YinethBalanta - 83Document11 pagesFase 4 - YinethBalanta - 83yineth balanta minaPas encore d'évaluation

- Reglas de Operacion 2020Document4 pagesReglas de Operacion 2020Fomento Económico De Chiapas ACPas encore d'évaluation

- Problemastg FPA1Document4 pagesProblemastg FPA1tempuscritPas encore d'évaluation

- Informe Pizzeria de LuisDocument9 pagesInforme Pizzeria de LuisEDWARD MATHIAS RAYNER ALVA OLORTEGUIPas encore d'évaluation

- Analisis Puesto de Trabajo SeguroDocument10 pagesAnalisis Puesto de Trabajo SeguroDaniel RodriguezPas encore d'évaluation

- Informe TecnicoDocument14 pagesInforme TecnicoGarrik MartinezPas encore d'évaluation

- El ControlDocument3 pagesEl ControlJeom limPas encore d'évaluation

- AST ModificadoDocument2 pagesAST ModificadoQG QG AndrésPas encore d'évaluation

- 16S 1650 IVECO O.D.-nº 0091 008 006-Fev-2005 - 1297095070-071 - 092 PDFDocument43 pages16S 1650 IVECO O.D.-nº 0091 008 006-Fev-2005 - 1297095070-071 - 092 PDFÁlvaro Ricardo Lopatiuk100% (1)

- Empresas Leasing OperacionalDocument150 pagesEmpresas Leasing OperacionalCamilo Peña MoraPas encore d'évaluation

- Formulario Unico Impuesto Industria y Comercio RoviraDocument3 pagesFormulario Unico Impuesto Industria y Comercio Rovirapatricia sanchezPas encore d'évaluation