Académique Documents

Professionnel Documents

Culture Documents

Mbe Unidad 4. Lectura Comprensiva Estadistica Bivarial Junio 2014

Transféré par

nonizur0 évaluation0% ont trouvé ce document utile (0 vote)

217 vues53 pagesCopyright

© © All Rights Reserved

Formats disponibles

PDF, TXT ou lisez en ligne sur Scribd

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

© All Rights Reserved

Formats disponibles

Téléchargez comme PDF, TXT ou lisez en ligne sur Scribd

0 évaluation0% ont trouvé ce document utile (0 vote)

217 vues53 pagesMbe Unidad 4. Lectura Comprensiva Estadistica Bivarial Junio 2014

Transféré par

nonizurDroits d'auteur :

© All Rights Reserved

Formats disponibles

Téléchargez comme PDF, TXT ou lisez en ligne sur Scribd

Vous êtes sur la page 1sur 53

1

UNIDAD 4. ENTENDIENDO ESTADSTICAS PARA

MEDICINA BASADA EN EVIDENCIAS DE DUDAS

TERAPUTICAS

OBJ ETI VOS DE APRENDI ZAJ E

Comprender e interpretar indicadores estadsticos en literatura cientfica para aplicar en la

toma de decisiones.

ACTI VI DAD DE APRENDI ZAJ E 1

1. Lea el texto que se presenta a continuacin utilizando las tcnicas de lectura comprensiva,

sistemtica y elabore resmenes o cuadros sinpticos.

2. Identifique los indicadores estadsticos que se adjuntan en los resmenes y artculos

cientficos proporcionados por el tutor.

3. Analice los indicadores de efectividad o eficacia de los artculos proporcionados utilizando

el grfico de anlisis de direccin y fuerza del efecto y la significacin estadstica de los

mismos.

1. INTRODUCCN AL ANLISIS DE DATOS

La compresin de indicadores estadsticos y la interpretacin de los resultados de un

artculo cientfico constituyen un gran reto para el desarrollo de las habilidades de lectura

comprensiva y del anlisis crtico. Cada tabla o figura debera ser evaluada

preguntndose Qu pienso que significa realmente? La discrecin es la palabra clave:

resultados grandes, excitantes o inesperados son extremadamente raros. En contraste,

estudios defectuosos y hallazgos equivocados son mucho ms comunes. Los resultados

deben ser abordados con cuidado para evaluar su significancia o confiabilidad y para

observar posibles peligros en el anlisis.

Esta unidad presenta las ideas fundamentales para interpretar resultados y evaluar si los

resultados fueron adecuadamente procesados y analizados.

2. CONCEPTOS BSICOS

Variable: Un proceso de la realidad que cambia o varia de sujeto a sujeto.

Es una variacin a ser medida.

Valor: Son los elementos concretos de la variable.

Opcin: Valor preciso de una variable.

Parmetro: Valores de la poblacin.

Estimador: Valores de la muestra.

Muestra: Parte o subconjunto de la poblacin.

Poblacin: Conjunto de unidades relevantes de la poblacin.

2

3. EVALUACIN DEL DISEO DE ANALISIS Y DEL

ANLISIS DE DATOS

3.1. REVISIN DEL DISEO DE ANLISIS DE DATOS

Antes de revisar las tablas o grficos se debe primero leer como el autor analiz los datos

en la seccin metodologa. En este captulo debe constar el diseo del anlisis en el cual

se debe considerar el diseo de la investigacin, por lo que es necesario revisar las

hiptesis u objetivos del estudio y analizar si el anlisis corresponde a las mismas.

Si la hiptesis u objetivo es descriptivo, se debe realizar anlisis univarial, pero si es

explicativo o de asociacin se deber haber realizado anlisis bivarial o multivarial. En

este segundo caso es importante reconocer como se clasificaron las variables de acuerdo

a su ubicacin causal, Cul o cules son dependientes (o efecto) y cules

independientes (factores de riesgo o exposiciones)? y dentro de estas cul es la variable

antecedente simple o causal directa, las intervinientes (cofactores y moderadoras o

interaccin) y las perturbadoras, etc.

Analice si el diseo planteado coincide con las tablas y grficos, considerando la

exposicin, los efectos y los potenciales variables de confusin o perturbadoras y

variables moderadoras.

Observe como se definieron los subgrupos y categoras de cada una de las variables. Las

forma de estructurar subgrupos se debe basar en: i) los conocimientos que se tiene sobre

el objeto de estudio, ii) las hiptesis biolgicas de importancia y iii) de la manera en que

el estudio va a ser (o fue) conducido. Los estudios tienen mayor posibilidad de ser tiles si

el anlisis toma en cuenta asociaciones y pruebas de hiptesis, basadas en la biologa

ms que en la mecnica (o electrnica), comparando toda posible exposicin (variable

independiente) con cada dao o efecto posible (variable dependiente).

3.2. EVALUACIN DEL ANLISIS DE DATOS

3.1.1. REGLAS PARA LEER EL ANLISIS DE DATOS

Tres son las reglas ms importantes a seguir en la lectura del anlisis de datos:

1. El anlisis de datos debe ir desde lo simple a lo complejo, las tcnicas de anlisis

sofisticadas no pueden reparar una informacin de mala calidad (mala representatividad,

sesgo sistemtico, sesgos por falta de respuestas de los encuestados). Por ello es

importante primero analizar la informacin ms simple.

2. Evaluar la consistencia de la informacin, que implica evaluar la presencia de valores

imposibles, duplicados, datos extraos y el porcentaje de no respuesta (datos en blanco).

3

Tanto las tablas simples como la representacin grfica permiten observar los valores que

difieren ostensiblemente del resto (valores extraos o fuera de rango) y los llamados

valores imposibles.

Los valores extraos y los fuera de rango son aquellos que es posible encontrar

pero que no se esperaran encontrar, por ejemplo valores de hemoglobina

menores de 5 o edad mayor de 80 aos.

Los valores imposibles son aquellos cuya existencia no es factible. Por ejemplo,

cuando se estudia la variable sexo se esperan solo dos cdigos: M para masculino

y F para femenino y no otra letra como G o N. La importancia de estos valores

extraos radica en que pueden alterar los resultados estadsticos (asociacin,

significacin, estimacin) pudiendo modificar la interpretacin de los resultados.

El evaluar si la informacin es correcta y limpia de errores es ms importante que

proceder a analizar las pruebas estadsticas sofisticadas. Una elevada proporcin de

datos en blanco (missing value) es una importante fuente de sesgo que con frecuencia

es considerada al evaluar la validez de las investigaciones. Es necesario primero

determinar el porcentaje de no respuestas dentro de cada variable, y apreciar si esto

afecta a los resultados; obviamente con las variables fundamentales de estudio no se

debera aceptar un alto porcentaje de no respuestas.

3. Evaluar el uso adecuado de las tcnicas estadsticas. Para cumplir este objetivo a

continuacin se presentan los elementos necesarios para poder evaluar si el anlisis de

datos se hizo o no adecuadamente.

3.1.2. TIPOS DE ANLISIS DE DATOS

El anlisis de informacin se puede clasificar de varias formas, las mismas que no son

excluyentes:

A AN N L LI IS SI IS S D DE ES SC CR RI IP PT TI IV VO O E E I IN NF FE ER RE EN NC CI IA AL L

Descriptivo

Es el anlisis de las caractersticas de las variables en la muestra (anlisis univarial) y la

explicacin de las relaciones entre variables (anlisis bivarial o multivariado). El anlisis

estadstico se puede hacer en muestras en muestras o en la poblacin (cuando se trabaja

con censos).

Con mucha frecuencia se diferencia descripcin de explicacin, pero en Estadstica el

anlisis descriptivo abarca las dos actividades: la descripcin de las caractersticas de las

variables y la explicacin de sus relaciones.

Inferencial

Este anlisis se refiere a como pasar de los hallazgos de la muestra a sacar conclusiones

en el universo. Incluye la estimacin y la significacin estadstica.

4

A AN N L LI IS SI IS S U UN NI IV VA AR RI IA AL L Y Y M MU UL LT TI IV VA AR RI IA AL L

Anlisis univarial se refiere al anlisis de una sola variable, puede ser descriptiva o

inferencial. Los objetivos del anlisis univarial son resumir y presentar la informacin de

cada variable individual.

Multivarial se refiere al estudio (descriptivo e inferencial) de dos o ms variables. En este

texto se diferencia anlisis bivarial (dos variables) de multivarial (ms de dos variables),

por las caractersticas y tcnicas particulares que estas dos modalidades presentan.

A AN N L LI IS SI IS S C CA AU US SA AL L, , F FA AC CT TO OR RI IA AL L Y Y C CL LA AS SI IF FI IC CA AT TO OR RI IO O

En los estudios epidemiolgicos y clnicos experimentales, cohorte, casos testigo o de

corte transversal se estudia con ms frecuencia la relacin causa efecto de dos o ms

variables. Este tipo de estudios necesitan un anlisis causal bivarial o multivarial.

4. EVALUACIN DE USO DE LAS TCNICAS DE

ANLISIS BIVARIAL

Para efectos de evaluacin de la eficacia o efectividad de intervenciones teraputicas en

esta unidad se enfatiza la comprensin de medidas estadsticas bivariales. Por lo que,

despus de haber revisado la distribucin de las variables claves de inters (anlisis

univarial), revise los cruces de variables. El conocimiento de las distribuciones simples y

de los cruces de variables garantiza la comprobacin de hiptesis.

Al igual que en el anlisis univarial, la eleccin del tipo y tcnicas de anlisis bivarial

depende de los objetivos de la investigacin, del tipo de datos que se estudian y de la

audiencia a la que va dirigida la investigacin. Adems de lo anterior, el uso de tcnicas

especificas de anlisis bivarial depende de: el tipo de variables que se manejan

(cuantitativas o cualitativas), su lugar en el estudio como variable independiente o

dependiente y el tipo de distribucin que tienen (normal, sesgada, leptocrvica, etc.).

Las tcnicas de anlisis pueden ser grficas o matemticas.

Para el anlisis matemtico bivarial se debe realizar dos tipos de pruebas estadsticas:

Medidas de asociacin o relacin, que son medidas descriptivas

Medidas de anlisis inferencial: de estimacin y de significacin estadstica.

Existen cuatro alternativas de anlisis bivarial:

1. Cuando las dos variables la independiente y dependiente son cualitativas

2. Cuando se cruza una variable independiente cuantitativa y la dependiente es

cualitativa

3. Cuando de cruza una variable independiente cualitativa y la dependiente

cualitativa

4. Cuando las dos variables con cuantitativas

5

En los estudios epidemiolgicos y clnicos, cuando se relacionan dos variables con

frecuencia se buscan relaciones causales. Para poder apreciar el grado de relacin que

tienen dos variables entre si, las ms importantes y usuales medidas son las que se

muestran en la siguiente tabla:

Variable dependiente

CUALITATIVA CUANTITATIVA

Variable

Independiente

CUALITATIVA

Coeficientes de

asociacin (RR,OR, RA,

NNT)

Diferencias de

medias o medianas.

CUANTITATIVA Regresin logstica

Regresin (r),

Correlacin ().

4.1.1. COEFICIENTES DE ASOCIACIN

El anlisis de la relacin de dos variables cualitativas se puede hacer mediante el clculo

de porcentajes en una tabla o mediante los coeficientes de asociacin.

Para el clculo de porcentajes en una tabla es necesario recordar algunas reglas bsicas

para evaluar el anlisis bivarial (cruces) entre dos variables cualitativas:

Identificar cual es la variable dependiente y cual la independiente. La variable

independiente en el ejemplo siguiente es FUMA (filas) y la dependiente es

CANCER DE PULMON (columnas).

El clculo de porcentajes debe ser en el sentido de la variable independiente. En el

ejemplo a continuacin se calcul los porcentajes en el sentido de las filas (fuma) y

el anlisis se hace comparando los resultados en el sentido contrario al calculado.

Ejemplo: Asociacin Tabaco y Cncer de Pulmn

FUMA CA. PULMON TOTAL

SI NO

No % No %

Si 40 90 10 20 50 100%

No 10 20 40 80 50 100%

TOTAL 50 100 50 100 100 100%

Aunque se calcul los porcentajes en sentido horizontal es decir en el sentido de la

variable independiente (FUMAR), pero para el anlisis se compara el porcentaje de

hombres que fuman con el de mujeres que fuman. En este ejemplo, se puede decir que

los que fuman tienen porcentaje ms alto de Cncer de Pulmn (90%) que los que no

fuman (20%).

Cuando se trata de tablas de dos por dos se debe calcular coeficientes de asociacin.

Estos coeficientes se clasifican en dos grupos

1. Coeficientes de producto cruzado: Riesgo Relativo, Razn de Productos Cruzados,

Diferencia de Riesgo.

2. Coeficientes basados en Chi cuadrado: Pearson, Tschuprow, CramerV

6

En este curso se revisarn solamente los Coeficientes de Producto Cruzado.

Medicin del efecto

En el ejemplo anterior el objetivo del estudio era evaluar el riesgo o proteccin. Cuando se

trata de medir la eficacia de un medicamento lo ms comn es que los ensayos clnicos

controlados midan la incidencia de algn evento en los grupos de individuos seguidos en

un determinado lapso y que este evento se exprese de manera dicotmica (es decir, la

presencia o no del desenlace: infarto al miocardio, recurrencia de una neoplasia, muerte,

etc.) como la proporcin de sujetos que llegan a presentarlo.

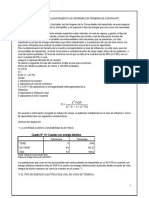

Para entender mejor el anlisis de efecto a continuacin se desarrolla un ejemplo de un

estudio en el que 20% (0.20) de los enfermos en el grupo control fallecieron en contraste

con slo 15% (0.15) de los que recibieron el tratamiento en evaluacin (Tabla 1)

Enfermedad/ efecto

+ -

Exposicin Si A 15 B 85 H1 100 I(+) = 15/ 100 = 0.15

No C 20 D 80 H2 100 I(-)= 20 / 100 = 0.20

V1 35 V2 165 N 200

Primero calculamos las Tasas de Incidencia para cada grupo

Riesgo del evento en los pacientes con el tratamiento (grupo experimental)

I (+) = 15/100 = 0.15 o 15%

Riesgo del evento en los pacientes sin el tratamiento (grupo control)

I (-) = 20/100 = 0.20 o 20%

C Co oe ef fi ic ci ie en nt te es s d de e P Pr ro od du uc ct to o C Cr ru uz za ad do o

Estas medidas de asociacin evalan la magnitud de la fuerza o poder de la asociacin

estadstica entre la exposicin y el efecto o la enfermedad estudiada. Para poder calcular

estos coeficientes se debe articular adecuadamente una tabla de 2 x 2, el diseo debe ser

el que se presenta en el ejemplo siguiente:

H1 y V1 representa los totales horizontal y vertical en los cuales la enfermedad o la

exposicin estn presentes. H2 y V2 son los totales en los cuales la exposicin o la

enfermedad estn ausentes. N es el gran total producto de la suma de todas las celdas.

Por ejemplo, se estudi un brote de gastroenteritis despus de una fiesta (que es el

efecto). Se sospech del pollo frito como el alimento causante, se quiere comprobar si fue

este alimento el causante y por lo tanto esta es la exposicin.

7

Enfermedad/ efecto

+ -

Exposicin Si A 40 B 170 H1 210 R1 = 40/ 210 = 0.19

No C 10 D 190 H2 200 R0 = 10 / 200 = 0.05

V1 50 V2 360 N 410 Rt = 50 / 410 = 0.12

El primer paso es calcular tasas de ataque de la enfermedad en los casos que se evala

riesgo y Tasas de Incidencia para los que comieron pollo (expuestos) a la que se

denominar Riesgo 1 (R1) y para los no expuestos Riesgo 0 (R0).

Con estos dos datos se pueden calcular los siguientes coeficientes:

a. Riesgo Relativo o Razn de Tasas

La razn de tasas es simple, el riesgo en el grupo de expuestos dividido para el grupo de

no expuestos:

Riesgo Relativo (RR) = R1 / R0 = (A/H1) / (C/H2)

RR = 0.19 / 0.05 = 3.8

Al igual que la diferencia de riesgo, la razn de tasas refleja tambin el exceso de riesgo o

de efecto en el grupo de expuestos o grupo de intervencin comparado con el grupo no

expuesto o grupo de comparacin, pero expresado como una razn.

Un RR de 3.8 significa que los expuestos tienen 3.8 veces ms riesgo que los no

expuestos que tienen 1 de riesgo. No es 3.8 veces ms. El RR se utiliza en estudios de

Cohorte o en experimentales, porque permite calcular las tasas de incidencia de la

enfermedad segn la exposicin.

Cuando no existen diferencias de riesgo el resultado es 1. Si el valor del RR es mayor a 1

se considera mayor efecto o factor de riesgo, si es menor de 1 es factor de proteccin o

menor efecto. Mientras ms alejado este de 1 el resultado de RR, significa que hay mayor

fuerza o poder de la asociacin entre exposicin y enfermedad o efecto.

En Ingles se denomina Relative Risk (RR) o Harm Risk (HR)

b. Razn de Productos Cruzados o Razn de Momios (ODDS RATIO)

Se puede calcular los riesgos de expuestos y no expuestos (R1, R0), no solamente con

tasas, sino tambin con Razones y con estos resultados calcular la razn de razones o

razn de riesgos. Para el efecto se calculan razones entre casos con efecto y casos sin

efecto para cada uno de los grupos.

Razn de evento y no evento en los pacientes expuestos o con el tratamiento

(grupo experimental)

R1 = 15/100 = 0.15 o 15%

8

Razn de evento y no evento en los pacientes no expuestos o sin el tratamiento

(grupo control)

R0 = 20/100 = 0.20 o 20%

Efecto

+ -

Exposicin Si a 40 b 170 210 R1 = 40/ 170 = 0,235

No c 10 d 190 200 R0 = 10 / 190 = 0,056

50 360 410 Rt = 50 / 360 = 0,13

La frmula para el clculo de la razn de razones es:

OR = (a / b) / (c / d) = R1 / R0 = 0,235 / 0,056 = 4,5

El nombre que se utiliza con ms frecuencia para denominar a esta Razn es Razon de

Momios, porque momio es sinnimo de razn. La traduccin al Ingls es Odds Ratio

(Odds=momios; Ratio= razn).

Como se trata de una razn la interpretacin de la Razn de Momios es igual a la que se

hace con el Riesgo Relativo.

La razn de momios se denomina tambin Razn de Productos Cruzados o Razn de

Disparidades, debido a que la ecuacin anterior puede transformarse matemticamente

en una Razn de Productos Cruzados o Razn de Disparidades, como puede verse en

las siguientes ecuaciones:

Razn de Momios = (a / b) / (c / d)

Razn de Productos Cruzados = (a x d) / (c x b)

Aplicando la formula de productos cruzados el clculo sera el siguiente:

OR = (40 x 190) / (10 x 170)= 4,47= 4,5

Como se puede apreciar la Razn de Momios o de Productos Cruzados a ms de ser fcil

de calcular, es una medida til de asociacin porque mide tambin la diferencia de riesgo

o de exposicin entre enfermos y no enfermos, lo que le hace til para estudios de Casos

y Testigos, Corte Transversal y en cohortes de enfermedades raras, en las cuales las

muestras son pequeas.

Es importante enfatizar que esta medida en espaol puede tener varios nombres:

Razn de Momios o Razn de Razones. Momio es un sinnimo del trmino razn

Razn de Productos Cruzados o Razn de Disparidades.

En ingls solo tiene una denominacin Odds Ratio (OR)

9

c. Reduccin del riesgo relativo (RRR) o fraccin de prevencin

La Reduccin de Riesgo Relativo (en Ingls Preventive fraction (PF) o Preventable

Fraction, se calcula a partir del Riesgo Relativo o de la Razn de Momios (OR).

Se debe usar cuando una exposicin reduce el riesgo y provee el porcentaje de casos

que puede evitarse o prevenirse si una poblacin se expone a una intervencin,

comparada con una no expuesta.

La reduccin del riesgo relativo (RRR) se expresa como un porcentaje. La frmula para

calcular esta medida es:

RRR = [(1 Riesgo Relativo) *100] o [(1-Razn de Momios)*100]

Ejemplo:

Para el ejemplo de Medicin de Efecto el resultado es:

RRA = I(-) I(+) = 0.15 0.20 = 0,75

Con este dato se calcula el RRR

RRR= (1 0,75) *100= 25%

Esta cifra significa que el nuevo tratamiento reduce el riesgo de sufrir el evento (morir o

enfermar) en 25% con relacin a lo que ocurre en los pacientes del grupo control;

mientras mayor sea la RRR mayor es la eficacia del tratamiento.

d. Diferencia de efectividad, Diferencia de riesgo, Riesgo Atribuible o Reduccin

del riesgo absoluto (RRA)

La diferencia de riesgos o diferencia de eficacia se calcula de una manera simple, se resta

del riesgo o efectividad de expuestos el riesgo o efectividad del grupo de no expuestos.

Diferencia de riesgos (DR) = R1-RO = a/H1 - c/HO

DR = 0.19 - 0.05 = 0.14 = 14 %

La diferencia de riesgos refleja el exceso de asociacin de riesgo de exposicin.

Si no existira diferencia de enfermar entre expuestos y no expuestos el resultado ser 0.

Valores con signo positivo significan riesgo o efecto mayor y valores con signo negativo

riesgo o efecto menor.

Mientras ms alejada este de 0, mayor ser la asociacin entre el factor de exposicin y

el efecto.

En Ingles puede tener dos denominaciones:

Atributable Risk (AR)

Efficacy Difference (ED)

Risk Diference

10

e. Nmero Necesario a Tratar (NNT) y Nmero Necesario para hacer Dao

El Numero Necesario a Tratar (NNT), Number Needed to Treat en Ingls, es una medida

de la eficacia de un tratamiento. Es el nmero de personas que se necesitara tratar con

un tratamiento especfico (ej. aspirina a quienes han sufrido un ataque cardaco) para

producir, o evitar, una ocurrencia adicional de un evento determinado (ej. prevencin de

muerte). Por ejemplo, si una droga tiene un NNT de 5, significa que se debe tratar 5

personas con esta droga para prevenir un resultado negativo adicional. El NNT es una

medida de probabilidad.

Para calcular el NNT usted necesita conocer el Riesgo Atribuible (RA) o la Reduccin

Absoluta de Riesgo (AAR).

Donde RA = Tasa del Evento en Grupo Control (TEGC) - Tasa del Evento en el Grupo

Experimental (TEGE).

El NNT es lo contrario del RA

NNT=1/RA (RA calculado en proporcin)

Si se calcula a partir del RA en porcentaje la formula es:

NNT = 100 / RA (calculado en porcentaje)

Ejemplo: NNT = 1 / 0,14 = 100 / 14 = 7,14

Nmero necesario a daar o perjudicar (NND) o Number Needed to Harm (NNH), es

una medida de los efectos adversos de un tratamiento, definida de modo similar al NNT,

como el nmero de personas que hay que tratar para producir un efecto adverso adicional

(ej. aspirinas para producir trastornos gstricos). Puede expresarse con valores negativos

por ejemplo -3.

Calculo de NNT a partir del RR o del OR

Es posible calcular el NNT y el Numero Necesario a Tratar (NNH) a partir de la razn de

Momios u Odds Ratio (OR) con las siguientes formulas:

NNT = (1-(TEEP*(1-OR))) / ((1-TEEP)*(TEEP)*(1-OR))

NNH = ((TEEP*(OR-1))+1) / (TEEP*(OR-1)*(1-TEEP))

Donde TEEP es Tasa de Eventos Esperados en Pacientes, en Ingls Patient Event

Expected Rate (PEER), que es el riesgo de tener un evento en la poblacin. Esta tasa es

la incidencia o prevalencia en la poblacin que es la prevalencia en el grupo no expuesto.

11

Ejemplo:

Enfermedad/ efecto

+ -

Exposicin Si a 40 b 170 210 R1 = 40/ 170 = 0,235

No c 10 d 190 200 R0 = 10 / 190 = 0,056

50 360 410 Rt = 50 / 360 = 0,13

OR = (a / b) / (c / d) = R1 / R0 = 0,235 / 0,056 = 4,47

Aplicando la formula anterior el resultado es:

NNT = (1-(0,05*(1-4,47))) / ((1-0,05)*(0,05)*(1-4,47))

NNT = 7,12, un poco menor al NNT calculado a partir del Riesgo Atribuible que fue de 7,5.

Hay que recordar que el OR presenta siempre valores superiores al RR.

Para calcular el NNT a partir del OR se puede disear un programa en Excel. Se adjunta

a este curso un programa para el clculo del NNT o del NND a partir del OR.

4.1.2. DIFERENCIA DE MEDIAS O MEDIANAS

El anlisis descriptivo bivarial de diferencia de medias o promedios y de diferencia de

mediana es muy simple, se trata de cuantificar la diferencia entre las medias o medianas

muestrales restando el promedio del grupo no expuesto del promedio del grupo expuesto.

En este caso la variable independiente es cualitativa y la dependiente cuantitativa.

De igual forma que con la diferencia de tasas o proporciones 0 es igual riesgo o igual

efecto, valores con signo positivo son mayor riesgo o mayor efecto y valores con signo

negativo son menor riesgo o menor efecto.

Ejemplo:

Promedio de peso en Kg en nios

Grupo experimental 39,26

Grupo Control 32,93

DIFERENCIA + 6,33 Mayor riesgo o mayor efecto

Promedio de peso en Kg en nios

Grupo experimental 39,26

Grupo Control 39,26

DIFERENCIA 0,00 Igual efecto

Promedio de peso en Kg en nios

Grupo experimental 32,93

Grupo Control 39,26

DIFERENCIA - 6,33 Menor riesgo o menor efecto

12

La diferencia de promedios o medias se utiliza cuando las distribuciones de los dos

grupos son simtricas o normales.

LA diferencia de mediana se utiliza cuando las distribuciones de los dos grupos en

comparacin son asimtricas o sesgadas o tambin cuando el un grupo tiene una

distribucin normal y el otro grupo asimtrica.

4.1.3. CORRELACIN Y REGRESIN

C Co or rr re el la ac ci i n n

Es una prueba de asociacin que se utiliza cuando se quiere establecer la presencia o

ausencia de una correlacin o asociacin entre dos variables cuantitativas: una

dependiente Y y la otra independiente X.

Esta prueba permite ver el grado en que varan conjuntamente las dos variables, aunque

el descubrir la existencia de una relacin no dice mucho del grado de asociacin o

correlacin. Por ejemplo se dice que los gastos estn relacionados con el ingreso: gasto

ms cuando gano ms, aunque no siempre sucede as, porque hay personas que

teniendo un ingreso alto gastan poco. El peso y la talla estn asociados: mientras ms

alto, ms peso, sin embargo algunas personas altas pesan poco y algunas pequeas

pesan mucho.

La CORRELACION vara respecto a su fuerza, estas variaciones se pueden apreciar por

medio de un diagrama de dispersin.

El diagrama de dispersin o dispersograma

Es un grfico que permite ver la forma en que se distribuyen los puntajes de dos variables

X y Y en toda la escala de los posibles valores de los puntajes. Este diagrama tiene

como base un sistema de coordenadas, en el que la variable Y que es la variable

dependiente se ubica en la lnea vertical y la variable X que es la independiente en la

lnea horizontal.

En el diagrama de dispersin se puede observar la fuerza de correlacin entre X y Y, la

misma que aumenta a medida que los puntos se van juntando y van formando un lnea

recta imaginaria por el centro del grfico.

El coeficiente de correlacin r

Se expresa con la letra r y es el valor que expresa numricamente tanto la direccin

como la fuerza de la correlacin lineal. Indica la estrechez de la asociacin. Esta medida

puede ir de un valor de -1 a un valor de +1.

Para analizar esta medida de estadstica bivarial se utilizan tres criterios:

Direccin de la correlacin

13

La direccin de la correlacin puede ser:

Directa o positiva

Negativa

La correlacin es positiva cuando los puntajes en el diagrama de dispersin muestran una

tendencia hacia arriba y hacia la derecha. Los puntajes altos de Y se asocian con los

puntajes altos de X y los bajos de Y con las bajos de X La lnea equidistante entre los

puntos denominada lnea de regresin tiene una direccin de descendente.

Ejemplos:

La correlacin es negativa cuando la tendencia de los puntajes en el diagrama es hacia

abajo y hacia la derecha. A puntajes bajos de la variable X corresponden valores altos de

la variable Y y a valores altos de X, los de Y son bajos. Es decir a un incremento de la una

variable la otra decrece. Por ejemplo, cuando menos aos de estudio tienen los padres,

mayor es el nmero de hijos que tienen.

No correlacin cuando no hay ninguna relacin entre las variables X y Y, en este caso los

valores de X y de Y se distribuyen indistintamente como una nube.

Tanto la correlacin positiva como la negativa representan una relacin lineal en la que

los valores en el diagrama van formando una lnea recta. Existen otros tipos de

correlacin, as, la curvilnea, la cuadrtica, etc. En este curso se explica la correlacin

lineal nicamente.

El grado de asociacin entre dos variables cuantitativos se mide con tres medidas: el

coeficiente de correlacin, el coeficiente de regresin y la interseccin de Y

14

El signo que antecede al nmero indica la direccin de la correlacin. + si es positiva, - si

es negativa. Valores con signos positivos indican correlacin positiva, valores con signos

negativos indican correlacin negativa y valor igual a 0 ninguna correlacin.

Fuerza o poder

En cuanto al grado o nivel de fuerza o poder, mientras ms se acerca a -1 o a +1, la

fuerza de la correlacin es mayor.

El valor de r de -1 indica que la correlacin es negativa perfecta y +1 cuando es positiva

perfecta. Un valor igual a 0 significa ninguna correlacin. En la siguiente tabla se presenta

categoras de la fuerza o poder de la correlacin:

Correlacin negativa Correlacin positiva

-1

-0.99 a -0.75

-0.74 a -0.50

-0.49 a - 0.10

Correlacin negativa perfecta

Correlacin negativa fuerte

Correlacin negativa moderada

Correlacin negativa dbil

+0.10 a 0.49

+0.50 a 0.74

+0.75 a 0.99

+1.00

Correlacin positiva dbil

Correlacin positiva moderada

Correlacin positiva fuerte

Correlacin positiva perfecta

0.00 Ninguna correlacin

El coeficiente de correlacin nunca debe ser mayor a +1 o -1.

Para realizar un anlisis grfico de la correlacin hay que considerar el grado de

dispersin de los puntos de interseccin en relacin a la lnea de regresin. Si todos los

puntos estn en la lnea, la correlacin es perfecta. En el grfico siguiente la correlacin

es negativa perfecta, r igual a -1. En cambio en el grafico de la izquierda los puntos no

siguen una tendencia, por lo que no hay ninguna correlacin, r igual a 0.

En los grficos siguientes se presentan ejemplos de correlaciones positivas con diferentes

niveles de fuerza o poder de dbil (0,3) a fuerte (0,9).

15

R Re eg gr re es si i n n

Lnea de regresin

En la correlacin, en el diagrama de dispersin los valores se distribuyen de acuerdo a la

fuerza de asociacin y a su direccin en una lnea imaginaria que se va formando en el

centro. En la regresin, se identifica esta lnea como una lnea recta que se traza a travs

del diagrama de dispersin. En todos los grficos anteriores se presenta la lnea de

correlacin para cada nube.

Coeficiente de Regresin

Es una prueba estadstica que permite estudiar cambios concomitantes entre la variable

X (variable independiente) y la Y (variable dependiente), por lo que permite predecir los

valores de la variable Y a partir de los valores de la variable X. La regresin no indica

causalidad, indica la variacin promedial de la variable Y en relacin a un cambio de la

variable X.

Este coeficiente se expresa como (beta) y mide el incremento promedial de Y por

cada unidad de aumento de X. Por ejemplo, un =1 significa que si X cambia en una

unidad (1), Y cambia tambin en una unidad. Si el = 2, significa que si X cambia en

una unidad (1), Y cambia tambin en dos (2) unidades.

Ejemplo:

16

CONSIDERACIONES IMPORTANTES

Para evaluar si se utiliz adecuadamente la regresin lineal es importante tomar en

cuenta los siguientes aspectos:

1. La correlacin es til solamente cuando se quiere ver una asociacin entre X y Y.

2. Las muestras deben ser extradas aleatoriamente de la poblacin y deben ser

representativa de la misma.

3. Tanto la variable X como la Y deben tener la caracterstica de distribuirse

normalmente en la poblacin. Por lo tanto la muestra no de tener menor de 30 casos.

4. En caso que una o las dos distribuciones sean no normales o tengan menos de 30

observaciones se debe hacer una transformacin logartmica de datos para poder

utilizar correlacin y regresin lineal.

0

1

2

3

4

5

6

7

8

9

10

0 1 2 3 4 5 6 7 8 9 10

Y

X

=1

0

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

0 1 2 3 4 5 6 7 8 9 10

Y

x x

=2

17

5. ANALISIS INFERENCIAL

Hacer inferencia estadstica es pasar de los datos obtenidos en la muestra (estimador), a

calcular valores en la poblacin de la que se obtuvo la muestra (parmetro) con un cierto

grado de certeza o confiabilidad.

Existen dos tipos de pruebas de anlisis inferencial:

1. Pruebas de significacin estadstica o de estimacin de punto

2. Intervalos de confianza o estimacin de intervalo.

En el pasado en los artculos cientficos se presentaban simplemente tablas y grficos con

una descripcin y explicacin de los principales hallazgos. Actualmente se exige que la

evaluacin de la significacin estadstica de los hallazgos a travs del uso de pruebas de

significacin o intervalos de confianza. La necesidad de las pruebas de significacin y los

intervalos de confianza cobraron importancia por la presencia del error de muestreo en los

estudios.

5.1. ERROR DE MUESTREO

Cualquiera que sea el procedimiento de seleccin de los individuos de un estudio, el

tamao de la muestra y de las medidas estadsticas calculadas, siempre hay la

probabilidad de que exista un error de muestreo que afecta los resultados. Los efectos

del error de muestreo son ms evidentes cuando las muestras son ms pequeas.

Supongamos que en el universo de una poblacin en estudio tienen el 50% de varones y

el 50% de mujeres. Si se toma una muestra de diez nios, aunque esperaramos que

cerca de la mitad podran ser mujeres, no deberamos sorprendernos si se encuentra

siete mujeres y solamente tres nios varones. Si se toma una segunda muestra, el

obtener cuatro mujeres y de seis varones, tampoco debera sorprendernos. El ejemplo

anterior nos hace ver que debido al error de muestreo rara vez tendramos 50% mujeres y

50% varones en muestras pequeas.

Los efectos del error del muestreo se presentan en cualquier circunstancia en la

investigacin mdica. Supongamos que dos tratamientos se estn comparando en un

estudio clnico controlado. Los pacientes han sido asignados aleatoriamente (por sorteo)

en dos grupos. Aunque la asignacin aleatoria o randomizacin evita diferencias

sistemticas (o debidas al azar) entre los dos grupos, no evita que existan diferencias por

error de muestreo. Por ejemplo, podra suceder que en uno de los dos grupos de estudio

existan mas pacientes enfermos graves, creando una diferencia aparente entre los

tratamientos aunque en realidad no existan. En la prctica es poco usual que dos grupos

de un estudio clnico controlado sean exactamente iguales, hay con frecuencia pequeos

errores de muestreo entre ellos y es raro encontrar errores de muestreo grandes o

diferencias entre los dos grupos.

La importancia del error de muestreo radica en la magnitud con la cual este afecta los

resultados observados. Algunas veces puede encontrarse un resultado interesante, pero

18

este puede tratarse de un hallazgo casual estadstico. Afortunadamente los mtodos

estadsticos inferenciales nos permiten probar si los resultados observados se deben o

no se deben a un error de muestreo. Un concepto central en estos mtodos es el

concepto de probabilidad.

5.2. PROBABILIDAD

La probabilidad de obtener un seis, al lanzar un dado es uno en seis; la probabilidad de

ganarse un sorteo de navidad, con un solo guachito en el que se imprimieron 1000

boletos en uno en mil. La probabilidad, es simplemente, una forma de describir cmo un

evento puede ocurrir probablemente.

Las probabilidades se pueden expresar en porcentajes, pero en estadstica son casi

siempre expresadas en fracciones decimales. En este caso sera 1,0 sera igual a 100%.

Las probabilidades varan de entre 0,0 y 1,0, donde 0 significa que un evento nunca

suceder y 1 significa que hay la total certeza que suceder. Por ejemplo, si se expresa

en fracciones decimales 1 en 6 vendra a ser 0,167, resultado de dividir 1 para 6 y uno en

mil sera igual a 0,001.

La interpretacin de probabilidades es un poco difcil, cuando un evento tiene una

pequea probabilidad por ejemplo 0,001, es poco probable que suceda, cuando una

probabilidad es grande por ejemplo, 0,9 el evento es muy probablemente que suceda.

Por ejemplo la probabilidad de que un adulto sano muera algn da es de 1.0 (100%),

porque todos morirn algn da, en contraste la probabilidad de que un adulto muera

maana podra se menor que 1 en 100.000, o 0,00001.

Las probabilidades son un aspecto medular de la estadstica inferencial. Estos son

expresados con frecuencia en trminos de valor de p o valor de probabilidad, en la cual la

letra p significa probabilidad.

Se pueden escribir como p = 0,0003, indicando que un evento tiene 3 en 1000

oportunidades de ocurrir, es algo que casi no ocurrir. Se puede escribir tambin como p

< 0,001 o p < 0,005, donde el smbolo < significa menor que. El smbolo < es

ampliamente usado, pero escribir p < 0,01 es menos preciso que p= 0.003. El uso de <

est ampliamente usado, con lo cual se redondean las cantidades a ciertos valores; los

ms frecuentes son p<0,05, p<0,01 y p<0,001. Se recomienda dar el valor exacto de p,

porque el redondeo puede caer en un valor aproximado al mnimo aceptado, lo que echa

a perder la informacin porque no se puede conocer la probabilidad de cometer errores

Tipo I o Tipo II.

19

5.3. LA LGICA DE LAS PRUEBAS ESTADSTICAS

INFERENCIALES

Las pruebas o test estadsticos pueden parecer que han sido creados para dar

dificultades. Sin embargo son de gran utilidad porque es la nica forma de conocer si los

resultados obtenidos en la muestra son similares a los que obtendra si se estudiara a

todo el universo o poblacin de la que se extrajo la muestra. Lo anterior se conoce

tambin como validez externa o capacidad de generalizacin estadstica de un estudio.

Imagine que en un estudio clnico controlado en el que se comparan dos tratamientos, se

encontr que un tratamiento da mejores resultados que el otro. Pero como este resultado

es de una muestra de pacientes, es necesario estimar si los resultados obtenidos en esta

muestra se encontrarn tambin en el universo de pacientes de donde se obtuvo la

muestra. Para lograr este propsito el primer paso es proponer, que la diferencia

observada entre los tratamientos es debido solamente a un error de muestreo, es decir

que no hay diferencias entre los dos tratamiento en el universo. Esto no es lo que se

espera, con la lgica que se utiliza a menudo siempre se espera que un nuevo tratamiento

sea superior al convencional. Sin embargo, cuando se hace anlisis inferencial se inicia

planteando lo contrario a lo esperado a lo que se denomina Hiptesis Nula (H0) y el

resultado que se espera que suceda se denomina Hiptesis Alternativa o de trabajo (Ha).

Las pruebas estadsticas inferenciales indican la probabilidad (valor de p) de que, los

resultados obtenidos en la muestra se deban al error muestral. Cuando este valor es

pequeo, ejemplo p<0,01 se concluye que el resultado observado es improbable que

suceda por error, lo que lleva a rechazar la propuesta de que no hay diferencias entre los

tratamientos y por lo tanto a rechazar la hiptesis nula. Se puede concluir entonces que

uno de los tratamientos es realmente mejor que el otro, o dicho de otra manera los

resultados observados en el estudio (en el que se utiliz una muestra) tambin se dan en

el universo del que se extrajo la muestra o que el resultado es significativo o confiable.

El valor de p es una muy buena gua para analizar si los resultados observados pueden

deberse al error muestral: valores pequeos de p, indican que los resultados son

improbables que sucedan por error muestral. Sin embargo, es importante definir a que

denominamos un valor de p pequeo. Existe una regla conveniente pero arbitraria:

cuando el valor de p es menor de 0,05 (p<0,05) es decir 5%, se excluir el error muestral

como explicacin. Cuando se tiene un valor de p pequeo se puede decir que se ha

alcanzado significacin estadstica.

Sin embargo, el uso de esta regla arbitraria de p<0,05 no es una garanta. Supongamos

que se realizan una gran cantidad de test estadsticos, puede aparecer un resultado

estadstico espurio o incorrecto una vez en cada veinte pruebas. Esto se debe a que

p=0,05 significa una probabilidad de uno en veinte de que ocurra un evento. Hay dos

conclusiones de este anlisis:

1. Los estudios en los cuales se han realizado mltiples test de significacin darn

regularmente significados espurios.

20

2. Valores pequeos de p, es decir p<0,01 o aun p<0,001 daran una confianza mayor

de que el resultado no fue por un error de muestreo.

5.4. ANALISIS DE LOS ERRORES TIPO I Y TIPO II

La mayora de las investigaciones sociales, clnicas o epidemiolgicas tienen como

objetivo contrastar hiptesis que plantean diferencias entre dos o ms grupos o muestras.

La hiptesis nula sustenta que no hay diferencias entre dos muestras, posiblemente

porque han sido extradas de la misma poblacin; por lo tanto, cualquier diferencia

observada entre las muestras se considera como un hecho casual o debido al azar,

resultante nicamente del error de muestreo. Es por tanto la afirmacin a comprobar. La

hiptesis alternativa es la afirmacin a rechazar.

Desde el punto de vista terico, al aceptar la Hiptesis Nula (Ho) o la Hiptesis de Trabajo

(Ht) se pueden cometer dos tipos de errores:

Si se acepta la Ht y esta decisin es correcta no existe error. El error tipo I o error

alfa se comete cuando se rechaza una hiptesis nula siendo verdadera. La

probabilidad de cometer este tipo de error slo puede presentarse cuando rechaza

la hiptesis nula y vara de acuerdo al nivel de confianza que se imponga. Esto

puede suceder cuando el valor de p es cercano a 0,05, por ejemplo 0,049.

Por el contrario, si se acepta la hiptesis nula (Ho) y sta es falsa se comete un

error tipo II. A la probabilidad de cometer este error se le denomina Beta (). De

igual manera como en el caso anterior esto puede suceder cuando el valor de p es

mayor pero muy cercano a 0,05, por ejemplo 0,052.

ACEPTA Ho Ho Correcta No error

Ho Falsa Error Tipo II (beta)

ACEPTA Ht Ht Correcta No error

Ht Falsa Error Tipo I (alfa)

La probabilidad de cometer error alfa ser menor mientras haya ms rigor en el nivel de

confianza; es decir mientras ms pequeo sea el valor de p. As, con un valor de p de

0,001 la probabilidad de cometer Error Tipo I, es 1 vez en 1000, en cambio con un valor

de p de 0,049, tan cercano a 0,05 la probabilidad de cometer error Tipo I es mayor.

El riesgo de cometer error beta o tipo II ser menor si el valor de p esta lo ms alejado

posible del valor de referencia 0.05 o 0.01. Por ejemplo, con un valor de p de 0.1 la

probabilidad de cometer un error Tipo II ser pequeo, en cambio con un valor de p de

0.51, tan cercano al valor de referencia (0.05) la probabilidad de cometer un error Tipo II

ser grande.

De forma arbitraria, solo como referencia para entender lo explicado anteriormente, se

pueden transformar los valores de p a categoras de nivel de significacin estadstica o

confiabilidad como se muestra en el ejemplo siguiente:

21

Valor de p Nivel de significacin

0,049 Significacin o confiabilidad baja o dbil. Probabilidad de error tipo I.

0,0049 Significacin o confiabilidad moderada.

0,00049 Altamente significativo o altamente confiable

0,051 No estadsticamente significativo o no confiable. Probabilidad de error

tipo II.

0,08 No significativo o no confiable moderado

0,8 Altamente No significativo o no confiable

Cuando se observan en los artculos cientficos valores de p muy cercanos al valor de

referencia (0.05 o 0.01) una de las explicaciones es que el tamao de la muestra es muy

pequeo para demostrar la hiptesis. Por lo tanto, una forma de evaluar si el tamao de la

muestra es suficiente para cumplir los objetivos o demostrar las hiptesis es analizar los

valores exactos de p.

En general se consideran muestras pequeas para estudios experimentales y

observacionales analticos cuando se estudian menos de 100 individuos, muestras

aceptables de 100 a 400 personas y muestras grandes cuando superan las 400 personas.

Mientras ms grande la muestra ms pequeo o confiable ser el valor de p. Analizar el

tamao de la muestra es una forma rpida, pero no precisa de evaluar la capacidad de

generalizacin de un estudio.

5.5. EVALUACIN DEL TEST DE SIGNIFICACIN UTILIZADO

Para evaluar si se ha escogido adecuadamente el test de significacin estadstica es

importante conocer que esto depende de:

1. El tipo de variables en estudio, si son cualitativas o cuantitativas.

2. El tipo de hiptesis u objetivos del estudio. Se dividen en dos tipos:

Los que buscan asociaciones o relacin de dependencia/ independencia.

Los que contrastan resultados entre dos o ms grupos o muestras.

3. El tipo de diseo: independiente o pareado.

4. Comportamiento de la variables, si es normal o no normal (sesgada, platicrvica o

leptocrvica), o si las varianzas son diferentes entre los grupos o muestras que se

comparan.

5. Tamao de los grupos (muestras)

5.5.1. POR TIPO DE VARIABLE EN ESTUDIO

De forma muy esquemtica existen cuatro posibilidades:

1. La dos variables (independiente y dependiente) son cuantitativas,

2. Las dos variables son cuantitativas

3. La variable dependiente es cualitativa y la independiente cuantitativa.

4. La variable dependiente es cuantitativa y la independiente es cualitativa

A continuacin se expone una tabla resumen de las pruebas de significacin ms usadas

segn el tipo de variables.

22

Tabla 1. Pruebas de significacin estadstica segn tipo de variables

VARIABLE DEPENDIENTE

CUALITATIVA CUANTITATIVA

VARIABLE

INDEPENDIENTE

CUALITATIVA - 2 grupos: Z o t para

diferencia de

proporciones.

- Ms de 2 grupos

(tablas n x n) y tablas

- Tablas de 2 x2 :

Chi cuadrado o Test

Exacto de Fisher

- 2 grupos: Z o t para

diferencia de

promedios o medianas

- Ms de 2 grupos:

ANOVA.

CUANTITA-

TIVA

Regresin logstica 2 Grupos:

Correlacin r y

Regresin .

Por el nmero de elementos que intervienen en la muestra se deben utilizar la prueba t

cuando son menos 30 y la Z cuando son ms de 30.

P Pr ru ue eb ba as s d de e s si ig gn ni if fi ic ca ac ci i n n p pa ar ra a a as so oc ci ia ac ci i n n d de e v va ar ri ia ab bl le es s c cu ua al li it ta at ti iv va as s c co on n

c cu ua al li it ta at ti iv va as s

Las variables cualitativas nicamente pueden describirse como proporciones. Por ello,

entre variables cualitativas nicamente podremos realizar estudios de asociacin o

relacin entre dos variables, una variable independiente y una dependiente, nunca se

realizar comparacin de medias.

Si los datos son independientes, de entrada debe considerarse como test de eleccin la

prueba Chi cuadrado. No obstante, como este test presenta una serie de limitaciones en

ocasiones es preciso utilizar el test de exactitud de Fisher. En el caso de datos

cualitativos apareados se utilizar el test de Mac Nemar.

Chi Cuadrado

Se usa como prueba de significacin estadstica de las medidas de asociacin entre

variables cualitativas o para probar diferencias entre dos proporciones. Las dos categoras

deben ser mutuamente excluyentes e independientes. Existen tres variantes de Chi

cuadrado:

1. Chi cuadrado sin correccin, que se utilizan cuando los valores esperados en cada

celda es mayor o igual a cinco.

2. Mantel Haenszel, que se utiliza cuando existen variables perturbadoras

3. Correccin de yates, se utiliza cuando los valores esperados en cada celda son

menores de cinco.

Los valores esperados constituyen los valores tericos que tendra la distribucin si no

existiran diferencias entre las categoras de las variables estudiadas. Para esto se

calculan los valores tericos o esperados de cada celda, multiplicando el total de la fila por

el total de la columna en la que est la celda y luego se divide para el total de las

23

observaciones. Con esto se consigue tener una cantidad que distribuye el total de la

columna, tomando en cuenta el peso que tiene la fila correspondiente.

Ejemplo:

GRUPO

SOCIAL

OBSERVADOS ESPERADOS

Enfermos Sanos Total Enfermos Sanos Total

Expuestos 21 a 79 b 100 13 a 87 b 100

No expuestos 5 c 95 d 100 13 c 87 d 100

TOTAL 26 174 200 26 174 200

Valores esperados:

a = 26 x 100 / 200 = 13

b = 174 x 100/ 200 = 87

c = 26 x 100 / 200 = 13

d = 174 x 100 / 200 = 87

Si se calcula tasas de incidencia de expuestos y no expuestos en esperados, se puede

observar que no hay diferencias entre los dos grupos. Los dos grupos tienen una tasa de

enfermar de 14,9%. Por lo tanto los valores de esperados representan a la hiptesis nula

y lo que se trata es de medir las diferencias entre esperados y no esperados, si no hay

diferencias o las diferencias son pequeas se acepta la hiptesis nula.

Paquetes estadsticos como Statcalc de EpiInfo 6.04 proveen los tres tipos de Chi

Cuadrado, el investigador debe seleccionar cual es el ms conveniente para su anlisis. A

continuacin se presentan estas tres alternativas.

Valor Chi Valor p

Chi sin correccin 11,32 0,00076

Mantel Haenszel 11,26 0,0079

Correccin yates 9,95 0,001611

Como en este ejemplo no hay valores esperados menores de cinco en cada celda, se

debera usar Chi sin correccin.

Cuando se tiene tablas de contingencia de dos filas y mas de dos columnas (2 x n) o de

ms de dos filas y columnas (r x c), se utiliza e Chi de Pearson.

Prueba de exactitud de Fisher

Esta prueba es considerada el estndar de oro de las pruebas estadsticas, pues provee

un valor exacto de p mientras el Chi-Cuadrado provee un valor aproximado. Es la prueba

a escoger cuando los nmeros en la tabla son pequeos (valores esperados menores de

cinco en una o ms celdas).

Con esta frmula se calcula directamente el valor de p y no se necesita la tabla de Chi

Cuadrado.

Este test provee dos resultados: para una cola, como para dos colas. Para una cola se

refiere cuando calcula la probabilidad en una sola direccin, es decir comparando la

24

distribucin terica con una distribucin en la que se conoce por estudios o referencias la

direccin de la asociacin. De dos colas se debe usar cuando no se desconoce la

direccin de la asociacin.

Ejemplo si la Ht dice que el OR es mayor de 1 es de una cola, si la Ht dice que OR puede

ser mayor o menor a 1 es de dos colas.

P Pr ru ue eb ba as s d de e s si ig gn ni if fi ic ca ac ci i n n p pa ar ra a c co om mp pa ar ra ac ci i n n d de e p pr ro op po or rc ci io on ne es s

Comparacin de una proporcin con un estndar conocido.

Para comparar la proporcin de personas (P) con ciertas caractersticas (enfermedad)

con un valor estndar conocido, se utiliza una prueba de significacin de diferencias de

proporciones, utilizando la tabla Z distribucin normal para muestras de ms de 30

observaciones para identificar el valor de p y la distribucin T para muestras de menos

de 30 observaciones.

Ejemplo: Se tomaron 100 muestras para evaluar prevalencia de bocio en un rea

endmica, obteniendo una prevalencia de 18%. Se quiere evaluar el impacto de un

programa de intervencin. Se report 30% de prevalencia antes de la intervencin.

Diferencia de proporciones = 0,12 (12%)

Estadstico Z= 2,6 Valor de p= 0,01

Comparacin de dos porcentajes de dos muestras

Para comparar diferencias de dos muestras con proporciones P1 y P2, se usa la prueba

de significacin de diferencia de proporciones. Al igual que en la prueba anterior para

identificar el valor de p se utiliza la tabla Z de distribucin normal para muestras de mas

de 30 observaciones y la distribucin t para muestras de menos de 30 observaciones.

Ejemplo: En la encuesta de prevalencia de alcoholismo en el Ecuador se encontr 360

alcohlicos para la sierra y 280 para la costa. Se quiere saber si estas dos diferencias son

significativas. La muestra de la Sierra fue de 3600 y la de la Costa 4000.

Diferencia de proporciones = 0,10 0,07 = 0,03 (3%)

Estadstico Z = 4,66 Valor de p = 0,0000 (< 0,0001)

P Pr ru ue eb ba as s d de e s si ig gn ni if fi ic ca ac ci i n n p pa ar ra a c co om mp pa ar ra ac ci i n n d de e p pr ro om me ed di io os s

Cuando la variable independiente es cualitativa y la dependiente es cuantitativa se deben

utilizar pruebas de significacin estadstica para diferencia de promedios o medianas.

Para diferencia de promedios hay dos tipos de pruebas: la Prueba Z y la Prueba t de

student.

25

Prueba z

Es una prueba de hiptesis paramtrica, que se utiliza para ver si la diferencia que

existe entre valores de dos muestras es estadsticamente significativa o se debe al

azar. Se utiliza para comparan dos promedios o dos proporciones cuando las

muestras son mayores a 30 y su distribucin se aproxima a una distribucin

normal.

Prueba t o t de student

Es una prueba de hiptesis paramtrica, que se utiliza para ver si la diferencia que

existe entre valores de dos muestras es estadsticamente significativa o se debe al

azar. De preferencia se utiliza cuando las muestras son pequeas -menores a 30 -

aunque se puede utilizar en muestras mayores, en este caso su distribucin se

aproxima a una distribucin normal.

Es paramtrica porque las frecuencias se distribuyen bajo la curva normal o se

aproximan a lla. Toma como referencia los parmetros para estimar o probar. Esta

prueba permite convertir la diferencia de promedios o de proporciones en unidades

estandarizadas.

La prueba t debe interpretarse con referencia a los grados de libertad, los mismos

que varan directamente con el tamao de la muestra. Mientras mayor es el tamao

de la muestra, mayores sern los grados de libertad y mientras mayor sea los

grados de libertad ms se acercar la distribucin en la curva normal.

Grados de libertad: Tcnicamente se refiere a la libertad de variacin entre un

conjunto de puntajes. As, si se tiene una muestra de cinco puntajes o grupos,

cuatro son libres de variar, mientras que solo uno es valor fijo. En este caso, el

clculo de grados de libertad sera = 5 - 1 = 4 porque gl = n - 1.

Comparacin de una media de una muestra con un estndar conocido

En este caso se quiere probar si la media muestral tiene una diferencia significativa con

un estndar conocido. Para muestras de ms de 30 observaciones se utilizar la

distribucin Z. Para muestras pequeas de menos de 30 observaciones la frmula es la

misma, pero por tener una distribucin de t, el resultado se busca en una tabla de

distribucin T student con grados de libertad igual a n-1, porque se comparan solo dos

grupos.

El valor de p se obtiene mirando el valor calculado de z en la tabla de distribucin

normal o en la tabla t.

Ejemplo Prueba Z:

El promedio de Yodo en Sal de una muestra de 100 observaciones fue de 70 p.p.m con

una desviacin estndar de 15. El mnimo aceptable segn las normas del pas es de 67

p.p.m.

26

Diferencia de medias = 70 - 67 = 3

Estadstico Z = 2 Valor de p = 0,024

Ejemplo: El valor de glucosa en la sangre considerado como normal es de 100. Se

determin la glucosa en una muestra de 25 personas y se encontr que el promedio en

este grupo fue de 110 y la desviacin estndar de 10. Queremos saber si esta diferencia

es significativa, es decir que existe en la poblacin o se debe al azar.

Ho = No hay diferencia entre el promedio de glucosa encontrado con el valor

considerado como normal.

Ha = Existe diferencia entre el promedio de glucosa encontrado y el valor de

glucosa referencial.

Diferencia de medias = 110 - 100 = 10

Grados de libertad = n-1 = 25 - 1 = 24

Estadistico t = 5 Valor de p < 0.05.

Comparacin de medias de dos muestras

En este caso se quiere probar si una media muestral tiene una diferencia significativa con

otra media muestral. Si las dos muestras tienen ms de 30 observaciones se utilizar la

distribucin Z. Si una de las muestras o grupos o las dos tienen menos de 30

observaciones el valor de p se busca en una tabla de distribucin T student.

El valor de p se obtiene de la tabla Z de la curva normal para muestras de ms de 30

observaciones y la distribucin t para muestras de menos de 30 observaciones.

Ejemplo en muestras mayores a 30: Se comparan el contenido de Iodo en muestras de

sal de dos marcas. La marca Crissal tiene 69,5 ppm de iodo en sal y una desviacin

estndar de 2,5 en 50 observaciones. La marca Super Max tiene 70,1 ppm y DE 2,3 en 60

observaciones.

Diferencia de medias = 70,1 - 69,5 = 0,6

Estadstico Z = 1,18 Valor de p= 0,53

Se acepta la hiptesis nula, se rechaza la hiptesis alternativa o de investigacin

Ejemplo de muestras menores a 30: En un estudio se determin nivel de colesterol en

mujeres que toman anticonceptivos y en mujeres que no toman anticonceptivos.

Los resultados fueron los siguientes:

Toman anticonceptivos No toman anticonceptivos

Media colesterol 198 181

Desvio estandar 29 12

No pariciepantes 26 26

27

Hiptesis nula: No hay diferencia en los niveles de colesterol entre los dos grupos.

Hiptesis Alternativa: Si hay diferencia en los niveles de colesterol entre los dos grupos.

Diferencia de medias = -17

Estadstico t = 2,71 Valor de p = 0,04 (<0,05)

Se rechaza la hiptesis nula, se acepta la hiptesis alternativa o de investigacin.

Anlisis de varianza

Es un test de significacin estadstica que se usa cuando se cruza una variable cualitativa

con una cuantitativa y se quiere comprobar si las diferencias en los promedios de una

variable que presenta ms de dos categoras o muestras se deben al azar o existe en el

universo.

Cuando se realiza comparaciones entre promedios de dos muestras se utiliza la prueba t

o Z, pero cuando el nmero de comparaciones aumentan, es decir son 3, 4 o ms el

procedimiento que puede utilizarse es hacer pruebas -t- por separado. Esto implica no

slo gran cantidad de trabajo sino tambin una limitacin estadstica porque aumenta la

probabilidad de cometer el error alpha o Tipo I, es decir, rechazar la Ho cuando es

verdadera y debe ser aceptada, lo que implica obtener resultados estadsticamente

significativos por error de muestreo ms que por una verdadera diferencia poblacional.

Para superar este problema se utiliza la prueba ANALISIS DE VARIANZA (ANOVA). Esta

prueba permite comparar 3, 4 o ms promedios de diferentes muestras. La prueba calcula

la Razn F que indica la magnitud de la diferencia entre los grupos en relacin a la

magnitud de la variacin dentro de cada grupo.

Mientras mayor sea la razn F, es decir mientras mayor sea la variacin entre los grupos

en relacin con la variacin dentro de stos, menor ser el valor de p y por lo tanto mayor

ser la probabilidad de rechazar la Ho y aceptar la Ha o de trabajo. Esta prueba tambin

se interpreta con el valor de p de la misma manera que el Chi cuadrado.

Ejemplo: Promedio de peso en los estudiantes de 4 facultades de la universidad.

Variacin dentro del grupo:

DIBUJO

Variacin entre los grupos:

DIBUJO

RAZON F: Indica la magnitud de la diferencia entre los grupos en relacin a la magnitud

de la variacin dentro de cada grupo.

Mientras mayor sea la razn F, es decir mientras mayor sea la variacin entre los grupos

en relacin con la variacin dentro de stos, mayor ser la probabilidad de rechazar la Ho

y aceptar la Ht o de trabajo.

28

P Pr ru ue eb ba as s d de e s si ig gn ni if fi ic ca ac ci i n n p pa ar ra a r re eg gr re es si i n n y y c co or rr re el la ac ci i n n

Para analizar si los resultados de los coeficientes de correlacin y regresin se deben al

azar o son representativos del universo del que se obtuvo la muestra, se pueden usar los

Intervalos de Confianza o las Prueba F de significacin para el coeficiente de correlacin

r o para el coeficiente de regresin (Beta).

La lgica de anlisis es la misma que antes. Para lo cual es necesario definir la Hiptesis

Nula (Ho) y el Valor crtico de p.

5.5.2. SEGN EL TIPO DE HIPTESIS U OBJETIVOS DEL ESTUDIO

Como se puede analizar en la seccin anterior hay dos tipos de hiptesis u objetivos: los

que buscan asociaciones o relacin de dependencia/ independencia y los que contrastan

resultados entre dos o ms grupos o muestras.

Ya se seal previamente que las dos hiptesis principales a contrastar pueden ser las

diferencias entre promedios o proporciones de muestras (contrastar resultados) y la

relacin o asociacin entre dos variables cualitativas (evaluar asociaciones).

Tipo de hiptesis Pruebas de significacin estadstica

Relacin o asociacin Chi cuadrado

Test de exactitud de Fisher

Correlacin y regresin

Comparacin o contrastacin de

resultados

Z o t para diferencia de proporciones.

Z o t para diferencia de promedios

ANOVA

5.5.3. ANLISIS POR EL TIPO DE DISEO: INDEPENDIENTE O

PAREADO

Los datos apareados son aquellos que proceden de los mismos individuos en dos

condiciones diferentes. En general, se denominan a las pruebas que incluyen datos

apareados pruebas antes-despus. Por ejemplo en los estudios clnico controlados se

hacen mediciones antes despus en los mismos individuos.

Cuando los datos obtenidos proceden de diferentes individuos se denominan

independientes, por ejemplo cuando se hacen encuestas transversales en la misma

poblacin en dos ocasiones pero en dos muestras diferentes.

5.5.4. POR TIPO DE DISTRIBUCIN NORMAL O SESGADA

Si las muestras se distribuyen normalmente es preciso realizar un test de

homoscedasticidad: Si este test confirma la similitud de varianzas (valor de p mayor de

0,05 para diferencia de varianzas), indicar el empleo de test paramtricos. Si, por el

contrario las muestras no se distribuyen normalmente, se plantean dos opciones: emplear

29

directamente test no paramtricos o realizar las transformaciones. Hay que recordar que

la diferencia de promedios se utiliza cuando las distribuciones de los grupos analizados

son normales y la diferencia de mediana cuando una o ms de las distribuciones

evaluadas son asimtricas.

Para transformar una distribucin sesgada en normal se puede elevar al cuadrado u

obtener el logaritmo de cada observacin y obtener el promedio de esta distribucin.

P Pr ru ue eb ba as s p pa ar ra am m t tr ri ic ca as s

Si nos interesa evaluar la relacin de independencia-dependencia entre dos variables

emplearemos los estudios de correlacin. Si nos interesa comparar las medias de

diferentes grupos, en el caso de dos muestras emplearemos la prueba de la T DE

STUDENT, para datos pareados o independientes, y el ANALISIS DE VARIANZA en el

caso de que existan tres o ms muestras. El anlisis de varianza puede poner de

manifiesto que existen diferencias significativas entre los diferentes grupos; en este caso

es til conocer entre qu grupos existen diferencias. Para esto se har la DSH de Turkey

(Diferencia Significativa Honesta).

P Pr ru ue eb ba as s n no o p pa ar ra am m t tr ri ic ca as s

Los estudios de correlacin no paramtricos ms utilizados son el COEFICIENTE DE

CORRELACION DE SPEARMAN Y EL COEFICIENTE DE CORRELACION DE

KENDALL. Ambos coeficientes tienen un significado equivalente al coeficiente de

Pearson. La comparacin entre diferentes muestras con datos pareados se realiza

empleando el TEST DE WILCOXON.

Si las muestras son independientes existen varios test: algunos son sensibles nicamente

a medidas de tendencia central (U de MANN-WHITNEY) mientras que otros (prueba de

Kolmogorov-Smirnov para dos muestras o test de las rachas de Wald-Worfowitz) son

sensibles a diferencias en distribucin, tendencial central, etc. Si existen ms de dos

grupos, el equivalente al anlisis de varianza con un factor de variacin es el test de

Kruskal-Wallis, mientras si existen dos factores de variacin el equivalente al anlisis de la

varianza es el test de Friedman.

D Di if fe er re en nc ci ia as s e en nt tr re e l la as s p pr ru ue eb ba as s p pa ar ra am m t tr ri ic ca as s y y n no o p pa ar ra am m t tr ri ic ca as s

PRUEBAS PARAMETRICAS PRUEBAS NO PARAMETRICAS

Mayor potencia

Precisa mayor nmero de individuos en la

muestra

Mayor rigor matemtico

Solo datos cuantitativos

Aplicacin ms compleja

Ms conservadora

Precisa muestras de menor nmero.

Menor Rigor matemtico

Datos Cuantitativos o cualitativos.

Aplicacin ms sencilla

30

5.5.4. SEGN COMPORTAMIENTO DE LA VARIABLES

V Va ar ri ia an nz za as s s si im mi il la ar re es s o o d di if fe er re en nt te es s

Para conocer si las muestras o grupos tienen varianzas similares y diferentes se debe

realizar un test de homoscedasticidad (test de Hartley, test de Cochran y test de Bartllert)

adecuado a las condiciones del estudio. As, en presencia de varias muestras de tamao

similar debe considerarse cul es el nmero de grupos de estudio; si es inferior a doce

suele emplearse el test de Hartley, mientras que si es superior est indicado el test de

Cochran. Si el nmero de individuos de cada muestra es muy diferente debe utilizarse el

test de Bartllet, prueba que requiere como condicin de aplicacin que la muestra se

distribuya normalmente.

Si las variables tienen varianza similares se utilizan test paramtricos, pero si son

diferentes o heterogneas se deben utilizar test no paramtricos.

5.5.5. NMERO DE GRUPOS DE ESTUDIO

El test estadstico que debe utilizarse es diferente segn el nmero de grupos de estudio

(dos grupos o ms de dos grupos). En esta ltima circunstancia, debido a la posibilidad

de obtener diferentes significativas al azar (postulado de Bonferroni) lo adecuado es

realizar inicialmente un test que evale si existen diferencias significativas globales entre

todos los grupos. En este caso, deber realizarse a continuacin otras pruebas que

intentan descubrir entre qu grupos existen diferencias.

Un ejemplo de prueba para comparar los resultados entre dos o mas grupos es el

ANOVA.

5.5.6. PODER ESTADSTICO O CARCTER CONSERVADOR

En algunos casos, se disponen de varias pruebas estadsticas diferentes para un mismo

problema. La eleccin de una u otra prueba va a depender de varios factores, entre ellos

el carcter conservador o el poder estadstico de la prueba.

Un test ms conservador proporciona intervalos de confianza ms amplios y por lo tanto

es menos probable que detecte diferencias significativas si estas no existen. Por el

contrario, un test ms potente tiene ms capacidad para descubrir pequeas diferencias,

pero tambin es posible que localice diferencias que no poseen un significado real. Un

ejemplo de test ms conservador es el Chi cuadrado y un ejemplo de test ms potente el

Test exacto de Fisher

31

5.6. EVALUACIN DE LOS INTERVALOS DE CONFIANZA

A los Intervalos de Confianza se les denomina tambin Pruebas de Estimacin y consiste

en calcular un parmetro a partir de un estimador, o calcular el valor aproximado de una

variable en el universo de estudio (Intervalos de Confianza) a partir de los resultados de

la muestra. El propsito es que, a partir de los resultados de las muestras (estimador),

realizar generalizaciones en el universo del que proceden (parmetro).

Los Intervalos de Confianza (IC) proveen una va alternativa de evaluar los efectos del

error muestral y tienen ms informacin que las pruebas de significacin. Efectivamente,

los IC proveen un rango o intervalo en el cual puede estar el valor de la variable estudiada

en la poblacin (universo). Este rango puede tener distintos niveles de certeza o

probabilidad, en general en los estudios causales se usa un nivel de certeza o confianza

de 95%.

Supongamos que en un estudio clnico controlado de dos drogas anti-hipertensivas,

muestran que el promedio de la presin diastlica en sangre en un grupo tiene una

medicin de 95 mm. de mercurio, al mismo tiempo en el otro grupo tiene un promedio de

solo 90 mm. de mercurio. La diferencia de promedios de 10 mm. parece bastante grande

pero hay que recordar que este valor es el encontrado en las muestras y que puede estar

influenciado por el error muestral.

En este estudio clnico controlado se obtiene un IC95% de 3 a 17, que significa que la

diferencia de presin arterial en el universo podra ir de 3 como el valor mas bajo a 17

como el valor ms alto, aunque podra ser cualquier valor dentro del rango (3, 4, 5, 6, 7, 8,

.....16 o 17).

Los IC se expresan como: IC 95% 3 < 10 < 17

Se puede decir entonces esto que un intervalo de 95% de nivel de confianza, nos da un

rango en el cual nosotros tenemos 95% de certeza de que en este intervalo cae el valor

real de la variable en estudio en universo del que proviene la muestra. Tomando el

ejemplo anterior se puede decir que en la muestra la diferencia de promedios de presin

arterial diastlica es de 10 y que en el universo o poblacin de la que se tom la muestra

puede ser de 3 a 17 con una certeza o probabilidad de acierto del 95%.

Se pueden calcular Intervalos de Confianza para anlisis univarial o para anlisis bivarial.

En la siguiente seccin se explica intervalos de confianza para anlisis bivarial.

32

INTERVALOS DE CONFIANZA PARA ANLISIS BIVARIAL

Se pueden calcular IC para todos los parmetros estadsticos de anlisis bivarial:

1. Las medidas de asociacin: Riesgo Relativo (RR), Razn de Productos Cruzados

(OR) y Riesgo Atribuible (RA).

2. De la diferencia de promedios, medianas o proporciones de dos muestras

3. Del Coeficiente de Correlacin r y del Coeficiente de Regresin ()

En la siguiente tabla se presentan el tipo de intervalos a calcular segn las variables de

estudio.

Tabla 2. Intervalos de confianza segn tipo de cruces de variables

Variable dependiente

CUALITATIVA CUANTITATIVA

Variable

Independiente

CUALITATIVA

IC95% para RR,

OR, RA y NNT

IC95% para diferencias de

medias o medianas.

CUANTITATIVA IC95% para OR

ajustado

(Regresin

logstica)

IC95% para Coeficiente de

Correlacin r y Coeficiente

de Regresin .

LOS INTERVALOS DE CONFIANZA COMO PRUEBAS DE

SIGNIFICACIN

Los Intervalos de Confianza pueden tambin ser usados como pruebas de significacin

estadstica. El primer paso para hacer esto es plantearse la Ho y la Ht.

En el ejemplo anterior se plante que en un estudio clnico controlado de dos drogas anti-

hipertensivas, muestran que el promedio de la presin diastlica en sangre en un grupo

tiene una medicin de 95 mm. de mercurio, al mismo tiempo en el otro grupo tiene un

promedio de solo 90 mm. de mercurio. La diferencia de promedios de 10 mm.

En el ejemplo anterior la Ho planteara que el valor real de la diferencia entre los

tratamientos podra tener un valor cercano o igual a cero (0) en la poblacin de la que se

obtuvo la muestra, es decir que no hay diferencias. La Ha o Ht planteara que la diferencia

de promedios es diferente de 0. Si existe un valor igual a 0 dentro del intervalo aceptamos

la Ho y rechazamos la alternativa.

En este estudio clnico controlado se obtuvo un IC95% de 3 a 17.

IC 95% 3 < 10 < 17

33

En este ejemplo el 0 (cero) cae fuera de este intervalo por lo tanto concluimos que es muy

probable que este sea un valor real. Esto es equivalente a tener un valor de p menor de

0,05 y por lo tanto es estadsticamente significativo.

Otro aspecto interesante a analizar es la amplitud del intervalo, ya que a amplitudes

mayores significa que el tamao de la muestra fue pequeo y por lo tanto hay una

probabilidad mayor de cometer errores. Si el rango o amplitud es pequeo, ejemplo

IC95% 3 < 10 < 17, no es lo mismo que un rango o amplitud de 2 < 10 < 24. En este

ltimo caso la interpretacin es diferente, porque el lmite inferior est ms cercano a cero

y la amplitud es mayor, lo que nos da una mayor probabilidad de cometer un Error Tipo II

y por lo tanto que la evidencia no es lo suficientemente confiable para concluir que hay

diferencia entre los tratamientos.

En otro ejemplo, en un IC95% de -1 < 10 < 17, el cero (0) est dentro del intervalo, por lo

que aceptamos la Ho y rechazamos la Ha, por lo tanto el resultado no es estadsticamente

significativo. De igual manera si se tiene el un IC95% de 0.7 < 10 < 17 aunque el

resultado es estadsticamente significativo, el rechazar la Ho existe una alta posibilidad de

cometer un Error Tipo I.

En resumen en este ejemplo, si el valor 0 de la diferencia de promedios cae entre el

intervalo de confianza se concluye que no hay efecto, si cae fuera del rango nosotros

concluimos que la no presencia de efecto es improbable, esto es equivalente a decir que

los resultados fueron estadsticamente significativos

Los intervalos de confianza son siempre interpretados de la misma manera, tanto si se

trata de un estudio clnico controlado, un estudio de corte o cualquier otro tipo de estudio.

En todos se prueba la hiptesis de que no hay diferencia entre los dos grupos.

La formulacin de las hiptesis cambiar segn el tipo de estimador que se utilice. Por

ejemplo si se utiliza el Riesgo Relativo o la Razn de Momios para un estudio de un factor

las hiptesis diran:

Ho 1

HT > 1

Con un RR de 3, se tiene un IC95% de 2 < 3 < 5. En este caso el valor uno (1), no est

en el intervalo, por lo que rechazamos la hiptesis nula y aceptamos la alternativa.

La ventaja de los intervalos de confianza es que estos hacen mucho ms que solo indicar

si el resultado puede ser por un error muestral, muestran y permiten evaluar la magnitud

del error muestral, es decir cuan pequeo o cun grande el tamao real del efecto puede

ser.

5.7. IDENTIFICACION DE ERRORES DE ANALISIS INFERENCIAL

El valor de p y los intervalos de confianza proveen un gua til para la interpretacin de

resultados cuando el anlisis estadstico ha sido realizado correctamente, pero el reto es

identificar cuando el anlisis es errneo. Con los detalles que se presentan en los

34

artculos cientficos es difcil decir si hay errores en el anlisis. Todos los test de anlisis

hacen algunas presunciones acerca de los datos, pero en la medida que no hay acceso a

los datos crudos no es posible probar si existen o no en la realidad.

VALORES FUERA DE RANGO

De cualquier manera hay algunos aspectos que pueden servir para identificar posibles

errores. Cuando los datos son presentados en tablas y figuras hay la posibilidad de

identificar valores fuera de rango. Un valor fuera de rango es usualmente un valor muy

alto o un valor muy bajo. Por ejemplo muchos de los valores para la presin diastlica

sangunea de adultos en la poblacin general pueden esperarse que caigan entre 46,5 a

90mm. Hg, valores menores de 40 o mayores 250 pueden ser denominados fuera de

rango. Estos pueden ser datos correctos o pueden ser producto de errores de recoleccin.

La presencia de aunque sea un poco de observaciones que caen fuera del conjunto de

datos puede distorsionar los resultados porque tienen una gran influencia sobre el