Académique Documents

Professionnel Documents

Culture Documents

Estadistica II - Roberto Manchego

Transféré par

Rolando Terceros MoyaCopyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

Estadistica II - Roberto Manchego

Transféré par

Rolando Terceros MoyaDroits d'auteur :

Formats disponibles

Pruebas no paramtricas

VII-12

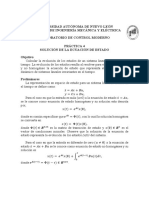

UNIVERSIDAD MAYOR DE SAN SIMN

FACULTAD DE CIENCIAS Y TECNOLOGA

DEPARTAMENTO DE MATEMTICAS

ESTADSTICA II

CAPTULO VIII

PRUEBAS NO PARAMTRICAS

SEMESTRE: II/2003

DOCENTE: Ing. Roberto Manchego C.

Cochabamba, Noviembre de 2003

Distribuciones de probabilidad

I-1

I DISTRIBUCIONES DE PROBABILIDAD

1.1 Variable aleatoria.- Una variable aleatoria X es una funcin de valor numrico que

asigna un nmero real a cada punto del espacio muestral de un experimento.

Se dice que X es aleatoria por que est asociada a la probabilidad de los

resultados del espacio muestral.

1.1.1 Variable aleatoria discreta.- Una variable aleatoria es discreta si la cantidad de

valores que puede tomar es un nmero finito o infinito numerable de valores.

1.1.2 Variable aleatoria continua.- Se dice que X es una variable aleatoria continua

cuando los valores que toma sta son de carcter fraccionario.

1.2 Distribucin de probabilidad.- Una distribucin de probabilidad de variable

aleatoria es el resultado de asignar valores de probabilidad a todos los valores

numricos posibles de dicha variable aleatoria, ya sea, mediante un listado o a travs

de una funcin matemtica.

1.2.1 Funcin de cuanta.- Es aquella distribucin de probabilidad de una variable

aleatoria discreta, funcin que se representa generalmente mediante un listado de

todos los valores numricos posibles de la variable aleatoria con sus probabilidades

correspondientes, tal como se observa en el Cuadro (1.1) y en la Grfica (1.1).

Cuadro (1.1)

DISTRIBUCIN DE PROBABILIDAD

DE LA VARIABLE X

x

i

p(x

i

)

x

1

p(x

1

)

x

2

p(x

2)

x

3

p(x

3

)

... ...

x

n

p(x

n

)

Distribuciones de probabilidad

I-2

0 X i x 1 x 3 x 2

p ( x 2 )

p ( x 3 )

p ( x 1 )

p ( X i )

Si x

i

es el valor de una variable aleatoria discreta y p(x

i

) la probabilidad de que

x

i

tome un valor en particular, todos los valores de p(x

i

) deben satisfacer las siguientes

propiedades:

-

0 ) x ( p

i

>

x i

N x e

- ( ) 1

1

=

=

=

n i

i

i

x p

x i

N x e

Por otra parte, la Funcin de distribucin acumulada de x

0

, es decir, la

probabilidad de que x sea menor o igual a un valor especfico x

0

se calcula con la

ecuacin (1.1).

( ) ( )

=

= s =

0

1

0 0

x i

i

i

x p x x p x F ) (

x i

N x e (1.1)

1.2.2 Funcin de densidad.- Es aquella funcin en la que la probabilidad de los

valores posibles de una variable aleatoria contnua se determinan a travs de una

funcin matemtica y se ilustra en forma grfica por medio de una curva de

probabilidad.

X

f ( X )

l s l i

Distribuciones de probabilidad

I-3

Si existe f(x), se debe cumplir:

- ( ) 0 > x f l.s. x l.i < <

- ( ) 1

.

.

=

}

s l

i l

dx x f

Es importante recordar que f(x) no representa ninguna probabilidad como tal y

que solamente cuando la funcin se integra entre dos puntos produce una probabilidad,

es decir:

( ) ( ) ( )

}

= s s = < <

b

a

dx x f b x a p b x a p

x

R x e (1.2)

La Funcin de distribucin acumulada de x

0

se define como:

( ) ( )

}

= s =

o

x

l.i

o o

f(x)dx x x p x F

x

R x e (1.3)

1.3 Valor esperado y varianza de una variable aleatoria.-

1.3.1 Valor esperado.- El valor esperado de una variable aleatoria es el valor que se

espera obtener despus de repetir muchas veces el experimento. Es llamado tambin

valor a la larga y esperanza matemtica. Se define como:

( ) ( )

=

=

= =

n i

i

i i

x p x x E

1

discreta v.a. x (1.4)

( ) ( )

}

= =

ls

li

dx x xf x E continua v.a. x (1.5)

La esperanza de una variable aleatoria x tiene las siguientes propiedades:

a) E(k) = k k constante

b) E(kx) = k E(x) k constante

c) E(k x) = k E(x) k constante

d) E(x y) = E(x) E(y) x,y var. aleatorias independientes

e) E(x y) = E(x) E(y) x,y var. aleatorias independientes

Distribuciones de probabilidad

I-4

1.3.2 Varianza.- La varianza de una variable aleatoria x se define como:

( ) ( )

2

2

= = x E x V (1.6)

Para el caso de variables discretas y continuas, se tiene:

( ) ( )

=

=

=

n i

i

i i

x p x

1

2

2

discreta v.a. x (1.7)

( ) ( )

}

= o

ls

li

2

2

dx x f x continua v.a. x (1.8)

Otras formas alternativas de clculo son:

( )

=

=

=

n i

i

i i

x p x

1

2 2 2

discreta v.a. x (1.9)

( )

}

= o

ls

li

2 2 2

dx x f x continua v.a. x (1.10)

A partir de las expresiones anteriores, la varianza tambin puede expresarse con

la ecuacin (1.11).

| |

2 2 2

) ( ) ( x E x E = (1.11)

La varianza tiene las siguientes propiedades:

a) V(k) = 0 k constante

b) V(kx) = k

2

V(x) k constante

c) V(kx) = V(x) k constante

d) V(x y) = V(x) + V(y) x,y var. aleatorias independientes

La raz cuadrada de la varianza de una variable aleatoria se denomina

desviacin standard () y al igual que la varianza es una medida de dispersin, es decir:

2

o + = o (1.12)

1.4 Distribuciones tericas de probabilidad.-

1.4.1 Distribuciones tericas de probabilidad de variable aleatoria discreta.- Las

principales distribuciones tericas de probabilidad de variable aleatoria discreta son:

- Distribucin Bernoulli.

- Distribucin Binomial.

Distribuciones de probabilidad

I-5

- Distribucin Poisson.

- Distribucin Hipergeomtrica.

- Distribucin Uniforme discreta.

- Distribucin Polinomial.

- Distribucin Geomtrica.

1.4.2 Distribuciones tericas de probabilidad de variable aleatoria continua.- Las

principales distribuciones tericas de probabilidad de variable aleatoria continua se

desarrollan a continuacin.

1.4.2.1 Distribucin Normal.- La distribucin Normal o distribucin de Gauss es

fundamental en la aplicacin de la inferencia estadstica, ya que las distribuciones de

muchos estadgrafos muestrales tienden a la distribucin Normal conforme crece el

tamao de la muestra.

Se dice que una variable aleatoria x est normalmente distribuida si su funcin

de densidad est dada por:

( ) + < <

to

=

|

.

|

\

|

o

x -

2

e

x f

2

2

x

2

1

(1.13)

En la que:

= valor esperado - < < +

o= varianza > 0

La grfica de la distribucin Normal es una curva simtrica con forma de

campana, que se extiende sin lmites tanto en la direccin positiva como en la negativa.

1.4.2.1.1.- Clculo de probabilidades.- La probabilidad de que una variable aleatoria

normalmente distribuida sea menor o igual a un valor especfico, est dada por la

funcin de distribucin acumulada de la ecuacin (1.14).

( ) dx

a

x

e

a x p

}

= s

|

|

.

|

\

|

2

2

2

2

1

(1.14)

Distribuciones de probabilidad

I-6

La funcin f(x) no es una funcin simple y su integracin no puede realizarse en

forma sencilla, adems, si se tabulara la funcin de densidad de la distribucin Normal,

la tabla que se elaborara sera para un par de valores de y

2

, tarea virtualmente

imposible.

Por tanto, para reducir el problema anterior, es necesario standarizar la variable,

de tal forma que permita presentar los resultados en una sola tabla, es decir:

=

x

z (1.15)

Luego:

( )

2

2

2

2

z

e

z f

= (1.16)

con:

( ) 0 = z E

( ) 1 = z V

De manera que:

( ) dz

e a

z p a x p

a z

}

o

t

=

|

.

|

\

|

o

s = s

2

2

2

(1.17)

Con mtodos de clculo integral, todava sigue siendo difcil integrar la funcin de

densidad acumulada de la distribucin Normal standarizada, sin embargo, por medio del

anlisis numrico se han obtenido tablas para dicha funcin.

1.4.2.1.2.- Propiedad reproductiva de la Distribucin Normal.- Una propiedad muy

importante de la Distribucin Normal es la llamada Propiedad Reproductiva de la

Distribucin Normal, la cual indica:

Si x

1

,x

2

,x

3

,.....,x

k

, son variables aleatorias normalmente distribuidas cada una con

media y varianza: N(

1

,o

2

1

), N(

2

,o

2

2

), N(

3

,o

2

3

),..., N(

k

,o

2

k

), respectivamente, adems,

si:

k

x x x x y + + + + = ......

3 2 1

(1.18)

Distribuciones de probabilidad

I-7

Entonces se cumple:

k y

y E + + + + = = ...... ) (

3 2 1

(1.19)

2 2

3

2

2

2

1

2

..... ) (

k y

y V + + + + = = (1.20)

1.4.2.2 Distribucin Uniforme continua.- Se dice que una variable aleatoria x est

distribuida uniformente en el intervalo (,) si su funcin de densidad es:

< <

=

casos otros en 0

x

1

) (

x f (1.21)

La Distribucin Uniforme es llamada tambin Distribucin Rectangular, por la

forma de su figura:

0 X

f ( X )

b a

1 / ( b - a )

La Distribucin Uniforme continua presenta en los experimentos en los que ocurre

un evento en que la variable aleatoria toma valores de un intervalo finito, de manera

que estos se encuentran distribuidos igualmente sobre el intervalo; es decir, la

probabilidad de que la variable aleatoria tome un valor en cada subintervalo de igual

longitud (contenido en el intervalo (,) es la misma, sin importar la localizacin exacta

del subintervalo.

La esperanza y la varianza de la distribucin Uniforme son:

2

) (

+

= = x E (1.22)

( )

12

) (

2

2

= = x V (1.23)

La distribucin Uniforme es simtrica y su mediana es igual a la media.

Distribuciones de probabilidad

I-8

1.4.2.3 Distribucin Gamma.- La variable aleatoria x tiene una distribucin Gamma si

su funcin de densidad est dada por:

( )

o

u

o

u o I

=

x

1

e x

) x ( f x0, 0, 0 (1.24)

En la que se define a la funcin gamma de a la expresin (1.25).

}

o

= o I

0

z 1

dz e z ) ( (1.25)

Para distintos valores de y se tienen los siguientes grficos:

f ( X )

X

f ( X )

X

f ( X )

X

f ( X )

o = 1

u = 1

o = 2

u = 2

o = 2

u = 1

La esperanza y la varianza son:

ou = ) x ( E (1.26)

2

) x ( V ou = (1.27)

Cuando es un nmero entero se origina la distribucin Erlang, cuya funcin de

densidad es:

( )

o

u

u o o

=

! 1

e

) x ( f

x

x0, 0, 1 (1.28)

1.4.2.4 Distribucin Exponencial.- La Distribucin Exponencial, llamada tambin

Distribucin Exponencial Negativa, es un caso especial de la distribucin Gamma con

= 1, es decir:

Distribuciones de probabilidad

I-9

casos otros en

0 0, x

> >

=

0

) (

x

e

x f

(1.29)

La esperanza y la varianza son:

u = ) x ( E (1.30)

2

) x ( V u = (1.31)

Grficamente:

X

f ( X )

1 / u

La variable aleatoria Exponencial representa el tiempo que transcurre hasta que

se presenta el primer evento Poisson, es decir, la Distribucin Exponencial puede

modelar el lapso entre dos eventos consecutivos Poisson que ocurren de manera

independiente y a una frecuencia constante (el parmetro u representa el tiempo

promedio entre dos eventos Poisson).

Por ejemplo, el tiempo que transcurre entre llegadas de un cliente a una tienda

un paciente a un servicio de emergencia de un hospital, la duracin de una llamada

telefnica, la duracin de un componente elctrico, etc..

Esta distribucin sirve para modelar problemas del tipo tiempo-falla y problemas

de lneas de espera.

1.4.2.5 Distribucin Chi Cuadrado.- Un caso especial de la Distribucin Gamma, con

= v/2 y = 2, es la Distribucin Chi Cuadrado cuya funcin de densidad es:

2

v

2

x

1

2

v

2 )

2

v

(

e x

) x ( f

I

=

x0 (1.32)

Distribuciones de probabilidad

I-10

En la que:

v = grados de libertad (entero positivo)

Los grados de libertad representan la cantidad de valores que se asignan de

manera arbitraria en una ecuacin, tal que de esa manera se pueda conocer una de

esas variables.

La esperanza y la varianza se muestran en las ecuaciones (1.33) y (1.34).

v ) x ( E = (1.33)

v 2 ) x ( V = (1.34)

Esta distribucin se emplea bastante en la inferencia estadstica (pruebas de

hiptesis) y de forma especial al hacer inferencias con respecto a las varianzas.

De acuerdo al valor de v, la grfica puede ser:

X

f ( X )

v = 6

v = 3

v = 1

Para calcular probabilidades se aplica la ecuacin (1.35), aunque para ello

existen tablas con la integral ya desarrollada (ver anexos).

}

= >

a

dx x f a x p ) ( ) ( (1.35)

1.4.2.6 Distribucin "t" o de Student.- Suponiendo que se realiza un experimento en

el que se obtienen dos variables aleatorias independientes: w con Distribucin Chi

Cuadrado con v grados de libertad y z con Distribucin Normal con media 0 y varianza

1, entonces la variable aleatoria "x" definida como:

Distribuciones de probabilidad

I-11

v

w

z

x = - < z < + (1.36)

w>0, v>0 y entero

- <x<+

tiene una distribucin tde Student, cuya funcin de densidad es:

( )

2

1 v

2

v

x

1

v

2

v

2

1 v

) x ( f

+

|

|

.

|

\

|

+

t |

.

|

\

|

I

|

.

|

\

| +

I

= - x (1.37)

v0, entero positivo

En la que:

v = grados de libertad

Grficamente, la Distribucin t tiene forma de campana y es simtrica respecto

al origen, adems se puede observar que esta Distribucin se asemeja a la Distribucin

Normal puesto que ambas varan en el intervalo (-; +), son unimodales y centradas

alrededor de 0.

La esperanza y la varianza es:

0 ) x ( E = (1.38)

2 v

v

) x ( V

= v>2 (1.39)

Para calcular probabilidades se aplica la ecuacin (1.40).

}

= s

a

dx x f a x p ) ( ) ( (1.40)

Los valores de probabilidad se encuentran tabulados para ciertos valores

especiales (ver anexos).

Distribuciones de probabilidad

I-12

La importancia de la Distribucin t radica en el hecho de que es til al efectuar

inferencias respecto a la media aritmtica cuando el valor de la desviacin standard es

desconocido y la poblacin tiene una Distribucin Normal sin importar el tamao de la

muestra.

1.4.2.7 Distribucin "F" de Fisher.- Esta distribucin es tambin muy utilizada en la

inferencia estadstica y se define de la siguiente manera:

Sea un experimento en el que se generan dos variables aleatorias

independientes w y z, cada una con una Distribucin Chi Cuadrado con v

1

y v

2

grados

de libertad respectivamente, se define la variable "x" a la relacin (1.41).

2

1

v

z

v

w

x = x >0 (1.41)

y se dice que tiene una distribucin F con v

1

y v

2

grados de libertad con funcin de

densidad:

( )

|

.

|

\

|

I |

.

|

\

|

I

+ |

.

|

\

| +

I

=

+

2

v

2

v

v x v x v v

2

v v

) x ( f

2 1

2

v v

2 1

2

2 v

2

v

2

2

v

1

2 1

2 1

1 2 1

(1.42)

La esperanza y la varianza son:

2 v

v

) x ( E

2

2

= v

2

2 (1.43)

) 4 v ( ) 2 v ( v

) 4 v 2 v 2 ( v

) x ( V

2

2

2 1

1 2

2

2

+

= v

2

4 (1.44)

Grficamente, para distintos valores de v

1

y v

2

se tiene:

Distribuciones de probabilidad

I-13

X

f ( X )

V 1 = 1 5

V 2 = 3 0

V 1 = 1 5

V 2 = 8

0

La Distribucin F es asimtrica hacia la derecha para cualquier par de valores

de v

1

y v

2

, pero sta va disminuyendo conforme v

1

y v

2

se vuelven ms grandes.

Para el clculo de probabilidades se emplea la ecuacin (1.45).

}

= s

a

dx x f a x p ) ( ) ( (1.45)

La ecuacin (1.45) se encuentra tabulada, existiendo tablas para 90%, 95%, y

99%.

La importancia de esta distribucin radica en que es til para efectuar inferencias

sobre las varianzas de 2 distribuciones Normales.

BIBLIOGRAFA:

(1) LEVIN Richard (1996): Estadstica para Administracin y Economa. Mxico

(2) MOYA Rufino y SARAVIA Gregorio (1988): Probabilidad e Inferencia Estadstica.

Per.

(3) MOYA Rufino (1991): Estadstica descriptiva. Conceptos y aplicaciones. Per.

================================

Distribuciones de probabilidad

I-14

NDICE

Pgina

1.1 Variable aleatoria.................................................................................. 1

1.1.1 Variable aleatoria continua............................................................. 1

1.1.2 Variable aleatoria discreta............................................................... 1

1.2 Distribucin de probabilidad de una variable aleatoria............................... 1

1.2.1 Funcin de cuanta .................................................. 1

1.2.2 Funcin de densidad ................................ 2

1.3 Valor esperado y varianza de una variable aleatoria.................................. 3

1.3.1 Valor esperado........................................................................ ........ 3

1.3.2 Varianza......................................................................................... 3

1.4 Momento de una variable aleatoria.......................................................... 4

1.5 Distribuciones toricas de probabilidad 5

1.5.1 Distribuciones tericas de probabilidad de variable aleatoria discreta... 5

1.5.2 Distribuciones tericas de probabilidad de variable aleatoria continua. 5

1.5.2.1 Distribucin Normal............................................................. 5

1.5.2.2 Distribucin Uniforme Contnua.... 7

1.5.2.3 Distribucin Gamma 8

1.5.2.4 Distribucin Exponencial... 9

1.5.2.5 Distribucin Chi cuadrado.... 10

1.5.2.6 Distribucin t de Student 11

1.5.2.7 Distribucin F de Fisher. 12

Teora general del muestreo

II-1

II TEORA GENERAL DE MUESTREO

2.1. Introduccin.- En todo estudio que se realice se desea conocer con absoluta

verdad y certeza toda la informacin requerida para tales fines.

Es natural que se busque conocer de manera exhaustiva las caractersticas de

una poblacin objeto de estudio y que para ello se requiera efectuar un censo. El

censo tiene sus ventajas y desventajas; estas ltimas ocasionan que se recurra a

otro procedimiento que vendra a ser el muestreo.

El muestreo posee caractersticas especiales que la hacen favorable en su uso

frecuente por parte de instituciones con recursos econmicos y tiempo limitados,

aunque tambin el factor que se debe controlar es el error presente en este

procedimiento.

El muestreo tiene distintas etapas, siendo dos de las ms importantes, la

forma de elegir los elementos de la muestra y el tamao de la misma. En este

captulo se efectuar el estudio de dichas etapas, en base a las cuales se realizarn

inferencias referentes a los parmetros de estudio desconocidos.

2.2 Censo.-

2.2.1 Poblacin objetivo.-

2.2.1.1 Definicin.- Es la totalidad de los elementos en discusin y acerca de los

cuales se desea obtener alguna informacin, dichos elementos tienen caractersticas

comunes que son de inters para el estudio. Ej.: todos los Centros Hospitalarios

ubicados en el departamento de Cochabamba, todos los Proyectos de Grado

presentados en la Carrera de Ing. Mecnica de la Facultad de Ciencias y Tecnologa

de la UMSS, etc..

Para garantizar el censo es necesario acotar el universo y conocer las

unidades que lo componen; acotar el universo significa concretar la poblacin que

va a ser objeto del estudio. Por ejemplo: nmero de bolsas de cemento producidas

por COBOCE el da 22 de julio de 2009 en la planta ubicada en Cochabamba.

2.2.1.2. Tipos de poblacin.- De acuerdo a la magnitud de la poblacin se definen

dos tipos de poblacin.

Teora general del muestreo

II-2

2.2.1.2.1. Poblacin finita.- Una poblacin es finita si tiene un nmero limitado

de sucesos o unidades elementales, numricamente es aquella que tiene menos de

500.000 unidades, por ejemplo: todos los estudiantes de la Carrera de Biologa,

nmero de clientes diarios que llegan a un autobanco, etc..

2.2.1.2.2. Poblacin infinita.- Es aquella que consiste en un nmero

infinitamente grande de observaciones. Se considera infinita a una poblacin que

posee ms de 500.000 unidades. Ejemplo: el conjunto de estrellas del Universo,

toda la poblacin de Bolivia, etc..

2.2.2. Parmetro.- Es posible definir este concepto de dos formas:

a) El parmetro es una caracterizacin numrica de la distribucin de la poblacin,

es decir, describe parcial o completamente, la funcin de probabilidad de la

poblacin de la variable de inters. Por ejemplo, cuando se especifica de la

distribucin Poisson, se est definiendo su funcin de probabilidad:

! x

e

) x ( f

x

=

(2.1)

Si se conoce el parmetro se puede calcular cualquier proposicin

probabilstica. Por tanto, puesto que los parmetros son inherentes a todos los

modelos de probabilidad, es imposible calcular las probabilidades deseadas sin un

conocimiento del valor de stos.

b) El parmetro es una caracterstica de tipo descriptivo de una determinada

poblacin. Ello se refiere a que una poblacin con determinadas caractersticas,

pueden ser descritas por ciertas medidas descriptivas , como por ejemplo, la media

aritmtica, ndices poblacionales, tasas, etc..

2.2.3. Definicin de censo.- Cuando es necesario conocer uno o ms parmetros

de una poblacin o universo se recurre a la realizacin de un censo.

El censo constituye un examen completo de todos los elementos de una

poblacin. En la mayora de los casos la realizacin de censos para conocer las

caractersticas de una determinada poblacin resulta muy costosa, exige la

movilizacin de muchos recursos humanos, su duracin suele ser muy larga y en

algunos casos el proceso es destructivo.

Teora general del muestreo

II-3

Existen muchos tipos de censo, siendo el ms importante el censo de

Poblacin y Vivienda, en el cual es necesario recabar la informacin de todos los

habitantes del pas, por ser marco obligado de referencia para multitud de trabajos

e investigaciones y, por razones meramente administrativas.

2.3 Muestreo.-

2.3.1.- Definicin.- Para el conocimiento de las caractersticas de la poblacin

existen mtodos opcionales cuyo costo y tiempo de realizacin se reducen

considerablemente. Estos mtodos estn constituidos en lo que se denomina

muestreo, cuyo objetivo es reconstruir modelos reducidos de la poblacin total, con

resultados que pueden extrapolarse al universo del que se extraen.

Todo ello quiere decir que a travs de muestras se puede obtener en muchos

casos, la informacin requerida, con un ahorro sustantivo de recursos humanos,

econmicos y de tiempo, sin que ello implique un alejamiento de la realidad que se

desea conocer.

Para que el proceso de muestreo sea una reconstruccin reducida pero real

del universo que se desea investigar es necesario que el tamao de las muestras y

la metodologa utilizada en su elaboracin respondan a determinados principios,

deducidos del clculo de probabilidades.

2.3.2. Muestra aleatoria.- La muestra aleatoria es aquella en la que cada unidad

elemental para la observacin tiene la misma probabilidad de ser incluida en la

muestra.

O de una forma ms especfica: x

1

, x

2

, x

3

,....,x

n

, es una muestra aleatoria de

tamao n, si cumple:

a) Cada x

i

es una variable aleatoria independiente.

b) Cada x

i

tiene la misma distribucin de probabilidad.

2.3.3. Inferencia estadstica.- La inferencia estadstica es el proceso mediante el

cual se utiliza la informacin de los datos de una muestra para extraer conclusiones

acerca de la poblacin de la que se seleccion.

Teora general del muestreo

II-4

La inferencia estadstica se basa en la inferencia inductiva, la cual constituye

una generalizacin de los resultados particulares a resultados generales.

Por ejemplo, si se tiene una florera que cuenta con 100.000 semillas de que

se desean comercializar, de la cual se sabe que pueden producir flores blancas o

rojas. El objetivo para la gerencia es averiguar cuntas de estas 100.000 semillas

producirn flores rojas.

Por tanto, lo ms lgico sera proceder de la siguiente manera:

1

o

Para dar una respuesta correcta, se debera sembrar todas las semillas y

observar el nmero de las que producen flores rojas.

2

o

Como ello es imposible, puesto que se desea vender todas las semillas y aunque

no se quisiera venderlas, el obtener una respuesta requerir invertir mucho

esfuerzo y dinero. Por lo que:

3

o

La solucin ser emplear unas cuantas semillas y basados en los resultados

aparecidos, hacer una afirmacin sobre el nmero de flores rojas que se tendrn del

total restante de semillas.

Toda inferencia inductiva constituye un proceso arriesgado, es decir, la

inferencia inductiva exacta es imposible, existiendo un grado de incertidumbre

susceptible de medicin a travs de la probabilidad.

La importancia de la inferencia estadstica radica en que por medio de ella se

hallan nuevos conocimientos.

2.3.4. Estadgrafo.- El estadgrafo es cualquier funcin de las variables que se

observaron en la muestra, de manera que, esta funcin no contiene cantidades

desconocidas. Por ejemplo: si x

1

, x

2

, ..., x

n

son variables aleatorias obtenidas de

una muestra, entonces: |

.

|

\

| + + +

=

n

x x x x

x

n

.....

3 2 1

es un estadgrafo.

Un parmetro es una constante, pero un estadgrafo es una variable

aleatoria. Adems, un parmetro describe un modelo de probabilidad, ningn valor

de estadgrafo puede desempear este papel, porque depende de las observaciones

de la muestra.

Teora general del muestreo

II-5

2.3.5. Diseo de una muestra.-

2.3.5.1 Definicin.- Por diseo de una muestra se entiende la planificacin o

metodologa para tomar muestras.

2.3.5.2. Criterios para evaluar el diseo de una muestra.- Existen dos criterios

para evaluar el diseo de una muestra: su fiabilidad y su efectividad.

2.3.5.2.1. Fiabilidad.- Es de esperar que en el muestreo existan errores. El error

de muestreo es la diferencia entre el valor de un estadgrafo y el valor del

correspondiente parmetro de poblacin, ello debido a variaciones fortuitas en la

seleccin de las unidades elementales.

Por otra parte, el error de muestreo es cuantificable mediante la fiabilidad, la

cual est estrechamente relacionada con la varianza del estadgrafo; por lo cual,

cuanto menor la varianza, mayor ser la fiabilidad del resultado de la muestra.

2.3.5.2.2. Efectividad.- El diseo de una muestra se considera efectivo si se

obtiene cierto grado de fiabilidad al menor costo posible. Un diseo muestral se

considera ms efectivo que otro, si el primero tiene menor costo que el segundo,

dentro del mismo grado de fiabilidad.

2.3.6. Tipos de muestreo.- Para la seleccin de la muestra se pueden utilizar

distintos mtodos o combinacin de mtodos, todos estos divididos en dos grandes

grupos:

- Muestreo aleatorio.

- Muestreo no aleatorio.

2.3.6.1. Muestreo aleatorio.- Comprende:

2.3.6.1.1. Muestreo aleatorio simple.- El muestreo aleatorio simple se aplica

en casos en que:

Las unidades elementales son fciles de identificar.

Cuando la poblacin es pequea.

Cuando la poblacin es homognea respecto a la caracterstica de inters.

El procedimiento consiste en numerar a toda la poblacin del estudio y

extraer al azar una muestra de n unidades. En el muestreo aleatorio simple la

Teora general del muestreo

II-6

seleccin de los elementos se efecta en una sola etapa y en forma directa,

pudiendo ser con o sin reemplazo.

Para la seleccin aleatoria de los nmeros se utilizan tablas de nmeros

aleatorios, programas de computacin, bolillos numerados, etc..

a) Muestreo aleatorio con reemplazo. En este caso cada elemento de la muestra

posee la misma probabilidad de ser elegida, puesto que cada uno es reintegrado a

la poblacin de la cual fue extrada.

b) Muestreo aleatorio sin reemplazo. En este caso cada unidad de la poblacin

posee la misma probabilidad de ser escogida que las restantes para formar parte de

la muestra, considerando que la probabilidad de que un elemento sea extrado

depender de los que anteriormente hayan sido elegidos.

La clave de este procedimiento es naturalmente la tcnica del azar, aunque el

lograr dicho "azar" o aleatoriedad no es cosa sencilla. Por ejemplo, si se desea

averiguar cul es la mejor Universidad de Cochabamba, no es aleatoria una muestra

de personas, si nos dirigimos al campus de la Universidad Catlica Boliviana y se

procede a entrevistar a las personas que ingresan a la misma.

Para poblaciones grandes el mtodo es costoso y requiere mucho tiempo,

siendo difcil y tediosa la elaboracin de listas con toda la poblacin. Cuando el

universo no es homogneo se produce mucho error.

2.3.6.1.2. Muestreo aleatorio sistemtico.- El muestreo sistemtico se emplea

cuando existe heterogeneidad respecto a algn rasgo de los elementos de la

poblacin y el tamao de sta es pequeo. Para tal efecto es aconsejable disponer

de una lista de las unidades de la poblacin, como ser una gua telefnica.

En el control de calidad se emplea frecuentemente el muestreo sistemtico

tomando muestras de artculos de la corriente de produccin.

Este procedimiento consiste en obtener una muestra tomando cada k-sima

unidad de la poblacin, tras numerar las unidades de la poblacin u ordenarlas de

Teora general del muestreo

II-7

alguna manera. La letra k representa un nmero entero llamado razn de

muestreo, coeficiente de elevacin salto y es igual a:

n

N

k = (2.2)

En la que:

N = tamao de la poblacin.

n = tamao de la muestra.

Para que toda unidad de la poblacin tenga igual probabilidad de salir, el

procedimiento debe empezar al azar; para ello se elige un nmero al azar, nmero

no superior a k, a partir del cual se suma sucesivamente la razn de muestreo.

Ahora bien, la muestra sistemtica es menos representativa que el muestreo

aleatorio simple, en situaciones en que existe periodicidad oculta en la poblacin, es

decir, cuando existe un movimiento cclico o peridico de los datos con la longitud

del ciclo aproximndose a la razn de muestreo k; por ejemplo, la venta de

entradas en una empresa cinematogrfica, el elegir sbado o domingo para tomar

una muestra, no siempre es representativo. Este problema se puede solucionar

parcialmente si se procede a "desordenar" la lista.

La desventaja principal del muestreo sistemtico es numerar u ordenar los

elementos de una poblacin grande, lo cual es fsicamente imposible si se abarca

todo un pas o zona geogrficamente grande.

2.3.6.1.3. Muestreo aleatorio estratificado.- El proceso de estratificacin

consiste en dividir la poblacin en clases o grupos llamados estratos. Dentro de

cada uno de tales estratos se encuentran los elementos situados de manera ms

homognea con respecto a las caractersticas en estudio. Para cada estrato se toma

una submuestra mediante el muestreo aleatorio simple y la muestra global se

obtiene combinando las submuestras de todos los estratos.

El muestreo por estratos es efectivo cuando se trata de poblaciones

heterogneas, por que al efectuarse la estratificacin, los grupos se establecen de

modo que las unidades de muestreo tienden a ser uniformes dentro de cada clase y

Teora general del muestreo

II-8

los grupos tienden a ser diferentes entre s. As se puede controlar la proporcin de

cada estrato en la muestra global y no dejarla al azar, quedando asegurado el

carcter representativo de la muestra.

Si la varianza de la caracterstica observada de cada estrato es menor que de

toda la poblacin, que es lo ms usual debido a la uniformidad dentro del estrato,

resultar aumentada la fiabilidad para un tamao de muestra.

El aumento de fiabilidad y efectividad se puede incrementar clasificando

todava los estratos en subestratos llamando a este procedimiento estratificacin

doble.

Para definir los estratos se emplean:

- Datos anteriores.

- Resultados preliminares de otros estudios.

2.3.6.1.4. Muestreo aleatorio por conglomerados.- Llamado tambin muestreo

por reas, consiste en seleccionar al azar grupos, llamados conglomerados, de

elementos individuales de la poblacin, y tomar luego todos los elementos o una

submuestra de ellos dentro de cada conglomerado para constituir as la muestra

total. Como ejemplo de conglomerados se tiene:

- Urbanizaciones.

- Centros hospitalarios.

- Ciudadelas universitarias.

Con este tipo de muestreo se desea que las diferencias entre conglomerados

sean lo ms pequeas posibles, es decir, que exista homogeneidad entre

conglomerados; por otro lado, se busca que dentro de los conglomerados, las

diferencias entre los elementos individuales sean lo ms grandes posibles, es decir,

que exista heterogeneidad dentro de los conglomerados. En ello radica la diferencia,

diametralmente opuesta, al muestreo por estratos.

El objetivo en el muestreo por conglomerados es que cada conglomerado sea

una representacin, a escala reducida, del universo. Adems, slo algunos de stos

Teora general del muestreo

II-9

forman parte de la muestra, mientras que en el muestreo estratificado existe en la

muestra algn elemento de cada uno de los estratos.

Si todos los elementos de cada uno de los conglomerados se incluyen en la

muestra, se denomina muestreo de una etapa. Si se extrae una submuestra

aleatoria de elementos de cada conglomerado seleccionado, se tiene un muestreo

en dos etapas. Si se obtienen ms de dos etapas en la obtencin de la muestra, se

dice que es un muestreo de etapas mltiples o polietpico.

Este tipo de muestreo se emplea a menudo en el control de calidad

estadstico, seleccionando lotes o "tandas" de produccin al azar como

conglomerados.

2.3.6.2. Muestreo no aleatorio.- Frente a los distintos tipos de muestreo

aleatorio, se suelen utilizar otros sistemas de seleccin de la muestra, englobados

en lo que tambin se denomina muestreo dirigido. El recurrir a uno u otro mtodo

se encuentra en funcin no slo de los costos, sino tambin de la precisin que se

desea obtener de la estimacin y la posibilidad de cuantificar los errores de

muestreo.

Generalmente, las instituciones oficiales tienden a emplear muestreos

aleatorios y las instituciones de opinin, mayormente privadas, emplean el

muestreo no aleatorio; ello en virtud a la disponibilidad de informacin y el costo

que ello representa.

2.3.6.2.1 Muestreo opintico.- En este caso el investigador, segn su criterio,

selecciona la muestra de manera que sea lo ms representativa a los efectos de la

investigacin que se pretende realizar, por ejemplo: estudios sobre el consumo de

droga en una determinada ciudad. Sin embargo, est sujeto a la subjetividad del

investigador y los resultados carecen de fiabilidad en trminos estadsticos.

2.3.6.2.2. Muestreo por cuotas.- Consiste en facilitar al entrevistador el perfil de

las personas que tiene que entrevistar de acuerdo a los objetivos del estudio.

2.4. Distribucin muestral.- La distribucin muestral de un estadgrafo es la

distribucin de probabilidad que expresa la relacin funcional entre cada uno de los

Teora general del muestreo

II-10

valores del estadgrafo y su correspondiente probabilidad, como resultado de un

nmero infinito de muestras aleatorias independientes, cada una de tamao n,

provenientes de la misma poblacin.

De la distribucin muestral los elementos ms importantes son el valor

esperado y la varianza. Por otro lado, la distribucin muestral de un estadgrafo no

tiene la misma forma que la funcin de probabilidad de la poblacin de la cual

proviene la muestra.

Por ejemplo, suponga que se tiene inters en el nmero de clientes que

llegan a los bancos de la ciudad, entre las 9:00 y las 10:00 de la maana, teniendo

certeza que cada una de las llegadas es independiente entre s, se decide

seleccionar en forma aleatoria cinco bancos durante 8 das. Para cada muestra

diaria, se procede a contar la cantidad de personas que ingresan durante el

intervalo de una hora en los cinco bancos. Con tales consideraciones se obtienen los

resultados del cuadro (2.1).

Cuadro (2.1)

NUMERO DE LLEGADAS A LOS BANCOS EN UNA HORA

DIA

BANCO

1 2 3 4 5 6 7 8

BISA 63 59 50 36 36 38 55 58

MERCANTIL-STA. CRUZ 32 44 25 57 46 45 45 50

UNION 54 39 39 68 58 50 51 53

GANADERO 52 46 34 58 54 38 54 51

DE CREDITO 48 44 56 67 56 58 41 38

Promedio (x) 50 46 40 57 50 46 49 50

Fuente: Elaboracin propia.

En este caso, el estadstico es el promedio o media muestral y todos los

valores obtenidos, conforman la distribucin muestral de x.

2.4.1. Distribucin muestral de x (promedio muestral).- Uno de los

estadgrafos ms importante es el promedio de un conjunto de variables aleatorias

e independientemente distribuidas, llamado tambin promedio o media muestral.

Este estadgrafo tiene un papel muy importante en problemas de decisiones para

medias poblacionales desconocidas.

Teora general del muestreo

II-11

Por tanto, si: x

1

, x

2

, x

3

,....., x

n

, es una muestra aleatoria de n variables

aleatorias independientes e igualmente distribuidas con E(x

i

)= y varianza

VAR(x

i

) =

2

, para i = 1, 2, 3,...., n; se define a la media muestral como:

=

=

+ + +

=

n

1 i

i n 2 1

n

x

n

x ......... x x

x (2.3)

Si se aplica muestreo con reemplazo, entonces se cumple que:

= = ) x ( E

x

(2.4)

n

) x ( V

2

2

x

o

= = o (2.5)

de lo que se deduce:

n

x

o

= o (2.6)

que se denomina error tpico de la media muestral o desviacin standard de la

distribucin muestral de la media muestral.

Este resultado es vlido sin importar la distribucin de probabilidad de la

poblacin de inters, siempre y cuando la varianza tenga un valor finito.

Lo expuesto anteriormente hace posible encontrar el error tpico de la media

sin conocer la distribucin de x .

Para el caso del muestreo sin reemplazo, se tiene:

=

x

(2.7)

n ) 1 N (

) n N (

2

2

x

o

= o (2.8)

En la que:

N = Nmero de elementos de la poblacin.

(N-n)/(N-1) = correccin finita de la poblacin

Teora general del muestreo

II-12

Cuando N tiende a infinito la ecuacin (2.8) se transforma en la ecuacin

(2.6).

El error tpico de la media vara proporcionalmente a la desviacin standard

de la poblacin, pero vara inversamente proporcional a la raz cuadrada del tamao

de la muestra, es decir, dado el tamao de la muestra, cuanto mayor sea el valor

de tanto mayor ser el valor de

x

o , y dado , cuanto mayor sea el valor de n

menor ser el valor de

x

o . Por tanto, se deduce que cuanto mayor sea la muestra,

se tendr ms certeza de que la media muestral es una buena estimacin de la

media poblacional.

2.4.2. Teorema central del lmite.- Sean: x

1

, x

2

, x

3

,....., x

n

un conjunto de n

variables aleatorias independientes e igualmente distribuidas, tal que E(x

i

)= y

VAR(x

i

)=

2

, tienen un valor finito para i= 1, 2, 3,..., n.

Si: Y

n

= x

1

+ x

2

+ x

3

+ ..... + x

n

(2.9)

con valor esperado y varianza:

E(Y

n

) = n (2.10)

VAR(Y

n

)= no

2

(2.11)

entonces la variable aleatoria z, estandarizada de la siguiente manera:

n

nu y

z

= (2.12)

se aproxima a una Distribucin Normal con media igual a cero y varianza igual a 1,

siempre y cuando "n tienda al infinito. Esto significa que la suma de un nmero

grande (n 30) de variables aleatorias tendr una Distribucin Normal Standard,

independiente de la distribucin de probabilidad de la variable aleatoria original.

Ahora bien, efectuando operaciones algebraicas se tiene tambin que la

ecuacin (2.12) se puede expresar como:

n

x

z

o

= (2.13)

que tambin se ajusta a una distribucin Normal standarizada.

Teora general del muestreo

II-13

En otras palabras, para n grande (n 30), la variable aleatoria

n

x

z

o

= se

aproxima a una Distribucin Normal con media 0 y varianza 1, sin importar el

modelo de probabilidad a partir del cual se obtuvo la muestra.

2.5. 2.5 Clculo del tamao de la muestra.- Dependiendo del tamao de la

poblacin objetivo, el clculo de n, se distingue si la poblacin es finita o infinita.

2.5.1 Clculo del tamao de muestra para poblaciones infinitas.-

2.5.1.1. Teorema o desigualdad de Tchebycheff.- Si una variable aleatoria x

tiene una distribucin de probabilidad conocida, se podr conocer la media () y la

varianza (

2

). Pero, si se conoce y

2

no se puede determinar la distribucin de

probabilidad de x, sin embargo, se puede calcular un lmite superior (o inferior)

para la probabilidad del tipo (| | < ).

La desigualdad de Tchebycheff indica: Si la variable aleatoria x con funcin de

probabilidad f(x) (generalmente desconocida) tiene media y varianza conocidos,

entonces para cualquier k>1, se cumple que:

2

k

1

1 ) k x ( p > o < (2.14)

La ecuacin (2.14) indica que la probabilidad de que x tome un valor dentro

del intervalo (-k;+k) es por lo menos

2

k

1

1 .

Puesto que (x- k) y (x- k) son eventos complementarios tambin

se cumple:

2

k

1

) k x ( p < o > (2.15)

Lo anterior significa que la probabilidad de que x tome algn valor fuera del

intervalo (-k;+k) es a lo ms 1/k.

La ventaja ms importante de este teorema es que se aplica a todo tipo de

distribucin y su desventaja es que slo proporciona un lmite superior (o inferior,

segn sea el caso) de probabilidad.

Teora general del muestreo

II-14

2.5.1.2. Ley de los grandes nmeros.- El teorema de Tchebycheff se aplica a la

variable x, pero si este Teorema se aplicase a la variable x , esta aplicacin se

denomina Ley de los grandes nmeros, la cual indica:

Sean: x

1

, x

2

, x

3

,....., x

n

, n variables aleatorias independientes e igualmente

distribuidas, tales que E(x

i

)= y VAR(x

i

)=

2

, tienen un valor finito para i= 1,2,

3,...., n, y considerando que

=

=

n

i

i

n

x

x

1

es un buen estimador de (media

poblacional).

A partir del Teorema de Tchebycheff para poblacin:

2

k

1

1 ) k x ( p > o < (2.16)

Aplicando a la variable aleatoria x , se tiene:

2

x x

k

1

1 ) k x ( p > o < (2.17)

Puesto que =

x

y

n

x

o

= o , se tiene:

2

k

1

1 )

n

k x ( p >

o

< (2.18)

o tambin:

2

k

1

)

n

k x ( p <

o

> (2.19)

O expresado de otra forma, haciendo que:

n

k

e

o

= (2.20)

2

2

ne

1 ) e x ( p

o

> < (2.21)

de lo que se deduce que:

2

e

k

n |

.

|

\

| o

> (2.22)

Teora general del muestreo

II-15

La Ley de los grandes nmeros indica que se puede determinar una muestra

aleatoria de tamao n de una poblacin con funcin de probabilidad f(x), tal que la

probabilidad de que x difiera de en menos de una cantidad arbitrariamente

pequea e, llegue a ser tan prxima a 1 cuanto ms grande sea n. Es decir, si n

crece, la probabilidad de que x valga se acerca a 1.

2.5.2. Clculo del tamao de muestra para poblaciones finitas.-

Adicionalmente, a la ecuacin presentada con anterioridad, deducida de la Ley de

los Grandes Nmeros, la cuales es aplicada para poblaciones infinitas, ya sea el

caso en el que se traten de caracteres cualitativos o cuantitativos, existen otras dos,

las cuales son utilizadas con bastante frecuencia en los estudios de mercado para

cuando las poblaciones sean finitas. Dichas ecuaciones, deducidas empricamente,

son:

- Carcter cuantitativo:

n = (2.23)

- Carcter cualitativo:

n = (2.24)

En la que:

N = tamao de la poblacin.

o

2

= varianza poblacional (en caso de no disponer de ella, se

utiliza su estimador respectivo)

e = error absoluto

P = proporcin poblacional correspondiente al atributo de inters

(en caso de no disponer de ella se estima a partir de una

muestra piloto)

Q = 1 - P

Z

tablas

= valor perteneciente a la Distribucin Normal Standard

correspondiente a un nivel de confianza (1-o)%, siendo

los ms frecuentes:

Z

tablas

= 2.575 1-o = 99%

Z

tablas

= 1.96 1-o = 95%

Z

tablas

= 1.645 1-o = 90%

Teora general del muestreo

II-16

2.6. Determinacin del tamao de muestra en el caso del muestreo

aleatorio estratificado.- El problema de conceder a cada estrato la adecuada

representacin en la muestra (conociendo de antemano el tamao de la muestra n)

se conoce con el nombre de afijacin. Para tal efecto se conocen tres criterios:

2.6.1. Afijacin igual.- Siendo L el nmero de estratos y n el tamao de la

muestra, ambos conocidos de antemano, entonces:

L

n

n ..... n n

L 2 1

= = = = (2.25)

2.6.2. Afijacin proporcional.- Considerando N

i

el tamao de la poblacin en el

estrato i-simo y denominando fraccin de muestreo al cociente n/N, este criterio

consiste en que, en cada estrato, la fraccin de muestreo permanezca constante,

por tanto:

i i

N

N

n

n = i= 1,2,...,L (2.26)

Para calcular el estimador de la media poblacional x , se emplea la relacin:

=

=

n

1 i

i i

N

x N

x (2.27)

2.6.3. Afijacin ptima.- Consiste en que cada tamao de la muestra por estrato

depende del tamao de la poblacin en el mismo (N

i

) y de la dispersin de la

variable que se estudia, tomndose como medida de dicha dispersin a la

desviacin standard

i

en el correspondiente estrato i-simo, por lo que, los valores

de n

i

sern:

=

=

L

i

i i

i i

i

N

n N

n

1

(2.28)

El estimador de la media poblacional se calcula empleando la ecuacin (2.27).

Teora general del muestreo

II-17

BIBLIOGRAFA:

(1) CANAVOS George. "Probabilidad y estadstica. Aplicaciones y mtodos,

Mxico, 1994.

(2) HINES Walter y MONTGOMERY David. "Probabilidad y Estadstica para

Ingeniera y Administracin. McGraw-Hill, Mexico, 1996.

(3) KAZMIER Leonard. "Estadstica aplicada a Administracin y Economa,

McGraw-Hill, Mxico, 1991.

(4) LEVIN Richard y RUBIN David. "Estadstica para Administradores, Prentice

Hall, Mxico, 1996

(5) MILLER Irwin, FREUND John y JOHNSON Richard. "Probabilidad y estadstica

para ingenieros, Mxico, 1994.

(6) MOYA Rufino y SARAVIA Rufino. "Probabilidad e Inferencia Estadstica. Per,

1988.

==========================

Teora de la estimacin estadstica

III-1

III TEORA DE LA ESTIMACIN ESTADSTICA

3.1 Introduccin.- La estimacin estadstica consiste en el proceso de aproximar un

parmetro de poblacin desconocido, mediante un estadgrafo obtenido a partir de

observaciones efectuadas en una muestra.

El proceso de estimacin, bsicamente, consiste en los siguientes pasos:

a) Seleccionar un estimador para inferir el parmetro deseado del conjunto o universo

bajo estudio.

b) Seleccionar una muestra de este conjunto.

c) Valorar al estimador de la muestra seleccionada.

d) Inferir, de este valor, el parmetro buscado de ese universo.

La estimacin estadstica se divide en estimacin puntual y estimacin por

intervalos.

3.2 Estimacin puntual.- La estimacin puntual consiste en estimar un slo valor

como estimacin de un parmetro de poblacin desconocido, se denomina puntual

porque se utiliza un slo punto del conjunto de todos los valores posibles.

En el caso general, si u es el parmetro desconocido de una variable aleatoria x

con distribucin de probabilidad f(x,u), y sean x

1

, x

2

, x

3

,...., x

n

, una muestra aleatoria de

n valores de x tomados de esta distribucin; se denominar

`

(theta circunflejo) a la

estimacin de u calculada a partir de dicha muestra de n observaciones; de esta

manera,

`

es un estadgrafo muestral con una distribucin muestral terica.

De todas maneras, en toda muestra existen errores, puesto que la muestra es

una parte pequea de todo el conjunto de observaciones posibles, por lo que, es muy

arriesgado afirmar que el valor de un estimador obtenido a partir de una muestra es el

correspondiente al valor del parmetro poblacional.

3.2.1 Propiedades que debe tener un buen estimador.- Para determinar un buen

estimador se aplican cuatro propiedades: consistencia, ausencia de sesgo, eficiencia y

suficiencia.

A lo largo de todo el anlisis se supondr la existencia de un slo parmetro

desconocido, sin embargo, en condiciones generales estos conceptos pueden

extenderse a un nmero mayor de parmetros desconocidos.

3.2.1.1 Consistencia.- Es razonable esperar que un buen estimador de un parmetro u

sea cada vez mejor conforme crece el tamao de la muestra. Esto es, a medida que

Teora de la estimacin estadstica

III-2

la informacin en una muestra aleatoria se vuelve ms completa, la distribucin

muestral de un buen estimador se encuentra cada ms concentrada alrededor del

parmetro u. Se tendr un mejor estimador de si se basa en 30 observaciones que si

se lo hace en 18.

Un estimador consistente es el que tiende a tener una probabilidad de acercarse

al parmetro de la poblacin a medida que el tamao de la muestra crece, es decir, si

`

es un estadgrafo muestral calculado a partir de una muestra de tamao n y u es el

parmetro de la poblacin que se va ha estimar, entonces,

`

es un estimador

consistente de u si, para todo nmero positivo arbitrariamente pequeo e, se cumple la

ecuacin (3.1).

( ) 1 = s

)

`

lim e p

n

(3.1)

La ecuacin (3.1) se denomina convergencia en probabilidad, es decir, si un

estimador es consistente converge en probabilidad al valor del parmetro que est

intentando estimar conforme el tamao de la muestra crece.

3.2.1.2 Ausencia de sesgo.- Para comprender mejor esta propiedad, se define el Error

Cuadrtico Medio de

`

como ( )

(

2

`

E , es decir, el Error Cuadrtico Medio es el

valor esperado del cuadrado de la diferencia entre u y

`

.

Desarrollando la expresin anterior y efectuando operaciones se tiene:

( ) | |

2

2

2

)

`

(

`

`

E E + =

(

(3.2)

La ecuacin (3.2) significa que el error cuadrtico medio es la suma de 2

cantidades no negativas:

2

`

u

o es la varianza del estimador y el trmino| | )

`

( E u u , el cual

se denomina sesgo del estimador, elevado al cuadrado.

Es deseable que el error cuadrtico medio sea lo ms pequeo posible, para lo

cual la varianza del estimador (

2

`

u

o ) debe ser lo ms pequea posible y el sesgo

prximo a cero o cero.

En vista de que la varianza del estimador (

2

`

u

o ) no es posible controlar, lo

deseable ser tener un estimador cuyo sesgo sea cero, estimador al que se denominar

insesgado.

Puesto que u

`

, estimador de u, es una variable aleatoria, como tal tiene una

distribucin de probabilidad con media y varianza, se dice, que u

`

es un estimador

Teora de la estimacin estadstica

III-3

insesgado de u, si el valor esperado de u

`

es igual a u, es decir, si:

u = u)

`

( E (3.3)

Dicho de otra forma, es de esperar que si se toman muchas muestras de tamao

dado partiendo de la misma distribucin, y si de cada una se obtiene un valor de u

`

, la

media aritmtica de todos los valores de u

`

han de estar muy cerca de u.

3.2.1.3 Eficiencia.- Un estimador u

`

es eficiente, si entre todos los estimadores

insesgados, tiene varianza ms pequea. Dicho estimador tambin se llama estimador

insesgado de varianza mnima.

En otras palabras, suponiendo que de la misma muestra se obtienen 2

estimadores

1

`

u y

2

`

u y, ambos son estimadores insesgados de u; adems, si por

ejemplo la varianza de

1

`

u es menor que la varianza de

2

`

u , se dice que

1

`

u es ms

eficiente que

2

`

u , por que sus valores estn ms cerca de u que los de

2

`

u .

3.2.1.4 Suficiencia.- Un estimador suficiente del parmetro u, es aquel que utiliza toda

la informacin pertinente sobre u que se puede disponer de la muestra.

Por ejemplo, si se toma una muestra de 30 observaciones con el fin de estimar ,

y si

1

x ` es el promedio de la primera y ltima observaciones,

2

x ` es el promedio de las

10 primeras observaciones y

3

x ` es el promedio de las 5 observaciones centrales, se

concluye que

2

x ` es el estimador suficiente entre los 3 estimadores calculados.

3.2.2 Estimacin por el mtodo de mxima verosimilitud.- Aunque un

experimentador decide sobre qu propiedades desea que posea un estimador, tiene

que enfrentarse con el problema de cmo obtener dichos estimadores. Uno de los ms

utilizados es el mtodo de mxima verosimilitud.

Bsicamente, el mtodo de estimacin por mxima verosimilitud selecciona como

estimador a aquel valor del parmetro que tiene la propiedad de maximizar el valor de la

probabilidad de la muestra aleatoria observada.

El procedimiento consiste en considerar todos los valores imaginables del

parmetro de poblacin, que se encuentran en la muestra, y calcular la probabilidad de

que se hubiera obtenido el estadgrafo muestral particular, dados todos los valores

imaginables del parmetro.

Teora de la estimacin estadstica

III-4

Sea una variable aleatoria cuya funcin de cuanta o densidad f(x), y con un slo

parmetro u; suponiendo que se efecta n veces el experimento correspondiente, con

lo que se obtiene una muestra de n nmeros: x

1

, x

2

, x

3

,, x

n

.

Adems, si existe independencia de los n ensayos, entonces la probabilidad de

que una muestra de tamao n conste precisamente de estos n valores est expresada

por una funcin L(u), funcin que se denomina funcin de verosimilitud y que se

muestra en la ecuacin (3.4).

) ; x ( f ......... ) ; x ( f ) ; x ( f ) ; x ( f ) ( L

n 3 2 1

u - - u - u - u = u (3.4)

Los valores ) ; x ( f ......... ) ; x ( f ) ; x ( f ) ; x ( f ) ( L

n 3 2 1

u - u - u - u = u dependen del

parmetro u, luego, L depende de x

1

, x

2

, x

3

,...., x

n

y u. Si x

1

, x

2

, x

3

,.., x

n

son constantes

y conocidos, L ser funcin slo de u.

La estimacin por la mxima verosimilitud consiste en hallar el valor de u de

manera que L tenga un valor mximo, para lo que ser necesario derivar L respecto de

u, es decir:

0

L

=

u c

c

(3.5)

obteniendo el estimador u

`

, llamado estimador mximo verosmil de u.

En virtud a que L(u), Ln L(u) y Log L(u) tienen su mximo para el mismo valor de

u, en la mayor parte de los casos es posible utilizar esta propiedad para facilitar los

clculos. Por lo que se tiene:

0

LnL

=

u c

c

(3.6)

0

LogL

=

u c

c

(3.7)

Para los casos en que existen varios parmetros, la funcin de mxima

verosimilitud es:

) ,.. , ; x ( f ... ) ,... , ; x ( f ) ,.. , ; x ( f ) ,... , ( L

k 2 1 n k 2 1 2 k 2 1 1 k 2 1

u u u - - u u u - u u u = u u u (3.8)

Si se satisfacen ciertas condiciones de regularidad, el punto en que la

Teora de la estimacin estadstica

III-5

verosimilitud es mxima es una solucin del sistema de k ecuaciones compuesta por:

0

L

1

=

u c

c

(3.9)

0

L

1

=

u c

c

(3.10)

..........

..........

0

L

k

=

u c

c

(3.11)

Tambin en este caso puede ser ms fcil trabajar con el logaritmo (natural o

decimal) de la funcin de verosimilitud.

Este mtodo tiene la propiedad de proporcionar estimadores que son funciones

de estadsticas suficientes, siempre y cuando el estimador mximo verosmil sea nico.

Adems, tambin proporciona un estimador eficiente, si es que existe. Sin embargo, la

mayora de estos estimadores son sesgados.

La desventaja de este mtodo radica en el hecho de que no da medida alguna de

la precisin de la estimacin y no indica la magnitud del error en que se puede incurrir.

3.3 Estimacin por intervalos.- La estimacin por intervalos describe un intervalo de

valores dentro del cual es posible que se encuentre un parmetro poblacional, ms

propiamente, consiste en determinar un intervalo (a,b) que comprende un parmetro de

poblacin u con cierta probabilidad (1- ) , es decir:

o = < u < 1 ) b a ( p (3.12)

En esta expresin:

- a y b son variables aleatorias que dependen del estimador

`

y que se denominan:

lmite de confianza inferior y lmite de confianza superior, respectivamente.

- Al intervalo (a,b) se denomina intervalo de confianza y es un estimador de intervalo

que se construye respecto a

`

y que permite especificar el alcance de la estimacin

que se est efectuando.

- b-a es una medida de la precisin.

- (1-) se denomina nivel de confianza y representa la confianza probabilidad de

que en ese intervalo se incluya el parmetro que se estima. Una probabilidad ms

alta representa ms confianza.

Teora de la estimacin estadstica

III-6

Para tal efecto, se puede construir distintos intervalos de confianza, ya sean

unilaterales o bilaterales:

- Intervalo de confianza para la media aritmtica.

- Intervalo de confianza para la diferencia de dos medias aritmticas.

- Intervalo de confianza para la proporcin.

- Intervalo de confianza para la varianza.

- Intervalo de confianza para la razn de dos varianzas.

3.3.1 Intervalo de confianza bilateral para la media aritmtica de la

poblacin.- Para estimar un intervalo de confianza para , se toma una muestra

aleatoria de n observaciones: x

1

, x

2

, x

3

,....., x

n

, y de dicha muestra se calcula el

estimador puntual x .

En el cuadro (3.1) se muestran los intervalos de confianza para la media

poblacional tanto para Distribuciones Normales como para las que no lo son.

Cuadro (3.1)

INTERVALOS DE CONFIANZA PARA ESTIMAR LA

MEDIA ARITMTICA DE LA POBLACION

DISTRIBUCION

DE LA POBLACIN

TAMAO DE

MUESTRA

2

CONOCIDO

2

DESCONOCIDO

Normal Grande (n> 30)

x tablas

z x o

x tablas

s z x

Normal Pequea (n<30)

x tablas

z x o

x tablas

s t x

Cualquiera Grande (n> 30)

x tablas

z x o

x tablas

s z x

FUENTE: Elaboracin propia.

En la que:

( )

( ) 1

= =

n

x x

s

n

i

i

(3.13)

- = = o s ` estimador de la desviacin standard poblacional = desviacin standard

muestral.

n

s

s

x

x = =

.

(3.14)

- = =

.

x

x s estimador de la desviacin standard de la distribucin muestral del

estadgrafo x .

Teora de la estimacin estadstica

III-7

- =

tablas

z valor absoluto de z perteneciente a la Distribucin Normal Standarizada

correspondiente a un valor de (1-o) central.

- =

tablas

t valor absoluto de t perteneciente a la Distribucin t correspondiente a un

valor de (1-o) central con v = n-1 grados de libertad.

3.3.2 Intervalo de confianza bilateral para la diferencia de dos medias

aritmticas poblacionales.- En el cuadro (3.2), considerando dos muestras

aleatorias de tamaos n

1

y n

2

respectivamente, se presentan los intervalos de confianza

para la diferencia entre medias aritmticas de dos distribuciones (

1

-

2

).

Cuadro (3.2)

INTERVALOS DE CONFIANZA PARA ESTIMAR LA DIFERENCIA ENTRE MEDIAS

ARITMTICAS DE DOS POBLACIONES

DISTRIBU-

CION DE

POBLACIN

TAMAO DE

MUESTRAS

1

2

y

2

2

CONOCIDOS

1

2

y

2

2

DESCONOCIDOS

Normal (n

1

,n

2

> 30)

( )

2 1

x x tablas 2 1

z x x

o ( )

2 1

x x tablas 2 1

s z x x

Normal (n

1

,n

2

< 30)

( )

2 1

2 1 x x tablas

z x x

( )

2 1

2 1

1 1

n n

S t x x

p tablas

+

Cualquiera (n

1

,n

2

> 30)

( )

2 1

x x tablas 2 1

z x x

o ( )

2 1

x x tablas 2 1

s z x x

FUENTE: Elaboracin propia.

En la que:

2

2

2

1

2

1

x x

n n

2 1

o

+

o

= o

(3.15)

- = o

2 1

x x

desviacin standard de la distribucin muestral de la diferencia de dos

medias muestrales.

2

2

2

1

2

1

x x x x

n

S

n

S

S `

2 1 2 1

+ = = o

(3.16)

-

2 1

x x

S

= estimador de la desviacin standard de la distribucin muestral de la

diferencia de dos medias muestrales.

Teora de la estimacin estadstica

III-8

( ) ( )

2

1 1

2 1

2

2 2

2

1 1

+

+

=

n n

S n S n

S

p

(3.17)

- S

p

= estimador combinado de la desviacin standard de la distribucin muestral de la

diferencia de dos medias muestrales.

-

tablas

t = valor absoluto de t perteneciente a la Distribucin t correspondiente a un

valor de (1-o) central con v grados de libertad.

2 n n v

2 1

+ = (3.18)

3.3.3 Intervalo de confianza bilateral para la varianza de una

Distribucin Normal.- Para estimar un intervalo de confianza para o

2

que

pertenece a una Distribucin Normal, se toma una muestra aleatoria de n

observaciones: x

1

, x

2

, x

3

,....., x

n

, y de dicha muestra se calcula el estimador puntual S

2

.

Es posible demostrar que la variable:

( )

2

2

2

1

S n

= (3.19)

pertenece a una Distribucin Chi cuadrado con (n-1) grados de libertad, tal como se

muestra en el siguiente grfico.

f(X )

0 X

1-o

1o/2, n1

o / 2

o / 2

o/2, n1 X X

Para desarrollar el intervalo de confianza, se puede observar del grfico:

o =

|

|

.

|

\

|

_ s _ s _

o

1 p

2

1 n ,

2

2 2

1 n ,

2

1

(3.20)

Efectuando operaciones se tiene:

Teora de la estimacin estadstica

III-9

( )

o =

|

|

.

|

\

|

_ s

o

s _

o

1

s 1 n

p

2

1 n ,

2

2

2

2

2

1 n ,

2

1

(3.21)

( ) ( )

o =

|

|

|

.

|

\

|

_

s o s

_

o

o

1

s 1 n s 1 n

p

2

1 n ,

2

1

2

2

2

1 n ,

2

2

(3.22)

3.3.4 Intervalo de confianza bilateral para la proporcin de una

Distribucin Binomial.- Considerando que se ha tomado una muestra aleatoria

de n observaciones de una poblacin con Distribucin Binomial con parmetros n y p;

para estimar el valor de p, se obtiene x' observaciones en esta muestra que

pertenecen a la clase de inters y se utiliza el estimador puntual:

n

x

p

'

= ` (3.23)

Es posible demostrar que:

p p E

P

= =

) ( (3.24)

( )

( )

n

p p

P

p V

= =

1

2

(3.25)

( )

n

p p

P

=

1

(3.26)

Solamente para el caso de tener un tamao de muestra grande (n > 30),

aplicando el Teorema Central del Lmite y por analoga con el caso de la estimacin de

la media aritmtica para el caso de una distribucin cualquiera (con n > 30 y varianza

conocida), el intervalo de confianza para la proporcin es:

p tab

z p

(3.27)

Ahora bien, puesto que en la expresin (3.26) se desconoce p, se reemplaza

por su estimador p , , por lo cual se tiene el intervalo (3.28).

( )

n

p p

z p

tablas

1

(3.28)

BIBLIOGRAFA:

(1) HINES Walter y MONTGOMERY David (1996): Probabilidad y Estadstica para

Ingeniera y Administracin. McGraw-Hill, Mxico.

Teora de la estimacin estadstica

III-10

(2) KAZMIER Leonard (1991): Estadstica aplicada a la administracin y economa.

McGraw-Hill, Mxico.

(3) LEVIN Richard y RUBIN David (1996): Estadstica para administradores.Prentice-

Hall, Mxico

(4) MILLER Irwin, FREUND John y JOHNSON Richard (1994): Probabilidad y

estadstica para ingenieros, Mxico.

(5) MOYA Rufino (1988): Estadstica Descriptiva. Per.

(6) TRIOLA Mario F. (2000): Estadstica elemental. Prentice-Hall, Mxico.

================================

Teora de la estimacin estadstica

III-11

INDICE

Pg.

4.1 Introduccin................................................................................... 1

4.2 Estimacin puntual......................................................................... 1

4.2.1 Propiedades que debe tener un buen estimador..................... 1

4.2.1.1 Consistencia............................................................... 2

4.2.1.2 Ausencia de sesgo...................................................... 2

4.2.1.3 Eficiencia................................................................... 3

4.2.1.4 Suficiencia................................................................. 3

4.2.2 Estimacin por el mtodo de mxima verosimilitud................... 3

4.3 Estimacin por intervalos................................................................ 5

4.3.1 Intervalos de confianza bilaterales para la media de la

poblacin

6

4.3.2 Intervalos de confianza bilaterales para la diferencia de dos medias

poblacionales............................................................. 7

4.3.3 Intervalo de confianza bilateral para la varianza de una Distribucin

Normal............................................................... 8

4.3.4 Intervalo de confianza bilateral para la proporcin de una Distribucin

Binomial............................................................. 8

Pruebas de hiptesis estadsticas

IV-1

IV PRUEBAS DE HIPTESIS ESTADSTICAS

4.1 Introduccin.- La inferencia relativa a un parmetro cualquiera de una

poblacin suele hacerse a travs de 2 mtodos: estimando el parmetro en base de

una muestra aleatoria o realizando una prueba sobre la aceptacin o refutacin del

valor del parmetro. En este captulo se estudiar el segundo mtodo: la prueba o

contraste de hiptesis estadstica.

4.2 Conceptos bsicos.- A continuacin se detallan las principales definiciones

referidas a las pruebas estadsticas.

4.2.1 Hiptesis estadstica.- Una hiptesis estadstica es un enunciado que se

hace acerca de la distribucin de probabilidad de una o ms variables aleatorias. Las

hiptesis estadsticas a menudo involucran uno ms parmetros.

Se puede especificar una hiptesis indicando el tipo de distribucin y el valor

o valores del parmetro que la definen. En la prctica, la distribucin de poblacin,

generalmente se asume, por tanto, una hiptesis se especifica con el valor o los

valores del parmetro.

4.2.2 Hiptesis nula e hiptesis alterna.- La hiptesis nula, denotada por H

0

, es

la hiptesis estadstica que se desea probar; mientras que, la hiptesis alterna,

denotada por H

1

, es una suposicin de lo que sera si es que no se cumple la

hiptesis nula.

La hiptesis nula suele determinarse de tres maneras:

- Puede resultar de la experiencia o conocimiento pasado del futuro.

- Puede determinarse a partir de alguna teora o modelo.

- Cuando el valor del parmetro poblacional es resultado de consideraciones

experimentales.

Una hiptesis nula debe considerarse como verdadera a menos que existiera

suficiente evidencia en contra (evidencia que es proporcionada por la muestra).

4.2.3 Prueba de hiptesis estadstica.- La prueba de hiptesis estadstica es

una metodologa que, en base de los valores experimentales observados, conduce a

una decisin, ya sea aceptar o rechazar una hiptesis bajo consideracin.

Existen dos tipos de pruebas, las pruebas unilaterales y las pruebas

bilaterales.

Pruebas de hiptesis estadsticas

IV-2

4.2.3.1 Pruebas unilaterales.- Estas pruebas se clasifican en:

4.2.3.1.1 Prueba de la cola inferior o cola izquierda.- En este caso las

hiptesis se plantean de la siguiente forma:

H

0

: u > a H

0

: u > a H

0

: u = a

H

1

: u < a H

1

: u < a H

1

: u < a

4.2.3.1.2 Prueba de la cola superior o prueba de la cola derecha.- Para este

caso las hiptesis se plantean de la siguiente manera:

H

0

: u s a H

0

: u < a H

0

: u = a

H

1

: u > a H

1

: u > a H

1

: u > a

4.2.3.2 Pruebas bilaterales o prueba de dos colas.- En este caso, las

hiptesis se formulan de la siguiente forma:

H

0

: u = a

H

1

: u = a

4.2.4 Tipos de errores.- La decisin para aceptar o rechazar la hiptesis nula (H

0

)

se basa en los datos de la muestra aleatoria. Cuando se toma una decisin

utilizando la informacin de una muestra aleatoria esta decisin se encuentra sujeta

a error. En las pruebas de hiptesis pueden cometerse dos tipos de errores: error

del tipo I y error del tipo II.

4.2.4.1 Error tipo I.- El error de tipo I se comete cuando se rechaza la hiptesis

nula (H

0

) siendo que en realidad es verdadera. La probabilidad de cometer el error

de tipo I es igual a o, es decir, es el nivel de significacin. Los niveles de

significacin o significancia ms utilizados son: 10%, 5% y 1%.

El nivel de confianza es el complemento del nivel de significacin, de tal

forma que se cumple la ecuacin (4.1).

nivel de confianza + nivel de significacin = 1 = 100% (4.1)

4.2.4.2 Error tipo II.- El error de tipo II se comete cuando se acepta la hiptesis

nula (H

0

) cuando en realidad es falsa. La probabilidad de cometer el error tipo II se

representa por .

Pruebas de hiptesis estadsticas

IV-3

En el cuadro (4.1) se muestran todas las situaciones que se pueden presentar

en la toma de decisiones.

CUADRO (4.1)

OPCIONES QUE SE PRESENTAN EN LA TOMA DE DECISIONES

DECISION H

0

VERDADERA H

1

VERDADERA

ACEPTAR H

0

Decisin correcta Error tipo II

RECHAZAR H

0

Error tipo I Decisin correcta

Por ejemplo, si:

H

0

= el medicamento XYZ no es peligroso.

H

1