Académique Documents

Professionnel Documents

Culture Documents

Inferencia Bayesiana PDF

Transféré par

Xavier VivasTitre original

Copyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

Inferencia Bayesiana PDF

Transféré par

Xavier VivasDroits d'auteur :

Formats disponibles

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5.

Comentarios nales

Tema 6: Introduccion a la Inferencia Bayesiana

Conchi Ausn

Departamento de Estadstica

Universidad Carlos III de Madrid

concepcion.ausin@uc3m.es

CESGA, Noviembre 2012

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Contenidos

1. Elementos basicos de la inferencia Bayesiana

2. Inferencia Bayesiana en variables binarias

3. Inferencia Bayesiana en variables normales

4. Prediccion Bayesiana

5. Comentarios nales

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

El Teorema de Bayes

Recordamos que...

Dados dos sucesos A y B,

Pr (A B) = Pr (A) Pr (B | A)

= Pr (B) Pr (A | B)

Teorema de Bayes

Pr (A | B) =

Pr (B | A) Pr (A)

Pr (B)

Ejemplo: He visto a una persona con bolso. Calcular la probabilidad de

que fuera mujer. Suponer que el 50 % de las personas son mujeres, el

60 % de las mujeres llevan bolso y el 20 % de los hombres tambien.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Probabilidades a priori y a posteriori

Dada una hipotesis, H, sobre una poblacion, la inferencia Bayesiana la

actualiza una vez que se han observado datos mediante,

Pr (H | Datos) =

Pr (Datos | H) Pr (H)

Pr (Datos)

donde:

Pr(H) es la probabilidad a priori de que la hipotesis H sea cierta.

Pr(H | D) es la probabilidad a posteriori de que la hipotesis H sea

cierta, la probabilidad de que H sea cierta una vez que se han

observado los datos.

Pr(Datos | H) es la verosimilitud, es decir, la probabilidad de que

haber observado esos datos si la hipotesis H es cierta.

Pr(Datos) es la verosimilitud marginal, la probabilidad de que haber

observado esos datos independientemente de que H sea cierta o no.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Pasos en la inferencia Bayesiana

Supongamos que estamos interesados en estimar un parametro, , a

partir de unos datos x = {x

1

, . . . , x

n

}.

Con la losofa Bayesiana no es un valor jo, sino una variable

aleatoria. Los pasos esenciales son:

1. Fijar una distribucion a priori para , que denotamos por (), que

exprese nuestras creencias sobre antes de observar los datos.

2. Datos los datos, x, escoger un modelo estadstico que describa su

distribucion dado , es la verosimilitud f (x | ).

3. Usando el Teorema de Bayes, actualizar las creencias sobre

calculando su distribucion a posteriori:

( | x) =

f (x | ) ()

f (x)

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Pasos en la inferencia Bayesiana

La verosimilitud marginal o distribucion marginal de los datos,

f (x) =

_

f (x | )()d

es una constante de integracion que asegura que la distribucion a

posteriori de integre uno, no depende de .

Por tanto, esta constante no proporciona ninguna informacion adicional

sobre la distribucion a posteriori y a menudo se escribe,

( | x) f (x | ) ()

Esta expresion es la distribucion a posteriori sin normalizar, que es

proporcional a la verosimilitud multiplicada por la distribucin a priori.

Un intervalo creble al 95 % para es simplemente un intervalo (a, b) tal

que la probabilidad a posteriori de que este en el intervalo es del 95 %.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables binarias

Supongamos que tenemos una moneda y queremos estimar la

probabilidad de obtener cara,

Pr(X = cara | ) = , Pr(X = cruz | ) = 1 .

Imaginemos que nuestras creencias a priori sobre se pueden describir

como una distribucion uniforme, U(0, 1), luego la distribucion a priori de

es,

() = 1, 0 < < 1.

Para actualizar la distribucion de , realizamos el experimento de tirar la

moneda 12 veces y obtenemos 9 caras y 3 cruces. Con estos datos,

x = {x

1

, . . . , x

12

}, la verosimilitud es,

f (x | ) =

_

12

9

_

9

(1 )

3

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables binarias

Luego, la distribucion a posteriori de es proporcional a,

( | x)

9

(1 )

3

,

que es el n ucleo de una distribucion beta,

( | x) =

9

(1 )

3

_

1

0

9

(1 )

3

d

=

1

B (10, 4)

101

(1 )

41

Luego, | x B(10, 4).

Recordamos que la densidad de una beta B(, ) es,

( | , ) =

1

B (, )

1

(1 )

1

donde

B (, ) =

()()

( +)

.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables binarias

Teniendo en cuenta que la media de una B(, ) es,

E[ | , ] =

+

,

entonces, dados los datos, la media a posteriori de es,

E[ | x] =

10

14

=

5

7

=

1

7

1

2

+

6

7

9

12

.

Luego,

E[ | x] =

1

7

E[] +

6

7

MV

donde E[] = 1/2 es la media a priori de la U(0, 1) y

MLE

= 9/12 es la

estimacion maximo verosmil.

Luego, la media a posteriori es una media ponderada de la media de

nuestras creencias a priori y la estimacion MV.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables binarias

Observar que la distribucion uniforme, U(0, 1), es un caso particular de la

densidad beta cuando = = 1, de modo que la distribucion a priori y

la posteriori son distribuciones beta, se dice que son conjugadas.

De modo mas general, si asumimos a priori una distribucion beta B(, ),

()

1

(1 )

1

,

y la verosimilitud es,

f (x | )

k

(1 )

nk

,

la distribucion a posteriori es una beta B( + k, + n k),

( | x)

+k1

(1 )

+nk1

.

Luego,

E[ | x] =

+ k

+ + n

=

+

+ + n

E[] +

n

+ + n

MV

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables binarias

Ejemplo: El archivo de datos birthwt en la librera MASS de R incluye, en

la variable bwt, el peso al nacer de 189 ni nos en Massachusetts en 1986.

Se considera que un bebe tiene bajo peso al nacer si pesa menos de 2500

gramos. Calcular:

1. La probabilidad a posteriori de que la proporcion de ni nos con bajo

peso sea mayor del 27.5 %

2. Un intervalo creble al 95 % para dicha proporcion.

3. Comparar los resultados con los obtenidos de forma frecuentista.

Usando:

Una distribucion a priori no informativa: B(1, 1).

Una distribucion a priori informativa: B(1, 5) o B(5, 1).

Una distribucion a priori informativa que reeje un estudio anterior

que dio lugar a un intervalo de conanza al 95 % para la proporcion

de ni nos con bajo peso entre el 10 % y el 20 %.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables binarias

Si tomamos y cada vez mas peque nos: , 0, la media a

posteriori de converge a

MV

. Con esta eleccion, la distribucion a priori

sera:

()

1

(1 )

,

que no es una funcion de densidad ya que

_

()d = , se dice que es

una distribucion a priori impropia.

Esta eleccion a priori es valida ya que da lugar a una distribucion a

posteriori propia: | x B(k, n k).

Las distribuciones impropias permiten no imponer informacion subjetiva a

priori. Sin embargo, es importante vericar que la distribucion a posteriori

sea propia.

Ejemplo: Usar una distribucion a priori impropia en el ejemplo anterior.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Comparacion con resultados frecuentistas

Los resultados con inferencia Bayesiana y frecuentista son similares

cuando:

1. Se usan distribuciones a priori objetivas.

2. El tama no muestral es muy grande y la inuencia de la distribucion

a priori es muy peque na en comparacion con la inuencia de la

verosimilitud.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

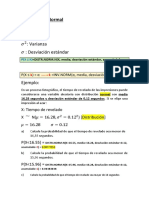

Inferencia Bayesiana en variables normales

Suponemos ahora que estamos interesados en hacer inferencia para una

poblacion normal, X | ,

2

N(,

2

), con densidad,

f

_

x | ,

2

_

=

1

2

2

exp

_

(x )

2

2

2

_

.

Para facilitar los calculos, es mejor trabajar con la precision = 1/

2

en

lugar de usar la varianza,

f (x | , ) =

1/2

2

exp

_

2

(x )

2

_

Dada una muestra de datos, x = {x

1

, . . . , x

n

}, de una variable N(, 1/)

y una distribucion a priori sobre (, ), el objetivo es obtener su

distribucion a posteriori.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables normales

Dados los datos, x, la verosimilitud de (, ) es,

f (x | , ) = (2)

n/2

n/2

exp

_

2

_

(n 1)s

2

+ n ( x )

2

_

_

donde s

2

=

1

n1

n

i =1

(x

i

x)

2

Demostraci on

f (x | , ) =

n

i =1

1/2

2

exp

_

2

(x

i

)

2

_

= (2)

n/2

n/2

exp

_

2

n

i =1

(x

i

)

2

_

= (2)

n/2

n/2

exp

_

2

n

i =1

(x

i

x + x )

2

_

= (2)

n/2

n/2

exp

_

2

n

i =1

(x

i

x)

2

+ n ( x )

2

_

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables normales

A priori podemos usar la distribucion normal-gamma que es conjugada y

viene dada por:

| N

_

m,

1

_

G

_

a

2

,

b

2

_

o equivalentemente,

(, ) = ( | ) ()

1/2

exp

_

2

( m)

2

_

a

2

1

exp

_

b

2

_

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables normales

Dados los datos, x, la distribucion a posteriori es tambien una

normal-gamma con:

| , x N

_

m

,

1

_

| x G

_

a

2

,

b

2

_

donde,

m

=

m + n x

+ n

,

= + n,

a

= a + n,

b

= b + (n 1) s

2

+

n

+ n

(m x)

2

.

Observar que m

es una media ponderada de la media a priori de y su

estimador MV.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables normales

Demostraci on

(, ) (, ) f (x | , )

a

2

1

exp

_

[

b+(m)

2

]

2

_

n

2

exp

_

[

(n1)s

2

+n( x)

2

]

2

_

a+n1

2

exp

_

[

b+(n1)s

2

+(+n)

2

2(m+n x)+m

2

+n x

2

]

2

_

1

2

exp

_

2

_

( + n)

_

m + n x

+ n

_

2

__

a+n

2

1

exp

_

2

_

b + (n 1) s

2

+m

2

+ n x

2

(m + n x)

2

+ n

__

1

2

exp

_

( + n)

2

_

m + n x

+ n

_

2

_

a+n

2

1

exp

_

2

_

b + (n 1) s

2

+

n

+ n

(m x)

2

__

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables normales

En la practica, el interes esta en la distribucion marginal a posteriori de

que viene dada por:

| x T

a

_

m

,

b

_

donde T

a

(, ) representa una distribucion t de Student no estandarizada

tal que:

T

T

a

donde T

a

es una distribucion t de Student standard con a grados de

libertad.

Dados los datos, x, un intervalo creble al (1 ) % para es:

m

t

/2,a

_

b

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables normales

Demostraci on

Sabemos que si Z N(0, 1) y V

2

, entonces:

Z

_

V/

T

Dados los datos, se tiene que:

_

( m

) N (0, 1) ,

y

b

G

_

a

2

,

1

2

_

b

2

a

,

luego,

( m

)

_

b

T

a

m

_

b

T

a

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables normales

Ejemplo: El archivo de datos crabs en la librera MASS de R incluye, en la

variable CL, la longitud del caparazon en milmetos de 200 cangrejos de la

especie Leptograpsus variegatus observados en Fremantle, Australia.

Asumiendo normalidad de dicha longitud, calcular:

1. La probabilidad a posteriori de que la media de la longitud sea mayor

de 30 milmetros.

2. Un intervalo creble al 95 % para dicha media.

3. Comparar los resultados con los obtenidos de forma frecuentista.

Usando una distribucion normal-gamma a priori para (, ):

No informativa con a = 0,01, b = 0,01, m = 0 y = 0,01.

Informativa que reeje un estudio anterior que con 50 datos

dio lugar a un intervalo de conanza al 95 % para la media de la

longitud del caparazon entre 20 y 30 milmetros.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables normales

Si consideramos una distribucion a priori impropia:

(, )

1

,

obtenemos que a posteriori:

| , x N

_

x,

1

n

_

| x G

_

n 1

2

,

(n 1)s

2

2

_

Y la distribucion marginal de a posteriori es:

| x T

n1

_

x,

(n 1)s

2

(n 1)n

_

T

n1

_

x,

s

2

n

_

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Inferencia Bayesiana en variables normales

As, un intervalo creble al (1 ) % para es:

x t

/2,n1

_

s

2

n

que es igual al intervalo de conanza clasico para una media de una

distribucion normal.

Ejemplo: Usar una distribucion a priori impropia en el ejemplo anterior.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Prediccion Bayesiana

Habitualmente, mas que en los parametros, el interes radica en la

predicci on de nuevos valores de la variable. Dados los datos observados,

x = {x

1

, . . . , x

n

}, la distribucion predictiva de una nueva observacion es:

f (x

n+1

| x) =

_

f (x | )( | x)d

Para una muestra de una poblacion normal, X | , N(, 1/), con

una distribucion normal-gamma a priori, se tiene que:

X

n+1

| x T

a

_

m

,

(

+ 1)b

_

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Prediccion Bayesiana

Demostraci on

Podemos escribir X

n+1

= +

n+1

, donde,

| , x N

_

m

,

1

_

| , x N

_

0,

1

_

Luego,

X

n+1

| , x N

_

m

,

_

1 +

1

_

1

_

.

y

| x G(, ).

Por tanto,

X

n+1

| x T

a

_

m

,

(

+ 1)b

_

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Prediccion Bayesiana

En particular, si se asume una a priori impropia, (, ) 1/, la

distribucion predictiva es,

X

n+1

| x T

n1

_

x,

(n + 1)s

2

n

_

que coincide con la distribucion de la prediccion de una nueva

observacion desde el punto de vista clasico.

Ejemplo: Obtener la distribucion predictiva para la longitud del caparazon

de un nuevo cangrejo usando las distribuciones a priori consideradas en

los ejemplos anteriores.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Comentarios nales

Hemos visto como realizar inferencia bayesiana para variables

binarias y normales. En estos casos existen distribuciones a priori

conjugadas que facilitan la obtencion de la distribucion a posteriori.

Existen otros modelos para los que existen distribuciones

conjugadas, por ejemplo:

Para una poblacion exponencial, X | E(), asumiendo una

gamma a priori para la tasa, G(, ).

Para una poblacion Poisson, X | P(), asumiendo una gamma a

priori para la media, G(, ).

Para una poblaci on uniforme, X | U(0, ), asumiendo una Pareto

a priori PA(, ).

El uso de distribuciones cojugadas facilita los calculos, pero no

necesariamente dan lugar a las mejores elecciones a priori. Existen

muchas otras alternativas como las distribuciones a priori de

Jereys, o las distribuciones de referencia.

1. Elementos basicos 2. Inferencia en variables binarias 3. Inferencia en variables normales 4. Prediccion 5. Comentarios nales

Comentarios nales

Sin embargo, en la mayora de los problemas en la practica dado un

modelo y una dsitribucion a priori sobre los parametros, la

distribucion a posteriori no es facil de obtener anallitamente.

Para abordar este problema, se pueden utilizar diferentes alternativas

que vamos a estudiar en los siguientes temas:

Aproximaciones asint oticas.

Integraci on Monte Carlo.

Simulaci on Monte Carlo:

Con metodos directos.

Mediante cadenas de Markov.

Vous aimerez peut-être aussi

- Mpro2 U2 A2 AlasDocument12 pagesMpro2 U2 A2 AlasAlex StottoPas encore d'évaluation

- Parcial - Escenario 4 - Primer Bloque-Teorico - Practico - Simulacion - (GRDocument15 pagesParcial - Escenario 4 - Primer Bloque-Teorico - Practico - Simulacion - (GRsandy lorena cometta uribePas encore d'évaluation

- Universidad Tecnica de AmbatoDocument8 pagesUniversidad Tecnica de AmbatoKevin RumipambaPas encore d'évaluation

- Teoria de ProbabilidadDocument18 pagesTeoria de ProbabilidadDouglas SalazarPas encore d'évaluation

- Formulas y TablasDocument10 pagesFormulas y TablasJuanRobertoBetancourthPas encore d'évaluation

- S11.s1 - Material (Distribución de Probabilidad Discreta - Poisson)Document20 pagesS11.s1 - Material (Distribución de Probabilidad Discreta - Poisson)Margorith RamosPas encore d'évaluation

- PRO - 11 Estimación de La Incertidumbre de Las Mediciones v2Document10 pagesPRO - 11 Estimación de La Incertidumbre de Las Mediciones v2resp 4922Pas encore d'évaluation

- S09 Probabilidades ASU 2202Document43 pagesS09 Probabilidades ASU 2202Alexander Olaya HuaraccoPas encore d'évaluation

- Bioestadistica Respuestas.Document6 pagesBioestadistica Respuestas.Pabla BalbuenaPas encore d'évaluation

- Apuntes 2 Variables Aleatorias y Funciones de ProbabilidadDocument5 pagesApuntes 2 Variables Aleatorias y Funciones de ProbabilidadRodrigoPas encore d'évaluation

- Clase 02Document16 pagesClase 02wilson QuintanaPas encore d'évaluation

- Probabilidad UNAH Análisis Cuantitativo IDocument6 pagesProbabilidad UNAH Análisis Cuantitativo IAlexander OrdoñezPas encore d'évaluation

- Actividad 3. Ejercicios de Aplicación (Individual) - CorreccionDocument12 pagesActividad 3. Ejercicios de Aplicación (Individual) - Correccionmagda lorena ruiz mavesoyPas encore d'évaluation

- Separata 4 PDFDocument30 pagesSeparata 4 PDFEdgar ChoqPas encore d'évaluation

- RP-MAT2-K20 - Ficha #20Document11 pagesRP-MAT2-K20 - Ficha #20roger_ruizPas encore d'évaluation

- Estadistica y Probabilidades (EF 2018-1)Document10 pagesEstadistica y Probabilidades (EF 2018-1)Brenda Chavez FernandezPas encore d'évaluation

- Distribucion y MuestreoDocument5 pagesDistribucion y MuestreoMiguel AngelPas encore d'évaluation

- Comparaciones OrtogonalesDocument8 pagesComparaciones OrtogonalesVane MartinezPas encore d'évaluation

- Distribucion T-STUDENTDocument7 pagesDistribucion T-STUDENTPeter SanchezPas encore d'évaluation

- Probabilidades de EventosDocument5 pagesProbabilidades de Eventosiborella999Pas encore d'évaluation

- Tema 4. La Correlación Entre VariablesDocument40 pagesTema 4. La Correlación Entre VariablesMarBella Cosmetics100% (2)

- Medidas de DispersiónDocument30 pagesMedidas de DispersiónHaggy QuiñonesPas encore d'évaluation

- Taller 2Document8 pagesTaller 2ByOtamerPas encore d'évaluation

- PTO 14 Distribuciones GráficasDocument15 pagesPTO 14 Distribuciones GráficasCristian CastroPas encore d'évaluation

- 10estad2021-2 UnacDocument35 pages10estad2021-2 UnacRay Garcia OrtizPas encore d'évaluation

- Ejemplo de Variable Aleatoria Discreta y ContinuaDocument3 pagesEjemplo de Variable Aleatoria Discreta y ContinuaGianella De La Hoz LongaPas encore d'évaluation

- Tablas BayesDocument8 pagesTablas BayesSonia NogueraPas encore d'évaluation

- Guía de distribuciones muestrales, intervalos de confianza y pruebas de hipótesisDocument123 pagesGuía de distribuciones muestrales, intervalos de confianza y pruebas de hipótesisChristian Fabian Montes CharryPas encore d'évaluation

- Practica Distribucion ExponencialDocument2 pagesPractica Distribucion ExponencialJACK ANTONI HIDALGO QUINTOPas encore d'évaluation