Académique Documents

Professionnel Documents

Culture Documents

Conversión Analógica Digital

Transféré par

Miguel Montoya HuarotoCopyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

Conversión Analógica Digital

Transféré par

Miguel Montoya HuarotoDroits d'auteur :

Formats disponibles

Conversión Analógica Digital

La conversión analógica-digital consiste en la transcripción de señales analógicas en señal

digital, con el propósito de facilitar su procesamiento (codificación, compresión, etcétera) y

hacer la señal resultante (digital) más inmune al ruido y otras interferencias a las que son

más sensibles las señales analógicas.

Comparación de señales analógicas y digital

Una señal analógica es aquella cuya amplitud (típicamente tensión de una señal que

proviene de un transductor y amplificador) puede tomar en principio cualquier valor, esto

es, su nivel en cualquier muestra no está limitado a un conjunto finito de niveles

predefinidos como es el caso de las señales cuantificadas.

Las señales analógicas no se diferencian, por tanto, de las señales digitales en su precisión

(precisión que es finita tanto en las analógicas como en las digitales) o en la fidelidad de

sus formas de onda (distorsión). Con frecuencia es más fácil obtener precisión y preservar

la forma de onda de la señal analógica original (dentro de los límites de precisión

impuestos por el ruido que tiene antes de su conversión) en las señales digitales que en

aquéllas que provienen de soportes analógicos, caracterizados típicamente por relaciones

señal a ruido bajas en comparación.

Ventajas de la señal digital

Sistema digital-analógico.

Cuando una señal digital es atenuada o experimenta perturbaciones leves, puede

ser reconstruida y amplificada mediante sistemas de regeneración de señales.

Cuenta con sistemas de detección y corrección de errores, que se utilizan cuando la

señal llega al receptor; entonces comprueban (uso de redundancia) la señal,

primero para detectar algún error, y, algunos sistemas, pueden luego corregir

alguno o todos los errores detectados previamente.

Facilidad para el procesamiento de la señal. Cualquier operación es fácilmente

realizable a través de cualquier software de edición o procesamiento de señal.

La señal digital permite la multigeneración infinita sin pérdidas de calidad.

Es posible aplicar técnicas de compresión de datos sin pérdidas o técnicas de

compresión con pérdidas basados en la codificación perceptual mucho más

eficientes que con señales analógicas.

Inconvenientes de la señal digital

Se necesita una conversión analógica-digital previa y una decodificación posterior,

en el momento de la recepción.

Si no se emplean un número suficiente de niveles de cuantificación en el proceso de

digitalización, la relación señal ruido (SNR) de la señal resultante se verá reducida.

El contenido en frecuencia de la señal digital viene limitado por la frecuencia de

Nyquist, de forma que la componente máxima se corresponde con la mitad de

la tasa de muestreo. Además, por cuestiones prácticas, se debe dejar un margen de

seguridad desde la frecuencia de Nyquist y el límite de la banda de interés. Así por

ejemplo, en los CD, cuya frecuencia de muestreo es 44,1 kHz, la componente

máxima es 22,05 kHz y la banda de interés se limita a los 20 kHz (margen del 10%).

Digitalización

Muestreo

La digitalización o conversión A/D, básicamente, consiste en realizar de forma periódica

medidas de la amplitud (tensión) de una señal; por ejemplo, la que proviene de un

micrófono si se trata de (retención) por un circuito de retención (hold), el tiempo suficiente

para permitir evaluar su nivel (cuantificación). Desde el punto de vista matemático, este

proceso no se contempla porque se trata de un recurso técnico debido a limitaciones

prácticas, y carece de modelo matemático.

Durante el “muestreo” y la “retención”, la señal aún es analógica, puesto que aún puede

tomar cualquier valor. No obstante, a partir de la “cuantificación”, cuando la señal ya toma

valores finitos, la señal ya es digital. Los cuatro procesos tienen lugar en un conversor

analógico-digital.

Cuantificación

En el proceso de cuantificación se mide el nivel de voltaje de cada una de las muestras.

Consiste en asignar un margen de valor de una señal analizada a un único nivel de salida.

Incluso en su versión ideal, añade como resultado una distorsión no deseada a la señal de

entrada: el ruido de cuantificación.

Codificación

La codificación consiste en traducir los valores obtenidos durante la cuantificación

al código binario. Hay que tener presente que el código binario es el más utilizado, pero

también existen otros tipos de códigos que también son utilizados.

Ejemplo de Digitalización

Una computadora o cualquier sistema de control, basado en un microprocesador, no puede

interpretar señales analógicas porque sólo utiliza señales digitales. Es necesario traducir o

transformar en señales binarias, lo que se denomina proceso de digitalización o conversión

de señales analógicas a digitales.

Digitalización por muestreo de una señal analógica.

Si el valor de la señal en ese instante está por debajo de un determinado umbral, la

señal digital toma un valor mínimo (0).

Cuando la señal analógica se encuentra por encima del valor umbral, la señal digital

toma un valor máximo (1).

El momento en que se realiza cada lectura, es ordenado por un sistema de sincronización

que emite una señal de reloj con un período constante. Estas conversiones analógico-

digitales son habituales en adquisición de datos por parte de una computadora y en la

modulación digital para transmisiones y comunicaciones por radio.

Compresión

La compresión consiste en la reducción de la cantidad de datos a transmitir o grabar, pues

hay que tener en cuenta que la capacidad de almacenamiento de los soportes es finita, de

igual modo que los equipos de transmisión pueden manejar sólo una determinada tasa de

datos.

Para realizar la compresión de las señales se usan complejos algoritmos de compresión

(fórmulas matemáticas).

Hay dos tipos de compresión:

1. Compresión sin pérdidas: en esencia se transmite toda la información pero

eliminando aquella que es redundante. Para ello se hace uso de conceptos de

la Teoría de la Información.

2. Compresión con pérdidas: se desprecia cierta información considerada

perceptualmente poco relevante. Este tipo de compresión aprovecha las

limitaciones en la percepción del ser humano para eliminar aquella información

que difícilmente puede percibir. No obstante una aplicación excesiva de esta

compresión puede conducir a una pérdida de la “calidad” en el resultado final.

Las técnicas de compresión sin pérdidas se basan en algoritmos matemáticos que permiten

la reducción de los bits que es necesario almacenar o transmitir. Un ejemplo común es la

llamada “codificación de longitud de secuencias” (o codificación Huffman), utilizada por

ejemplo en el código Morse. En este tipo de codificación se emplean secuencias de bits más

cortas para aquellos símbolos muy frecuentes, dejando las más largas para aquellos que

aparecen no muy a menudo. Así, en Morse, la letra 'e' (muy frecuente en inglés) se codifica

con sólo un punto, mientras que la 'j' (con escaso uso en inglés) se codifica con un punto

seguido de tres rayas. Como puede verse, el resultado es una reducción del número total de

bits a transmitir o almacenar.

Las técnicas de codificación mencionadas son de gran utilización en los sistemas de

transmisión digital. Sin embargo, en lo que se refiere al tratamiento digital de imagen y

sonido, dada la aleatoriedad de este tipo de señales (todos los símbolos tienden a

ser equiprobables), son poco efectivos en cuanto a la reducción del tamaño de los archivos

resultantes.

Por eso, la compresión del sonido y la imagen para Internet se basa más en el

conocimiento del funcionamiento de nuestros sentidos. Son técnicas que asumen pérdidas

de información, de ahí su nombre de compresión con pérdidas, pero están diseñados de

modo que las “pérdidas” no sean apenas percibidas por los seres humanos.

Como ejemplos clásicos se pueden citar:

La compresión gráfica GIF se basa en la utilización de una paleta de 256 colores

estudiados cuidadosamente de acuerdo con la apreciación del color por ojo humano.

Con esto se logra una razón de compresión de ⅓. Los 256 se pueden codificar con 8

bits, en vez de usar 24 bits para definir el color verdadero. La pérdida de información

parece grande, pero ¿puede el ojo humano apreciar los matices de más de un millón de

colores?.

La compresión gráfica JPEG en lugar de definir la imagen por sus tres colores básicos

(R;G;B), utiliza la trasformación de la información de color a la de luminancia (1 valor

por muestra) y de crominancia (2 valores por muestra) de forma similar a como se

emplea en la señal de televisión. Resulta que el ojo humano es más sensible a los

cambios de brillo (luminancia) que de color (crominancia), por lo que estos códecs

codifican la luminancia de todas las muestras o píxeles y un valor medio de cada una

de los valores crominancias cada 4 píxeles. Para codificaciones de 8 bits por píxel, la

cuenta de la razón de compresión es 4x8+8+8=48, en vez de 4x8x3=96 de la original.

Vous aimerez peut-être aussi

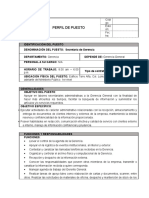

- Perfil de Puesto Secretaria de GerenciaDocument2 pagesPerfil de Puesto Secretaria de GerenciaClaudia Maradiaga77% (39)

- Brauerizing A How To Guide Brauerizing Techniques and ConceptsDocument15 pagesBrauerizing A How To Guide Brauerizing Techniques and ConceptsJeik BeatPas encore d'évaluation

- Vale Salida AlmacenDocument4 pagesVale Salida AlmacenMartha Elizabeth Barrios VazquezPas encore d'évaluation

- Tema 3 Modulacion PCMDocument52 pagesTema 3 Modulacion PCMKéké Docteur100% (1)

- Conversión Analógico-Digital (ADC)Document4 pagesConversión Analógico-Digital (ADC)ËlvisPëstänäPas encore d'évaluation

- Características Del Sonido DigitalDocument2 pagesCaracterísticas Del Sonido Digitalvanesass160% (1)

- Cuestionario Tecnicas de Mezcla EQ y DINDocument2 pagesCuestionario Tecnicas de Mezcla EQ y DINlesoundPas encore d'évaluation

- 16 FórmulaMixer - Material de Trabajo Clase 2Document9 pages16 FórmulaMixer - Material de Trabajo Clase 2angelPas encore d'évaluation

- 14 Audio ProfesionalDocument91 pages14 Audio ProfesionalGustavo De SantisPas encore d'évaluation

- Hacia La Mezcla CreativaDocument46 pagesHacia La Mezcla CreativaAlexis ContrerasPas encore d'évaluation

- Masterización digital: fundamentos y flujo de trabajoDocument43 pagesMasterización digital: fundamentos y flujo de trabajoAnzwer LazySundayPas encore d'évaluation

- Sonido Digital InterfacesDocument114 pagesSonido Digital Interfacesttap79Pas encore d'évaluation

- Unidad 8 MDocument19 pagesUnidad 8 MFrancisco Franco Caudillo y LectorPas encore d'évaluation

- Conversion analógico a digitalDocument7 pagesConversion analógico a digitalEduardoAyalaPas encore d'évaluation

- Compuertas 1Document8 pagesCompuertas 1Sergio BrunoPas encore d'évaluation

- Informática musical: Micrófonos y técnicas de posicionamientoDocument59 pagesInformática musical: Micrófonos y técnicas de posicionamientoErnesto Aguilar Sosa100% (1)

- Esquema de Configuracion de Una Red Lan Con Diferentes Segmentos IpDocument1 pageEsquema de Configuracion de Una Red Lan Con Diferentes Segmentos IpHernan Dario Mina OrtizPas encore d'évaluation

- VocoderDocument5 pagesVocoderdiejuanPas encore d'évaluation

- TP Emumix-Empa 2020 PDFDocument2 pagesTP Emumix-Empa 2020 PDFJulián Rodríguez F.Pas encore d'évaluation

- Manual para Masterizacion de Audio PDFDocument3 pagesManual para Masterizacion de Audio PDFLisbeth RomeroPas encore d'évaluation

- Sonido Directo PDFDocument29 pagesSonido Directo PDFanabetunePas encore d'évaluation

- Convertidores DAC y CAD PDFDocument7 pagesConvertidores DAC y CAD PDFskyworld99Pas encore d'évaluation

- Tema 7 - El Audio DigitalDocument20 pagesTema 7 - El Audio Digitalnoemi76Pas encore d'évaluation

- CAD 40cDocument15 pagesCAD 40cFernando PérezPas encore d'évaluation

- Adjunto 01000004300370Document1 pageAdjunto 01000004300370romiaranda2020Pas encore d'évaluation

- Transmision de AudioDocument11 pagesTransmision de AudioSaul MalcaPas encore d'évaluation

- Manual Melodyne Editor SpanishDocument141 pagesManual Melodyne Editor SpanishArturo de la RosaPas encore d'évaluation

- F.tischmeyer - Masterizacion en Daw - DVD 1Document23 pagesF.tischmeyer - Masterizacion en Daw - DVD 1Cris MaidanaPas encore d'évaluation

- Modulacion-Por Ampitud de PulsosDocument21 pagesModulacion-Por Ampitud de PulsosAnonymous xViiYStvPas encore d'évaluation

- Como Emprender Una FondaDocument20 pagesComo Emprender Una FondaDebora100% (1)

- PDFDocument85 pagesPDFmfqcPas encore d'évaluation

- Ejemplo EcualizacionDocument4 pagesEjemplo EcualizacionGabrielle DleonhernPas encore d'évaluation

- Modulo Introduccion Al Sonido en Vivo PDFDocument120 pagesModulo Introduccion Al Sonido en Vivo PDFFabian Andres GonzalezPas encore d'évaluation

- Line Array Ax-9015 EspañolDocument18 pagesLine Array Ax-9015 EspañolAndres GuerreroPas encore d'évaluation

- Procesador de AudioDocument72 pagesProcesador de AudioDattel CAPas encore d'évaluation

- Conectores DJDocument18 pagesConectores DJJefferson RoseroPas encore d'évaluation

- Red de Frecuencia Unica PDFDocument10 pagesRed de Frecuencia Unica PDFDIEGO GUALOCHICO100% (1)

- Simulación Alteraciones Señal ComunicacionesDocument10 pagesSimulación Alteraciones Señal Comunicacionesjonathan_e_tito_oPas encore d'évaluation

- RME Fireface 400 - Manual Usuario (Traducción)Document19 pagesRME Fireface 400 - Manual Usuario (Traducción)Natalia AlcónPas encore d'évaluation

- LoudnessDocument1 pageLoudnessJulioGuerreroPas encore d'évaluation

- Rider TecnicoDocument16 pagesRider TecnicoErlinsonPas encore d'évaluation

- Traduccion Digital Communications by Bernard SklarDocument10 pagesTraduccion Digital Communications by Bernard SklarWilmer Mendez100% (1)

- Implementación de Sistema de Sonorización AmbientalDocument9 pagesImplementación de Sistema de Sonorización AmbientalWillyAlegriaPas encore d'évaluation

- ECUALIZACIÓNDocument3 pagesECUALIZACIÓNShane CampbellPas encore d'évaluation

- Rough Mix PDFDocument15 pagesRough Mix PDFjesus david maturana cardonaPas encore d'évaluation

- Tutorial Rfe wwb6 Spanish PDFDocument10 pagesTutorial Rfe wwb6 Spanish PDFAlejandro ChapaPas encore d'évaluation

- Factura Edesa 12-2019Document1 pageFactura Edesa 12-2019Tere EscobarPas encore d'évaluation

- Yamaha CL5Document65 pagesYamaha CL5Mario Loayza100% (1)

- Análisis Comparativo de Ber para Modulaciones BPSK y QPSK en Distintos Tipos de CanalesDocument6 pagesAnálisis Comparativo de Ber para Modulaciones BPSK y QPSK en Distintos Tipos de CanalesElvis RudasPas encore d'évaluation

- ElectoacusticaDocument16 pagesElectoacusticaAriel PiñaPas encore d'évaluation

- MPEG-2 PaperDocument6 pagesMPEG-2 PaperJonathan Caycho MoralesPas encore d'évaluation

- Mezcladores de AudioDocument26 pagesMezcladores de AudioCivantos1999Pas encore d'évaluation

- Ecualizacion y FiltrosDocument3 pagesEcualizacion y Filtrosdiegoedh dhPas encore d'évaluation

- 02 - Sintesis FM y AMDocument5 pages02 - Sintesis FM y AMCarlos LoorPas encore d'évaluation

- 8 5 1 3 Practica Final Capitulo 8Document7 pages8 5 1 3 Practica Final Capitulo 8Karla Martinez0% (1)

- Cómo usar Elastic Audio en ProTools para ajustar el tempo y posición de audioDocument2 pagesCómo usar Elastic Audio en ProTools para ajustar el tempo y posición de audioTony HerreraPas encore d'évaluation

- Filtros y EcualizadoresDocument34 pagesFiltros y EcualizadoresMarco AlvarezPas encore d'évaluation

- Tecnicas de MuestreoDocument7 pagesTecnicas de MuestreoJuan Camilo NaranjoPas encore d'évaluation

- Cuantificación No UniformeDocument9 pagesCuantificación No Uniformejean paul rengifoPas encore d'évaluation

- Muestreo de señalesDocument8 pagesMuestreo de señalesMilena RodriguezPas encore d'évaluation

- Analicis Señales Digitales MONOGRAFIADocument11 pagesAnalicis Señales Digitales MONOGRAFIAdarkfenyx69Pas encore d'évaluation

- Muestreo DigitalDocument6 pagesMuestreo DigitalSergio VallejosPas encore d'évaluation

- Capitulo V - Grupo 2Document7 pagesCapitulo V - Grupo 2Miguel Montoya HuarotoPas encore d'évaluation

- Parcial de MicroondasDocument20 pagesParcial de MicroondasMiguel Montoya HuarotoPas encore d'évaluation

- Comunicacion Via SateliteDocument68 pagesComunicacion Via SatelitePolluelo PeluchePas encore d'évaluation

- SOCIOLOGIADocument16 pagesSOCIOLOGIAMiguel Montoya HuarotoPas encore d'évaluation

- ParcialDocument6 pagesParcialMiguel Montoya HuarotoPas encore d'évaluation

- Mapa ConceptualDocument1 pageMapa ConceptualMiguel Montoya HuarotoPas encore d'évaluation

- NTSCDocument12 pagesNTSCMiguel Montoya HuarotoPas encore d'évaluation

- Telem PDFDocument18 pagesTelem PDFDanielaz SaenzPas encore d'évaluation

- CaraDocument1 pageCaraMiguel Montoya HuarotoPas encore d'évaluation

- Arquitectura de Base de DatosDocument1 pageArquitectura de Base de DatosMartin Diaz FloresPas encore d'évaluation

- Conexión 701Server 701Client 40Document5 pagesConexión 701Server 701Client 40jvgonzalezramonPas encore d'évaluation

- Inventario PC OmarDocument630 pagesInventario PC OmaromargesPas encore d'évaluation

- ArreglosDocument22 pagesArreglosChristian MazacottePas encore d'évaluation

- Clasificación información ISO 27001Document2 pagesClasificación información ISO 27001John EspitiaPas encore d'évaluation

- Manual PositivoDocument26 pagesManual Positivovalkira03Pas encore d'évaluation

- Trabajo Final AlgoritmoDocument17 pagesTrabajo Final AlgoritmoRichard Jorge Pacheco VidesPas encore d'évaluation

- Taller 4. Tratamiento Del RiesgoDocument2 pagesTaller 4. Tratamiento Del RiesgoNonePas encore d'évaluation

- Enrutamiento Estatico y DinamicoDocument43 pagesEnrutamiento Estatico y DinamicoHerlan 2004Pas encore d'évaluation

- Capa Aplicacion Tcp/ipDocument18 pagesCapa Aplicacion Tcp/ipEmmanuel VélezPas encore d'évaluation

- Instalación y uso básico de MininetDocument29 pagesInstalación y uso básico de MininetjavierPas encore d'évaluation

- Taller Desarrollo SotfwareDocument5 pagesTaller Desarrollo SotfwaremeigkPas encore d'évaluation

- Clase 2Document7 pagesClase 2johnsergioPas encore d'évaluation

- BIM Training Manual ESPDocument56 pagesBIM Training Manual ESPriquelmePas encore d'évaluation

- Admin OpenStackDocument136 pagesAdmin OpenStackflamenquitoPas encore d'évaluation

- Modulo 3 - InternetDocument12 pagesModulo 3 - InternetSilvana Kiara BustosPas encore d'évaluation

- Redes WindowsDocument55 pagesRedes WindowsEnrique Bueno Carbonell100% (1)

- Algoritmos para calcular intereses, descuentos, funciones y sumas de dígitosDocument2 pagesAlgoritmos para calcular intereses, descuentos, funciones y sumas de dígitosLaudy MendivelsoPas encore d'évaluation

- Programa Curso Practico Sap2000 v17 Modulo IDocument4 pagesPrograma Curso Practico Sap2000 v17 Modulo IDiego VillaPas encore d'évaluation

- Instructivo Definitivo de Microsoft WordDocument46 pagesInstructivo Definitivo de Microsoft WordRichard Bosstyck Olmedo QuispePas encore d'évaluation

- Trabajo Practico 2 - Redes PDFDocument7 pagesTrabajo Practico 2 - Redes PDFGaston OrtizPas encore d'évaluation

- MORLEY MorleyIAS 2011 ConvencionalDocument18 pagesMORLEY MorleyIAS 2011 ConvencionalErnesto MarinPas encore d'évaluation

- Compilacion de Preguntas Seguridad InformaticaDocument45 pagesCompilacion de Preguntas Seguridad Informatica25hbaamPas encore d'évaluation

- Nccu-246 Formato Alumno Trabajo FinalDocument5 pagesNccu-246 Formato Alumno Trabajo FinalJpeti MT40% (5)

- ICSP Microcontroladores PICDocument5 pagesICSP Microcontroladores PICMini G. NoizePas encore d'évaluation

- Directv 110668487Document3 pagesDirectv 110668487Migue Jr.Pas encore d'évaluation

- Actividades para ClassroomDocument7 pagesActividades para ClassroomJulio César Ramírez LeyvaPas encore d'évaluation

- Caracteristicas Laptop DellDocument5 pagesCaracteristicas Laptop DellLeonel ForaPas encore d'évaluation