Académique Documents

Professionnel Documents

Culture Documents

Cours 3 4 5 6

Transféré par

Amine MezzyaneTitre original

Copyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

Cours 3 4 5 6

Transféré par

Amine MezzyaneDroits d'auteur :

Formats disponibles

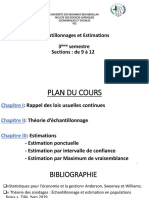

Cours de Biostatistiques 1

Marguerite Zani (Universite Paris-Est Creteil)

Laurent Mazet (CNRS)

13 et 14 septembre 2010

IV-1 Variables aleatoires : denition

Denition : Soit (, F, P) un espace probabilise et E = R, N, Z, , on

appelle variable aleatoire une application X : E telle que

X

1

(I ) F (I est un intervalle de R, un ensemble ni de N ou de Z).

Exemple elementaire : la fonction indicatrice : 1l

A

: {0, 1}, avec

A F :

1l

A

() =

_

1 si A

0 si / A

A

1

0

IV-2 Loi dune variable aleatoire :

Une variable aleatoire : X : (, F, P) (E, E, P

X

) transporte la mesure

P en une mesure image P

X

qui est la loi de la variable X : pour tout

A E,

P

X

(A) = P(X A) = P({; X() A}) .

Il existe deux grands types de lois : les lois discr`etes et les lois continues.

Une variable aleatoire peut etre discr`ete ou continue, ou un melange des

deux.

Variables aleatoires discr`etes

il sagit de variables `a valeurs dans un ensemble ni ou inni

denombrable {x

1

, x

n

, } = {x

k

, k K} et K denombrable. La

loi est alors denie par les nombres P(X = x

k

).

On a alors

kK

P(X = x

k

) = 1 .

Pour A {x

k

, k K},

P

X

(A) =

x

k

A

P(X = x

k

) .

Exercice

On consid`ere une population composee de 60 hommes et 40 femmes,

dans laquelle on choisit au hasard un groupe de 5 individus (choisis en

une fois, sans ordre). Quelle est la probabilite quil y ait 2 hommes dans

ce groupe ? Quil y ait plus de femmes que dhommes ?

Modelisation : lespace des issues est

= {{I

1

, I

2

, I

3

, I

4

, I

5

}, I

k

: individu F (femme) ou H (homme)}

Par exemple {H

24

, F

4

, F

32

, H

15

, H

49

} et Card = C

5

100

=

_

100

5

_

Rappel :

C

k

n

=

_

n

k

_

=

n!

k!(n k)!

.

Attention : bien noter quavec cette modelisation, {H

24

, F

4

, F

32

, H

15

, H

49

}

et {F

4

, F

32

, H

15

, H

24

, H

49

} representent le meme evenement elementaire.

Pour tout , on note X() la variable aleatoire correspondant au

nombre dhommes dans . Il est clair que X {0, 1, , 5}.

P(X = 2) =

_

60

2

__

40

3

_

_

100

5

_

0, 23 .

et

P(X 2) = P(X = 0) + P(X = 1) + P(X = 2)

=

_

40

5

_

+

_

60

1

__

40

4

_

+

_

60

2

__

40

3

_

_

100

5

_

0, 31 .

Variables aleatoires continues

Soit X une variable aleatoire reelle continue (E = R). Donner la loi

de X revient `a determiner la densite de probabilite, cest `a dire la

fonction f

X

telle que P(X [x, x + dx[) = f

X

(x)dx. La densite est

une fonction positive telle que

_

E

f

X

(x)dx = 1 .

Si A = [a, b] un intervalle de R, P

X

(A) =

_

b

a

f

X

(x)dx

IV-3 Independance de deux variables aleatoires :

Denition : Deux variables aleatoires X et Y denies de (, F, P) dans

(E, E) sont independantes si pour tous A et B de E,

P(X A Y B) = P(X A)P(Y B) .

Proposition

Soient X et Y deux variables aleatoires independantes et f et g deux

fonctions continues, alors f (X) et g(Y) sont independantes.

Remarque : la denition de lindependance de deux variables aleatoires

implique que la loi dun couple est le produit des lois : on peut reecrire

lidentite de la denition ci-dessus comme ci-dessous

P

(X,Y)

(A B) = P

X

(A)P

Y

(B)

Pour deux variables continues reelles X et Y independantes, la densite du

produit est le produit des densites :

f

(X,Y)

(x, y) = f

X

(x)f

Y

(y) .

Cette propriete est particuli`erement utile dans letude de lois

dechantillons (voir le paragraphe sur lestimation).

IV-4 Variables aleatoires usuelles

1) Variable de Bernoulli : X suit une loi de Bernoulli de param`etre

p [0, 1], on note X B(p), si

X {0, 1} avec P(X = 1) = p et P(X = 0) = 1 p.

Typiquement, X est la loi associee au resultat dune experience aleatoire

lorsque lon attribue 1 pour un succ`es et 0 pour un echec.

Exemple : dans le cadre dune campagne deradication de la poliomyelite

en Afghanistan, lUnicef a procede `a des vaccinations massives des

enfants, organisees sur plusieurs journees. Ainsi, en septembre 2009, seuls

5% des enfants de la region du sud avaient ete oubliespar ces soins.

Supposons que lon examine un enfant de cette region, et que lon veuille

savoir sil est vaccine ou non. On notera X = 1 si lenfant est vaccine, et

X = 0 sinon. La loi de X est une loi de Bernoulli de param`etre 0, 95 :

P(X = 1) = 0, 95 et P(X = 0) = 0, 05.

2) Variable Bin^omiale : X suit une loi binomiale de param`etres (n, p)

dans N

[0, 1], on note X B(n, p), si

X est `a valeurs dans {0, 1, , n}, et pour tout k {0, 1, , n},

P(X = k) = C

k

n

p

k

(1 p)

nk

=

_

n

k

_

p

k

(1 p)

nk

.

Typiquement X est le nombre de succ`es sur n experiences aleatoires

independantes.

On peut construire une binomiale comme une somme de variables de

Bernoulli independantes : soient Y

1

, Y

n

des v.a. independantes de loi

de Bernoulli de param`etre p, alors X =

n

i =1

Y

i

represente le nombre de

succ`es et cest une variable aleatoire binomiale de param`etres (n, p).

Exemple :

Le diab`ete neonatal insulino-dependant concerne un nouveau-ne sur

400000 en France. Dans une population de 50 nouveau-nes, quelle est la

loi du nombre de bebes diabetiques ?

On note X le nombre de nouveau-nes diabetiques, et Y

i

= 1 si lenfant

numero i a le diab`ete, Y

i

= 0 sinon. On a alors

X =

50

i =1

Y

i

et chaque Y

i

suit une loi de Bernoulli de param`etre 1/400000. On

consid`ere que les variables Y

i

sont independantes, car chaque enfant a ou

non du diab`ete independamment des autres. Ainsi X suit une loi

binomiale B(50, 1/400000).

3) Variable geometrique : on dit que X suit une loi geometrique de

param`etre p > 0, on note X G(p), si

X est `a valeurs dans N

et si pour tout k N

on a

P(X = k) = (1 p)

k1

p.

Typiquement, X est le nombre dexperiences aleatoires `a eectuer avant

davoir un premier succ`es ( levenement X = k signie que lon a obtenu

un succ`es `a la k-i`eme tentative apr`es k 1 echecs successifs).

4) Variable de Poisson : on dit que X est une v.a. de Poisson de

param`etre > 0 si

X est `a valeurs dans N et si pour tout k N, P(X = k) =

k

k!

e

.

La loi de Poisson est couramment utilisee pour modeliser des

phenom`enes rares. Pour illustrer cela, nous allons montrer que lorsque

lon somme beaucoup de variables de Bernoulli de tr`es petit param`etre

(probabilite doccurence rare), on obtient une loi de Poisson.

Convergence dune loi bin omiale vers une loi de Poisson

Soit X une v.a. de loi binomiale B(n, p) en supposant n grand et p petit

avec np = . Alors

P(X = k) =

_

n

k

__

n

_

k

_

1

n

_

nk

=

n!

k!(n k)!

k

n

k

_

1

n

_

k

_

1

n

_

n

=

n(n 1) (n k + 1)

n

k

k

k!

_

1

n

_

k

_

1

n

_

n

On modelise n grand en supposant n +, on a alors :

lim

n+

n(n 1) (n k + 1)

n

k

= lim

n+

n

n

n 1

n

n k + 1

n

= 1

lim

n+

_

1

n

_

k

= 1

lim

n+

_

1

n

_

n

= lim

n+

exp

_

n log(1

n

)

_

= e

.

Ainsi

P(X = k)

k

k!

e

,

qui est une loi de Poisson de param`etre .

5) Variable aleatoire uniforme : X est une variable aleatoire

uniforme sur [a, b], on note X U[a, b], si

elle a pour densite f

X

(x) =

1

b a

1l

[a,b]

.

1/2

6 2 1

1/4

X U[2, 6] : f

X

(x) =

1

4

1l

[2,6]

.

6) Variable aleatoire exponentielle : X est une variable aleatoire

exponentielle de param`etre , on note X E(), si

X a pour densite f

X

(x) = e

x

1l

x0

.

X E(2) : f

X

(x) = 2e

2x

1l

x0

.

7) Variable aleatoire gaussienne : X suit une loi gaussienne (ou

normale) de param`etres m ( moyenne) et

2

( variance), on note

X N(m,

2

), si

X a pour densite f

X

(x) =

1

2

2

e

(xm)

2

/2

2

.

La loi gaussienne est une loi naturelle , elle sert `a modeliser les bruits

autour dune valeur moyenne donnee. Par exemple pour modeliser la

taille dun ensemble dindividus donnes, on peut considerer le mod`ele

gaussien en supposant que la taille moyenne est m et lecart type `a la

moyenne . La justication de ce choix de loi est donnee par le theor`eme

central limite (voir ci-apr`es) qui etablit que les uctuations dun caract`ere

donne sur une population suivent une loi gaussienne lorsque la population

est grande.

Graphes : meme moyenne (m = 0) et variances dierentes

-5 -4 -3 -2 -1 0 1 2 3 4 5

-3

-2

-1

1

2

3

2

= 1 <

2

=

1

4

<

2

=

1

40

Graphes : meme variance (

2

=

1

20

) et moyennes dierentes

-5 -4 -3 -2 -1 0 1 2 3 4 5

-3

-2

-1

1

2

3

m = 0 < m = 2

IV-5 Caracteristiques dune variable aleatoire

Caracteristique de position : Esperance ou moyenne

Denition : Soit X une variable aleatoire, on denit lesperance

mathematique de X (lorsque quelle existe) de la fa con suivante :

Si X est une v.a. discr`ete `a valeurs dans {x

k

, k K denombrable}

alors

E(X) =

kK

x

k

P(X = x

k

) .

Si X est une v.a. continue reelle de loi de densite f

X

alors

E(X) =

_

R

xf

X

(x)dx .

Proposition

La fonction esperance est lineaire :

E(aX + bY) = aE(X) + bE(Y) .

Pour des variables discr`etes X et Y `a valeurs dans {x

k

, k 1} et

{y

p

, p 1} :

E(aX + bY) =

k,p

(ax

k

+ by

p

)P(X = x

k

Y = y

p

)

=

k

ax

k

p

P(X = x

k

Y = y

p

)

+

p

by

p

k

P(X = x

k

Y = y

p

)

=

k

ax

k

P(X = x

k

) +

p

by

p

P(Y = y

p

)

= a

k

x

k

P(X = x

k

) + b

p

y

p

P(Y = y

p

) = aE(X) + bE(Y) .

Pour des variables continues `a valeurs dans R, X et Y de densites f

X

et

f

Y

,

E(aX + bY) =

_

RR

(ax + by)f

(X,Y)

(x, y)dxdy

=

_

RR

axf

(X,Y)

(x, y)dxdy +

_

RR

byf

(X,Y)

(x, y)dxdy

=

_

R

ax(

_

R

f

(X,Y)

(x, y)dy)dx +

_

R

by(

_

R

f

(X,Y)

(x, y)dx)dy

= a

_

R

xf

X

(x)dx + b

_

R

yf

Y

(y)dy

= aE(X) + bE(Y) .

Remarque : on a utilise le fait que lorsque lon connait la densite f

(X,Y)

dun couple de variables aleatoires (X, Y), que lon peut voir comme une

variable `a valeurs dans R

2

, alors la densite de X est donnee par

lintegrale de f

(X,Y)

par rapport `a y :

f

X

(x) =

_

R

f

(X,Y)

(x, y)dy .

On a une formule analogue pour f

Y

. On dit que les lois de X et Y sont

les lois marginales du couple (X, Y).

Formule de transfert

Soit X une variable aleatoire et f une fonction continue. On pose

Z = f (X). Z est alors une variable aleatoire.

Si X est une variable aleatoire discr`ete, Z est aussi une variable

aleatoire discr`ete et

E(Z) = E(f (X)) =

h

z

h

P(Z = z

h

) =

k

f (x

k

)P(X = x

k

) .

Si X est une variable aleatoire continue, Z est aussi une variable

aleatoire continue et

E(Z) = E(f (X)) =

_

R

zf

Z

(z)dz =

_

R

f (x)f

X

(x)dx .

Exemples

X B(n, p) :

E(log(1+X)) =

n

k=0

log(1+k)P(X = k) =

n

k=0

log(1+k)

_

n

k

_

p

k

(1p)

nk

.

X N(0, 1)

E(X

2

1) =

_

+

(x

2

1)f

X

(x)dx

=

_

+

(x

2

1)e

x

2

/2

dx

2

=

_

+

x

2

e

x

2

/2

dx

_

+

e

x

2

/2

dx

2

= 1 1

= 0 .

Proposition

Soient X et Y deux variables aleatoires independantes. Pour toute

fonctions f et g continues,

E[f (X)g(Y)] = E[f (X)]E[g(Y)]

Si X et Y sont deux variables aleatoires independantes :

E(XY) = E(X)E(Y)

Mediane :

Dans le cas dune variable aleatoire X presentant des valeurs extr`emes, il

arrive que la moyenne ne donne pas un ordre de grandeur interessant

pour letude, elle decale vers les grandes valeurs ou les petites valeurs de

X. On a alors recours `a la mediane, qui est la valeur qui separe

lensemble des valeurs de X en deux ensemble egaux en probabilite :

Denition : On dit quune variable aleatoire reelle X a pour mediane m si

P(X m) = P(X m) =

1

2

.

Caracteristique de dispersion : Variance

Lesperance est la valeur moyenne de la v.a. X cest `a dire la valeur la

plus probable en tenant compte des ponderations apportees par les

probabilites que X vaille une valeur ou une autre. Pour mesurer comment

la variable se repartit autour de sa moyenne, on mesure lecart entre la

moyenne et les dierentes valeurs prises par la v.a., pondere par les

probabilites associees `a ces valeurs.

Denition : Soit X une variable aleatoire, on denit la variance de X

(lorsquelle existe) par la quantite suivante :

VarX = E[(X E(X))

2

] = E(X

2

) E(X)

2

La racine carree de la variance sappelle ecart-type.

Si X est une v.a. discr`ete `a valeurs dans {x

k

, k K denombrable}

VarX = E[(X E(X))

2

] =

kK

(x

k

E(X))

2

P(X = x

k

) .

Si X est une v.a. continue reelle de loi de densite f

X

alors

VarX = E[(X E(X))

2

] =

_

R

(x E(X))

2

f

X

(x)dx .

Proposition

La variance est quadratique

Preuve :

Var(aX + b) = E[(aX + b E(aX + b))

2

] = E[(aX + b aE(X) b)

2

]

= E[a

2

(X E(x))

2

]

= a

2

E[(X E(X))

2

]

= a

2

Var(X) .

Remarque : pour calculer Var(X + Y) nous avons besoin de connatre

E(XY).

Covariance :

La variance est un cas particulier de la covariance entre deux variables

aleatoires :

Denition : Soient X et Y deux variables aleatoires, on denit la

covariance de X et Y par

cov(X, Y) = E

_

(X E(X))(Y E(Y)

_

= E(XY) E(X)E(Y) .

Proposition

Si X et Y sont deux variables aleatoires reelles independantes, alors

cov(X, Y) = 0. La reciproque est fausse.

En eet, si X et Y sont independantes,

cov(X, Y) = E(XY) E(X)E(Y) = E(X)E(Y) E(X)E(Y) = 0 .

La reciproque est fausse :

Soit X une variable de loi uniforme sur [1, 1], et Y = X

2

. Il est clair

que X et Y ne sont pas independantes puisque lune secrit en fonction

de lautre. Montrons que cependant la covariance est nulle : on a

f

X

(x) =

1

2

1l

[1,1]

(x). On calcule

E(X) =

_

1

1

x

dx

2

= 0

car on int`egre une fonction impaire sur un intervalle symetrique. Par

ailleurs,

cov(X, Y) = E(XY) E(X)E(Y) = E(XY) = E(X

3

) =

_

1

1

x

3

dx

2

= 0

car la fonction x

3

est impaire et on int`egre sur un intervalle symetrique.

Si X et Y sont deux v.a. independantes

Var(X + Y) = Var(X) + Var(Y) .

Preuve : On developpe

Var(X + Y) = E[(X + Y E(X + Y))

2

]

= E[(X + Y)

2

] E(X + Y)

2

= E[X

2

+ 2XY + Y

2

] (E(X) + E(Y))

2

= E(X

2

) + 2E(XY) + E(Y

2

) E(X)

2

2E(X)E(Y) E(Y)

2

= E(X

2

) E(X)

2

+ E(Y

2

) E(Y)

2

+ 2E(XY) 2E(X)E(Y)

= Var(X) + Var(Y) .

Sommes de variables aleatoires

Proposition

La somme de deux variables de Poisson independantes est une variable de

Poisson. De plus le param`etre de la somme est la somme des param`etres.

Preuve : soient X de loi P() et Y de loi P(), alors X + Y est `a

valeurs dans N et pour tout k N,

P(X + Y = k) =

k

p=0

P(X = p Y = k p) =

k

p=0

p

p!

e

kp

(k p)!

e

=

e

(+)

k!

k

p=0

_

k

p

_

kp

=

( +)

k

k!

e

(+)

.

Donc X + Y suit une loi de Poisson de param`etre +.

Rappel : on a utilise le binome de Newton :

k

p=0

_

k

p

_

a

p

b

kp

= (a + b)

k

.

Proposition

La somme de deux variables gaussiennes independantes est une variabl

gaussienne

Preuve : voir plus loin, transformation de Laplace.

Calculs desperances et de variances

Loi de Bernoulli : si X B(p), alors

E(X) = p et Var(X) = p(1 p)

En eet

E(X) = 0 P(X = 0) + 1 P(X = 1) = 0 (1 p) + 1 p = p

Var(X) = E(X

2

)E(X)

2

= 0

2

P(X = 0)+1

2

P(X = 1)p

2

= pp

2

= p(1p) .

Loi Bin^omiale : si X B(n, p), alors

E(X) = np et Var(X) = np(1 p)

En eet, on ecrit X comme une somme de Bernoulli Y

i

B(p) independantes

X =

P

n

i =1

Y

i

. Par les proprietes ci-dessus de linearite de lesperance et de

somme de variables independantes on a :

E(X) = E(Y

1

) + + E(Y

n

) = n E(Y

1

) = np .

Var(X) = Var(Y

1

) + + Var(Y

n

) = n Var(Y

1

) = np(1 p) .

Loi de Poisson : si X P(), alors

E(X) = et Var(X) =

En eet :

E(X) =

+

k=0

kP(X = k) =

+

k=0

k

k

k!

e

= e

k=0

k

k

k!

= e

= .

Pour calculer Var(X) = E(X

2

) E(X)

2

, il sut de calculer E(X

2

) :

E(X

2

) =

+

k=0

k

2

P(X = k) =

+

k=0

k

2

k

k!

e

= e

k=0

k

2

k

k!

= e

(

2

+)e

=

2

+.

Loi gaussienne : si X N(m,

2

), alors

E(X) = m et Var(X) =

2

.

En eet

E(X) =

_

+

xf

X

(x)dx =

_

+

xe

(xm)

2

/2

2 dx

2

2

=

_

+

(u + m)e

u

2

2

du

2

=

2

_

+

ue

u

2

2

du +

m

2

_

+

u

2

2

du

=

2

0 +

m

2 = m

(changement de variable u =

xm

, les bornes de lintegrale sont

inchangees)

Pour calculer la variance, il sut de connatre E(X

2

) :

E(X

2

) =

_

+

x

2

f

X

(x)dx =

_

+

x

2

e

(xm)

2

/2

2 dx

2

2

=

_

+

(u + m)

2

e

u

2

2

du

2

=

2

2

_

+

u

2

e

u

2

2

du +

2m

2

_

+

ue

u

2

2

du +

m

2

2

_

+

u

2

2

du

=

2

2 +

2m

2

0 +

m

2

2

=

2

+ m

2

Ainsi

Var X =

2

+ m

2

m

2

=

2

.

IV-6 Autres lois utiles en statistique

Loi du

2

: soient X

1

, X

k

des variables aleatoires independantes

et de meme loi normale centree reduite N(0, 1), alors

Y =

k

i =1

X

2

i

suit une loi dite du chi-deux `a k degres de liberte, on note

Y

2

(k).

Cest une variable aleatoire continue, positive, desperance k et de

variance 2k. Sa densite de probabilite est donnee pour x R

+

par

f

Y

(x) =

1

2

k

2

(

k

2

)

x

k

2

1

e

x/2

.

Loi de Student : soit Z une variable aleatoire de loi N(0, 1) et U

une variable aleatoire independante de Z, de loi

2

(k), alors on note

T =

Z

_

U/k

,

on dit que T suit une loi de Student `a k degres de liberte.

Lesperance de T nest pas denie si k = 1 et E(T) = 0 si k > 1.

La variance de T est innie si k 2 et Var(T) =

k

k2

si k > 2.

IV-7 Caracterisation dune loi

Denition : La fonction de repartition F

X

associee `a la variable aleatoire

reelle X est une fonction de R dans [0, 1] denie par

F

X

(t) = P(X t) .

Elle caracterise la loi de X.

Remarque : pour une variable discr`ete, cette fonction est en escalier, pour

une variables continue de densite f

X

,

F

X

(t) =

_

t

f

X

(x)dx .

Proposition

Toute fonction de repartition F

X

verie les proprietes suivantes

F

X

est croissante sur R

F

X

est continue `a droite en tout point et admet une limite `a gauche.

lim

t

F

X

(t) = 0, lim

t+

F

X

(t) = 1

Dans certains cas, on ne peut pas calculer F

X

explicitement. On utilise

alors des tables de lois statistiques.

Table de la loi normale centree reduite :

X N(0, 1), on calcule F

X

(z) = P(X z)

Table de la loi normale centree reduite : probabilites bilaterales

X N(0, 1), on calcule

= P(|X| > ) = P(X < ) + P(X > ) = 2(1 P(X ))

Table du

2

:

X

2

(k), on calcule F

X

(z) = P(X z)

Table de la loi de Student :

X suit une loi de Student `a k degres de liberte, on calcule

F

X

= P(X z)

Table de la loi de Student : probabilites bilaterales

X suit une loi de student `a k degre de liberte, on calcule

= P(|X| > ) = P(X < ) + P(X > ) = 2(1 P(X ))

Denition : La transformee de Laplace dune variables aleatoire X reelle

continue de densite f

X

est determinee par

E(e

tX

) =

_

+

e

tx

f

X

(x)dx .

Elle caracterise la loi de X.

Exemple : soit X N(m,

2

) calculons sa transformee de Laplace :

E(e

tX

) =

Z

+

e

tx

e

(xm)

2

/2

2 dx

2

2

=

Z

+

e

(x

2

2mx2

2

tx+m

2

)/2

2 dx

2

2

=

Z

+

h

x(m+

2

t)

4

t

2

2m

2

t

i

/2

2

dx

2

2

= e

(

4

t

2

+2m

2

t)/2

2

Z

+

x(m+

2

t)

2

/2

2

dx

2

2

= e

mt+(

2

t

2

)/2

.

Application : la somme de deux variables aleatoires independantes de loi

gaussienne est une loi gaussienne.

En eet, soit X N(m,

2

) et Y N(, v

2

) independantes, on calcule

E(e

t(X+Y)

) = E(e

tX+tY

)

= E(e

tX

)E(e

tY

)

= e

mt+(

2

t

2

)/2

e

t+(v

2

t

2

)/2

= e

(m+)t+(

2

+v

2

)t

2

/2

.

On trouve la transformee de Laplace dune loi gaussienne de moyenne

m + et de variance

2

+ v

2

.

La loi de la somme de deux v.a. gaussiennes independantes est donc une

loi gaussienne de moyenne la somme des moyennes et de variances la

sommes des variances.

V-1 Dierents modes de convergence

En statistique, on doit souvent traiter un grand nombre de valeurs ou de

donnees. Pour modeliser cela dans un cadre aleatoire, on se place alors

dans le cas asymptotique, cest `a dire en supposant que le nombre de

donnees est inni. On introduit pour cela certaines notions de

convergences aleatoires :

Denition : Soit une suite X

1

, X

2

, , X

n

, de variables aleatoires

reelles et X une variable aleatoire reelle, denies sur un meme espace

probabilise .

On dit que la suite (X

n

) converge en loi vers X si pour toute

fonction g continue bornee

lim

n+

E(g(X

n

)) = E(g(X)) .

Si les variables X

n

et X sont continues, la denition ci-dessous est

equivalente : t R,

lim

n+

F

X

n

(t) = F

X

(t) .

On dit que la suite X

n

converge en probabilite vers X si pour tout

> 0,

lim

n+

P(|X

n

X| > ) = 0 .

On dit que la suite X

n

converge presque s urement vers X si

P({ : lim

n+

X

n

() = X()}) = 1 .

Lien entre les dierents mode de convergence :

Convergence presque s ure = Convergence en probabilite

Convergence en probabilite vers une variables continue

= Convergence en loi

V-2 Theor`emes limites :

Theor`eme (Loi des grands nombres)

Soient (X

n

)

n

des variables aleatoires independantes et de meme loi avec

E(|X

1

|) < .

X

n

=

1

n

n

k=1

X

i

n

E(X

1

) presque s urement .

(la moyenne empirique converge presque s urement vers la moyenne

theorique E(X

1

)).

Theor`eme (Theor`eme central limite)

Soient (X

n

)

n

des variables aleatoires independantes et de meme loi telles

que E(X

2

1

) < . On note m = E(X

1

) et

2

= VarX

1

. Alors on a

n(X

n

m)

loi

n

N(0,

2

) .

Remarque : on peut obtenir une version faible de la loi des grands

nombres (convergence en probabilites et non pas presque s ure) en

utilisant une inegalite fondamentale en probabilite :

Proposition (Inegalites de Markov et Tchebyche)

Soit X une variable aleatoire reelle positive (P(X 0) = 1) telle que

E(X) < , alors on a pour tout t > 0

P(X > t)

E(X)

t

(Markov)

Soit X une variable aleatoire reelle telle que E(X

2

) < , alors on a

pour tout t > 0

P(|X E(X)| > t)

Var(X)

t

2

(Tchebyche)

Loi faible des grands nombres : soit X

1

, X

2

, , X

n

, une suite de

variables aleatoires independantes, de meme loi et telles que

Var (X

1

) < . On calcule alors

E(X

n

) =

1

n

E(X

1

+ +X

n

) =

1

n

[E(X

1

) + +E(X

n

)] =

1

n

nE(X

1

) = E(X

1

) .

et

Var(X

n

) =

1

n

2

Var(X

1

+ + X

n

) =

1

n

2

[Var(X

1

) + + Var(X

n

)]

=

1

n

2

nVar(X

1

) =

Var(X

1

)

n

En appliquant Tchebyche, pour tout > 0,

P(|X

n

E(X

1

)| > )

Var(X

n

)

2

Var(X

1

)

n

2

Il est clair que le terme de droite ci-dessus tend vers 0 quand n

donc X

n

tend en probabilite vers E(X

1

).

V-2 Application : intervalles de conance :

Dans cette derni`ere partie, nous evoquons une partie de la statistique

parametrique qui concerne les intervalles de conance. Au vu

dobservations x

1

, , x

n

, nous voulons deduire une information sur le

param`etre qui caracterise la loi sous-jacente de ces observations.

Denition : Soient X

1

, X

2

, , X

n

des variables aleatoires denies sur un

meme espace , independantes et de meme loi . Alors (X

1

, , X

n

) est

appele echantillon ( ou nechantillon) de loi . La loi du n-uplet lui

meme est le produit des lois : .

On fait alors la modelisation suivante : on suppose que les observations

(x

1

, , x

n

) sont une realisation de lechantillon (X

1

, , X

n

) de loi P

o` u est le param`etre `a estimer, cest `a dire pour un certain on a

(x

1

, , x

n

) = (X

1

(), , X

n

()). Nous detaillons par la suite deux

exemples de mod`eles : Bernoulli et loi Normale.

Echantillon de loi de Bernoulli

On suppose que lon dispose de n observations (x

1

, , x

n

) issues dun

echantillon (X

1

, X

n

) de loi de Bernoulli P

= B(), cest `a dire que

pour tout i , P(X

i

= 1) = , P(X

i

= 0) = 1 .

[0, 1] est le param`etre inconnu que lon cherche `a determiner ou

plutot estimer.

Exemple : on veut deteminer le nombre de fumeurs dans une population

donnee dindividus adultes (ex : salaries dune entreprise, personnel dune

universite, dun hopital, etc...). On observe n individus choisis au hasard

dans cette population, et on note x

i

= 1 si lindividu numero i est

fumeur, x

i

= 0 sinon. On suppose que les individus fument ou pas

independamment les uns des autres, et avec la meme probabilite `a

estimer.

Comment avoir une idee de la valeur de ?

La loi des grands nombres nous fournit un estimateur ponctuel : la

moyenne empirique X

n

tend presque s urement vers E(X

1

) = (on sait

que pour une variable de Bernoulli, lesperance est le param`etre).

On peut alors dire que pour tout , X

n

() = (x

1

+ + x

n

)/n fournit

une valeur pour avec une marge derreur que lon doit preciser. On peut

aussi simplement sinteresser `a un ordre de grandeur de , qui sera

donnee par un intervalle I

n

aleatoire, donc dependant des observations.

Comme pour une estimation ponctuelle, cette information doit

saccompagner dune majoration de lerreur faite en supposant dans

lintervalle aleatoire I

n

.

Intervalle de conance : majoration de lerreur avec linegalite de

Tchebyche

Dans le cas dun echantillon de loi de Bernoulli B(),

E(X

n

) = E(X

1

) = , Var(X

n

) =

Var(X

1

)

n

=

(1 )

n

.

On cherche un intervalle donne par lerreur en probabilite faite en

remplacant par X

n

:

dapr`es Tchebyche,

P

(|X

n

| > )

VarX

n

2

=

(1 )

n

2

On a pour tout [0, 1], (1 )

1

4

et

P

(|X

n

| > )

1

4n

2

.

Cette borne ne depend plus de .

On se xe une probablite derreur que lon souhaite atteindre.

Pour avoir P

(|X

n

| > ) , il sut davoir

1

4n

2

, cest `a dire

1

2

n

. Ainsi on a

P

(|X

n

| >

1

2

n

)

donc P

(|X

n

|

1

2

n

) 1

donc P

( [X

n

1

2

n

, X

n

+

1

2

n

]) 1

On note I

n

= [X

n

1

2

n

, X

n

+

1

2

n

] lintervalle de conance au niveau

1 .

Approche asymptotique :

On utilise le theor`eme central limite.

n(X

n

E(X

1

))

Var X

1

loi

n

N(0, 1) .

On veut controler

P

(|X

n

| > ) = P

_

|

n(X

n

)|

_

(1 )

>

n

_

(1 )

_

.

comme (1 ) 1/4,

(1)

2

n et

P

(|X

n

| > ) P

_

|

n(X

n

)|

_

(1 )

> 2

n

_

.

On consid`ere Y une variable aleatoire de loi N(0, 1) et sa fonction de

repartition. Le theor`eme centrale limite nous permet decrire :

P

_

|

n(X

n

)|

_

(1 )

> 2

n

_

P(|Y| > 2

n).

Or

P(|Y| > 2

n) =

_

2

2

e

x

2

/2

dx +

_

2

n

1

2

e

x

2

/2

dx

= 2(1 (2

n))

On note =

n et grace aux tables de loi, on determine

0

tel que

2(1 (2

0

)) = .

Dans ce cas,

I

n

= [X

n

n

, X

n

+

0

n

]

est un intervalle de conance asymptotique au niveau 1 .

Comparaison des deux methodes : application numerique pour n = 1000

et = 0, 05.

Avec linegalite de Tchebyche, on obtient un intervalle I

n

de longueur

0, 14.

Avec lapproximation par une loi normale,

0

= 1, 96/2 et la longueur de

lintervalle I

n

est 0, 06.

Rappel : Table de la loi normale centree reduite : probabilites bilaterales

Y N(0, 1)

= P(|X| > ) = P(X < ) + P(X > ) = 2(1 P(X ))

Echantillon de loi normale

On suppose que X

1

, X

n

sont des variables aleatoires independantes de

loi N(m,

2

), on a alors un echantillon gaussien.

Pour etablir un intervalle de conance, il faut determiner quel est la

param`etre `a estimer ( = m ou =

2

) et si lautre param`etre est connu

ou inconnu.

On veut estimer la moyenne = E(X

1

) en supposant que la variance

2

est connue. Alors Y =

n

X

n

N(0, 1) . On a alors

P

(|X

n

| > ) = P

(|Y| >

) ,

avec Y une variable N(0, 1).

En xant = 0, 05, on a un intervalle de conance au niveau 0, 95

[X

n

1, 96

n

, X

n

+ 1, 96

n

] .

On veut estimer = E(X

1

) en supposant que la variance

2

est

inconnue. On utilise alors la variance empirique

S

2

n

=

1

n 1

n

k=1

(X

k

X

n

)

2

,

Cest un estimateur sans biais de la variance, cest `a dire que

E(S

2

n

) =

2

. On a alors (theor`eme de Cochran)

n

X

n

S

n

T

o` u T est une loi de Student `a n 1 degres de liberte. On a alors

P

(|X

n

| > ) = P(|T| >

n

S

n

) .

Pour = 0, 05 et n = 5, on a un intervalle de conance au niveau

0, 95

[X

n

2, 776

S

n

n

, X

n

+ 2, 776

S

n

n

] .

Rappel : Table de la loi de Student : probabilites bilaterales

On veut estimer =

2

en supposant que la moyenne m est connue.

On pose alors

2

n

=

1

n

n

k=1

(X

k

m)

2

,

Alors (theor`eme de Cochran), on a

n

2

n

2

U

o` u U est une variable aleatoire de loi

2

`a n degres de liberte.

On cherche alors dans la table du

2

(n) des valeurs

1

et

2

(fractiles) telles que

P(

1

U

2

) = 1 .

On veut estimer =

2

en supposant que la moyenne m est

inconnue.

On utilise `a nouveau

S

2

n

=

1

n 1

n

k=1

(X

k

X

n

)

2

,

Alors (theor`eme de Cochran), on a

(n 1)

S

2

n

2

V

o` u V est une variable aleatoire de loi

2

`a n 1 degres de liberte.

On cherche alors dans la table du

2

(n 1) des valeurs

1

et

2

(fractiles) telles que

P(

1

U

2

) = 1 .

Vous aimerez peut-être aussi

- Corrigé Série #01Document17 pagesCorrigé Série #01Rayhane OUANANIPas encore d'évaluation

- Chapitre1 ReprésentationDocument61 pagesChapitre1 ReprésentationgharbiaPas encore d'évaluation

- Master Ingénierie Mathématique: 1 Er Année TD Sous R de StatistiqueDocument14 pagesMaster Ingénierie Mathématique: 1 Er Année TD Sous R de Statistiqueamel mansouriPas encore d'évaluation

- Chapitre 4 - L'Estimation StatistiqueDocument9 pagesChapitre 4 - L'Estimation StatistiqueGnamadio Yves Eugène SékongoPas encore d'évaluation

- Série-3-Estimation - CorrectionDocument8 pagesSérie-3-Estimation - CorrectionYousra MekerkebPas encore d'évaluation

- TD2009 Tables ProbabilitesDocument11 pagesTD2009 Tables ProbabilitesBadrane Taleb AliPas encore d'évaluation

- Méthode Ampère MétriqueDocument7 pagesMéthode Ampère Métriquekhadija rahmakallhPas encore d'évaluation

- Cours5 de RLMDocument36 pagesCours5 de RLMMohamedPas encore d'évaluation

- TD4 StatM1 TestsDocument4 pagesTD4 StatM1 TestsHans HermanPas encore d'évaluation

- Notion PDFDocument137 pagesNotion PDFouPas encore d'évaluation

- Labarere Jose p02Document26 pagesLabarere Jose p02youness.khalfaouiPas encore d'évaluation

- Loi NormaleDocument33 pagesLoi NormaleSalma SouhailePas encore d'évaluation

- EstimationDocument53 pagesEstimationIssam Najib100% (1)

- QCM Stat Math EAPDDocument7 pagesQCM Stat Math EAPDhounkanlinalphonse100% (1)

- Demarche EconometriqueDocument15 pagesDemarche Econometriquealla jean wilfried kouaméPas encore d'évaluation

- Rapport Test de Student PDFDocument7 pagesRapport Test de Student PDFYoussef El OualiPas encore d'évaluation

- Vecteurs GaussiensDocument8 pagesVecteurs Gaussiensstefj1208Pas encore d'évaluation

- TD ProbasDocument6 pagesTD ProbasRàchiid GöüäghöüPas encore d'évaluation

- Fiche FormulesDocument2 pagesFiche FormulesBen FofanaPas encore d'évaluation

- Chap 1Document31 pagesChap 1issam hakamPas encore d'évaluation

- Test D HypotheseDocument3 pagesTest D HypotheseCheikh Talla100% (2)

- Cours de Statistique Et EconometrieDocument118 pagesCours de Statistique Et EconometriesamisimoPas encore d'évaluation

- Cours Echantillonnage Et Estimation Partie1Document14 pagesCours Echantillonnage Et Estimation Partie1ChaimaaPas encore d'évaluation

- Probas Chapitre2Document26 pagesProbas Chapitre2hindPas encore d'évaluation

- Chapitre Lois Usuelles Continues 2021 - 2022Document42 pagesChapitre Lois Usuelles Continues 2021 - 2022Abdelkaber abdelkaberPas encore d'évaluation

- Lecon2 - Estimation StatistiqueDocument22 pagesLecon2 - Estimation StatistiqueMamadou TouréPas encore d'évaluation

- Devoir Stat MathsDocument3 pagesDevoir Stat MathsDomingo BenPas encore d'évaluation

- TD 6 Tests StatistiquesDocument3 pagesTD 6 Tests Statistiquescidadela25Pas encore d'évaluation

- Probastat Section7Document55 pagesProbastat Section7baudouinkankolongoPas encore d'évaluation