Académique Documents

Professionnel Documents

Culture Documents

Statistique Chapitre2 2

Transféré par

hajarjb47Copyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

Statistique Chapitre2 2

Transféré par

hajarjb47Droits d'auteur :

Formats disponibles

CHAPITRE 2

STATISTIQUE DESCRIPTIVE A DEUX DIMENSIONS

2.1 INTRODUCTION

Le but de la statistique descriptive à deux dimensions est de mettre en évidence les

relations qui existent entre deux séries d’observations considérées simultanément. Comme en

statistique descriptive à 1 dimension, trois aspects peuvent être envisagés :

• Elaboration de diagramme ou distributions de fréquences à deux dimensions;

• Représentations graphiques;

• Calcul des paramètres ou valeurs typiques (réduction des données).

2.2. Les distributions de fréquences

2.1.1. Série statistique double

Une série statistique double correspond à la suite de n couples de valeurs observées

correspondant à deux variables et n individus (observations). Les données sont rangées par

ordre croissant d’une des deux variables :

𝑥1 𝑥2 . . . 𝑥𝑖 … 𝑥𝑛

𝑦1 , 𝑦2 , . .. , 𝑦𝑖 , . .. 𝑦𝑛

Exemple 2.1 : tailles (x en cm) et poids (y en Kg) d’un groupe de dix individus

Individu 1 2 3 4 5 6 7 8 9 10

xi 157 160 160 165 167 167 170 178 182 185

yi 51.5 55.0 53.5 61.0 60.0 63.5 67.0 75.5 78.0 81.0

2.1.2. Les distributions de fréquences à deux dimensions

Une distribution de fréquence se présente sous la forme d’un tableau statistique à double

entrée, dont une ligne est réservée à chaque valeur xi de x et une colonne à chaque valeur yj de

y. Dans le cas des distributions groupées, les valeurs xi et yj représentent les points centraux des

classes, mais le plus souvent, on représente dans les lignes et/ou les colonnes du tableau, les

intervalles de classes.

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 19

y y1 y2 ... yj ... yq Totaux

x

x1 n11 n12 ... n1j ... n1q n1.

x2 n21 n22 ... n2j ... n2q n2.

. . . . . .

. . . . . .

. . . . . .

xi ni1 ni2 ... nij ... niq ni.

. . . . . .

. . . . . .

. . . . . .

xp np1 np2 ... npj ... npq np.

Totaux n.1 n.2 ... n.j ... n.q n

On définit ainsi à partir de ce tableau :

Les fréquences absolues 𝒏𝒊𝒋 :

Elles représentent, pour chaque cellule du tableau, le nombre de couples d’observations

(xi, yj)

Les fréquences relatives 𝒏′𝒊𝒋 :

nij' = nij / n

Les fréquences unitaires 𝒏′′ 𝒊𝒋

Quand les intervalles de classes ne sont pas constants, les fréquences sont calculées en

divisant la fréquence relative par les intervalles correspondants.

′′

"

𝑛𝑖𝑗

𝑛𝑖𝑗 =

Δ𝑥𝑖 Δ𝑦𝑗

Les fréquences marginales :

Les fréquences marginales sont obtenues en calculant les totaux relatifs aux différentes

lignes ou aux différentes colonnes.

q p

ni. = nij et n. j = nij

j =1 i =1

(Le point remplace l’indice suivant lequel on a sommé).

p q p q

Avec : ni. = n. j = nij = n

i =1 j =1 i =1 j =1

La distribution marginale de x :

La distribution marginale de x est la distribution de fréquence à une dimension

constituée des valeurs xi et des fréquences marginales ni. correspondantes.

La distribution marginale de y :

De même pour y, la distribution marginale est constituée des valeurs yj et des fréquences

marginales n.j .

Les fréquences marginales relatives :

Elles sont définies par :

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 20

ni'. = ni. n et n.' j = n. j n

q p

ou ni'. = nij' , n.' j = nij'

j =1 i =1

p q p q

avec : ni'. = n.' j = nij' = 1

i =1 j =1 i =1 j =1

La distribution conditionnelle de x sous la condition y=yj

Si on ne considère qu’une colonne particulière du tableau à double entrée, on définit

par l’ensemble des valeurs xi et des fréquences correspondantes 𝑛𝑖𝑗 une distribution à une

dimension appelée distribution conditionnelle de x sous la condition y=yj. Il existe autant de

distributions conditionnelles de x que de valeurs ou de classes de y.

La distribution conditionnelle de y sous la condition x=xi

De même, si on ne considère qu’une ligne particulière du tableau à double entrée, , on

définit par l’ensemble des valeurs yj et des fréquences correspondantes nij la distribution

conditionnelle de y sous la condition x=xi. Il existe également autant de distributions

conditionnelles de y que de valeurs ou de classes de x.

Les fréquences relatives conditionnelles de x sous la condition y= yj

Elles sont définies par :

nij nij' p

ni j =

'

= ' , avec ni' j = 1

n. j n. j i =1

Les fréquences relatives conditionnelles de y sous la condition x=xi

Elles sont définies par :

nij nij' q

nj i =

'

= ' , avec n 'j i = 1

ni. ni. j =1

Exemple 2.2. On a observé la distribution suivante relative aux poids et tailles de 300 individus.

Taille (y en cm) 150-159 160-169 170-179 180-189 190-199 Totaux

Poids (x en Kg)

40 - 49 2 1 3

50 - 59 7 8 4 2 21

60 - 69 5 15 22 7 1 50

70 - 79 2 12 63 19 5 101

80 - 89 7 28 32 12 79

90 - 99 2 10 20 7 39

100 - 109 1 4 2 7

Totaux 16 45 128 84 27 300

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 21

Distributions marginales:

Poids (x) ni. ni.’ taille (y) n.j n.j’

40 - 49 3 0.010 150-159 16 0.053

50 - 59 21 0.070 160-169 45 0.150

60 - 69 50 0.167 170-179 128 0.427

70 - 79 101 0.337 180-189 84 0.280

80 - 89 79 0.263 1901-99 27 0.090

90 - 99 39 0.130 Totaux 300 1

100 - 109 7 0.023

Totaux 300 1

Distribution conditionnelle de x sous la condition y entre 170 et 179

Poids (x) ni/j=3 n’i/j=3

40 - 49

50 - 59 4 0.031

60 - 69 22 0.172

70 - 79 63 0.492

80 - 89 28 0.219

90 - 99 10 0.078

100 - 109 1 0.008

Totaux 128 1

Distribution conditionnelle de y sous la condition x entre 70 et 79 :

taille (y) nj/i=4 n’j/i=4

150-159 2 0.020

160-169 12 0.119

170-179 63 0.624

180-189 19 0.188

1901-99 5 0.049

Totaux 101 1

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 22

2.3. Les représentations graphiques

2.3.1. Diagrammes de dispersion

Les diagrammes de dispersion ou nuage de points sont obtenus en représentant chaque

couple d’observations (xi,yj) d’une série statistique double par un point dans un plan (x,y) (Fig.

2.1).

190

185

180

Taille en cm (y) 175

170

165

160

155

150

40 60 80 100

Poids en kg (x)

Fig. 2.1 Diagramme de dispersion pour les données de l’exemple 2.1

2.3.2. Diagrammes en bâtonnets

Les diagrammes en bâtonnets sont obtenus en traçant perpendiculairement au plan (x,y)

et en chaque point (xi,yj) un segment de droite de longueur égale à la fréquence nij ou n’ij. Ils

sont utilisés pour les distributions non groupées (Fig. 2.2).

25

20

15

10 0

5

4

0 3

0 2

1 1

2

3 0

4

5

6

Fig. 2.2 Diagramme en bâtonnets pour les données de l’exemple 2.3

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 23

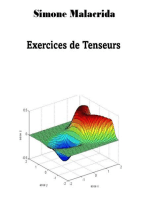

2.3.3. Les stéréogrammes

Ils sont composés de parallélépipèdes rectangles juxtaposés dont les bases sont les

cellules des tableaux à double entrée, et les hauteurs sont égales aux fréquences relatives ou

absolues. Ils sont utilisés pour les distributions groupées (Fig. 2.3).

70

60

50

40

30

20

199,5

10

189,5

179,5

0

169,5

49,5

59,5

69,5

159,5

79,5

89,5

99,5

109,5

Fig. 2.3 Stéréogramme pour les données de l’exemple 2.2

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 24

2.4. La réduction des données

2.4.1 Généralités

Les paramètres utilisés pour caractériser les séries statistiques doubles et les

distributions de fréquences à 2 dimensions sont de deux types. Les uns ne concernent qu’une

seule variable à la fois, les autres servent à décrire les relations existant entre les deux variables

considérées simultanément.

• Les paramètres ne concernent qu’une variable à la fois

Pour caractériser les distributions marginales et les distributions conditionnelles, on utilise

les paramètres habituels de la statistique descriptive à une dimension :

1 n 1 p

Moyennes marginales : x= xi

n i =1

ou ni . x i

n i =1

1 n 1 q

y= yi

n i =1

ou n. j y j

n j =1

1 n 1 p

Variances marginales : s = ( xi − x ) 2

2

x

n i =1

ou

n i =1

ni . ( x i − x ) 2

1 n 1 q

s y2 = ( yi − y ) 2

n i =1

ou

n j =1

n. j ( y j − y ) 2

p

1

Moyennes conditionnelles : x j ou x y =

n. j

n

i =1

ij xi

1 q

y i ou y x = nij y j

ni . j =1

p

1

Variances conditionnelles : s x2 / j ou s x2 / y =

n. j

n

i =1

ij ( xi − x j ) 2

q

1

s y2 / i ou s y2 / x =

ni .

nj =1

ij ( y j − yi ) 2

• La description des relations existant entre deux variables considérées simultanément fait

intervenir d’autres paramètres faisant l’objet des paragraphes suivants.

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 25

Exemple 2.3 : On a observé la distribution suivante relative au nombre de bovins (x) et au

nombre d’ouvriers salariés dans 225 exploitations agricoles d’un village donné.

Nb ouvriers (y) 0 1 2 3 4 Totaux

Nb de bovins (x) (ni.)

0 10 1 11

1 4 15 4 2 25

2 3 9 22 7 1 42

3 2 5 13 19 5 44

4 1 8 25 12 46

5 2 1 20 17 40

6 1 4 12 17

Totaux (n.j) 19 33 49 77 47 n=225

1 7

Moyennes marginales : x= ni. xi =3.23 bovins,

225 i =1

1 5

y= n. j y j =2.44 ouvriers,

225 j =1

1 7

Variances marginales : s x2 =

225 i =1

ni. ( xi − x ) 2 =2.61 bovins²,

1 5

s y2 = n. j ( y j − y ) 2 =1.47 ouvriers²,

225 j =1

1 7

Moyennes conditionnelles : x2 = nij xi =1.88 bovins,

n.2 i =1

1 5

y7 = nij y j =3.65 ouvriers,

n7 . j =1

1 7

Variances conditionnelles : s x2 / 2 =

n.2 i =1

nij ( xi − x j ) 2 =1.38 bovins²,

1 5

s y2 / 7 = nij ( y j − yi ) 2 =0.35 ouvriers².

n7. j =1

2.4.2 La covariance

a. Définition

La covariance entre deux séries d’observation x, y est définie par:

1 n

Séries statistiques : cov(x, y ) = ( xi − x )( yi − y )

n i =1

Formules de calcul :

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 26

1 n 1 n n

1 n 1 n SPE

cov(x, y ) =

n i =1

x y

i i − (

n i =1

x i )(

i =1

y i =

)

n i =1

xi yi − nx y )

=

n i =1

xi y i − x y =

n

1 n q

Distributions de fréquences : cov(x, y ) = ni ( xi − x )( y j − y )

n i =1 j =1 j

Formules de calcul :

1 p q 1 p q

1 p q

cov(x, y) = ij i j n x y − ( n i i

. x )( n. j j =

y ) nij xi y j −nx y

n i =1 j =1 n i =1 j =1 n i =1 j =1

p q

1 SPE

= ni j xi y j − x y =

n i =1 j =1 n

La covariance mesure le degré de dépendance ou de liaison entre les deux variables x

et y. Elle est positive si la relation entre les deux variables est croissante, elle est négative si la

relation entre les deux variables est décroissante.

Les valeurs observées supérieures ou inférieurs à x et à y apportent une contribution

positive à la covariance (les écarts par rapport aux moyennes étant du même signe), alors que

les valeurs observées supérieures à l’une des moyennes et inférieures à l’autre apportent une

contribution négative (les écarts par rapport aux moyennes étant de signes contraires) (Fig.

2.4).

190

185

- +

180

175

170

y

165

160

155 + -

150

40 50 60 x 70 80 90

Fig. 2.4 Contribution des valeurs observées au signe de la covariance

b. Propriétés

• La covariance est influencée par les changements d’unités, mais pas par les changements

d’origine :

si 𝑥’ = 𝑎 + 𝑏𝑥 et 𝑦’ = 𝑐 + 𝑑𝑦 alors 𝐶𝑜𝑣(𝑥’, 𝑦’) = 𝑏𝑑 𝐶𝑜𝑣(𝑥, 𝑦)

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 27

• La covariance est toujours en valeur absolue, inférieure ou égale au produit des écarts-types.

Cov ( x, y ) s x s y

1 7 5

Pour les données de l’exemple 2.3 : Cov(x,y)= ni xi y j − xy =1.44

225 i =1 j =1 j

2.4.3. Le coefficient de corrélation et le coefficient de détermination

a. Le coefficient de corrélation (r)

Le coefficient de corrélation est défini par :

Cov( x, y ) SPE

r= =

sx s y SCE x SCE y

Il mesure la netteté de la relation qui existe entre les deux variables, pour autant que

cette relation soit linéaire ou presque linéaire. Il possède le même signe que la covariance.

Propriétés

• r est compris entre -1 et +1 puisque Cov ( x, y ) s x s y

- r=1 si tous les points se trouvent sur une droite de coefficient angulaire positif ;

- r1 lorsque tous les points observés sont situés à proximité d’une telle droite;

- 0<r<1 lorsque le nuage de points est allongé parallèlement à une telle droite;

- r=0 lorsque le nuage de points est allongé parallèlement à l’un des axes de

coordonnées ou s’il a une forme arrondie ;

- -1<r<0 lorsque le nuage de points est allongé parallèlement à une droite de coefficient

angulaire négatif ;

- r-1 lorsque tous les points observés se trouvent à proximité d’une telle droite;

- r=-1 lorsque tous les points observés sont situés exactement sur une telle droite.

• r est indépendant de toute transformation linéaire :

si x’=a+bx et y’=c+dy (b,d>0) alors r(x’,y’) = r(x,y)

Cov( x, y ) 1.44

Pour les données de l’exemple 2.3 : r = = = 0.74

sx s y 1.62 *1.21

b. Le coefficient de détermination (r2)

Il est le carré du coefficient de corrélation :

Cov 2 ( x, y ) SPE 2

r2 = =

s x2 s y2 SCE x SCE y

Pour les données de l’exemple 2.3 : r2=0.54

Remarque :

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 28

La corrélation est différente de la causalité. L’existence d’une corrélation entre deux

variables ne veut pas, nécessairement, dire qu’il y a une relation de cause à effet entre les deux

variables. Il se peut que les deux variables soient soumises à des influences communes.

2.4.4 La régression linéaire au sens des moindres carrés

a. Le diagramme de régression de y en x

Le diagramme de régression de y en x est formé des points moyens conditionnels

( xi , y i ) (Fig. 2.5). Il donne une idée de la façon dont varie en moyenne la variable y en fonction

de la variable x. y est dite la variable dépendante et x est dite variable indépendante ou

explicative.

diagramme de régression

190

185

180

175

yi170

165

160

155

150

40 60 80 100

xi

Fig. 2.5 Diagramme de régression de y en x

b. La droite de régression de y en x

Lorsque le nuage de points ou le diagramme de régression ont une forme générale

linéaire ou approximativement linéaire, on peut rechercher l’équation d’une droite qui s’ajuste

au mieux aux valeurs observées. Cette droite est appelée droite de régression de y en x. Elle

est généralement déterminée par la méthode des moindres carrés. Elle est déterminée de

manière à rendre minimum la somme des carrés des écarts entre les points observés et les points

correspondante sur la droite.

Si l’équation de la droite est : y = a + bx

La somme des carrés des écarts à minimiser est :

n n

( yi − y( xi )) 2 = ( yi − a − bxi ) 2

i =1 i =1

Les xi et yi étant connus, alors le minimum peut être déterminé en dérivant par rapport à a et b,

et en annulant ces dérivées soit:

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 29

( yi − a − bxi ) 2 ( yi − a − bxi ) 2

= =0

a b

On obtient :

a = y − bx

Cov( x, y ) SPE

b= 2

=

sx SCE x

L’équation de la droite est donc :

y = b( x − x ) + y

a est l’ordonnée à l’origine

b (noté généralement byx)est appelé coefficient de régression de y en x.

c. La variance résiduelle et l’écart type résiduel

On appelle résidus de y par rapport x, les écarts entre les valeurs observées (yi)de la

variable dépendante et les valeurs correspondantes de la droite de régression (y(xi)):

di = yi-y(xi) = yi-a-bxi

La variance de ces résidus est la variance résiduelle :

1 n 1 p q

s 2

y. x = ( yi − y ( xi )) 2

n i =1

ou

n i =1 i =1

nij ( y j − y ( xi )) 2

La somme des carrés des résidus appelée somme des carrés des écarts résiduelle est la

quantité :

n p q

SCE y. x = ( yi − y ( xi )) 2 = ns 2 y. x

i =1

ou n

i =1 j =1

ij ( y j − y ( xi )) 2

l’écart-type résiduel est la racine carrée de s²y.x

La variance résiduelle est liée au coefficient de corrélation par la relation suivante:

Cov 2 ( x, y )

s y2. x = s y2 1 − = s y2 (1 − r 2 )

s 2 2

s

x y

On en déduit que :

0 s²y.x s²y

s²y.x = s²y si Cov(x,y)=0 ou r=0

s²y.x = 0 si Cov²(x,y)=s²xs²y ou r=1

s²y.x est un indice de la dispersion des points observés autour de la droite de régression de y en

x. La variance résiduelle est la partie de la variance de y inexpliquée par la régression de y en

x.

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 30

Cov 2 ( x, y ) Cov 2 ( x, y )

Comme s y2. x = s y2 − , alors la quantité est la partie de la

s x2 s x2

variance de y expliquée par la régression.

Cov 2 ( x, y ) 2

or r 2 = / s y est la part relative de la variance de y expliquée par la régression.

s2x

Donc, le coefficient de détermination exprimé en % représente le pourcentage de la variance

de y expliquée par la variable x.

Exemple 2.4. Pendant plusieurs années consécutives, on a observé le prix de vente moyen (en

Dh/Kg) d’un certain type d’aliment d’origine animale. Déterminez l’équation de régression

linéaire qui s’ajuste à ces données. Que pensez-vous de la qualité de l’ajustement ? A quel prix

doit-on s’attendre les deux années suivantes ?

Années (x) 2006 2007 2008 2009 2010 2011 2012 2013 2014 2015 2016 2017 2018 2019 2020

Prix (y) 50 51 55 54 60 58 63 66 69 67 70 75 76 78 81

Equation de régression y=a+bx

622

b= = 2.221

280

a=64.867-2.221*2010=-4400.20

Qualité de l’ajustement

r=0,989, r²=0,979

s y. x = 94.116 * (1 − 0.979 ) = 2.00

2

Prévision des prix

En l’an 2021 : yˆ = 82 .64 Dh

En l’an 2022 : yˆ = 84 .86 Dh

Exemple 2.5. Dans 15 échantillons de graisse de bovins, un chimiste a déterminé le PH et la

concentration en acide gras (en micro-moles par ml).

a. En fonction des résultats suivants, déterminer l’équation de régression linéaire qui

s’ajuste le mieux à ces données.

b. Mesurer la qualité de l’ajustement. Doit-on considérer que la liaison entre les deux

variables est linéaire ?

c. A quelle concentration en acides gras doit-on s’attendre dans deux échantillons qui

ont respectivement des PH de 5.8 et 7 ?

PH 5.3 5.3 5.4 5.6 5.6 5.7 6.0 6.0 6.2 6.3 6.4 6.4 6.6 6.6 6.8

Conc. 145 200 160 140 160 185 125 155 120 130 110 125 90 125 70

a. Conc = = -55,716PH + 471,04, b. r²=0.694; c. 147.89 et 81.03

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 31

Exemple 2.6. Un chercheur agronome réalise des essais en laboratoire sur la croissance d’une

plantule. Il observe la longueur de la plantule (y en cm) en fonction du temps (x en jours):

x en jours 1 2 4 6 10 15 20 30 40 50 60

y en cm 2.5 4.1 6.4 8.2 10.5 12.3 13.6 14.3 15.1 15.0 14.9

Le modèle de croissance qu’il souhaite ajuster à ces données est du type:

ax

y=

b+x

a. En fonction des résultats obtenus, estimez d’une manière approchée les paramètres du

modèle par la méthode des moindres carrés.

b. Que pensez-vous de ce modèle.

a. Linéarisation (Y=A+BX) ;

Y= X= A= B=

1/y 1/x 1/a b/a

a=1/A b=B/A

16.392 x

y=

5.672 + x

b. r² ~ 0.997

AJERAME M.M. IAV/DSIA Cours de statistique mathématique (Chapitre 2) 32

Vous aimerez peut-être aussi

- La Statistique Bidimensionnelle: 1) La Série Double À Doubles IndicesDocument20 pagesLa Statistique Bidimensionnelle: 1) La Série Double À Doubles IndicesTraore ZeinabPas encore d'évaluation

- Analyse de Donnée 2Document62 pagesAnalyse de Donnée 2Meryeme M'HouhPas encore d'évaluation

- Cours Statistique À Deux Variables19-20Document11 pagesCours Statistique À Deux Variables19-20c8gm9fz295Pas encore d'évaluation

- Cours Statistiques TS2-2Document4 pagesCours Statistiques TS2-2Bamba DiagnePas encore d'évaluation

- Analyse BivarieeDocument19 pagesAnalyse BivarieeKHAOULA ESSAKHIPas encore d'évaluation

- Data Science - Méthodes DescriptivesDocument110 pagesData Science - Méthodes Descriptivesnour elislemPas encore d'évaluation

- Biostat-Chapitre 2Document12 pagesBiostat-Chapitre 2ouadah inessazizaPas encore d'évaluation

- Analyse en Composantes PrincipalesDocument26 pagesAnalyse en Composantes PrincipalesdodoPas encore d'évaluation

- Chapitre1 ACPpppppDocument51 pagesChapitre1 ACPpppppRa NimPas encore d'évaluation

- Chapitre 2Document27 pagesChapitre 2malektimiaPas encore d'évaluation

- Série Statistique DoubleDocument11 pagesSérie Statistique DoubleSouha Lachachi100% (2)

- Stat Synth Se Listes Question Indicatives-2Document6 pagesStat Synth Se Listes Question Indicatives-2Thomas BastinPas encore d'évaluation

- Chap5 EtudiantDocument7 pagesChap5 Etudiantmichelakon1Pas encore d'évaluation

- Stastiques 4 Ieme 2018 BAC TOUS LES SECTOON 2018 2019Document18 pagesStastiques 4 Ieme 2018 BAC TOUS LES SECTOON 2018 2019عبد الحميدPas encore d'évaluation

- Stat Descriptive BivarieeDocument21 pagesStat Descriptive Bivarieekeito225Pas encore d'évaluation

- Cours Biostat Licence Et MasterDocument39 pagesCours Biostat Licence Et Masterfatmaamir878Pas encore d'évaluation

- Etude D'une Série Statistique À Double CaractèreDocument7 pagesEtude D'une Série Statistique À Double Caractère3ONSORY FFPas encore d'évaluation

- Polycop PST1Document22 pagesPolycop PST1Mrh MusPas encore d'évaluation

- Cours Statistiques InfDocument18 pagesCours Statistiques InfDimokrati HoussamPas encore d'évaluation

- CourS602 - 2013Document32 pagesCourS602 - 2013ChamseddineKarafiPas encore d'évaluation

- Screenshot 2023-11-11 at 22.35.35Document16 pagesScreenshot 2023-11-11 at 22.35.35gv9t4q52zyPas encore d'évaluation

- IntroductionDocument11 pagesIntroductionpochette t2L2Pas encore d'évaluation

- 818Document81 pages818Silviu100% (1)

- YAHI Parmètres de Dispersion Dec 2021Document3 pagesYAHI Parmètres de Dispersion Dec 2021mangaka 362Pas encore d'évaluation

- Analyse en Composante PrinicpaleDocument38 pagesAnalyse en Composante PrinicpaleOussama El GrandePas encore d'évaluation

- Cours RLMultipleDocument60 pagesCours RLMultiplesporara alio100% (2)

- Khi DeuxDocument11 pagesKhi DeuxOussama El MkhayarPas encore d'évaluation

- Bivariée Statistique TexDocument14 pagesBivariée Statistique TexTaleb WassimPas encore d'évaluation

- Cours Statistique Double Coordination MI (Corrigé) PDFDocument19 pagesCours Statistique Double Coordination MI (Corrigé) PDFBazizi WardiaPas encore d'évaluation

- Cours 1S StatistiquesDocument3 pagesCours 1S StatistiqueseliezagorPas encore d'évaluation

- Analyse Fréquentielle Pour CourDocument53 pagesAnalyse Fréquentielle Pour CouradamPas encore d'évaluation

- Cours Statistique Parametrique Chap 1Document14 pagesCours Statistique Parametrique Chap 1mahaseddiki2003Pas encore d'évaluation

- Cours SDFDocument32 pagesCours SDFAchraf MoutaharPas encore d'évaluation

- Statistiques d'IUT, BERNABOTTODocument33 pagesStatistiques d'IUT, BERNABOTTOelmorabit100% (1)

- Devoir 2019Document14 pagesDevoir 2019arsene-perelmanPas encore d'évaluation

- DECISION STATISTIQUeDocument23 pagesDECISION STATISTIQUeKim NewPas encore d'évaluation

- Méthodes ItérativesDocument10 pagesMéthodes ItérativesConnexion 96Pas encore d'évaluation

- Chapitre IIIDocument12 pagesChapitre IIImohamed lamine hamritPas encore d'évaluation

- Cochran 1Document10 pagesCochran 1onuciPas encore d'évaluation

- ArticlePieczinski EtautresDocument4 pagesArticlePieczinski Etautreslila oudjoudiPas encore d'évaluation

- Ch2 Descri Bidim MIPDocument27 pagesCh2 Descri Bidim MIPMeriem AIT AHMED OABDPas encore d'évaluation

- Devoir CorrigéDocument9 pagesDevoir Corrigéyousfihajar326Pas encore d'évaluation

- Concours Commun Polytechniques (CCINP) 2022 MP Mathématiques 2 EaDocument4 pagesConcours Commun Polytechniques (CCINP) 2022 MP Mathématiques 2 EaGhali El KhoulassaPas encore d'évaluation

- Balisage de ESTIMATEURDocument23 pagesBalisage de ESTIMATEUR123456789Pas encore d'évaluation

- Examen Corrige 01-2020Document6 pagesExamen Corrige 01-2020mido052011Pas encore d'évaluation

- 2 Moyenne, VarianceDocument6 pages2 Moyenne, VariancelvtmathPas encore d'évaluation

- Fiabilité Des Structures Et Analyse Du Risque: Prof. A. AldeaDocument26 pagesFiabilité Des Structures Et Analyse Du Risque: Prof. A. AldeaAchraf HwiwiPas encore d'évaluation

- Cours de StatistiquesDocument3 pagesCours de StatistiquesAbdessatar GouiderPas encore d'évaluation

- Epuchap 4Document4 pagesEpuchap 4Sidahmed LarbaouiPas encore d'évaluation

- Stastiques A Double Entrees Et Regression LineaireDocument6 pagesStastiques A Double Entrees Et Regression LineaireAbdel HakPas encore d'évaluation

- Résumé Du Cours 2Document5 pagesRésumé Du Cours 2hiPas encore d'évaluation

- Proba5 PDFDocument8 pagesProba5 PDFjrachek21490% (1)

- Chapitre - 03 Statistique Descriptive BivariéeDocument19 pagesChapitre - 03 Statistique Descriptive BivariéeFaculté De Médecine Béchar100% (3)

- Traitement-Du-Signal-Cours-04 PARTIE2Document30 pagesTraitement-Du-Signal-Cours-04 PARTIE2nouhaila.ingenieurPas encore d'évaluation

- Technique D'analyse Multidimensionnelle Des DonneesDocument114 pagesTechnique D'analyse Multidimensionnelle Des DonneesKhaled AmriPas encore d'évaluation

- Traitement Des Donnees m1 BC 2022-2023 AnovaDocument11 pagesTraitement Des Donnees m1 BC 2022-2023 AnovaCoquelicot Éphémère ÉphémèrePas encore d'évaluation

- Support Master 2Document38 pagesSupport Master 2ja natPas encore d'évaluation

- (Chapitre 2) Du Cous Proba-Stat 2021 S1Document52 pages(Chapitre 2) Du Cous Proba-Stat 2021 S1anesmeziane123Pas encore d'évaluation

- TP1 StatDesc RDocument4 pagesTP1 StatDesc RThiaré ModouPas encore d'évaluation

- CHAP2Document21 pagesCHAP2Khadim Seck0% (1)

- 39 Ms 2 EquadiffetweibullDocument4 pages39 Ms 2 EquadiffetweibullHamid BendjelloulPas encore d'évaluation

- ÉconométrieDocument24 pagesÉconométrieNicolas KiadivilaPas encore d'évaluation

- ADD CoursDocument15 pagesADD CoursRabir BabaPas encore d'évaluation

- CorrélationDocument18 pagesCorrélationAfaf SaddokPas encore d'évaluation

- Corrélation Des Résultats Des Essais Pressiométriques Et StatiquesDocument8 pagesCorrélation Des Résultats Des Essais Pressiométriques Et StatiquesCharles CousinPas encore d'évaluation

- En Vue de L'obtention Du Diplôme MasterDocument86 pagesEn Vue de L'obtention Du Diplôme MasterMenel BouzegzaPas encore d'évaluation

- Chapitre 3 - Distribution Statistique À Deux VariablesDocument24 pagesChapitre 3 - Distribution Statistique À Deux VariablesElbazzaz GhitaPas encore d'évaluation

- Exercices Supplementaires Tests RegressionDocument9 pagesExercices Supplementaires Tests RegressionAblayePas encore d'évaluation

- Conception D'une Plateforme Big Data-ML de Prédictions D'incidents Dans Un Smart GridDocument67 pagesConception D'une Plateforme Big Data-ML de Prédictions D'incidents Dans Un Smart GridMbaye Babacar MBODJPas encore d'évaluation

- Statistique-Non Paramétrique-et-Robustesse-Série Exercices N°2Document11 pagesStatistique-Non Paramétrique-et-Robustesse-Série Exercices N°2karlaugustt1230% (2)

- Apprentissage Supervisé - Introduction - vf23Document44 pagesApprentissage Supervisé - Introduction - vf23shi ftPas encore d'évaluation

- L'impact Du Système D'information Comptable Sur La Performance Financière Des Entreprises Algériennes.Document15 pagesL'impact Du Système D'information Comptable Sur La Performance Financière Des Entreprises Algériennes.L'auditeurJuniorPas encore d'évaluation

- Econometrie PDFDocument258 pagesEconometrie PDFcedricngassPas encore d'évaluation

- PR Mourad TOUNSI Chapitre 7 La Regression Stat'App ENCG OCT 2023Document19 pagesPR Mourad TOUNSI Chapitre 7 La Regression Stat'App ENCG OCT 2023فاطمة الزهراء حمانيPas encore d'évaluation

- 156083-Article Text-407342-1-10-20170516Document13 pages156083-Article Text-407342-1-10-20170516marcelina24Pas encore d'évaluation

- Concepts Et FormulesDocument31 pagesConcepts Et FormulesGarinne ChatPas encore d'évaluation

- Chapitre 1 Notions de Probabilité Et Analyse Statistique Appliquée À LhydrologieDocument5 pagesChapitre 1 Notions de Probabilité Et Analyse Statistique Appliquée À LhydrologieAzzedine GarahPas encore d'évaluation

- Econometrie PDFDocument23 pagesEconometrie PDFSaïfoulaye Zobon100% (1)

- Examen SC GMI 15 16Document3 pagesExamen SC GMI 15 16ayoub eljadidPas encore d'évaluation

- TP D18o DocsDocument2 pagesTP D18o DocsGrégory DelbecquesPas encore d'évaluation

- 1RLS PDFDocument2 pages1RLS PDFPPwmPas encore d'évaluation

- COURS D'ECONOMETRIE APPLIQUEE Master1 Gestion 2019-2020Document34 pagesCOURS D'ECONOMETRIE APPLIQUEE Master1 Gestion 2019-2020De Sales Boni100% (7)

- Modélisation StatistiqueDocument3 pagesModélisation StatistiqueHosni GholamiPas encore d'évaluation

- Chapitre 1 - Introduction à l'économétrieDocument72 pagesChapitre 1 - Introduction à l'économétrieJEAN OUMAR THIANEPas encore d'évaluation

- ECONOMETRIEDocument11 pagesECONOMETRIEZackaria JacoPas encore d'évaluation

- Méthodes Quantitatives de PrévisionDocument25 pagesMéthodes Quantitatives de Prévisionmike4shinoda100% (6)

- Examen de SpssDocument2 pagesExamen de SpssSueños Esperanza Sin CorazonPas encore d'évaluation

- Machine Learning - Chap1 - IntroductionDocument15 pagesMachine Learning - Chap1 - IntroductionBadiss JabouPas encore d'évaluation

- Ch2 Ajustement Et CorrélationDocument66 pagesCh2 Ajustement Et CorrélationAbubakr Sidik100% (1)