Académique Documents

Professionnel Documents

Culture Documents

1 Examen2011-2012

Transféré par

ilyes0 évaluation0% ont trouvé ce document utile (0 vote)

87 vues1 pageTitre original

1.examen2011-2012

Copyright

© © All Rights Reserved

Formats disponibles

PDF, TXT ou lisez en ligne sur Scribd

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

© All Rights Reserved

Formats disponibles

Téléchargez comme PDF, TXT ou lisez en ligne sur Scribd

0 évaluation0% ont trouvé ce document utile (0 vote)

87 vues1 page1 Examen2011-2012

Transféré par

ilyesDroits d'auteur :

© All Rights Reserved

Formats disponibles

Téléchargez comme PDF, TXT ou lisez en ligne sur Scribd

Vous êtes sur la page 1sur 1

Université Mohamed Khider-Biskra

Département d’informatique

Master IDM Fouille de Données Avancée

25 Jan 2012 12:00-13:30, Salle 6

Examen (documents autorisés)

Questions de cours (5 pts)

1. Proposer, avec une brève explication, trois applications de la fouille de données non vues

dans le cours.

2. Expliquer le problème de sur-apprentissage et comment le résoudre.

3. Expliquer le problème de la non séparabilité linéaire dans les machines à vecteurs supports

(SVM). Comment est-il résolu ? Quelle est l’utilité des noyaux ?

Exercice 1 Motifs fréquents (8 pts)

Soit la base de données transactionnelle suivante :

TID Items TID Items

T01 A, B, C, D T05 B, C, G

T02 A, C, D, F T06 D, F, G

T03 C, D, E, G, A T07 A, B, G

T04 A, D, F, B T08 C, D, F, G

En utilisant un support minimum de 25% et un minimum de confiance de 60%, trouver :

1. Les motifs fréquents maximaux (de taille maximale)

2. Les motifs fréquents fermés (qui ne sont sous ensemble d’aucun autre motif)

3. Les règles solides d’association.

Exercice 2 Arbres de décision (7 pts)

Soit les exemples suivants ayant trois attributs et appartenant à deux classes :

N˚ Att1 Att2 Att3 Classe N˚ Att1 Att2 Att3 Classe

1 A L T C1 8 B L T C1

2 A H T C2 9 B H F C1

3 A H F C2 10 C H T C2

4 A H F C2 11 C L T C2

5 A L F C1 12 C H F C1

6 B H T C1 13 C H F C1

7 B H F C1 14 C H F C1

En utilisant l’algorithme ID3 :

1. Calculer l’entropie de l’ensemble d’exemples par rapport à la valeur de la classe.

2. Construire l’arbre de décision appris de cette table.

FFF Bonne chance FFF

A.Djeffal

Vous aimerez peut-être aussi

- 1 Examen2011-2012 PDFDocument1 page1 Examen2011-2012 PDFilyesPas encore d'évaluation

- Ilovepdf MergedDocument99 pagesIlovepdf Mergedslim yaichPas encore d'évaluation

- Chapitre 1 Analyse de DonnéesDocument44 pagesChapitre 1 Analyse de Donnéescalabi mozartPas encore d'évaluation

- Règles D'associationDocument56 pagesRègles D'associationJaber YassinePas encore d'évaluation

- UP2 2 RDP Slides PDFDocument65 pagesUP2 2 RDP Slides PDFKarim Elyazami0% (1)

- Corrige Exam 2013Document2 pagesCorrige Exam 2013slim yaichPas encore d'évaluation

- AD Examen 0405Document4 pagesAD Examen 0405habiba rizkiPas encore d'évaluation

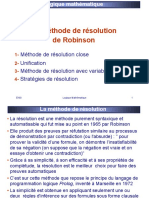

- Principe de Resolution de Robinson-CH4Document71 pagesPrincipe de Resolution de Robinson-CH4youssef ghaouiPas encore d'évaluation

- Polycopie SEP 2021-ConvertiDocument46 pagesPolycopie SEP 2021-ConvertiSoheibPas encore d'évaluation

- TD Machine Regression PythonDocument3 pagesTD Machine Regression Pythontest testPas encore d'évaluation

- 3 Examenfda2013 PDFDocument2 pages3 Examenfda2013 PDFilyesPas encore d'évaluation

- CoursIA 1Document32 pagesCoursIA 1Khlifi AssilPas encore d'évaluation

- Algorithmes Recherche Opérationnelle Et Théorie Des GraphesDocument23 pagesAlgorithmes Recherche Opérationnelle Et Théorie Des GraphesSfDPas encore d'évaluation

- TD dw1Document14 pagesTD dw1Arsene PendaPas encore d'évaluation

- Chapitre 4Document69 pagesChapitre 4Ramous RamousPas encore d'évaluation

- Les Classes Et Les Objets en Java Exercices CorrigésDocument1 pageLes Classes Et Les Objets en Java Exercices CorrigésSlimen Ben AmorPas encore d'évaluation

- Intelligence Artificielle Sujet 04Document2 pagesIntelligence Artificielle Sujet 04Faralahy UlrichPas encore d'évaluation

- CARTDocument13 pagesCARTSharif Aria Karimi100% (1)

- Interblocage PDFDocument5 pagesInterblocage PDFHmidaPas encore d'évaluation

- Architecture Parallèle TD: Université Alger 1 2022/2023 Faculté Des Sciences Département MI M2 RseDocument2 pagesArchitecture Parallèle TD: Université Alger 1 2022/2023 Faculté Des Sciences Département MI M2 RseYasmine ChihabPas encore d'évaluation

- Methode FormelleDocument22 pagesMethode Formellejoe kazengaPas encore d'évaluation

- Chapitre III - Analyse Des DonnéesDocument14 pagesChapitre III - Analyse Des Donnéesسهى نداريPas encore d'évaluation

- Travail Pour MASTERDocument8 pagesTravail Pour MASTERZarzouh ZarzouhPas encore d'évaluation

- Cours Mcda AnDocument21 pagesCours Mcda Anlokmandz100% (2)

- Chaines MarkovDocument12 pagesChaines Markovbob gorbiPas encore d'évaluation

- Session 1: Principes de L'analyse Factorielle en Composantes PrincipalesDocument13 pagesSession 1: Principes de L'analyse Factorielle en Composantes PrincipalesSanders100% (1)

- Naive Bayes ClassifierDocument35 pagesNaive Bayes ClassifiershimunoPas encore d'évaluation

- Crypto Examen Corrige PDFDocument4 pagesCrypto Examen Corrige PDFInsaf.mgassebPas encore d'évaluation

- ACP M2 Print PDFDocument32 pagesACP M2 Print PDFJunior Ebong Moudoubou100% (1)

- Securité Informatique ch3Document40 pagesSecurité Informatique ch3Rami RamiPas encore d'évaluation

- 1 - Les SI 2019-2020Document28 pages1 - Les SI 2019-2020Ķőőķie Šâm100% (1)

- Transp Files Attente PDFDocument45 pagesTransp Files Attente PDFAlaa Din AL-khwarizmiPas encore d'évaluation

- Corrigé TD 1 PST Usto 2020-21Document6 pagesCorrigé TD 1 PST Usto 2020-21mayar mimiPas encore d'évaluation

- CMTCDocument2 pagesCMTCyves1ndriPas encore d'évaluation

- Td4 HellmanDocument6 pagesTd4 HellmanqsdfghjklPas encore d'évaluation

- Chapitre 3 Système ExpertDocument62 pagesChapitre 3 Système ExpertSayed BenslimanePas encore d'évaluation

- Génie Logiciel Avancé Cours 4 - Conception - Stefano Zacchiroli PDFDocument83 pagesGénie Logiciel Avancé Cours 4 - Conception - Stefano Zacchiroli PDFEn Personne AlaeddinePas encore d'évaluation

- Corrige GL 2021Document2 pagesCorrige GL 2021PapiPas encore d'évaluation

- RDP ColoresDocument16 pagesRDP ColoresAlimi TaharPas encore d'évaluation

- TD1 MCD PDFDocument2 pagesTD1 MCD PDFSanaa JhPas encore d'évaluation

- JMCT MepsDocument17 pagesJMCT MepsMohamed Oualid100% (1)

- EMD SE 2021 SolutionDocument4 pagesEMD SE 2021 SolutionfatimaPas encore d'évaluation

- LASTDocument48 pagesLASTChaima BelhediPas encore d'évaluation

- Cours Language ZDocument417 pagesCours Language ZليوناردودافينشيPas encore d'évaluation

- Exercice Corrige en Algorithm PDFDocument34 pagesExercice Corrige en Algorithm PDFOussama Himmi0% (1)

- Chapitre 2 Définitions Et Classification Des Méthodes FormellesDocument38 pagesChapitre 2 Définitions Et Classification Des Méthodes FormellesKhedhri ChaymaPas encore d'évaluation

- TD1. Arbre CouvrantDocument2 pagesTD1. Arbre Couvrantsafe selmi100% (1)

- TP AcpDocument12 pagesTP AcpKhadija HoPas encore d'évaluation

- Rattrapage SolutionsDocument3 pagesRattrapage SolutionsAbdallahi SidiPas encore d'évaluation

- td1 CorrigéDocument3 pagestd1 CorrigéNahrawess SlamaPas encore d'évaluation

- Chapitre2 IA 2019Document53 pagesChapitre2 IA 2019Khalil KraiemPas encore d'évaluation

- Exercices MCPA PDFDocument44 pagesExercices MCPA PDFdoudi doudaPas encore d'évaluation

- TDN 3 - Traduction Dirig Ee Par La SyntaxeDocument3 pagesTDN 3 - Traduction Dirig Ee Par La SyntaxeJames OptimistePas encore d'évaluation

- Examen Theorique Passage Juin 2006Document3 pagesExamen Theorique Passage Juin 2006api-26420184100% (5)

- TD2 SAMP (Correction)Document11 pagesTD2 SAMP (Correction)Hă Fsă100% (1)

- TD2 PLDocument3 pagesTD2 PLYassminaPas encore d'évaluation

- Examen15 16Document2 pagesExamen15 16zaydPas encore d'évaluation

- Partie I Le Chiffrement SymétriqueDocument13 pagesPartie I Le Chiffrement SymétriqueBeldi MakremPas encore d'évaluation

- Exam Modeles Pour Le Datamining 2016 2017Document2 pagesExam Modeles Pour Le Datamining 2016 2017ilyesPas encore d'évaluation

- Exam Modeles Pour Le Datamining 2015 2016corDocument4 pagesExam Modeles Pour Le Datamining 2015 2016corilyesPas encore d'évaluation

- Exam Modeles Pour Le Datamining 2015 2016 RattrapageDocument1 pageExam Modeles Pour Le Datamining 2015 2016 RattrapageilyesPas encore d'évaluation

- Exam Modeles Pour Le Datamining 2015 2016 RattrapageCorDocument5 pagesExam Modeles Pour Le Datamining 2015 2016 RattrapageCorilyesPas encore d'évaluation

- Exam Modeles Pour Le Datamining 2015 2016Document5 pagesExam Modeles Pour Le Datamining 2015 2016ilyesPas encore d'évaluation

- Exam Fouille Extraction Datamining Donnees 2017 2018corrigeDocument9 pagesExam Fouille Extraction Datamining Donnees 2017 2018corrigeMaximaPas encore d'évaluation

- Tdmotifs1920 PDFDocument2 pagesTdmotifs1920 PDFilyesPas encore d'évaluation

- 5 Examenfda2015Document5 pages5 Examenfda2015ilyesPas encore d'évaluation

- 2 Rattfda2011-2012 PDFDocument1 page2 Rattfda2011-2012 PDFilyesPas encore d'évaluation

- 6 Examenrattfda2015Document4 pages6 Examenrattfda2015ilyesPas encore d'évaluation

- 3 Examenfda2013 PDFDocument2 pages3 Examenfda2013 PDFilyesPas encore d'évaluation

- 4 Examenfda2014Document4 pages4 Examenfda2014ilyesPas encore d'évaluation

- 2 Rattfda2011-2012Document1 page2 Rattfda2011-2012ilyesPas encore d'évaluation

- 12 Examenrattfda2018Document4 pages12 Examenrattfda2018ilyesPas encore d'évaluation

- Tdad 1920Document1 pageTdad 1920ilyes0% (1)

- 13 Examenfda 2019Document7 pages13 Examenfda 2019ilyesPas encore d'évaluation

- Tdmotifs 1920Document2 pagesTdmotifs 1920ilyes100% (1)

- PolycopefdaDocument96 pagesPolycopefdailyesPas encore d'évaluation

- AlgorithmDocument6 pagesAlgorithmAbdallahi SidiPas encore d'évaluation

- Rapport v1Document36 pagesRapport v1Saad NAJARPas encore d'évaluation

- OMEREMEMO1 - CopieDocument51 pagesOMEREMEMO1 - CopieBajikila AmandPas encore d'évaluation

- TH8068Document160 pagesTH8068imene chatlaPas encore d'évaluation

- Detomal TR SorDocument93 pagesDetomal TR SorFarid Ibn Chouaib89Pas encore d'évaluation

- Ilovepdf MergedDocument95 pagesIlovepdf Mergedslim yaichPas encore d'évaluation

- Cours IA Chapitre 1 2 2Document49 pagesCours IA Chapitre 1 2 2Souhail Ben AfiaPas encore d'évaluation

- Detection D'anomaliesDocument13 pagesDetection D'anomaliesEmerukay YuutsuPas encore d'évaluation

- Fouille Des Big Data Et Visualisation - Week 2Document47 pagesFouille Des Big Data Et Visualisation - Week 2souhail nahedPas encore d'évaluation

- 1 Examen2011-2012Document1 page1 Examen2011-2012ilyesPas encore d'évaluation

- Data Mining (Partie 1)Document56 pagesData Mining (Partie 1)Saad NajarPas encore d'évaluation

- Catalogue OMA 2018 2019Document72 pagesCatalogue OMA 2018 2019Fatima ZahraPas encore d'évaluation

- TP SVMDocument2 pagesTP SVMChafik BerdjouhPas encore d'évaluation

- TH8753Document150 pagesTH8753Arsalan TlmPas encore d'évaluation

- Machine LearningDocument417 pagesMachine LearningrolandPas encore d'évaluation

- Intelligence ArtificielleDocument40 pagesIntelligence ArtificiellelaminePas encore d'évaluation

- Intro Machine LearningDocument240 pagesIntro Machine LearningBossa Mulamba100% (1)

- Un Système de Tri Automatique Des Dattes Par SVM 1vsRDocument10 pagesUn Système de Tri Automatique Des Dattes Par SVM 1vsRElsa KouassiPas encore d'évaluation

- Machine LearningDocument54 pagesMachine LearningTambokto BrainsPas encore d'évaluation

- TH8212Document175 pagesTH8212imane cherPas encore d'évaluation

- S Eparateurs ' A Vastes Marges (SVM) : Prof. Armel YODEDocument29 pagesS Eparateurs ' A Vastes Marges (SVM) : Prof. Armel YODEEric LegerPas encore d'évaluation

- K Plus Proches Voisins / K-Nearest Neighbors /KNNDocument8 pagesK Plus Proches Voisins / K-Nearest Neighbors /KNNAbdallahi SidiPas encore d'évaluation

- MachineLearning MRAminiDocument39 pagesMachineLearning MRAminiKhaled MhamediPas encore d'évaluation

- Rapport PROJET " BREAST CANCER DETECTION "Document37 pagesRapport PROJET " BREAST CANCER DETECTION "Saad NAJARPas encore d'évaluation

- Feuille TageDocument25 pagesFeuille TagepfePas encore d'évaluation

- Comparaison Méthodes SuperviséesDocument18 pagesComparaison Méthodes SuperviséesayoubhaouasPas encore d'évaluation