Académique Documents

Professionnel Documents

Culture Documents

Algorithmes: Exercice 1. Appliquer L'apprentissage Automatique

Transféré par

talel brikiTitre original

Copyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

Algorithmes: Exercice 1. Appliquer L'apprentissage Automatique

Transféré par

talel brikiDroits d'auteur :

Formats disponibles

Traduit de Anglais vers Français - www.onlinedoctranslator.

com

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

Exercice 1. Appliquer l'apprentissage automatique

algorithmes

Temps estimé

01:00

Aperçu

Savoir comment sélectionner l'algorithme d'apprentissage automatique approprié pour un cas d'utilisation donné est une

compétence importante dont vous avez besoin pour résoudre des problèmes réels. Cet exercice fournit les concepts de base que

vous devez comprendre pour appliquer quatre algorithmes d'apprentissage automatique populaires :

• K-means clustering

• Classificateur naïf de Bayes

• Régression linéaire

• Arbre de décision

Objectifs

Après avoir terminé cet exercice, vous devriez être en mesure de :

• Déterminer les centroïdes d'un ensemble de données avec l'algorithme de clustering K-means

• Prédire la classe d'un objet avec le classificateur Naïve Bayes

• Appliquer l'algorithme de régression linéaire pour résoudre des problèmes d'apprentissage supervisé

• Construire un arbre de décision pour prédire les résultats

Introduction

Cet exercice couvre quatre algorithmes d'apprentissage automatique :

• Le clustering K-means est une technique d'apprentissage automatique non supervisée. L'objectif principal de

l'algorithme est de regrouper les observations de données en k clusters ; chaque observation appartient au cluster

avec la moyenne la plus proche.

• Les classificateurs naïfs de Bayes sont une famille de classificateurs simplesclassificateurs probabilistes basé sur

l'application Théorème de Bayes avec naïfindépendance hypothèses entre les caractéristiques des données.

• La régression linéaire est l'un des algorithmes de régression populaires. Il aide les analystes à modéliser les relations

entre les variables d'entrée X et l'étiquette de sortie Y en fonction d'un ensemble de points de données

d'apprentissage. Cet algorithme cible les problèmes de régression supervisée, où la variable cible est une valeur

continue.

• Un arbre de décision est un algorithme qui construit un modèle sous forme d'arborescence. Il ressemble à un organigramme et il

est facile à interpréter. Il décompose un ensemble de données en sous-ensembles de plus en plus petits

© Copyright IBM Corp. 2018, 2019 1-1

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

tout en construisant l'arbre de décision associé. L'arbre de décision est essentiellement constitué de trois entités

principales, à savoir le nœud racine, les nœuds de décision et les feuilles.

Indice

Pour réaliser cet exercice, vous pouvez utiliser une calculatrice scientifique en ligne qui fournit des fonctions

mathématiques de base et avancées telles que WEB 2.0 CALChttps://web2.0calc.com/

Exigences

Aucune exigence particulière, uniquement du papier et un stylo.

© Copyright IBM Corp. 2018, 2019 1-2

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

Consignes d'exercice

Dans cet exercice, vous effectuerez les tâches suivantes :

__ 1. Déterminez les centroïdes d'un ensemble de données avec l'algorithme de clustering K-means.

__ 2. Prédisez la classe d'un objet avec le classificateur Naïve Bayes.

__ 3. Appliquez la régression linéaire à un ensemble de données simple.

__ 4. Construire un arbre de décision pour prédire si un athlète est en forme.

Partie 1: Détermination des centroïdes d'un ensemble de données avec l'algorithme de clustering

K-means

Dans cette partie, vous allez calculer les centres (également appelés centroïdes) pour un ensemble de données non étiqueté

(anonymes) en utilisant l'algorithme de clustering K-means. Il existe de nombreux cas d'utilisation pratiques du clustering K-

means; exemples sont :

• Segmentation et compression d'images

C'est le processus de partitionnement d'une image numérique en plusieurs segments (ensembles de pixels) pour

simplifier et changer la représentation d'une image en quelque chose de plus significatif et plus facile à analyser.

• Segmentation de la clientèle

Le clustering aide les spécialistes du marketing à améliorer leur clientèle, à travailler sur des zones cibles et à segmenter

les clients en fonction de l'historique des achats, des intérêts ou du suivi des activités. La classification des clients peut

aider les entreprises à cibler des groupes spécifiques de clients pour des campagnes spécifiques.

Introduction

Cette section fournit des informations d'introduction dont vous avez besoin pour résoudre ce problème.

Pour calculer le centroïde d'un cluster, un processus itératif est utilisé par lequel chaque point est examiné et il

est déterminé s'il appartient à un cluster spécifique. Ensuite, le nouveau centre de gravité est calculé en utilisant

la moyenne de tous les points avec l'équation suivante :

Notation:

est le nouveau centre de gravité.

est le nombre de points appartenant au même cluster.

est le numéro de point de données i.

© Copyright IBM Corp. 2018, 2019 1-3

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

Vous catégoriserez les points de l'ensemble de données dans la figure suivante entre deux clusters (K=2) en

appliquant l'algorithme de clustering K-means.

Comme point de départ, supposonsau hasard deux points quelconques comme centroïdes initiaux. Supposons que vous ayez sélectionné les

deux points suivants :

Groupe 1 = C1 = (2, 2)

Groupe 2 = C2 = (3, 1).

Vous classerez chaque point d'échantillonnage comme appartenant à un cluster particulier et vous mettrez à jour le

centre du cluster sur seulement deux itérations. Cette approche maintient le processus simple et plus facile à

comprendre. Dans un problème réel, l'ensemble de données comprendrait un grand nombre de points et il faudrait

plusieurs itérations pour catégoriser les points et déterminer le centroïde.

Itération 1

Les étapes suivantes illustrent la première itération :

__ 1. Pour chaque point, calculez le barycentre auquel il appartient ; cela dépend de la distance

entre le centroïde et le point calculé en utilisant la distance euclidienne.

Pour calculer la distance euclidienne, utilisez la formule suivante :

© Copyright IBM Corp. 2018, 2019 1-4

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

Point 1 :(2, 2) → d11 = Oui, d12 = Non

Cela signifie que le point1 (2,2) appartient à C1 et non à C2 car il est plus proche de C1.

Point 2:(3, 1) → d21 = Non, d22 = Oui

Cela signifie que le point2 (3,1) appartient à C2 et non à C1 car il est plus proche de C2.

Point 3 :(6, 4) → d31 = Non, d32 = Oui

Cela signifie que le point3 (6,4) appartient à C2 et non à C1 car il est plus proche de C2.

Point 4 :(7, 5) → d41 = Non, d42 = Oui

Cela signifie que le point4 (7,5) appartient à C2 et non à C1 car il est plus proche de C2.

A présent, vous avez identifié chaque point comme appartenant à un centroïde.

__ 2. Ensuite, calculez les nouveaux centroïdes en déplaçant les centroïdes qui ont été initialement choisis au

hasard au centre de chaque cluster.

- C1 = (2, 2) reste inchangé.

- C2 = (3,1) : Le nouveau centroïde est calculé avec la formule suivante :

C2 = 1/3 ((3, 1) + (6, 4) + (7, 5)) =(5.33, 3.33)

La figure suivante montre l'ensemble de données et les centroïdes déterminés par l'itération 1.

© Copyright IBM Corp. 2018, 2019 1-5

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

Itération 2

Maintenant c'est ton tour. Suivez un processus similaire à l'itération 1 pour effectuer l'itération 2 et déplacer les centres

de cluster.

Quelles sont les nouvelles valeurs de C1 et C2 après l'itération 2 ? Tracez-les dans le graphique.

Partie 2 : Prédire la classe d'un objet avec le classificateur Naïve Bayes

Le classificateur Naïve Bayes est un classificateur probabiliste supervisé. Il est basé sur le théorème de Bayes.

Le théorème suppose une forte indépendance (naïve) entre les caractéristiques des échantillons.

Il existe de nombreux cas d'utilisation pratiques du classificateur Naïve Bayes; exemples sont :

• Classification des articles de presse en technologie, politique, sports, divertissement, etc.

• Classification des e-mails en spam et non en spam.

• Reconnaissance d'objets dans une image, par exemple, reconnaissance faciale.

• Déterminez si un morceau de texte exprime des émotions positives ou négatives.

Dans cette section, vous utiliserez le classificateur Naïve Bayes pour prédire si un objet indéfini d'un ensemble donné

d'échantillons de données étiquetés est une pomme.

Introduction

Cette section fournit des informations d'introduction dont vous avez besoin pour résoudre le problème suivant :

Appliquez le classificateur Naïve Bayes à l'ensemble de données du tableau suivant pour prédire si un objet est une

pomme. Les caractéristiques de l'objet sont : couleur = Rouge, forme = Cylindre et diamètre = 10 CM de diamètre.

Tableau 1. Exemple de fonctionnalités d'objet

Le processus que vous suivrez pour déterminer si l'objet est une pomme comprend les étapes suivantes :

1. Définissez deux classes, CY et CN, correspondant respectivement à Pomme = Oui et Pomme = Non.

2. Calculez la probabilité pour CY compte tenu des attributs x de l'échantillon : p(CY | x)

p(Pomme = Oui | Couleur = Rouge, Forme = Cylindre, Diamètre => 10 cm)

© Copyright IBM Corp. 2018, 2019 1-6

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

3. Calculez la probabilité pour CN étant donné les attributs x de l'échantillon : p(CN | x)

p(Pomme = Non | Couleur = Rouge, Forme = Cylindre, Diamètre => 10 cm)

4. Déterminez quelle probabilité conditionnelle est la plus grande. Utilisez le théorème de Naïve Bayes pour calculer la

probabilité conditionnelle avec la formule suivante :

Si p(CY |x) > p(CN |x) alors l'objet est une pomme.

Calculez chaque terme de la formule de Naïve Bayes comme suit :

Naïve Bayes suppose que les caractéristiques (également appelées attributs) des données d'entrée sont indépendantes.

Par conséquent, vous pouvez écrire p(x|CY) sous la forme :

p(x|CY) = p(Couleur = Rouge | Pomme = Oui) p(Forme = Cylindre | Pomme = Oui) p(Diamètre => 10 CM |

Pomme = Oui)

De même, pour p(x| CN) :

p(x| CN) = p(Couleur = Rouge | Pomme = Non) p(Forme = Cylindre | Pomme = Non) p(Diamètre => 10 CM |

Pomme = Non)

Résoudre le problème

C'est maintenant à vous de résoudre le problème. Effectuez les étapes suivantes :

__ 1. Calculer la probabilité conditionnelle. Remplissez les blancs en utilisant les données du tableau 1 Exemple de

caractéristiques d'objet.

Le tableau comprend cinq pommes et trois d'entre elles sont rouges.

p(Couleur = Rouge | Pomme = Oui) = 3/5

Du tableau, cinq objets ne sont pas des pommes et deux d'entre eux sont rouges.

p(Couleur = Rouge | Pomme = Non) = 2/5

De même, calculez les valeurs suivantes.

p(Forme = Cylindre | Pomme = Oui) = …

p(Forme = Cylindre | Pomme = Non) = …

p(Diamètre => 10 cm | Pomme = Oui) =…

p(Diamètre => 10 cm | Pomme = Non) = …

p(Pomme = Oui) = 5/10

p(Pomme = Non) = …

__ 2. À l'aide des calculs effectués à l'étape précédente, multipliez les termes suivants :

© Copyright IBM Corp. 2018, 2019 1-7

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

p(Couleur = Rouge | Pomme = Oui) * p(Forme = Cylindre | Pomme = Oui) * p(Diamètre => 10 cm |

Pomme = Oui) = …

p(Couleur = Rouge | Pomme = Non) * p(Forme = Cylindre | Pomme = Non) * p(Diamètre = > 10 cm | Pomme

= Non) =

__ 3. Enfin, comparer p(COui|X) et p(CN |X):

__ 4. Pouvez-vous prédire si l'objet est une pomme ?

Note

Pour gagner du temps, il est recommandé aux élèves de travailler surPartie 3, "Appliquer la régression linéaire à un

ensemble de données simple (facultatif)" etPartie 4, "Construire un arbre de décision pour prédire si un athlète est en

forme (facultatif)" comme devoirs par eux-mêmes et ils discutent des résultats avec l'instructeur le jour 2.

Partie 3 : Application de la régression linéaire à un ensemble de données simple (facultatif)

La régression linéaire est le modèle le plus simple et le plus largement utilisé pour l'apprentissage supervisé avec des

objectifs continus. Il donne une fonction de prédiction linéaire qui est particulièrement facile à interpréter et à utiliser dans la

notation des observations.

La régression est une technique qui affiche la relation entre une variable « y » basée sur les valeurs d'une

variable « x ». La régression linéaire est utilisée pour trouver la relation entre les variables dépendantes et

indépendantes.

La régression linéaire est une technique statistique très puissante et peut être utilisée pour générer des informations sur le

comportement des consommateurs, comprendre les entreprises et les facteurs influençant la rentabilité. Par exemple:

• Analyser l'efficacité marketing, les prix et les promotions sur les ventes d'un produit

• Prévoir les ventes en analysant les ventes mensuelles de l'entreprise au cours des dernières années

• Prédire les prix des maisons avec l'augmentation de la taille des maisons

• Calculer les relations causales entre les paramètres dans les systèmes biologiques

En appliquant des techniques de régression linéaire, vous pouvez tracer une ligne à une distance optimale de tous les points. Pour

tracer cette ligne, calculez l'erreur de manière itérative jusqu'à ce que vous atteigniez la meilleure ligne avec le minimum

© Copyright IBM Corp. 2018, 2019 1-8

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

valeur d'erreur, c'est-à-dire la distance minimale entre la ligne et tous les points. L'erreur représente la

distance agrégée entre les points de données et la ligne cible.

Introduction

Cette section fournit des informations d'introduction dont vous avez besoin pour résoudre le problème.

Attention

Dans cet exercice, la représentation du modèle de régression linéaire pour ce problème sera :

hp(Xje) = p0 + p1 * X

Notation:

• i est le numéro d'un échantillon ou d'un point de données dans les échantillons de l'ensemble de données.

• hp(Xje) est la valeur prédite pour le point de données i.

• yjeest la valeur réelle du point de données i.

• m est le nombre d'échantillons d'ensembles de données ou de points de données.

• Fonction Coût/Erreur au carré = J(P) = (1/(2*m)) ∑(hp(Xje) - yje)2

Ainsi l'erreur minimisée avec l'erreurmin=(1/m)*∑(hp(Xje) - yje)

• j est le numéro de la fonction.

• αest le taux d'apprentissage.

• p0s'appelle le biais. p0est également appelée l'interception car elle détermine l'endroit où la ligne

intercepte l'axe y.

• p1est appelée la pente car elle définit la pente de la ligne ou la façon dont x est corrélé à la valeur y

avant d'ajouter le biais.

• L'algorithme de descente de gradient pour obtenirnouveau les poids donnésvieux poids est calculé avec la

formule suivante :

p0=p0– α * erreurmin

De même, pour p1

p1=p1– α * erreurmin

Le problème hypothétique que nous essayons de résoudre a les caractéristiques suivantes :

© Copyright IBM Corp. 2018, 2019 1-9

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

• Une seule caractéristique (une dimension), c'est-à-dire la valeur de j = 1.

• Le taux d'apprentissage est de 0,01, c'est-à-dire α = 0,01.

• L'ensemble de données est représenté dans le tableau suivant où x représente l'entrée et Y représente la

sortie.

X = [1,2,4] et Y = [2,1,5], c'est-à-dire m = 3.

X Oui

1 2

2 1

4 5

• L'initialisation pour p0=p1= 0. Et donc hp(Xje) = 0, puisque hp(Xje) = p0+p1* X. Utilisez la descente de gradient

pour calculer de nouvelles valeurs pour p0et P1.

Itération 1

Effectuez les étapes suivantes :

__ 1. Remplacez les valeurs dans l'équation suivante :

p1=p1– α *(1/m)*Σ(hp(Xje) - yje)* Xje

p1= 0 – 0,01* (1/3)* [((0-2)*1) +((0- 1)*2)+((0-5)*4)]

p1= 0 – 0,01 * (1\3) * (-(2 + 2 + 20))

p1= 0,08

__ 2. Calculer p0

__ 3. Calculez l'erreur pour l'itération 1. Remplacez les valeurs dans la fonction de coût :

J(P) = (1/(2*m)) Σ(hp(Xje) - yje)2

J(P) = 1/(2*3)* ([(0,02666+0,08*1-2) 2̂ + (0,02666+0,08*2-1)^2 +(0,02666+0,08*4-5)^2 ]

J(P) = 4,3166

Itération 2

Effectuez les étapes suivantes :

__ 1. Utiliser les valeurs calculées à l'itération 1 pour p0et P1pour calculer les nouvelles valeurs de p0et P1

© Copyright IBM Corp. 2018, 2019 1-10

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

__ 2. Calculez l'erreur pour l'itération 2.

__ 3. L'erreur de l'itération 2 a-t-elle diminué par rapport à l'erreur de l'itération 1 ?

__ 4. Étape facultative :Vous pouvez utiliser leRégression linéaire feuille comme indiqué dans la figure suivante

pour ajuster les poids initiaux et le taux d'apprentissage (en bleu) et voir comment l'erreur change.

Partie 4 : Construire un arbre de décision pour prédire si un athlète est en forme (facultatif)

Decision Tree est un algorithme de classification qui tente de résoudre le problème en utilisant une représentation

arborescente. Chaque nœud interne de l'arbre correspond à un attribut, et chaque nœud feuille correspond à une

étiquette de classe.

Les arbres de décision sont une méthode de prédiction populaire. Les arbres de décision peuvent expliquer pourquoi une

prédiction spécifique a été faite en parcourant l'arbre.

Certains cas d'utilisation de l'arbre de décision sont :

• Construire des plates-formes de gestion des connaissances pour le service client qui améliorent la résolution

du premier appel, le temps de traitement moyen et les taux de satisfaction client.

• En finance, prévoir les résultats futurs et attribuer des probabilités à ces résultats.

• Prédire la volonté des clients d'acheter un produit donné dans un environnement donné, par exemple, en ligne ou dans

un magasin physique.

• Prise de décision commerciale générale.

Introduction

Cette section fournit des informations d'introduction dont vous avez besoin pour résoudre le problème.

Dans cet exercice, vous construirez un arbre de décision à partir d'un ensemble de données pour décider si un joueur est apte. Pour

comprendre le processus, examinons un exemple différent, pour décider si c'est une bonne journée pour jouer au tennis en fonction des

conditions météorologiques.

Examinons d'abord quelques définitions de termes :

• Gain d'information : il s'agit d'une métrique qui définit la quantité d'informations qu'une fonctionnalité fournit sur une classe.

L'ensemble de données est divisé en différentes caractéristiques (ou attributs) pour construire l'arbre. La fonction avec le gain

d'informations le plus élevé est utilisée pour la première division.

© Copyright IBM Corp. 2018, 2019 1-11

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

• Entropie : C'est une métrique qui est utilisée pour calculer le gain d'information comme suit :

Entropie pour un attribut : Entropie(x) = - Σ p(x)log2p(x) Entropie

pour deux attributs : Entropy(T, xje) = - Σjep(xje)enregistrer2p(xje)

Gain(T,x) = Entropie(T)-Entropie(T,x)

Exemple : Calcul de l'entropie pour un attribut

Étant donné le tableau de fréquence suivant, calculez l'entropie.

Jouer au tennis

Oui Non

4 6

Entropie (jouer au tennis) = - (4/10) log2(4/10) - (6/10) bûche2(6/10) =0,970

Exemple : Calcul de l'entropie pour deux attributs

Étant donné le tableau de fréquence suivant, calculez l'entropie.

Jouer au tennis

Venteux Oui Non

Oui 3 4

Non 1 2

Entropie(jouer au tennis, venteux) = (7/10) E(3,4) + (3/10) Entropie(1,2)

La formule suivante calcule l'entropie pour jouer au tennis lorsqu'il y a du vent (venteux = Oui), en ne prenant en

considération que la fréquence de jouer au tennis lorsqu'il y a du vent.

E(3,4) = - (3/7) log2 (3/7) - (4/7) log2 (4/7) = 0,9852

La formule suivante calcule l'entropie pour jouer au tennis lorsqu'il n'y a pas de vent (venteux = Non), en ne

prenant en considération que la fréquence de jouer au tennis lorsqu'il n'y a pas de vent

E(1,2) = - (1/3) log2 (1/3) - (2/3) log2 (2/3) = 0,91829

Enfin, substituez E(3,4) et E(1,2) :

Entropie (jouer au tennis, venteux) = (7/10)* 0,9852 + (3/10) *0,91829 = 0,965127

Exemple : calcul du gain

La formule suivante calcule le gain en utilisant les valeurs d'entropie calculées dans les exemples

précédents.

Gain(jouer au tennis, venteux) = Entropie(jouer au tennis) - Entropie(jouer au tennis, venteux)

© Copyright IBM Corp. 2018, 2019 1-12

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

=970-0.965127

= 0,004873.

Vous comprenez maintenant comment calculer l'entropie et le gain. Vous pouvez passer à la section suivante pour construire un

arbre de décision à partir d'un ensemble de données afin de décider si un joueur est apte.

Prédire si un joueur de football est apte à jouer un match

Les données du tableau suivant décrivent huit joueurs de football s'entraînant pour un match à venir. Chaque

joueur a trois caractéristiques ou attributs, et chaque joueur est apte ou non. La colonne IsFit représente

l'étiquette des données. Trouvez l'arbre de décision correspondant.

Pratique Abid_Dietary Est Motivé Est en forme

Modéré Oui Oui Oui

bien Non Oui Oui

Non Non Oui Non

Modéré Non Non Non

Modéré Non Oui Oui

Modéré Non Oui Oui

Non Oui Non Non

bien Oui Non Non

Itération 1

Calculez le gain pour chaque fonctionnalité afin de spécifier le nœud racine dans l'arbre de décision :

__ 1. Gain (IsFit , Pratique) = Entropie (IsFit) – (4/8) Entropie (Pratique = Modéré) – (2/8)

Entropie (Pratique = Bon) - (2/8) Entropie (Pratique = Non)

__ un. Entropie(IsFit) = -(4/8)log2(4/8) -(4/8) log2 (4/8) = 1

__ b. Entropie (Pratique = Modéré) = -(3/4)log2(3/4) -(1/4)log2(1/4) = 0,8113

__ c. Entropie(Pratique = Bon) = -(1/2)log2(1/2) -(1/2)log2(1/2) = 1

__ d. Entropy(Practice = No) = 0 (Essayez de le calculer, mais comme vous pouvez le voir dans le tableau,

lorsque Practice = No , IsFit est toujours No).

Remplaçons maintenant les valeurs :

Gain (IsFit, Pratique)=1 – (4/8) × 0,8113 – (2/8) × 1 – 0 = 0,3443

__ 2. Gain(IsFit , IsMotivated) = Entropy(IsFit) – (5/8) Entropy(IsMotivated = Yes) – (3/8)

Entropy(IsMotivated = No)

__ un. Entropie (IsMotivated = Yes) = -(4/5)log2(4/5) -(1/5)log2(1/5) = 0,7219

__ b. Entropie (IsMotivated = Non) = 0

Remplaçons maintenant les valeurs

© Copyright IBM Corp. 2018, 2019 1-13

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

Gain (IsFit, IsMotivated)=1 – (5/8) × 0,7219 – 0 = 0,5488

__ 3. Gain(IsFit, Abid_Dietary) = Entropy(IsFit) – (3/8) Entropy(Abid_Dietary = Yes) – (5/8)

Entropie (Abid_Dietary = Non)

__ un. Entropie (Abid_Dietary = Oui) =

__ b. Entropie(Abid_Dietary = Non) =

Remplaçons maintenant les valeurs :

Gain(IsFit, Abid_Dietary)=

Puisque Gain(IsFit, IsMotivated) est le plus grand, alors le nœud racine est IsMotivated.

Itération 2

Pour compléter l'arborescence, calculez le gain des autres fonctionnalités pour l'ensemble de données lorsque IsMotivated = Yes.

__ 1. Gain(IsMotivated = Yes, Practice)=Entropie (IsMotivated = Yes) – (3/5) Entropy

(IsMotivated = Yes , Practice = Modéré) – (1/5) *Entropy (IsMotivated = Yes , Practice =

Good) - (1/5) Entropy (IsMotivated = Yes , Pratique =Non)

Parcourez le tableau et concentrez-vous uniquement sur les lignes de données où IsMotivated = Yes et

ignorez les autres lignes. Pour les lignes sélectionnées, comparez l'attribut IsFit aux valeurs de la colonne

Practice. Vous constaterez que chaque valeur unique est mappée directement sur une valeur unique soit IsFit

= Yes ou IsFit = No, il n'y a pas de valeurs mixtes, donc l'entropie pour chacune est 0.

__ un. Entropie (IsMotivated = Yes , Practice = Modéré) = 0

__ b. Entropie (IsMotivated = Yes , Practice = Good) = 0

__ c. Entropie(IsMotivated = Yes , Practice = No) = 0

Gain(IsMotivated = Yes, Practice)=0,7219 – 0 – 0 – 0=

__ 2. Gain(IsMotivated = Oui, Abid_Dietary)=Entropie (IsMotivated = Oui) – (1/5) Entropie

(IsMotivated = Oui, Abid_Dietary = Oui) – (4/5) * Entropie (IsMotivated = Oui,

Abid_Dietary = Non)

__ un. Entropie (IsMotivated = Yes , Abid_Dietary = Yes) =

__ b. Entropie (IsMotivated = Yes , Abid_Dietary = No) =

Gain(IsMotivated = Oui, Abid_Dietary)=0,7219 – (4/5)*0,8112= 0,07294

Depuis,Gain(IsMotivated = Yes, Practice)est le plus grand alors utilisez le noeud Entraînement

© Copyright IBM Corp. 2018, 2019 1-14

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

Fin d'exercice

© Copyright IBM Corp. 2018, 2019 1-15

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

V11.2

Exercice 1. Appliquer des algorithmes d'apprentissage automatique

EXvide

Bilan de l'exercice et synthèse

Dans cet exercice, vous avez appliqué quatre algorithmes d'apprentissage automatique pour résoudre des problèmes simples et utilisé de petits

ensembles de données.

Vous avez appris à calculer des centroïdes dans des clusters K-means comme exemple d'apprentissage non

supervisé. Vous avez implémenté la classification supervisée à l'aide de Naïve Bayes. Vous avez résolu une

régression avec régression linéaire et finalement construit un arbre de décision.

Vous avez effectué tous les calculs manuellement pour comprendre le processus requis pour appliquer ces algorithmes à

des problèmes et à un ensemble de données très simples.

© Copyright IBM Corp. 2018, 2019 1-16

Les supports de cours ne peuvent être reproduits en totalité ou en partie sans l'autorisation écrite préalable d'IBM.

Vous aimerez peut-être aussi

- 1 - Techniques-Optimisation-AoDocument63 pages1 - Techniques-Optimisation-AoAhmed AbatourabPas encore d'évaluation

- Utilisation d'EXCEL Pour Résoudredes Problè Mes de Programmation LinéaireDocument17 pagesUtilisation d'EXCEL Pour Résoudredes Problè Mes de Programmation LinéaireAnas BouchikhiPas encore d'évaluation

- Le diagramme d'Ishikawa: Les liens de cause à effetD'EverandLe diagramme d'Ishikawa: Les liens de cause à effetÉvaluation : 3.5 sur 5 étoiles3.5/5 (3)

- Bevel To Degree Conversion ChartDocument1 pageBevel To Degree Conversion ChartScott NorrisPas encore d'évaluation

- CNNDocument4 pagesCNNNour BellaliPas encore d'évaluation

- Notions Sur Les: Support Vector MachinesDocument23 pagesNotions Sur Les: Support Vector MachinesmouradPas encore d'évaluation

- Chapitre 2Document63 pagesChapitre 2DUTERRAGE HugoPas encore d'évaluation

- Classification Et Évaluation: Objectif Du TP 4Document5 pagesClassification Et Évaluation: Objectif Du TP 4Medilyass ElhamdaouiPas encore d'évaluation

- TP07Document5 pagesTP07touatit tamerPas encore d'évaluation

- SpssDocument15 pagesSpssrifai aminePas encore d'évaluation

- ML PRDocument66 pagesML PRAbdrrahim ElhPas encore d'évaluation

- CHAPITRE 1Document17 pagesCHAPITRE 1naimemed3Pas encore d'évaluation

- Projet FinalDocument5 pagesProjet FinaldungPas encore d'évaluation

- Machine Learning - InitiationDocument18 pagesMachine Learning - InitiationAnass Roman100% (1)

- ba3d modification ta3 machine learningDocument10 pagesba3d modification ta3 machine learningnaimemed3Pas encore d'évaluation

- TP - Arbre de DécisionDocument6 pagesTP - Arbre de DécisionMeryem Bakir100% (1)

- TP 2Document3 pagesTP 2Mariama DIOUFPas encore d'évaluation

- exposé-MLDocument31 pagesexposé-MLSoltan SadokPas encore d'évaluation

- Premier essai apres les resuméDocument19 pagesPremier essai apres les resuménaimemed3Pas encore d'évaluation

- tp1 DeeplDocument5 pagestp1 DeeplDr. Chekir AmiraPas encore d'évaluation

- Chapitre I MEF DocumentDocument39 pagesChapitre I MEF DocumentJelly GiroudPas encore d'évaluation

- Exercice Random Forest Classification BayesienneDocument5 pagesExercice Random Forest Classification Bayesienneoumayma brikiPas encore d'évaluation

- 2023 2024 m2 Mlds Big Data Projet TMPDocument3 pages2023 2024 m2 Mlds Big Data Projet TMPMohamed CHPas encore d'évaluation

- Cours1 - Intoduction À L'apprentissage Et ComplexitéDocument42 pagesCours1 - Intoduction À L'apprentissage Et ComplexitéMoumouh KingPas encore d'évaluation

- KPPVDocument2 pagesKPPVYunes iFriPas encore d'évaluation

- Apprentissage Automatique Semi - SuperviséDocument9 pagesApprentissage Automatique Semi - Supervisémichelone129925Pas encore d'évaluation

- EX_ML_corrigé_CII-3-SSIR_A_BDocument4 pagesEX_ML_corrigé_CII-3-SSIR_A_BsnoussiwahibaPas encore d'évaluation

- Résumé Deep LearningDocument15 pagesRésumé Deep LearningACHRAF KADMIRIPas encore d'évaluation

- TP SVMDocument7 pagesTP SVMmarwaPas encore d'évaluation

- IA ReseauxNeuronnes Seance2Document19 pagesIA ReseauxNeuronnes Seance2Ikrame LABZIOUIPas encore d'évaluation

- Algorithme Machine LearngDocument16 pagesAlgorithme Machine LearngYayaPas encore d'évaluation

- Correction 2014Document4 pagesCorrection 2014rukiaPas encore d'évaluation

- Devoir2 2021Document3 pagesDevoir2 2021fifaacessPas encore d'évaluation

- TP Deep Learning MNIST DatasetDocument9 pagesTP Deep Learning MNIST Datasetimane elattPas encore d'évaluation

- Seq Poubelle ConnecteeDocument3 pagesSeq Poubelle ConnecteeKaled MRASSIPas encore d'évaluation

- Chap2 Intro Deep LearningDocument58 pagesChap2 Intro Deep LearningkaoulatouatiPas encore d'évaluation

- Aides Pédagogiques d'informatique-2SI - AlgoDocument3 pagesAides Pédagogiques d'informatique-2SI - AlgoRaniaElleuchAbidPas encore d'évaluation

- KPPV PDFDocument2 pagesKPPV PDFAchraf BouraPas encore d'évaluation

- TP 1 AvanceDocument3 pagesTP 1 Avanceb.sabiri6445Pas encore d'évaluation

- Chapitre II Machine LearningDocument161 pagesChapitre II Machine Learningoumayma bayarPas encore d'évaluation

- Méthode Merise - Analyse Et Conception de Système D'InformationsDocument20 pagesMéthode Merise - Analyse Et Conception de Système D'Informationsapi-3706108100% (3)

- TP4 ClassificationSupervisée StudentDocument11 pagesTP4 ClassificationSupervisée Studentmohamed anouar hassinePas encore d'évaluation

- Cours ML MouniraDocument131 pagesCours ML Mouniraenetcom.mpritel2022Pas encore d'évaluation

- Eb31 630Document2 pagesEb31 630Anthony TonyPas encore d'évaluation

- TP SVMDocument8 pagesTP SVMHanane KARDIPas encore d'évaluation

- Examen DesignPattern2010 Corrige PDFDocument10 pagesExamen DesignPattern2010 Corrige PDFKhaled ChraietPas encore d'évaluation

- Chapitre 4Document29 pagesChapitre 4Christopher NumbiPas encore d'évaluation

- Aides Pédagogiques 2 - 3 - 4ème SI - ALGO 2022 - 2023-Version FinaleDocument13 pagesAides Pédagogiques 2 - 3 - 4ème SI - ALGO 2022 - 2023-Version FinaleMd infoPas encore d'évaluation

- Algorithmes de Machine LearningDocument52 pagesAlgorithmes de Machine LearningNora Habrich100% (1)

- Atelier AutomaticDocument35 pagesAtelier AutomaticdjamilPas encore d'évaluation

- CurriculaSI (Algo+STI) 2021-2022Document24 pagesCurriculaSI (Algo+STI) 2021-2022Thabet CHOKRI100% (1)

- Ensemble Learning Boosting of Different ClassifiersDocument16 pagesEnsemble Learning Boosting of Different Classifiersmickael.nerodaPas encore d'évaluation

- TP2 - EPI Polytec - v2020 - 2021 PDFDocument12 pagesTP2 - EPI Polytec - v2020 - 2021 PDFNader AbdessayedPas encore d'évaluation

- Les Algorithmes D'apprentissage AutomatiqueDocument29 pagesLes Algorithmes D'apprentissage AutomatiqueLasmer ChadiPas encore d'évaluation

- TP3 DMDocument7 pagesTP3 DMHamdi GdhamiPas encore d'évaluation

- RAPPORT RegressionDocument14 pagesRAPPORT RegressionAmal TouhamiPas encore d'évaluation

- Algo AvDocument23 pagesAlgo AvaroPas encore d'évaluation

- TD Avec CorrigéDocument9 pagesTD Avec Corrigéaziz123100% (1)

- Solution Examen de Remplacement Optimisation Combinatoire Anne 2021-2022Document4 pagesSolution Examen de Remplacement Optimisation Combinatoire Anne 2021-2022bochramiinfoPas encore d'évaluation

- Machine LearningDocument417 pagesMachine LearningrolandPas encore d'évaluation

- Stage de Fin D'Etudes: Ecole D'Ingenierie Et D'Innovation de MarrakechDocument3 pagesStage de Fin D'Etudes: Ecole D'Ingenierie Et D'Innovation de MarrakechFatine BEN ABDELGHANIPas encore d'évaluation

- Solution TP AsservissementDocument9 pagesSolution TP AsservissementÄy MênPas encore d'évaluation

- 01 - AlgorithmiqueDocument48 pages01 - Algorithmiquedovah14136Pas encore d'évaluation

- S1 ML0524 B - T6CSH Single Vane PumpDocument8 pagesS1 ML0524 B - T6CSH Single Vane PumpBernardo Orozco LariosPas encore d'évaluation

- 1 - GravimétrieDocument25 pages1 - GravimétriekhelifahmedaminePas encore d'évaluation

- Concurrence Pure Et ParfaiteDocument73 pagesConcurrence Pure Et ParfaitesmatiPas encore d'évaluation

- Dimensionnement Des RéservoirsDocument1 pageDimensionnement Des RéservoirsArthur TohamPas encore d'évaluation

- 17 EquaDiffScalaires1 CompletDocument4 pages17 EquaDiffScalaires1 CompletTtabi VeydiPas encore d'évaluation

- Nos Radiateurs Éléctriques - Nos Radiateurs Éléctriques CarreraDocument1 pageNos Radiateurs Éléctriques - Nos Radiateurs Éléctriques CarreraChristophe DUMAZET MARTINPas encore d'évaluation

- Examen EDO 2016-2017Document2 pagesExamen EDO 2016-2017interactif tchatcheuPas encore d'évaluation

- Article IADocument2 pagesArticle IAloukmaneanassriPas encore d'évaluation

- L'impact de La Communication Interne Sur La Performance Des Salariés Cas Pratique Danone Djurdjura Akbou (Bejaia)Document130 pagesL'impact de La Communication Interne Sur La Performance Des Salariés Cas Pratique Danone Djurdjura Akbou (Bejaia)saliha ameziane100% (1)

- Inventaire de Nos Fautes Les Plus Usuelles - Sylva ClapinDocument194 pagesInventaire de Nos Fautes Les Plus Usuelles - Sylva Clapinpetros dionPas encore d'évaluation

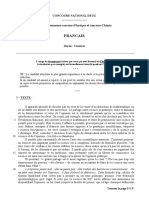

- Concours National Deug Epreuve de Francais 2004Document4 pagesConcours National Deug Epreuve de Francais 2004Majed JallouliPas encore d'évaluation

- Ex5 Modalisation Exercice Attitude PropoDocument5 pagesEx5 Modalisation Exercice Attitude Proposan draPas encore d'évaluation

- L'entretienDocument24 pagesL'entretienhanae elharounPas encore d'évaluation

- BENHRIMIDA 1 ChaltouteDocument12 pagesBENHRIMIDA 1 ChaltouteAmine ChettatPas encore d'évaluation

- Compte Rendu Chimie: 1: Vaporisation de L'eau DistilléeDocument9 pagesCompte Rendu Chimie: 1: Vaporisation de L'eau DistilléeWalid Ouabas100% (3)

- Le Processus StratégiqueDocument2 pagesLe Processus StratégiqueNajwa AmellalPas encore d'évaluation

- CdA ZeroDocument40 pagesCdA ZeroangedesjolisbasPas encore d'évaluation

- Đề cương - L'OCÉAN INDIENDocument6 pagesĐề cương - L'OCÉAN INDIENK60 Tạ Hà LinhPas encore d'évaluation

- Stop en Cas de Danger / Sécuriser / Reprendre Le Travail: ConstructionDocument1 pageStop en Cas de Danger / Sécuriser / Reprendre Le Travail: ConstructionLanciné Djene KouroumaPas encore d'évaluation

- Variateur de Fréquence - HTML PDFDocument17 pagesVariateur de Fréquence - HTML PDFAnonymous oyUAtpK0% (1)

- To MehdiDocument14 pagesTo Mehdirubis tarekPas encore d'évaluation

- Exposé MQDocument16 pagesExposé MQCHAIMAE KACEMIPas encore d'évaluation

- 125 Bouddine BenfaidaDocument38 pages125 Bouddine BenfaidaOthmane BenfaidaPas encore d'évaluation

- Rapport-Stage - ModiffierDocument40 pagesRapport-Stage - ModiffierOussama RachikPas encore d'évaluation

- PFE MASTER Mohammed Ouhaggou Ilham SahriDocument61 pagesPFE MASTER Mohammed Ouhaggou Ilham SahriSeLMA 12Pas encore d'évaluation

- nd2313 PDFDocument9 pagesnd2313 PDFYassine BouchPas encore d'évaluation