Académique Documents

Professionnel Documents

Culture Documents

Critères de Choix Des Méthodes Statistiques

Transféré par

bouzidi a.rrehmaneTitre original

Copyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

Critères de Choix Des Méthodes Statistiques

Transféré par

bouzidi a.rrehmaneDroits d'auteur :

Formats disponibles

Chapitre 3 critères de choix des méthodes statistiques

Dans la pratique des analyses statistiques, on se heurte souvent au choix d’une méthode

d’analyse parmi une multitude de méthodes existantes. Pour faire un choix judicieux de

la méthode statistique, il faut :1) avoir une vue d’ensemble des méthodes les plus

utilisées dans son domaine d’étude ;2) être au courant de l’usage et des exigences de

chaque méthode et 3) tenir compte des variables (nombre et nature) utilisées en

relation avec les objectifs de recherche poursuivis. On peut ainsi envisager plusieurs

manières de choisir une méthode d’analyse. On peut les résumer comme suit :

1- Choix selon les paramètres comparés : selon qu’on souhaite comparer des

moyennes, des variances …etc, on aura besoin de choisir des méthodes (tests)

différentes. Voici un tableau de synthèse des tests usuels avec les situations de

leur emploi. Dans ce tableau, sont inclues les fonctions R pour réaliser ces

méthodes.

Eléments à comparer Test paramétrique Fonction R Test non Fonction R

paramétrique

1 moyenne obs/1 Student t.test (x,µ=µ0) Mann-Whitney wilcox.test()

moyenne théorique (compare les

médiane)

2 moyennes (échs Student t.test(x,y,paired=F) Mann-Whitney wilcox.test(x,y,paired=F)

indépendants) (médianes)

2 moyennes (échs Student t.test(x,y,paired=T) Wilcoxon wilcox.test(x,y,paired=T)

appariés (rangs signés

de Wilcoxon

(médianes)

>2moyennes (échs anova aov() Kruskal-Wallis kruskal.test()

indép) (médianes)

>2moyennes (échs Anova à mesures aov() Friedman(médi Friedman.test()

appariés) répétées ane)

2 variances Test de Fisher var.test() -------------- ……………..

( test F)

>2variances Test de Levene/ bartlett.test() -------- ---- ……………….

test de Bartlett

Proportions(%) 1 , 2 Test du khi-2 chisq.test() Test exact de fisher.test()

éch indép et >2 éch binom.test() fisher

indépendants prop.test()

Proportions Test Mac Nemar mcnemar.test() --------------

(appariés)

Association entre Corrélation de cor.test(x,y,method Corrélation de cor.test(x,y,method=’’spear

deux variables Pearson = ‘’pearson’’ ) Spearman man’’)

quantitatives

Vérifier la normalité Test de ks.test()

des données Kolmogorov-

smirnov

Test de shapiro.test()

shapiro-wilk

Conditions de validité des tests paramétriques

Test de Student pour échantillons indépendants:

1- Indépendance des échantillons

2- Normalité des données :On peut la vérifier avec un test de normalité (test de

shapiro-wilk) ou appréciée par un simple histogramme

3- Egalité des variances des populations mères : vérifiée avec le test F

Test de Student pour échantillons appariés

Normalité des différences entre les deux séries de mesure

Test du khi-2 :

Valable si tous les effectifs observés (expected) sont >= 5

Si au moins un effectif <5 mais >= 3 on réalise la correction de YATES

Si au moins un des effectifs observés<3 on réalise le test exact de fisher

Analyse de la variance :

Egalité des variances entres les populations : test de Bartlett/test de Levene

Normalité des données (ou des résidus) de toutes les populations comparées

Tests : Bartlett et Levene : valables si les données sont normales.

Avantages et inconvénients :

Tests paramétriques :

- se basent sur des distributions statistiques supposées des données

(distribution normale…) parfois difficiles voire impossibles à vérifier !

- Sont plus puissants ( rejet de H0 ‘’facilement’’ quand elle est fausse)

Tests paramétriques :

- S’appliquent sans faire aucune hypothèse sur la distribution des données ;

On dit que les tests non paramétriques sont ‘’robustes’’. En d’autres termes, ils

peuvent s’appliquer sans aucune contrainte…

- Ils s’appliquent notamment, lorsque les données sont peu nombreuses pour

pouvoir vérifier la normalité ou valider la convergence des données à une loi

connue…ou encore avec des donnés de dénombrement ou de score (note

attribuée…).

2- Choix selon la nature de données (variables)

Comme signalé plus haut, la nature des variables peut contraindre à l’usage d’un test

paramétrique ou non paramétrique. Le tableau ci- dessous, résume les différentes

situations. Toutefois, il serait utile de rappeler brièvement la signification des

différentes échelles que peut prendre la nature d’une variable. Référence :

https://www.univ-orleans.fr/deg/masters/ESA/GC/sources/CoursNP.pdf

- échelle nominale : Exemple une variable indicatrice du genre d’une personne a

deux modalités valant 0 (ou ’H’ ou ...) pour les hommes et 1 (ou ’F’ ou ...) pour les

femmes …etc.

- échelle ordinale : les modalités prises par la variable définissent une relation

d’ordre sur la population considérée. On ne peut en particulier pas interpréter les

écarts des valeurs prises par la variable en termes d’intensité : un classement ne

renseigne en rien sur la distance séparant les individus classés. L’exemple type

est celui des échelles de Likert que l’on rencontre fréquemment dans les

questionnaires, ayant des modalités de la forme : très satisfait / satisfait /

insatisfait / très insatisfait. Ces variables remplissent un objectif de

hiérarchisation

- échelle d’intervalle : En plus de la relation d’ordre précédente on dispose d’une

mesure relative à la distance séparant deux individus : contrairement à la mesure

précédente, on peut comparer les écarts existant entre des observations. Ainsi

si la distance entre A et B est de 4 et celle de B à C est de 2 alors on peut

conclure que A est deux fois plus éloigné de B que

B l’est de C. L’origine de ces mesures, le zéro, est fixé arbitrairement. Un

exemple est donné par la mesure des températures. On ne peut pas dans ce cas

interpréter en termes d’intensité le rapport existant entre deux observations :

si la variation de température entre 100 et 110 Celsius est la même que celle qu’il

y a entre 200 et 210, en revanche il ne fait pas deux fois plus chaud lorsque l’on

passe de 10 à 20 degrés Celsius

- échelle de rapport (ou de ratio ou proportionnelle) : C’est une échelle d’intervalle

caractérisée par l’existence d’une origine, un vrai zéro. De ce fait le rapport de

deux variables définit une intensité mesurable (on peut par exemple affirmer que

si deux personnes perçoivent respectivement 2000 et 2500 euros par mois alors

la seconde reçoit 1.25 fois le salaire de la première 2).

La nature des données peut contraindre l’emploi de tel ou tel test. Les tests

paramétriques exigent en effet que les variables de travail soient mesurées au moins

sur une échelle d’intervalle. Les tests non paramétriques sont les seuls à pouvoir être

mis en oeuvre sur des variables de type nominales ou ordinales. En pratique il est donc

important de connaître l’échelle de mesure des variables de travail. Enfin, vous savez

encore qu’au sein des variables quantitatives il est possible de distinguer celles à

observations discrètes, comme dans le cas des dénombrements, et celles à observations

continues. Naturellement si un test paramétrique suppose une distribution continue, il ne

pourra pas être employé dans le premier cas.

3- Choix selon les objectifs de recherche

Dans la pratique de l’analyse de données, on dispose de données issues d’expériences

réalisées dans le cadre d’un travail de recherche comportant des objectifs bien

définis. En fonction de ces objectifs, on est amené et parfois contraint d’utiliser

telle ou telle méthode.

- S’il s’agit de rendre compte de la variabilité des données relatives à une

population et de rendre les données plus lisibles, ordonnées et synthétisées ,

alors la méthode descriptive sera adoptée ;

- Pour rechercher des liens entre deux variables quantitatives, c’est la régression

linéaire qui sera utilisée…

- Pour rechercher un lien entre deux variables qualitatives, on utilise le test du

khi-2 ;

- Pour comparer une variable quantitative en fonction d’une variable qualitative, on

utilise le test de STUDENT (exemple :poids en fonction du sexe …etc.)

- Pour comparer une variable quantitative en fonction de deux ou plus de variables

qualitatives, on utilise l’analyse de la variance (anova) (exemple : rendement d’une

culture en fonction de ‘’type d’engrais’’ et ’’type de variété ‘’)

- Pour expliquer les variations d’une variable qualitative binaire (présence /

absence) en fonction de variables quantitatives et/ou qualitative, on utilise la

régression logistique

- Pour analyse un tableau complet (individus /variables quantitatives

continues=mesures) , on utilise une méthode multivariée , l’ACP (analyse en

composantes principales) ;

- Pour analyser un tableau de contingence (tableau croisé=enquêtes), on utilise une

méthode multivariée appelée AFC (analyse factorielle des correspondances) .

Vous aimerez peut-être aussi

- Les Méthodes Quantitatives Explicatives de Traitement Des DonnéesDocument6 pagesLes Méthodes Quantitatives Explicatives de Traitement Des DonnéesMohamed Reda HammadiaPas encore d'évaluation

- Question de Recherche Hypothèses de Recherche Variables Et Échelles de Mesure Types de Données Nombre D'échantillonsDocument20 pagesQuestion de Recherche Hypothèses de Recherche Variables Et Échelles de Mesure Types de Données Nombre D'échantillonsClosed WayPas encore d'évaluation

- Cm.2ci. EsakDocument105 pagesCm.2ci. EsakNoomen GalmamiPas encore d'évaluation

- Les erreurs fréquentes en Mathématiques du cycle secondaire: Enquête statistique - TOME IID'EverandLes erreurs fréquentes en Mathématiques du cycle secondaire: Enquête statistique - TOME IIPas encore d'évaluation

- CM1SH KefDocument84 pagesCM1SH KefNoomen GalmamiPas encore d'évaluation

- Val Rech Essaia 2021 Partie 2Document45 pagesVal Rech Essaia 2021 Partie 2amina imenePas encore d'évaluation

- Analyses Statitistiques Master Recherche 2020Document41 pagesAnalyses Statitistiques Master Recherche 2020FELICITE FODNE WAASOPas encore d'évaluation

- Cours 3Document65 pagesCours 3ms hadjerPas encore d'évaluation

- CM1 Quantit - CARTHAGEDocument85 pagesCM1 Quantit - CARTHAGENoomen GalmamiPas encore d'évaluation

- Choix Des Tests Et Analyses Statistiques V2Document88 pagesChoix Des Tests Et Analyses Statistiques V2carmen84100% (1)

- ADD Intro Et Chapitre PremierDocument6 pagesADD Intro Et Chapitre PremierSafae BelmazouziPas encore d'évaluation

- Le Data MiningDocument5 pagesLe Data MiningizmPas encore d'évaluation

- Atelier 3Document12 pagesAtelier 3limaPas encore d'évaluation

- Relation Entre Deux Variables QualitativesDocument10 pagesRelation Entre Deux Variables QualitativesDantePas encore d'évaluation

- Tests StatistiquesDocument11 pagesTests Statistiqueschouchou vetovet100% (1)

- CCM1Didactique. KefDocument79 pagesCCM1Didactique. KefNoomen GalmamiPas encore d'évaluation

- Test Khi Deux Test D Association Sous SPDocument21 pagesTest Khi Deux Test D Association Sous SPwalid ben abdallahPas encore d'évaluation

- Analyse Bivariee Miage Licence IIDocument75 pagesAnalyse Bivariee Miage Licence IIDonald KonePas encore d'évaluation

- Resume AddDocument3 pagesResume AddAya ElPas encore d'évaluation

- Serie5 - TP PS PDFDocument5 pagesSerie5 - TP PS PDFMarouane BenPas encore d'évaluation

- Tests Non ParamétriquesDocument36 pagesTests Non ParamétriquesNabila Mamzlle SukiPas encore d'évaluation

- Analyses de Variance - AnovaDocument12 pagesAnalyses de Variance - AnovaAnaHiyaMessaPas encore d'évaluation

- Tests Non Paramétriques - 16pagesDocument16 pagesTests Non Paramétriques - 16pagesLUCAS KONANPas encore d'évaluation

- Analyse Des DonnãesDocument26 pagesAnalyse Des DonnãesBayrem HarbaouiPas encore d'évaluation

- Statistiques en Recherche FondamentaleDocument53 pagesStatistiques en Recherche FondamentaleGuivis ZeufackPas encore d'évaluation

- Analyse de Données CoursDocument18 pagesAnalyse de Données CoursNeamaElaziz100% (1)

- Test de Student PDFDocument5 pagesTest de Student PDFVie PrivéPas encore d'évaluation

- Test de Student PDFDocument5 pagesTest de Student PDFVie PrivéPas encore d'évaluation

- Chapitre 4 StatistiqueDocument12 pagesChapitre 4 Statistiqueoussema waliPas encore d'évaluation

- Test Non Que Avec SpssDocument111 pagesTest Non Que Avec SpssGora MbenguePas encore d'évaluation

- Cours ADEBDocument9 pagesCours ADEBdeel braPas encore d'évaluation

- Comparaison Multiples de MoyennesDocument6 pagesComparaison Multiples de Moyennesmousdo100% (1)

- BiostatistiqueDocument9 pagesBiostatistiqueRabehi DhoPas encore d'évaluation

- Formation Vérification de Méthode ReduitDocument53 pagesFormation Vérification de Méthode ReduitAnonh AdikoPas encore d'évaluation

- Le Traitement Statistique PDFDocument5 pagesLe Traitement Statistique PDFZandry BefitiaPas encore d'évaluation

- Test SpycologieDocument9 pagesTest SpycologiefofanamgabonPas encore d'évaluation

- CCM2.Didactique KefDocument72 pagesCCM2.Didactique KefNoomen GalmamiPas encore d'évaluation

- Cours de Statistique Inferentielle 1 l2 LMD StatistiqueDocument38 pagesCours de Statistique Inferentielle 1 l2 LMD Statistiquepaulmonga2022Pas encore d'évaluation

- 2-Comparaison Des 2 MoyennesDocument39 pages2-Comparaison Des 2 MoyennesissamarPas encore d'évaluation

- Statistiq MedDocument29 pagesStatistiq Medtaoufik akabliPas encore d'évaluation

- For Participants Partie 2Document34 pagesFor Participants Partie 2Zahira SafouanPas encore d'évaluation

- ProbaDocument6 pagesProbaetoiledemer123Pas encore d'évaluation

- Notion D'erreurs en PhysiqueDocument10 pagesNotion D'erreurs en PhysiqueBertin YoudomPas encore d'évaluation

- Cours Biostat Master 1 Biochimie 2020Document51 pagesCours Biostat Master 1 Biochimie 2020Saif DzPas encore d'évaluation

- Teste StatistiqueDocument33 pagesTeste StatistiqueEmile Hans ObamePas encore d'évaluation

- Biostatistiques Descriptives DR Marc CUGGIA 1ere Annee Univ RennesDocument105 pagesBiostatistiques Descriptives DR Marc CUGGIA 1ere Annee Univ RenneslecteurscribdPas encore d'évaluation

- ANOVA A 1 Facteur Analyse de Variance OnDocument24 pagesANOVA A 1 Facteur Analyse de Variance Onkata brhPas encore d'évaluation

- Analyse de Données CoursDocument18 pagesAnalyse de Données CoursSlimani El Alaoui MohamedPas encore d'évaluation

- Résumé Anova Et Manova-1 PDFDocument4 pagesRésumé Anova Et Manova-1 PDFNorah SahwanePas encore d'évaluation

- Econométrie - Analyse DescriptiveDocument8 pagesEconométrie - Analyse DescriptiveGasy ManjabePas encore d'évaluation

- TP StataDocument8 pagesTP StataNiyonkuru Alain DanielPas encore d'évaluation

- ANOVAetudiantFPT Master PACQ 1Document17 pagesANOVAetudiantFPT Master PACQ 1Rim AbouttiPas encore d'évaluation

- Modélisation Des Montants de Sinistres Et Des Fréquences de SinistresDocument44 pagesModélisation Des Montants de Sinistres Et Des Fréquences de SinistresAmira Lya100% (6)

- Projet SPSS VFDocument8 pagesProjet SPSS VFEttalbiPas encore d'évaluation

- Cours StatistiquesDocument82 pagesCours StatistiquesYassine KoutounPas encore d'évaluation

- Notion de Test D - HypotheseDocument6 pagesNotion de Test D - HypotheseMahdi El BahiPas encore d'évaluation

- 4) AnovaDocument29 pages4) AnovaMina Ait KaddourPas encore d'évaluation

- Ficha 7.0702 31 Honda Civic TypeR GroupeA FN2Document20 pagesFicha 7.0702 31 Honda Civic TypeR GroupeA FN2HugoPas encore d'évaluation

- Bimetre Sage Attic PDFDocument8 pagesBimetre Sage Attic PDFsarraPas encore d'évaluation

- UntitledDocument3 pagesUntitledyeheph yehephPas encore d'évaluation

- Commandes Non Lineaires D'Un Redresseur PWM Triphase: ThemeDocument159 pagesCommandes Non Lineaires D'Un Redresseur PWM Triphase: ThemeSofiane ZozoPas encore d'évaluation

- TP6 Complx 2018-2019Document2 pagesTP6 Complx 2018-2019Hadjer KaddourPas encore d'évaluation

- TP Api IiDocument11 pagesTP Api IiAdem AounPas encore d'évaluation

- Fopc 0720916e 4241Document4 pagesFopc 0720916e 4241Cyrielle DomguePas encore d'évaluation

- Poinçonnement: LIM SovanvichetDocument13 pagesPoinçonnement: LIM SovanvichetPhal KhemraPas encore d'évaluation

- Cours Infographie 1Document129 pagesCours Infographie 1Saf BesPas encore d'évaluation

- Détection D'anomalies D'un Réseau Mobile MEGHERBI KHALEFDocument27 pagesDétection D'anomalies D'un Réseau Mobile MEGHERBI KHALEFminiya1703Pas encore d'évaluation

- Ex Ef PotenceDocument10 pagesEx Ef PotenceChafik BouguezourPas encore d'évaluation

- Exercice 1Document2 pagesExercice 1Nour elhoudaPas encore d'évaluation

- 06.0165 - Chambre D'essai Sous Vide (Avec Vaccuometre) - 2Document1 page06.0165 - Chambre D'essai Sous Vide (Avec Vaccuometre) - 2Ghilles PoloPas encore d'évaluation

- Fiche JavascriptDocument5 pagesFiche JavascriptA'ch RéfPas encore d'évaluation

- TP SemaphoresDocument2 pagesTP Semaphoresعضوش محمدPas encore d'évaluation

- C4 CdmaDocument20 pagesC4 CdmaF Nass BenPas encore d'évaluation

- Le But de Cette Épreuve Est de Déterminer Si Un Seul Feutre Effaceur Suffit Pour Effacer Le Contenu D'une Petite Cartouche D'encre BleueDocument4 pagesLe But de Cette Épreuve Est de Déterminer Si Un Seul Feutre Effaceur Suffit Pour Effacer Le Contenu D'une Petite Cartouche D'encre BleuePrescillia DieziaPas encore d'évaluation

- MedafDocument42 pagesMedafYesmine JasminePas encore d'évaluation

- RadjaZahia ZoutatAziza SilakhelYaminaDocument78 pagesRadjaZahia ZoutatAziza SilakhelYaminaLamia BekehchiPas encore d'évaluation

- Cours - Pic 16f628a PDFDocument11 pagesCours - Pic 16f628a PDFridofoxPas encore d'évaluation

- Hydrologie Statistique PDFDocument153 pagesHydrologie Statistique PDFAhlam RA100% (1)

- Capteurs/actuateurs Auto PDFDocument23 pagesCapteurs/actuateurs Auto PDFyassine89% (9)

- Scomazzon Pasal SMZ926Document225 pagesScomazzon Pasal SMZ926hiriPas encore d'évaluation

- l3 tm1 Chapitre1 Lecon 01Document10 pagesl3 tm1 Chapitre1 Lecon 01Fatima LagnaouiPas encore d'évaluation

- Doctorat BelhouchetDocument184 pagesDoctorat Belhouchetfootball goalPas encore d'évaluation

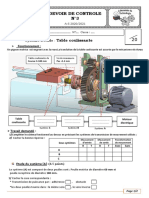

- Devoir de Controle N°3: Table CoulissanteDocument2 pagesDevoir de Controle N°3: Table CoulissanteTarekMostapha100% (1)

- Concours General Mathematiques 2002 SujetDocument5 pagesConcours General Mathematiques 2002 SujetkkstanPas encore d'évaluation

- Brochure Tech 2017 Techn Info Tournai 24pDocument28 pagesBrochure Tech 2017 Techn Info Tournai 24pDayang DayangPas encore d'évaluation

- PP2 Cor MathDocument69 pagesPP2 Cor MathtotoPas encore d'évaluation

- Tp1 BI-PythonDocument3 pagesTp1 BI-PythonHiba AmaraPas encore d'évaluation

- Les LES TRUCS MATHEMATIQUES AU PRIMAIRE: et si on leur donnait du sens!D'EverandLes LES TRUCS MATHEMATIQUES AU PRIMAIRE: et si on leur donnait du sens!Évaluation : 2 sur 5 étoiles2/5 (1)

- Enjeux contemporains de l'éducation scientifique et technologiqueD'EverandEnjeux contemporains de l'éducation scientifique et technologiqueAbdelkrim HasniPas encore d'évaluation

- Je me prépare aux examens du ministère en mathématiques: Es-tu prêt à passer le test ?D'EverandJe me prépare aux examens du ministère en mathématiques: Es-tu prêt à passer le test ?Évaluation : 4 sur 5 étoiles4/5 (1)

- Petit guide d'aromatherapie: ou de l'usage des huiles essentielles et de la phytothérapieD'EverandPetit guide d'aromatherapie: ou de l'usage des huiles essentielles et de la phytothérapiePas encore d'évaluation

- Les Êtres Vivants Dépendent De La Mécanique QuantiqueD'EverandLes Êtres Vivants Dépendent De La Mécanique QuantiquePas encore d'évaluation

- La particule de temps: Une approche quantique du tempsD'EverandLa particule de temps: Une approche quantique du tempsPas encore d'évaluation

- Pour une intervention précoce: Dépister, repérer, identifier les difficultés et les troubles d'apprentissage - guideD'EverandPour une intervention précoce: Dépister, repérer, identifier les difficultés et les troubles d'apprentissage - guidePas encore d'évaluation

- De la télépathie: Étude sur la transmission de la penséeD'EverandDe la télépathie: Étude sur la transmission de la penséePas encore d'évaluation

- Quand 7 x 6 = 37: Partir des connaissances des élèves pour enseigner les mathématiquesD'EverandQuand 7 x 6 = 37: Partir des connaissances des élèves pour enseigner les mathématiquesPas encore d'évaluation

- De la Télépathie : Étude sur la transmission de penséeD'EverandDe la Télépathie : Étude sur la transmission de penséeÉvaluation : 4 sur 5 étoiles4/5 (1)

- Le médecin quantique: Un docteur en physique quantique explique l’efficacité thérapeutique de la médecine intégraleD'EverandLe médecin quantique: Un docteur en physique quantique explique l’efficacité thérapeutique de la médecine intégralePas encore d'évaluation

- Représenter pour mieux raisonner: Résolution de problèmes écrits d'addition et de soustractionD'EverandReprésenter pour mieux raisonner: Résolution de problèmes écrits d'addition et de soustractionPas encore d'évaluation

- La LA RECHERCHE EN DIDACTIQUE DES MATHEMATIQUES ET LES ELEVES EN DIFFICULTE: Quels enjeux et quelles perspectives?D'EverandLa LA RECHERCHE EN DIDACTIQUE DES MATHEMATIQUES ET LES ELEVES EN DIFFICULTE: Quels enjeux et quelles perspectives?Pas encore d'évaluation

- La distinction entre falsification et rejet dans le problème de la démarcation de Karl PopperD'EverandLa distinction entre falsification et rejet dans le problème de la démarcation de Karl PopperPas encore d'évaluation

- Représenter pour mieux raisonner - Résolution de problèmes écrits de multiplication et de divisionD'EverandReprésenter pour mieux raisonner - Résolution de problèmes écrits de multiplication et de divisionPas encore d'évaluation

- Évaluations nationales des acquis scolaires, Volume 4: Analyser les données issues d'une évaluation nationale des acquis scolairesD'EverandÉvaluations nationales des acquis scolaires, Volume 4: Analyser les données issues d'une évaluation nationale des acquis scolairesPas encore d'évaluation

- Epistémologie de la gravité expérimentale: Rationalité scientifiqueD'EverandEpistémologie de la gravité expérimentale: Rationalité scientifiquePas encore d'évaluation

- Se SE PREPARER A ENSEIGNER LES MATHEMATIQUES AU PRIMAIRED'EverandSe SE PREPARER A ENSEIGNER LES MATHEMATIQUES AU PRIMAIREPas encore d'évaluation

- Mathématiques ludiques pour les enfants de 4 à 8 ansD'EverandMathématiques ludiques pour les enfants de 4 à 8 ansPas encore d'évaluation

- Les premiers apprentissages scolaires à la loupe: Des liens entre énumération, oralité et littératieD'EverandLes premiers apprentissages scolaires à la loupe: Des liens entre énumération, oralité et littératiePas encore d'évaluation