Académique Documents

Professionnel Documents

Culture Documents

Informations Générales: Business Intelligence Avec SQL Server 2019 Et Power BI

Transféré par

Piè CoulibalyTitre original

Copyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

Informations Générales: Business Intelligence Avec SQL Server 2019 Et Power BI

Transféré par

Piè CoulibalyDroits d'auteur :

Formats disponibles

Informations générales

Titre, auteur …

Business Intelligence avec SQL Server 2019 et Power BI

Maîtrisez les concepts et réalisez un système décisionnel

Ce livre sur la Business Intelligence (BI) avec SQL Server 2019, s'adresse à tous les membres d'une

équipe décisionnelle : chef de projet, architecte, développeur ETL, développeur de rapports, service

Aide à la Maîtrise d'Ouvrage (AMO). Du débutant au technicien expérimenté, le lecteur bénéficiera

d'une approche métier du décisionnel.

Tout au long du livre, et très progressivement, l'auteur détaille les concepts clés du décisionnel puis

les met concrètement en application. Ainsi, au cours des différents chapitres, le lecteur va utiliser les

différents outils de la suite SQL Server et Power BI pour bâtir progressivement un système

décisionnel complet et professionnel. À chaque chapitre, le livre regorge de solutions concrètes et de

bonnes pratiques. Le lecteur bénéficie des retours d'expérience de l'auteur pour finalement gagner

en expertise sur les différentes étapes d'un projet décisionnel.

Plus précisément, l'auteur propose de créer le système décisionnel d'une société virtuelle, Distrisys,

qui sera l'occasion pour le lecteur d'étudier les sujets suivants :

- l'architecture des serveurs et le choix des licences

- la modélisation de l'entrepôt de données

-

Conditions générales d'utilisation Copyright - ©Editions ENI

Avant-propos

À qui s’adresse ce livre ?

Ce livre s’adresse en premier lieu à tous les membres d’une équipe ayant pour objectif la mise en

œuvre d’un système décisionnel avec SQL Server.

Par membre de l’équipe décisionnel, nous entendons :

Le chef de projet, qui trouvera dans ce livre une approche méthodologique pour aborder la

conception du système décisionnel, ainsi qu’une vision d’ensemble sur les bonnes pratiques

d’implémentation des différents outils SQL Server.

L’architecte, qui trouvera des réponses très concrètes concernant l’architecture serveur,

l’architecture logicielle, le choix des outils de restitution, l’organisation des bases de données,

les bonnes pratiques de modélisation des bases décisionnelles…

Le développeur ETL, qui, quant à lui, trouvera dans ce livre un chapitre détaillant comment

utiliser l’outil d’ETL de Microsoft et rappelant tous les concepts du métier. Une partie

importante est consacrée à l’audit du système ETL : un sujet à grande valeur ajoutée dans le

cadre de la mise en place d’un projet d’alimentation de données.

Le développeur de rapports trouvera un chapitre consacré à la restitution de données ainsi que

tous les éléments pour choisir le bon outil de restitution. Il trouvera aussi des exemples concrets

mettant en œuvre tous les cas d’emplois offerts par les outils à disposition.

Le membre d’un service AMO ne connaissant pas particulièrement le décisionnel et désirant

réaliser un cahier des charges ou un appel à projet pour sélectionner un prestataire, y trouvera

tous les éléments pour comprendre le décisionnel, ses enjeux et comment aborder cette

problématique.

Enfin, ce livre s’adresse à toute personne connaissant la base de données SQL Server désirant

comprendre ce qu’est le décisionnel et apprendre à utiliser les outils SQL Server qui y sont associés.

Les débutants y trouveront des explications très détaillées, des actions et des manipulations à réaliser.

Les techniciens expérimentés, quant à eux, y trouveront une approche métier du décisionnel, très

complémentaire avec l’utilisation des outils, ainsi que des solutions pratiques pour implémenter ces

concepts.

Les étudiants enfin, y trouveront une approche et des mises en œuvre très concrètes, proches du

monde de l’entreprise. Ce livre est un bon moyen d’aborder l’état de l’art du décisionnel et pour

apprendre à utiliser des outils qu’ils côtoieront dans l’exercice de leur futur métier.

Les prérequis

Le seul prérequis nécessaire est d’être familier avec la base de données SQL Server, sans toutefois

en être un expert. Le livre est fait de telle manière que les bases et concepts liés au décisionnel sont

repris et expliqués.

Pour réaliser les manipulations et suivre le déroulement du livre, vous aurez besoin d’une installation

de SQL Server 2019 ainsi que d’Office 365 (Excel notamment).

Si besoin, vous pouvez télécharger ces solutions en version d’évaluation sur le site de

Microsoft : http://technet.microsoft.com/fr-fr/evalcenter/

Conditions générales d'utilisation Copyright - ©Editions ENI

Conditions générales d'utilisation Copyright - ©Editions ENI

Les objectifs du livre

Cet ouvrage n’a pas pour objectif de faire de vous des experts techniques sur chacun des outils de la

suite SQL Server, mais plutôt de vous apprendre à les comprendre et à bien les employer dans le cadre

de la mise en œuvre d’un système décisionnel.

Cet ouvrage se veut avant tout un support et un outil pour toute personne désirant réaliser un système

décisionnel avec Microsoft, en bénéficiant des meilleures pratiques. Les pratiques expliquées dans

l’ouvrage sont issues des théories du décisionnel mais aussi de leur application concrète sur le terrain.

Le livre suit la mise en œuvre concrète d’un système décisionnel au sein d’une société virtuelle, sous

tous ses aspects.

Les premiers chapitres vont vous permettre de vous familiariser avec le projet décisionnel :

Le chapitre Installation et découverte des outils SQL Server permettra de faire le point sur

l’architecture serveur et logicielle. Des propositions concrètes d’architecture vous seront proposées.

Le chapitre Réaliser son premier système décisionnel vous permettra de créer en quelques

manipulations un entrepôt de données avec son cube associé. Ce chapitre vous permettra ainsi de

vous familiariser avec les grands concepts du décisionnel et de les démystifier. Il vise à vous donner

les moyens de réaliser des maquettes ou de mener à bien des ateliers de modélisation.

Les chapitres suivants entreront dans les détails de chacune des phases clés d’un lot projet :

Le chapitre La modélisation dimensionnelle abordera les concepts ainsi que les bonnes

pratiques de modélisation. Nous vous fournirons très concrètement des modélisations standards

dont vous pourrez vous inspirer pour vos projets.

Le chapitre Alimenter l’entrepôt de données avec SSIS vous permettra d’aborder dans le

détail l’ETL : l’architecture d’alimentation des données, les différents types de flux et le système

d’audit. Ce chapitre regorge d’exemples illustrant chaque type de flux et chaque situation. Autant

d’exemples que vous pourrez réutiliser également directement sur vos projets.

Le chapitre Gérer les données de référence avec MDS vous présentera le concept de Master

Data Management (MDM). Vous y découvrirez la place et l’importance du MDM dans votre projet

décisionnel, comment constituer des données de référence et comment les gérer avec l’outil de

Microsoft. La mise en œuvre de MDS est réalisée simplement, progressivement, mais de manière

très concrète en bénéficiant des meilleurs retours d’expérience.

Le chapitre Restituer les données décisionnelles abordera le bon usage des outils Excel,

Reporting Services et Power BI. Vous apprendrez notamment à utiliser le PowerPivot, à réaliser la

publication de masse d’un rapport décisionnel et à créer un dashboard.

L’ensemble de ces chapitres est organisé logiquement afin de suivre le déroulement chronologique du

projet.

L’ouvrage ne traite pas spécifiquement des nouveautés de la version SQL Server 2019 par rapport aux

versions précédentes. Néanmoins, les lecteurs trouveront ici et là des éléments abordant ces

nouveautés.

Pour suivre au plus près le déroulement du livre, il est important que vous récupériez les éléments

accompagnant ce livre. Ces éléments sont à télécharger depuis la page Informations générales.

Tout d’abord, pour faire connaissance, nous allons commencer par vous présenter le décisionnel, ses

objectifs et les solutions délivrées par Microsoft pour y répondre. Ce sera aussi l’occasion de vous

présenter la société Distrisys, la société virtuelle qui sera au centre de nos attentions tout au long de

ces pages.

Conditions générales d'utilisation Copyright - ©Editions ENI

Introduction

Présentation du décisionnel

Cet ouvrage a pour but de montrer la manière dont il faut se servir des outils Microsoft SQL Server

afin d’aborder au mieux la problématique décisionnelle.

Avant de rentrer dans des considérations techniques, il est bon de faire un point sur ce qu’est le

décisionnel et ce que ce terme sous-entend.

Pour faire très simple, l’informatique décisionnelle recouvre tous les moyens informatiques destinés à

améliorer la prise de décision des décideurs d’une organisation.

Cette définition pose trois nouvelles questions :

Qu’est-ce qu’un décideur ?

Qu’est-ce qui peut permettre d’améliorer la prise de décision ?

Quels sont les moyens informatiques disponibles ?

L’informatique décisionnelle est souvent appelée BI pour Business Intelligence. Attention, le

décisionnel n’a strictement rien à voir avec une mauvaise traduction littérale de Business

Intelligence, qui serait « Intelligence économique ». Ne confondons pas tout !

1. La notion de décideur

Sous le modèle du taylorisme et jusque dans les années 80-90, les organisations étaient organisées de

manière pyramidale. Les décisions étaient prises au sommet de la pyramide et les ordres étaient

transmis de manière descendante et unilatérale à tous les niveaux opérationnels. Dans ce type

d’organisation, les décideurs étaient seulement les dirigeants de l’organisation.

Ce type d’organisation était efficace tant que le marché était localisé et qu’il suffisait de produire pour

vendre.

Depuis nous sommes confrontés à une complexité grandissante du marché liée :

À la mondialisation : les concurrents sont plus nombreux, plus innovants, mieux armés.

À une modification des comportements d’achats : l’organisation se doit d’être centrée sur le

client. En effet, les produits sont de plus en plus personnalisés (on parle de one-to-one).

Au fait que le monde va de plus en plus vite : le critère de délai de livraison ou de disponibilité

de l’information 7 jours du 7, 24h sur 24 associé à la mondialisation et la personnalisation du

besoin client, démultiplie la complexité de l’écosystème de l’organisation.

Afin de pouvoir répondre à cette complexité grandissante du marché, l’entreprise dans les années 90,

puis avec le web dans les années 2000 a amorcé une mutation de son organisation. Une des

conséquences de cette modification latente des organisations est que les cadres opérationnels sont

devenus autant de décideurs de terrain.

Dans une entreprise internationale, les responsables du marché français, japonais et indien sont

forcément des personnes distinctes. Les marchés sont trop différents. De même, dans cette même

entreprise, le responsable de l’unité parisienne est différent du responsable de l’activité à Nice sur le

littoral ou à Limoges dans le Limousin : les clients sont trop différents, leurs attentes, leurs

Conditions générales d'utilisation Copyright - ©Editions ENI

disponibilités diffèrent trop pour qu’une politique unique soit menée unilatéralement sans prise en

compte de cette différence.

Conditions générales d'utilisation Copyright - ©Editions ENI

Cette logique, facile à comprendre dans un cadre commercial, s’applique dans tous les domaines de

l’entreprise. La prise de décision ne peut plus être centrale, celle-ci doit être déléguée.

De fait, dans une entreprise moderne, tout cadre devient un décideur de terrain et dispose d’une

autonomie relative. C’est cette explosion du nombre de décideurs qui pose un gros problème à :

L’informatique, qui se voit démultiplier le nombre de demandes de rapports et d’extraction de

données.

La direction, qui a besoin d’outils pour manager ses décideurs : de la cohérence est nécessaire

afin que les décisions prises à tous les niveaux de l’entreprise, le soient en accord avec la

stratégie d’entreprise.

Cette problématique, liée à une démocratisation des outils décisionnels, a fait exploser la demande et

mis en avant au début des années 2000, ce besoin de décisionnel.

Face à ce constat, qui sont les décideurs dans une entreprise ?

On les classe en trois catégories :

Les décideurs stratégiques

Exemple : la direction générale dans une entreprise.

Horizon de travail : long terme.

Périmètre de travail : tous les services, tous les territoires.

Leur rôle : ces décideurs impulsent une politique, définissent les valeurs de l’organisation et

donnent les moyens aux ambitions de l’organisation.

Les décideurs tactiques

Exemple : sur un axe horizontal, on va retrouver la direction financière, la direction des achats, la

direction des ventes… Sur un axe vertical, pour chaque direction, on aura le responsable des ventes

France, le responsable des ventes Japon… Mais aussi, potentiellement, suivant la taille de

l’entreprise, le responsable Paris, Nice et Limoges…

Horizon de travail : moyen terme.

Périmètre de travail : un service ou un territoire.

Leur rôle : les décideurs tactiques sont les relais des caps stratégiques, fixés par les décideurs

stratégiques. Ce sont eux qui fixent les objectifs de leur direction ou de leur territoire, qui

élaborent et choisissent la meilleure tactique pour atteindre ces objectifs.

Les décideurs opérationnels

Exemple : un commercial, un acheteur, un responsable de magasin, l’agent de maîtrise d’une ligne de

production ou d’un atelier... Ce sont toutes ces personnes qui prennent des décisions à chaud sur le

terrain.

Horizon de travail : court terme.

Périmètre de travail : un service sur un territoire.

Leur rôle : faire face à la réalité du terrain, gérer le quotidien.

À ces trois profils de décideurs s’ajoute celui des analystes. Le rôle des analystes est de récolter et de

travailler l’information, fiabiliser les données, expliquer les résultats. Leur rôle est d’aider à la prise de

Conditions générales d'utilisation Copyright - ©Editions ENI

décision des décideurs. Les analystes varient suivant le type d’organisation (industrie, négoce, service

public…) et le service auquel ils appartiennent.

Conditions générales d'utilisation Copyright - ©Editions ENI

Par exemple, les analystes de la direction financière sont des contrôleurs de gestion, ceux du service

marketing peuvent être statisticiens, dans une société industrielle l’analyste peut être aussi un

qualiticien ou un gestionnaire des stocks… Dans beaucoup d’entreprises, ce sont les secrétariats de

direction qui récoltent les chiffres et les consolident pour leur directeur de rattachement. Enfin,

depuis l’émergence du Big Data, les métiers de Data Analyst (analyste des données) et de Data

Scientist apparaissent de plus en plus dans les moyennes et grandes entreprises.

Il est important d’identifier les analystes dans l’organisation dans laquelle vous intervenez, car ce

sont de très loin les utilisateurs les plus demandeurs d’informations.

Cette classification a de l’importance, car elle va révéler de grosses différences dans le type

d’outils dont chacun a besoin. Bien entendu, les choses ne sont pas aussi binaires : certaines

personnes relèveront du stratégique/tactique, d’autres du tactique/opérationnel… Toutes les nuances

sont permises. Ce qu’il faut bien comprendre, c’est que la notion de prise de décision pour chacun de

ces décideurs n’a pas la même teinte et que chaque profil n’a pas les mêmes attentes vis-à-vis du

décisionnel.

2. Les facteurs d’amélioration de la prise de décision

Généralement, on présente les trois facteurs de prise de décision comme étant :

La connaissance et l’analyse du passé.

La représentation du présent.

L’anticipation du futur.

Les informations permettant d’appréhender ces facteurs peuvent être de deux natures différentes :

Les informations quantitatives : ce sont toutes les données chiffrées telles que les montants,

quantités, pourcentages, délais…

Les informations qualitatives : ce sont toutes les informations non quantifiables telles qu’un

commentaire accompagnant un rapport, des mécontentements, un sentiment, une directive, une

nouvelle procédure…

Ces facteurs n’ont pas le même sens suivant le type de décideur. Leurs horizons fonctionnels et

temporels sont trop différents pour être traités de manière uniforme.

Conditions générales d'utilisation Copyright - ©Editions ENI

Conditions générales d'utilisation Copyright - ©Editions ENI

Les décideurs stratégiques ont besoin d’une vision à 360° de leur organisation. S’ils ont besoin d’une

évaluation régulière de leur politique, ils travaillent surtout sur l’anticipation de l’avenir. Ils ont besoin

de projections chiffrées internes et externes à l’organisation (données quantitatives), mais aussi de

beaucoup de données qualitatives remontant du terrain : commentaires, comptes-rendus. La conviction

repose sur des chiffres, mais aussi sur l’appréhension et la compréhension d’un contexte et d’un climat

interne ou externe à l’organisation.

Les décideurs tactiques sont souvent les plus grands demandeurs d’outils décisionnels, car ils sont

comprimés entre des décideurs stratégiques, qui leur demandent des évaluations de leur politique, et

des décideurs de terrain, parfois très nombreux, qu’il faut cadrer et suivre. Ces décideurs tactiques ont

besoin d’une parfaite compréhension du passé, travaillent peu avec le présent, mais se doivent de

travailler avec des prévisions pour recadrer leur politique. Les données chiffrées sont bien

évidemment essentielles, encore faut-il que les différents systèmes s’accordent entre eux.

Les décideurs opérationnels travaillent surtout avec le présent : il leur faut des données opérationnelles

brutes instantanées. L’analyse du passé relève surtout d’un suivi opérationnel pour vérifier

l’adéquation avec les objectifs. L’anticipation de l’avenir relève de la fourniture de données

opérationnelles en amont du service.

Par exemple, s’il y a beaucoup de prises de commandes lors d’une journée, le responsable d’un

centre logistique sait que le lendemain ou la semaine suivante la charge de son service va augmenter.

Pour les décideurs tactiques et opérationnels, les informations qualitatives quant à elles ne sont pas

uniquement dans les systèmes informatiques traditionnels : elles sont dans les mails, dans les réseaux

sociaux et circulent de vive voix.

Pour être concret, la plupart des cadres d’entreprise arrivent le matin à leurs bureaux. Ils déposent

leurs affaires, puis allument leur ordinateur pour consulter leurs mails.

Ils vont ensuite à la machine à café pour discuter du dernier mail ou de l’information de la veille. Ils

règlent certaines de leurs affaires à cette occasion, mais découvrent aussi d’autres problèmes. Enfin,

ils reviennent à leurs bureaux pour traiter les problèmes qu’on leur a soumis. Ils font le nécessaire

pour obtenir et consulter des données chiffrées. Ils analysent puis retravaillent ces informations

chiffrées. Enfin, après réflexion, ils prennent leur décision sur la base de ces données.

Le problème, c’est que ces cadres ne connaissent pas la fiabilité des données à leur disposition. De

plus, chaque fichier contient une information dense mais qui pourtant, ne révèle qu’une information

partielle. Il faut alors croiser des données de différents fichiers, émis par des services distincts, pour en

avoir une vue complète. Cela n’est pas toujours très facile à faire. L’autre problème consiste à obtenir

les données. Dans certaines organisations, la recette de la conception des chiffres et plus encore la

possession de ces mêmes chiffres est un enjeu de pouvoir important. Enfin dans de nombreuses

organisations, les chiffres émis par un service sont systématiquement contestés par les autres. Les

réunions de comité de direction se transforment dans certaines entreprises en dialogue de sourds car

chacun reste sur sa position et estime être celui qui possède le bon chiffre.

Dans ce contexte, prendre des décisions sur des données fiables et en toute sérénité relève du parcours

du combattant.

Conditions générales d'utilisation Copyright - ©Editions ENI

Sachez que vous pouvez avoir confiance en chacune des décisions que vous prenez, dès l’instant que

vous avez :

La certitude que vos données sont fiables, à jour et complètes.

Les capacités de comprendre l’origine d’un succès ou d’une défaillance.

Les moyens d’évaluer les plans d’action et les politiques mises en œuvre consécutivement à une

décision.

Dès lors, la mise en place d’outils décisionnels doit permettre de répondre progressivement à ces trois

attentes :

Améliorer l’accès et la qualité des données.

Gagner en finesse d’analyse et de compréhension de données.

Gérer les performances de l’organisation et de ses politiques.

3. L’informatique décisionnelle

L’informatique décisionnelle couvre toutes les solutions informatisées pour améliorer la prise de

décision des décideurs dans l’organisation.

Dans ses débuts, l’informatique décisionnelle s’est contentée tout d’abord de dupliquer les bases de

données des systèmes de gestion, afin d’isoler les requêtes d’analyse de données des

requêtes opérationnelles. Les requêtes d’analyse étant souvent très lourdes, l’objectif était surtout de

préserver les performances des systèmes opérationnels. Ensuite, cette base de données dédiée aux

requêtes et à l’analyse a progressivement muté et s’est organisée.

Partant du constat qu’il est difficile de croiser des données contenues dans des bases de données

distinctes, le plus simple a été de regrouper ces données éparses. Le concept de la base unique

pour centraliser les données de l’entreprise est plus que jamais d’actualité. Il s’agit du concept

d’entrepôt de données (ou Data Warehouse).

S’il est plus simple d’analyser ces données une fois qu’elles sont dans l’entrepôt de données, il n’en

reste pas moins qu’il faut tout de même remplir l’entrepôt de données. L’extraction et le croisement

des données des différents systèmes opérationnels puis le chargement dans l’entrepôt de données, ont

fait émerger des outils dédiés à cette tâche, avec des concepts métiers qui leur sont propres : les outils

d’ETL (Extract Transform Load).

Si au début les requêtes d’analyses portaient sur une base relationnelle (dites OLTP pour OnLine

Transaction Processing), le concept de base multidimensionnelle (dites OLAP pour OnLine

Analytical Processing) s’est démocratisé fin des années 90. Ce concept de bases de données offrait des

performances très largement supérieures aux bases OLTP pour répondre à des requêtes d’analyse. Ces

bases OLAP se sont alors couplées avantageusement avec l’utilisation de l’entrepôt de données. En

effet, elles offraient à la fois un environnement plus performant, mais permettaient également aux

utilisateurs finaux de bénéficier d’une interface simplifiée d’accès aux données, beaucoup plus

intuitive qu’une base de données OLTP. On parle alors de métamodèle. Enfin, vers la fin des années

2010, les éditeurs ont proposé des métamodèles montés directement en mémoire pour encore plus de

performance.

Conditions générales d'utilisation Copyright - ©Editions ENI

Attention, suivant les éditeurs, les métamodèles ne reposent pas forcément sur des bases

multidimensionnelles. Les métamodèles peuvent utiliser les technologies OLTP (de moins en

moins), OLAP ou "In Memory".

Conditions générales d'utilisation Copyright - ©Editions ENI

L’ensemble des moyens informatiques et techniques destiné à améliorer la prise de décision est appelé

système décisionnel ou encore Système Informatique d’Aide à la Décision (SIAD).

Architecture technique d’un système décisionnel

Si l’informatique décisionnelle s’est contentée dans ses débuts d’une approche technicienne, elle

progresse et converge de plus en plus rapidement vers le poste utilisateur et s’adapte aux métiers des

utilisateurs. Nous sommes encore aujourd’hui dans cette phase de convergence.

Vous le comprendrez, dans le contexte actuel, les décideurs étant de natures très différentes, les outils

de restitution sont multiples afin de convenir et répondre à toutes les attentes des différents acteurs de

la prise de décision.

On dénombre sur le poste de travail des outils de natures très variées :

Les outils de reporting pour délivrer une information opérationnelle ou une information

décisionnelle de suivi d’activité. Dans le cadre du reporting décisionnel, il s’agit notamment de

reporting de masse destiné à la publication d’un rapport personnalisé vers de nombreux

utilisateurs avec un profil de décideur opérationnel.

Les outils d’analyse pour comprendre et appréhender une situation passée. Les outils d’analyse

reposant sur un métamodèle (OLAP ou en mémoire) pour des performances optimales. Ces

outils doivent permettre aux analystes de naviguer et d’explorer les données disponibles

facilement, rapidement et en toute autonomie.

Conditions générales d'utilisation Copyright - ©Editions ENI

Le métamodèle favorise l’utilisation d’outils d’analyse. Attention, le métamodèle n’est pas un

outil d’analyse en soi. Que serait un système de gestion (type ERP ou CRM), si on ne livrait aux

utilisateurs que la base de données sans les interfaces…

Les outils de statistiques pour modéliser des situations ou des comportements, pour tenter de les

anticiper. On parle actuellement d’apprentissage machine ou d’intelligence artificielle.

Les outils de tableaux de bord et de pilotage pour assurer l’alignement des objectifs stratégiques,

tactiques et opérationnels de l’organisation et permettre le suivi des politiques.

Les outils d’intranet pour partager l’information dans l’entreprise, favoriser la production

d’informations qualitatives (wiki, blog, forum, enquêtes…) et associer informations qualitatives

et quantitatives. L’objectif de l’intranet, dans une optique décisionnelle, est de favoriser

l’émergence de véritables espaces de prises de décision, personnalisés à un service et/ou à un

utilisateur. L’intranet est aussi le relais idéal du décisionnel lorsqu’il s’agit de mettre en œuvre

les actions correctrices et bien entendu de les suivre.

Les outils de restitution suivant les profils d’utilisateurs

Dans la section suivante nous allons voir comment Microsoft articule sa solution pour répondre à ces

exigences, tant techniques que fonctionnelles.

Conditions générales d'utilisation Copyright - ©Editions ENI

La solution Microsoft BI

1. L’offre Microsoft BI

Microsoft n’est pas un nouveau venu dans le monde de la BI. Depuis le tout début des années 2000, il

en est même un acteur majeur et ce, grâce à sa base OLAP Analysis Services et au tableau croisé

dynamique Excel.

Bien entendu, son offre s’est largement étendue et structurée depuis, avec le développement de ce

marché. Il est à noter tout de même que Microsoft a largement contribué à démocratiser le recours à

l’informatique décisionnelle dans les sociétés de taille moyenne, ainsi que dans les PME.

Sur le fond, l’offre Microsoft BI est structurée autour des trois promesses du décisionnel :

Améliorer l’accès et la qualité des données : on y retrouve tous les outils destinés à concevoir un

entrepôt de données bien modélisé, performant et contenant des données fiabilisées. On y

retrouve aussi tous les outils permettant d’identifier et de gérer les données de référence et de

s’assurer de leur qualité.

Gagner en finesse d’analyse et de compréhension de données : on y retrouve tous les outils qui

permettent aux utilisateurs finaux d’analyser et de naviguer dans leurs données en toute

autonomie, sans avoir à recourir au service informatique.

Gérer les performances de l’organisation et de ses politiques : on y retrouve tous les outils

destinés à partager, à communiquer et à organiser les performances de l’organisation tels que les

outils de tableaux de bord et les outils collaboratifs.

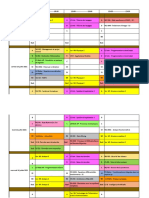

Sur la forme, l’offre Microsoft BI est structurée au sein de trois licences. Chacune de ces licences

contient de nombreux outils à usage décisionnel correspondant aux tâches énoncées plus haut :

SQL Server 2019 : Integration Services, Master Data Services, Analysis Services, Reporting

Services, Data Quality Services.

Office 365 : Excel, SharePoint et Teams.

Power Platform : Power BI, Power App, Power Automate.

Si les outils de la gamme SQL Server 2019 sont plutôt des produits techniques destinés, à l’usage, au

service informatique, les outils Office 365 sont plus spécifiquement destinés aux utilisateurs finaux et

les produits de la gamme Power Platform à des utilisateurs d’un niveau intermédiaire.

Dans la suite de cette partie, nous allons étudier le contenu, l’utilisation et le positionnement de

chacune de ces solutions.

Conditions générales d'utilisation Copyright - ©Editions ENI

L’utilisation des licences Microsoft suivant les profils utilisateurs

Conditions générales d'utilisation Copyright - ©Editions ENI

2. SQL Server 2019

Si à l’origine, la licence SQL Server correspond uniquement à une base de données relationnelle

(OLTP), assez rapidement la licence s’étoffe pour couvrir l’ensemble des outils dédiés au stockage et

au traitement de données. Dans le langage courant, SQL Server évoque la base de données

relationnelle. Il existe néanmoins d’autres outils ou services couverts par cette même licence, dont la

plupart trouve un usage dans le cadre de la mise en œuvre d’un système décisionnel.

Nous ne nous attarderons donc pas sur le service de base de données relationnelle, qui a maintenant

fait ses preuves face à la concurrence. La base de données est fiable, performante et hautement

disponible. Le service de base de données est parfaitement indiqué pour accueillir un entrepôt de

données. On retrouve d’ailleurs des entrepôts de données sous SQL Server Database Services dans de

grandes banques nationales, dans de grands consortiums hospitaliers, dans la grande distribution, dans

des sociétés de télécom et de téléphonie… SQL Server se retrouve dans les sociétés et organisations

de toutes les tailles et dans tous les domaines d’activité.

Nous avons vu précédemment que la construction d’un système décisionnel ne se limite pas à

l’utilisation d’une base de données relationnelle. Avec la licence SQL Server, Microsoft nous livre

toute la panoplie d’outils dont un service informatique a besoin pour bâtir un système décisionnel dans

les règles de l’art.

Pour bâtir notre système d’aide à la décision, nous aurons besoin de :

SQL Server Integration Services : l’ETL.

SQL Server Master Data Services : le gestionnaire des données de référence.

SQL Server Analysis Services : la base de données multidimensionnelle (OLAP) et le

métamodèle.

SQL Server Data Quality Services : la base de connaissances permettant de qualifier et nettoyer

certaines données constitutives de vos référentiels de données ou des bases marketing.

SQL Server Reporting Services : l’outil de reporting opérationnel et de reporting de masse.

Dans les sections qui suivent, nous allons présenter plus en détail chacun de ces outils.

a. SQL Server Integration Services

Nous avons expliqué précédemment que les concepts du décisionnel prennent racine dans le fait de

bénéficier d’entrepôt de données contenant et croisant des données provenant de systèmes sources très

hétérogènes.

Si la grande valeur ajoutée du décisionnel est d’accéder confortablement aux données contenues dans

l’entrepôt de données, il n’en reste pas moins que la majeure partie d’un projet décisionnel se situe

dans l’alimentation de l’entrepôt de données et la mise à jour des données de référence.

En effet, la constitution des données de référence et l’alimentation d’un entrepôt de données

représentent généralement près de 80 % de la charge du projet. De prime à bord, beaucoup de services

informatiques qui découvrent le décisionnel ont largement tendance à sous-estimer le temps nécessaire

à récupérer l’information, mais aussi à la croiser.

Conditions générales d'utilisation Copyright - ©Editions ENI

Pour nous aider dans cette tâche, Microsoft met à notre disposition, dans la licence SQL Server 2019,

un outil d’ETL (Extract Transform Load) : SQL Server Integration Services (SSIS).

Déroulement d’un flux ETL sous SSIS

Même s’il n’est pas considéré comme le meilleur ETL du marché, il n’en reste pas moins que SSIS est

un véritable outil d’ETL, fiable, performant, et qu’il remplit parfaitement le rôle pour lequel il est

destiné. SSIS est d’ailleurs largement déployé et employé dans de très nombreuses entreprises

françaises et étrangères.

Nous ne vous conseillons pas d’acheter la licence SQL Server 2019 pour bénéficier

spécifiquement de SSIS, surtout, si vous travaillez sur un décisionnel en environnement Linux

avec des technologies open source... En revanche, si vous avez pour projet de bâtir un système

décisionnel en environnement Microsoft, le rapport qualité-prix de l’outil est véritablement

imbattable.

Le point fort de SSIS est que c’est d’une part un bon ETL et qu’il est d’autre part disponible sans

surcoût avec la licence SQL Server. Une licence que la plupart des entreprises disposent déjà afin

de bénéficier de la base de données relationnelle.

Plus que l’outil, c’est la manière dont est employé l’ETL qui est très importante. À ce propos, le

chapitre Alimenter l’entrepôt de données avec SSIS, reviendra assez largement sur le sujet afin de

vous donner les bonnes pratiques d’usage. Nous vous invitons donc à consulter ce chapitre, à la fois

pour découvrir les bonnes pratiques de l’ETL et pour apprendre à vous familiariser avec SSIS.

Conditions générales d'utilisation Copyright - ©Editions ENI

Généralement, on attend d’un outil d’ETL :

Qu’il accélère le travail de développement des flux de données : SSIS est un ETL assez simple

d’utilisation. Sa prise en main est rapide. SSIS, comme les grands ETL, permet de découper un

flux d’alimentation en une multitude de petites tâches de transformation de données distinctes et

ordonnancées. L’amélioration de la productivité vient du fait qu’il est plus facile de traiter une

multitude de problèmes très simples, plutôt que de traiter un grand problème très compliqué.

SSIS permet aussi de suivre très précisément le déroulement du flux de données. Entre chaque

tâche de transformation de données, il est possible de visualiser les valeurs, ainsi que les

transformations qui leur ont été appliquées.

Qu’il offre une vision claire et maintenable des flux réalisés : SSIS, comme tout bon ETL,

permet d’obtenir une visualisation graphique, logique et simple des flux réalisés. Les règles de

transformation pouvant être parfois très compliquées, il est important qu’elles puissent être

représentées simplement afin que n’importe quel informaticien, disposant d’une formation ETL,

puisse lire et comprendre le déroulement d’un flux de données. Chaque tâche de

transformation est représentée par une boîte que le développeur a la liberté de nommer ou plutôt

de décrire. Développer un flux ETL avec SSIS ne nécessite pas de notions de développement

objet ni même d’un grand savoir-faire SQL. Un flux SSIS correctement développé et respectant

la logique ETL est un flux vraiment très lisible et facilement maintenable.

Qu’il puisse se connecter et travailler avec de nombreuses sources hétérogènes : le propre d’un

ETL est d’être ouvert et de pouvoir disposer d’une certaine universalité de connexion. SSIS ne

déroge pas à cette règle, il permet entre autres de se connecter nativement à :

de nombreuses bases relationnelles par OLEDB : SQL Server, Oracle, DB2…

des fichiers : fichier plat CSV, fichier XML, fichier Excel.

des sources en ligne : services web, service FTP.

etc.

La liste est bien entendu loin d’être exhaustive. Les connecteurs sont cependant de qualité très inégale,

mais comme tous les produits Microsoft, le produit est ouvert et la communauté de développeurs est

assez efficace. Vous trouverez sur le marché de nombreux autres composants, connecteurs ou tâches,

et vous disposerez de la possibilité de créer le vôtre en .NET si vraiment cela s’avère nécessaire. Ce

qui est en définitive assez rare toutefois.

Au cours de nos projets, nous avons eu par exemple à développer une tâche récupérant les fichiers

en pièces jointes des mails d’une boîte aux lettres électronique. Le besoin est peu banal mais la

réalisation a été simple.

Qu’il soit performant : un ETL dispose souvent de fenêtres de traitement très courtes pour se

connecter à un système source et pour charger l’entrepôt de données. Il faut alors que l’outil

traite de très gros volumes, très rapidement. Le secret de la performance des outils d’ETL

réside généralement dans leur capacité à travailler et faire les transformations sur les données en

mémoire vive. C’est le cas de SSIS, qui dispose d’ailleurs de nombreuses possibilités de gestion

et d’optimisation du cache.

Qu’il dispose de nombreuses fonctionnalités de transformation de données : en ce qui concerne

la lettre T de ETL, SSIS est plutôt bien fourni et propose de nombreuses tâches de

transformation : calcul, contrôle, mise en cohérence des données, conversion, pivotement,

union, jointure, nettoyage, regroupement, échantillonnage… SSIS intègre de plus en plus de

tâches de transformation avancées issues de la statistique, pour vous permettre de mieux

nettoyer vos données ou contrôler leurs contenus.

Conditions générales d'utilisation Copyright - ©Editions ENI

Qu’il puisse se déployer facilement : SSIS gère parfaitement les problématiques de multi-

environnements et de déploiement sur un environnement de production. Les flux se lancent et se

planifient, soit par le biais de l’agent SQL fourni et intégré à SQL Server, soit par le biais d’une

ligne de commande exécutable, si vous disposez de votre propre ordonnanceur d’entreprise.

Conditions générales d'utilisation Copyright - ©Editions ENI

Enfin SSIS permet de mettre en œuvre pleinement les concepts du métier : audit de données,

historisation des dimensions (SCD), traitement des erreurs et des rejets... En ce qui concerne la gestion

d’erreur, SSIS gère l’erreur au niveau de chacune de ses tâches et potentiellement au niveau de

chacune des lignes chargées. SSIS vous permet ainsi de mettre en place des systèmes d’audit de flux

et de données performants et entièrement personnalisés à votre activité et à votre problématique.

Cependant, ce genre de système n’est pas quelque chose de standard inclus magiquement dans un

outil, il vous faudra le mettre en place. Nous vous incitons à consulter sur ce sujet le chapitre

Alimenter l’entrepôt de données avec SSIS - L’audit des flux ETL.

b. SQL Server Master Data Services

SQL Server Master Data Services (MDS) est disponible depuis la version SQL Server 2019. Ce

service est une solution de MDM (Master Data Management) ou Management des données de

référence.

La gestion des données de référence n’est pas exclusive au système décisionnel. Il s’agit plutôt d’une

pratique d’urbanisation des systèmes d’information qui contribue sensiblement à la qualité de

l’information dans l’entreprise.

Les données de référence sont les données transversales de l’entreprise. Ce sont les éléments clés qui

décrivent et définissent un domaine de l’entreprise : clients, produits, fournisseurs, sites,

organisations, services, employés…

Gérer ces données de référence devient primordial pour la plupart des entreprises qui ont une

organisation cloisonnée des données.

Une société multinationale qui dispose d’un ERP, d’une GPAO ou d’un CRM pour chacune de ses

filiales, est forcément confrontée à un moment ou un autre à des problèmes de redondance ou

d’incohérence de données. Le risque est le même chaque fois qu’une organisation fait le choix de

déployer une solution spécialisée pour gérer une activité spécifique de son activité : déployer un CRM

pour les commerciaux, une GPAO pour la production, une GMAO pour les services maintenance, un

logiciel de paie spécifique à une branche d’activité… Lors de chaque déploiement, les données de

référence sont alors dupliquées. Si l’on n’y fait pas attention, il devient rapidement extrêmement

complexe de rapprocher les données de ces différents systèmes.

Le MDM regroupe les pratiques, méthodes et outils qui permettent de rassembler, gérer et partager les

données pour lesquelles il est primordial de fournir à l’ensemble de l’organisation une vision contrôlée

et unique. Le rôle du MDM est de fournir aux différents systèmes des données de référence exactes,

complètes et actualisées.

Le MDM crée une ressource centralisée, indépendante des applications et des processus métier, qui

gère le cycle de vie des données de référence.

Avec la mise en place d’une telle pratique impliquant les services fonctionnels et le service

informatique, la cohérence des données dans les divers systèmes de transactions et d’analyses est

garantie. Ainsi, les problèmes de qualité des données peuvent être résolus de manière proactive, plutôt

qu’après coup dans l’entrepôt de données.

Microsoft fournit donc à travers MDS, une solution informatique appuyant et permettant la mise en

œuvre d’une démarche de MDM dans votre organisation. Le MDM n’est pas spécifiquement l’objet

de l’ouvrage, mais elle est abordée dans le chapitre Gérer les données de référence avec MDS. En

effet, il est essentiel que vous compreniez l’importance et l’intérêt d’une telle solution lors du

déploiement de votre système décisionnel. Le rapprochement des données entre les différents

Conditions générales d'utilisation Copyright - ©Editions ENI

systèmes est l’un des principaux enjeux de l’ETL, mais aussi l’une des raisons majeures des délais de

développement ETL.

Conditions générales d'utilisation Copyright - ©Editions ENI

Lorsque vous serez confronté à un projet d’entrepôt de données, une des phases techniques préalables

de votre projet consistera à identifier les données de référence. Et si celle-ci ne sont pas définies, il

vous faudra alors les créer, les alimenter et les mettre à jour et ce, avant même d’avoir créé la base de

données de l’entrepôt de données. L’outil SQL Server Master Data Services vous sera alors d’une

bonne aide pour faire émerger ce nouveau système dans votre organisation. Un peu comme SSIS,

MDS n’est pas la meilleure solution du marché, mais elle s’avèrera très suffisante pour la grande

majorité des organisations et dispose d’un rapport qualité-prix inégalable. C’est la solution idéale pour

faire émerger un projet de MDM en douceur, en parallèle du projet décisionnel.

Interface d’administration de MDS

Avec MDS, vos utilisateurs vont aussi apprécier de retrouver leurs données de référence dans Excel.

La gestion de ces données se fera directement depuis un classeur Excel, facilitant ainsi la conduite du

changement et l’adoption du MDM dans votre organisation.

La gestion des données de référence dans Excel avec MDS

Conditions générales d'utilisation Copyright - ©Editions ENI

c. SQL Server Data Quality Services

Cette solution permet de contrôler et d’améliorer la qualité des données qui circulent au sein de

l’organisation à l’aide de bases de connaissances liées au contenu et à la structure de vos données.

Typiquement, on peut utiliser DQS pour dé-doublonner une base client, contrôler le format d’un

numéro de téléphone ou d’un code postal, qui doivent être composés de 10 et 5 chiffres. On peut

également implémenter des contrôles plus fonctionnels, comme par exemple un employé ne peut pas

avoir plus de 90 ans et moins de 16 ans.

Les bases de connaissances vont également vous permettre de capitaliser sur la correction des erreurs.

Ainsi, une correction manuelle d’une erreur pourra être transformée en règle qui corrigera ensuite

automatiquement toute donnée comportant la même anomalie.

Cette solution trouve tout son sens dans la constitution de fichier client ou lors de la récupération de

données provenant de fichiers non structurés saisis par divers employés, fournisseurs ou partenaires.

Dans ce cas, DQS offre la possibilité d’auditer une base ou un fichier pour vous signaler tous les

champs en désaccord avec la base de connaissances.

Cette base de connaissances employée conjointement avec MDS et SSIS va permettre d’identifier la

non-qualité des données et faciliter le travail de nettoyage des fichiers client, prospect, employé...

Mais l’utilisation dans le cadre d’un projet strictement décisionnel est limitée ou du moins annexe,

nous ne l’aborderons donc pas dans cet ouvrage.

Base de connaissances DQS

Conditions générales d'utilisation Copyright - ©Editions ENI

d. SQL Server Analysis Services

SQL Server Analysis Services regroupe en fait plusieurs services destinés à faciliter l’exploration

d’une quantité importante de données.

Les trois facettes de la solution sont :

Le mode multidimensionnel

Le mode exploration de données ou data mining

Le mode tabulaire

Le mode multidimensionnel

Il s’agit du mode historique de SQL Server Analysis Services (SSAS). C’est ce mode-ci que l’on

désigne peut-être abusivement sous la dénomination SSAS.

Dans ce mode, SQL Server Analysis Services (SSAS) est la base multidimensionnelle (OLAP) de la

licence SQL Server. On présente souvent SSAS comme étant la solution de cubes de Microsoft. SSAS

est une solution parfaitement fiable et très robuste, leader de son marché.

Interface de conception Analysis Services

Avec l’augmentation des volumes de données, les bases de données OLAP se sont imposées comme

des solutions incontournables pour représenter les données contenues dans l’entrepôt de données. À

l’opposé des bases OLTP, plus les requêtes utilisateurs portent sur des données globales et agrégées,

plus la réponse est rapide. À l’inverse, plus la requête porte sur les données de détails, moins la

requête est performante. Il ne faut donc pas considérer Analysis Services comme une base de données

permettant des extractions de données. Les modèles Analysis Services doivent être conçus pour

fournir la finalité de l’analyse attendue par l’utilisateur.

Conditions générales d'utilisation Copyright - ©Editions ENI

Les données détaillées de l’entrepôt de données sont contenues dans la base relationnelle, mais

c’est Analysis Services qui les agrège et les présente aux utilisateurs finaux. Étant la partie émergée de

l’entrepôt de données, il offre ainsi la possibilité de gérer véritablement de très grands volumes de

données avec des temps de réponse de l’ordre de la seconde.

Les résultats sont souvent jugés époustouflants pour des utilisateurs habitués à travailler avec des

bases de données OLTP. SSAS ne craint pas les gros volumes de données, il est conçu pour cela.

Attention toutefois à conserver une modélisation appropriée, car la performance de son moteur OLAP

est directement liée à la modélisation de la base de données sous-jacente.

Nous ne saurions que trop insister tout au long de l’ouvrage sur l’importance de la modélisation de

l’entrepôt de données. Nous vous suggérons à ce sujet les chapitres Réaliser son premier système

décisionnel, puis La modélisation dimensionnelle, pour vous apprendre à concevoir des modèles

d’analyse cohérents et performants.

Les données de l’entrepôt de données étant manipulées directement et exclusivement par le biais

d’Analysis Services, celui-ci offre aux utilisateurs une interface simplifiée d’accès aux données et

intuitive. Dans les faits, les utilisateurs n’accèdent pas directement à Analysis Services. Ce sont les

outils de restitution qui proposent et consomment les données du cube. Il est donc indispensable,

lorsque vous mettez en place SSAS, de proposer parallèlement aux utilisateurs, des outils de

restitution adaptés (par exemple Excel).

Analysis Services est l’interface entre l’entrepôt de données et les outils de restitution

Le mode tabulaire

Le mode tabulaire de SQL Server Analysis Services a été une nouveauté de la version 2012, et c’est la

plus grande évolution de SQL Server Analysis Services depuis la version 2005 et la sortie du mode

multidimensionnel actuel.

Tout comme le mode multidimensionnel, le mode tabulaire offre un modèle sémantique qui se veut

ouvert à tous les types de restitution : reporting, analyse, tableau de bord…

Le mode tabulaire propose une autre façon de concevoir des modèles et de les stocker. Contrairement

au mode multidimensionnel qui nécessite une modélisation dimensionnelle (cf. chapitre La

modélisation dimensionnelle) et un stockage OLAP, le mode tabulaire utilise une modélisation

relationnelle et un moteur d’analyse en mémoire vive pour le stockage et le calcul.

Conditions générales d'utilisation Copyright - ©Editions ENI

De ce fait, le mode tabulaire va être plus proche des modèles relationnels classiques, tout en

permettant une vitesse de restitution de données extrêmement rapide, de la donnée détaillée comme de

la donnée agrégée. C’est le mode tabulaire, que Microsoft a choisi de porter en mode PaaS dans Azure

sous l’appellation Azure Analysis Services.

Lors de la révision de cet ouvrage, nous nous sommes posé la question de savoir si nous allions

réaliser le livre avec un métamodèle en mode tabulaire ou en mode multi-dimensionnel. Jusqu’à

présent, ce choix était facile, car nous considérions qu’Analysis Services en mode tabulaire ne

disposait pas de la maturité et de toutes les fonctionnalités du mode multidimensionnel.

Mais cette dernière version 2019 comble un bon nombre de lacunes, ce qui nous fait maintenant

hésiter. Toutefois, nous rencontrons rarement dans les systèmes décisionnels matures le mode

tabulaire déployé en production. C’est pourquoi, nous avons choisi de nouveau dans cette édition de

vous présenter dans le chapitre Réaliser son premier système décisionnel, un métamodèle en mode

multidimensionnel.

Pour utiliser le mode tabulaire, il vous faudra toutefois créer une instance dédiée et nous vous

conseillons de dédier une machine physique et puissante à cette instance.

e. SQL Server Reporting Services

Enfin, la suite SQL Server dispose d’un serveur de rapports permettant d’afficher et de diffuser des

informations.

Reporting Services est avant tout un produit destiné à un public d’informaticiens. Sa parfaite

intégration avec l’environnement .NET, sa capacité de mise en page, ses possibilités de diffusion en

font un excellent outil de reporting opérationnel. Reporting Services est l’outil parfait pour mettre en

page une facture, un bon de livraison, un suivi de commande, un inventaire, un catalogue produit, la

liste des clients à relancer… Tous les états dont une application de gestion a besoin sont parfaitement

réalisables avec Reporting Services.

En ce qui concerne le besoin décisionnel, Reporting Services a été survendu par Microsoft depuis la

sortie de SQL Server 2005. Reporting Services n’est pas un outil d’analyse destiné à des utilisateurs

finaux. En revanche, il a totalement sa place dans la diffusion de rapports de masse, c’est-à-dire dans

les rapports décisionnels destinés à de nombreux décideurs opérationnels.

Par exemple, la diffusion par mail au format PDF du rapport mensuel de suivi des ventes à tous les

commerciaux de l’entreprise.

Nous reviendrons largement sur ce sujet dans le chapitre Restituer les données décisionnelles -

Reporting Services. Nous aborderons alors plus en détail la différence entre rapport opérationnel et

rapport décisionnel, puis nous apprendrons à faire bon usage de Reporting Services.

Conditions générales d'utilisation Copyright - ©Editions ENI

Exemple de rapport réalisé avec Reporting Services

3. Office 365

Microsoft Excel est sûrement et de loin, le premier outil décisionnel dans le monde et ce, depuis de

nombreuses années. Il répond aux besoins d’analyse de tous les services, de toutes les organisations et

sert à toutes les tâches : stockage de données, traitement de l’information et restitution.

Si Microsoft Excel seul répond assez bien à des problématiques sectorielles (propres à un seul

service), il atteint toutefois ses limites lorsque :

Il s’agit de croiser les données de référence de plusieurs applications : les fichiers Excel

deviennent alors de véritables usines à gaz très difficiles à maintenir.

Il s’agit de réduire les délais de production des tableaux de bord : il est difficile d’automatiser le

traitement de données dans Excel. On peut toujours y arriver par le biais de macro, mais on

augmente alors sensiblement la difficulté de maintenance des rapports.

Les données à traiter deviennent trop importantes : Excel 2003 gérait quelque 65 000 lignes,

Excel 365 en gère un maximum de 1 024 576. Mais les systèmes produisent toujours plus de

données et les demandes des décideurs ont aussi tendance à se complexifier.

Il s’agit de sécurité : un fichier Excel diffusé par mail contient l’intégralité des données

détaillées qu’il affiche et ses données sont potentiellement modifiables.

Il s’agit d’automatiser la diffusion des rapports : les fichiers sont de plus en plus volumineux. La

limite admise par le serveur de messagerie est parfois atteinte.

Conditions générales d'utilisation Copyright - ©Editions ENI

Pour toutes ces raisons et bien d’autres encore, Excel a besoin de s’adosser à un système décisionnel.

Les utilisateurs continuent toutefois de plébisciter l’utilisation d’Excel dans leur quotidien. Microsoft

a compris l’avantage substantiel qu’il peut tirer de cette position privilégiée.

Au sein de la solution BI Microsoft, Excel est l’outil d’analyse des utilisateurs finaux. Toutefois,

Excel n’est utilisé que pour accéder, manipuler et naviguer dans les données d’Analysis Services. Les

données ne sont plus contenues directement dans le fichier, mais sur un serveur. Et ces données ne

sont plus traitées directement par les utilisateurs fonctionnels mais par le service informatique par le

biais de l’ETL. Excel conserve toutefois toutes ses capacités de représentation graphique, de mise en

page et de personnalisation à l’aide de formules.

Le tableau croisé dynamique d’Excel

Nous étudierons en détail, dans le chapitre Restituer les données décisionnelles - Excel, l’utilisation

d’Excel adossée à la solution décisionnelle Microsoft Vous apprendrez ainsi à mieux comprendre et à

cerner l’utilisation de cet outil puissant, ses possibilités, mais aussi ses limites.

4. Power BI

Le projet à l’origine des compléments Excel PowerPivot, PowerView et PowerQuery s’est imposé

progressivement, depuis 2015, comme un produit à part entière et maintenant comme une famille de

produits (Power Platform). PowerBI s’installe actuellemetn dans le quotidient de très nombreuses

entreprises, à tel point qu’il permet en 2019 à Microsoft de figurer en tant que leader des solutions de

Business Intelligence.

Conditions générales d'utilisation Copyright - ©Editions ENI

Power BI permet de fournir des interfaces interactives de visualisation des données. Power BI est

résolument tourné vers des utilisateurs non informaticiens, leur permettant à l’aide de l’outil Power BI

desktop de concevoir des dashboards interactifs très riches. Contrairement à Excel, qui n’est pas conçu

pour partager des visualisations à une équipe ou à son organisation, Power BI est vraiment pensé pour

cela.

Le dashboard Power BI

D’autant plus qu’avec Power BI Service, Microsoft utilise la puissance de son cloud pour affranchir

les utilisateurs non informaticiens des moyens offerts traditionnellement par leur direction

informatique. Nous verrons au chapitre Restituer les données décisionnelles - Power BI, qu’il est

maintenant possible de déployer un serveur de rapports Power BI sans en passer par le cloud.

Cependant, Power BI n’est pas un outil d’analyse. Il est très efficace pour présenter l’information,

mais très peu performant pour l’explorer. Excel reste en cela incontournable.

Nous reviendrons largement sur ces outils au chapitre Restituer les données décisionnelles - Power BI.

Nous vous apprendrons alors à créer un dashboard Power BI, et à le partager au sein de votre

organisation.

Conditions générales d'utilisation Copyright - ©Editions ENI

Microsoft BI et Azure

Avec l’arrivée de Satya Nadella à la tête de Microsoft en février 2014, l’entreprise de Redmond a

adopté une stratégie entièrement tournée vers son cloud Azure.

Microsoft procède ainsi progressivement à la migration de ses plus anciennes solutions vers le cloud

(avec plus ou moins de succès).

C’est ainsi que sa base de données relationnelle se retrouve sous Azure sous les produits Azure SQL

managed instance et Azure SQL Database. Mais ces bases ne sont pas des plus adaptées au Data

Warehouse, pour cela on peut alors se tourner vers Azure Data Warehouse. Comme nous l’avons vu

plus haut, le métamodèle multidimensionnel n’est pas porté dans le cloud, mais le métamodèle

tabulaire se retrouve sous l’appellation Azure Analysis Services. Integration Services n’a été supporté

que très récemment par Azure Data factory, qui en préfigure très probablement l’avenir. Reporting

Services, Master Data Services et Data Quality Services n’ont toujours pas d’équivalent PaaS sous

Azure.

Cependant, sa nouvelle offre Power BI a entièrement été repensée autour du cloud, qui est

actuellement son environnement naturel.

À l’heure actuelle, créer son système décisionnel entièrement dans le cloud Azure est envisageable,

mais nécessite une hybridation de technologies On-premise, IaaS et PaaS, qui aurait pour effet de

compliquer le projet plutôt que de le simplifier. Il est à parier que dans l’avenir une intégration Azure

de la suite BI et notamment des outils de la suite SQL Server sera réalisée progressivement, à moins

qu’un éditeur s’empare de cette problématique.

C’est pourquoi, nous avons choisi lors de la révision de ce livre de nous consacrer à la mise en place

d’un système décisionnel entièrement On-premise.

Mes dernières expériences m’ont mené à concevoir des projets décisionnels dans le cloud avec

succès. C’est donc possible. Il y a toutefois des problématiques autour du transfert de données et

de l’authentification qui s’ajoutent à ceux d’un projet On-Premise. Il faut par exemple, en cas de

grosses volumétries, transférer les données des systèmes source au fil de l’eau via des Web API et

orchestrées par un service bus, au lieu de se contenter d’un traitement ETL quotidien. C’est donc

une étape supplémentaire propre à la problématique du Big Data qui s’ajoute au projet. Bien

entendu, une fois ces problèmes surmontés, le système décisionnel bénéficie de toute la puissance

du cloud en termes d’élasticité, de disponibilité et de sécurité.

Notre étude de cas : Distrisys

La société Distrisys est une société européenne que nous prendrons en exemple dans notre ouvrage.

Cette société n’existe pas, elle a tout spécialement été créée pour cet ouvrage.

Distrisys est un grossiste de grands et petits appareils d’électroménager. La société est distributeur

officiel et exclusif d’appareils qu’elle fait fabriquer, importe puis vend sous ses propres marques :

Lagon, Cuccina et Pierre-Michel. La société ne fabrique donc pas elle-même, elle a une activité

importante d’importation.

Conditions générales d'utilisation Copyright - ©Editions ENI

Distrisys ne vend pas ses produits en direct aux consommateurs. La société dispose d’un réseau de

revendeurs et distributeurs agréés. Son réseau est de plusieurs types : réseau de distribution

généraliste, réseau de magasins spécialisés et enfin réseau de sites marchands.

Distrisys est issue historiquement de plusieurs sociétés acquises par croissance externe. La société

dispose de cinq sites géographiques :

Trois en France : le siège à Paris, Aix-En-Provence et Bordeaux.

Deux à l’étranger : Barcelone et Munich.

Chaque site dispose de son propre PGI (Progiciel de Gestion Intégrée ou ERP en anglais), qui a été

toutefois homogénéisé pour en faciliter la gestion et la maintenance.

La direction de Distrisys est depuis très longtemps confrontée à des problèmes de qualité de données

et souhaite se doter d’outils permettant d’appréhender leurs données de manière globale. Si la

direction n’engage pas encore de démarches de Management de la Performance, elle y pense très

sérieusement.

C’est dans ce contexte que le service transformation digitale, en liaison avec la direction financière et

la direction informatique, amorce un projet de mise en œuvre d’un système décisionnel.

L’équipe informatique a mené une étude de choix d’outils. Compte tenu qu’elle possédait déjà des

serveurs SQL Server et d’un portail SharePoint, elle a porté son dévolu sur la solution BI Microsoft.

La solution en plus d’être cohérente, très complète et compétitive techniquement, dispose d’un

formidable rapport qualité-prix.

La problématique du cloud a été posée. Après étude, il s’est avéré pour le moment plus simple et plus

économique, compte tenu qu’un cluster SQL Server existe déjà au sein de l’entreprise pour héberger

les données de l’intranet Sharepoint, de mener le projet On-premise.

Tout au long de l’ouvrage, nous allons étudier et traiter le cas de la société Distrisys. Nous allons

suivre toutes les étapes de mise en œuvre de la solution décisionnelle au sein de la société. Afin de

suivre le déroulement du projet et faire les manipulations pour bâtir en parallèle le système

décisionnel, vous n’aurez besoin que d’une installation de SQL Server. Tous les exemples de ce livre

sont réalisés avec la version d’évaluation de SQL Server 2019 CTP3.2. À noter que de votre côté, si

vous disposez de la version finale ou d’une version plus ancienne (2005 ou ultérieure), vous pourrez

aussi parfaitement suivre le déroulement du projet tel que décrit dans ce livre.

Les versions SQL Server 2005, 2008, 2008 R2, 2012, 2014, 2016 et 2017 sont assez proches les

unes des autres. De plus, vous comprendrez assez vite qu’au-delà des outils et des versions, ce sont

les concepts qui sont vraiment importants.

L’exploitation de la solution décisionnelle nécessitera, quant à elle, une version d’Excel, idéalement

Excel 365. Mais nous vous engageons à faire des tests avec toutes les versions d’Excel disponibles et

déployées dans votre entreprise afin d’en apprécier les différences.

Des versions d’évaluation de ces produits sont disponibles en téléchargement sur le site Technet

Evaluation Center à l’adresse : http://technet.microsoft.com/fr-fr/evalcenter/

Conditions générales d'utilisation Copyright - ©Editions ENI

Déroulement du projet

Étant donné notre expérience, nous constatons généralement que la première intention d’un service

informatique souhaitant réaliser un système décisionnel est de partir des données à leur disposition. Si

ce réflexe est parfaitement compréhensible, il est l’opposé de ce qu’il faut faire si l’on souhaite mener

à bien un projet et obtenir des résultats.

Un projet décisionnel nécessite, tout d’abord et forcément, d’être mené en trio : l’IT représenté par

l’équipe BI, un membre du service fonctionnel concerné par le périmètre traité et enfin un membre du

contrôle de gestion. Ce projet doit si possible s’inscrire dans un projet d’entreprise disposant du

sponsoring ou du moins du soutien d’un membre influent de la direction.

Ce mode de fonctionnement est essentiel, car il est indispensable de mener chaque étape du projet du

haut vers le bas, c’est-à-dire du besoin global, le plus stratégique, vers la donnée la plus détaillée.

Pour débuter, on commence par s’assurer le périmètre projet auprès des décideurs stratégiques. Mener

l’ensemble du périmètre en un seul bloc projet mènerait inévitablement le projet à sa perte. Un projet

décisionnel doit être vivant. Ne pouvant pas mener tout le périmètre d’un seul tenant, le projet sera

mené par itération successive. Le périmètre projet initial est alors fractionné en lots que l’on va

prioriser et étaler dans le temps. On dit alors que l’on lotit le projet. Un lot est généralement un sujet

fonctionnel, ni trop petit, afin d’apporter une cohérence et une valeur ajoutée, ni trop gros, afin

d’obtenir des itérations projet courtes de l’ordre de quelques mois au maximum. L’ordre de priorité

d’un lot est défini suivant deux critères : sa facilité de réalisation et sa valeur ajoutée.

Dans les faits, nous commençons toujours si possible par le périmètre le plus simple à réaliser

(disponibilité de l’information, disponibilité du service, réflexion déjà bien avancée…) et par le

périmètre qui apporte le plus de valeur ajoutée (criticité de la qualité de l’information, transversalité

fonctionnelle du lot, orientation stratégique majeure…).

Dans le cas de Distrisys, une première étude a été menée pour définir les contours du projet. Le

périmètre projet a été défini. Il s’agit dans l’ordre des priorités :

De la facturation (facture + commande + budget)

Des stocks

Des achats (commandes fournisseurs + commandes en attente + facturation fournisseurs)

Du service après-vente

Du marketing

L’équipe projet commence par la facturation car il s’agit :

Du domaine fonctionnel le plus facile à réaliser : le domaine est parfaitement maîtrisé, tant

techniquement que fonctionnellement. Tous les indicateurs réclamés par les décideurs sont a

priori disponibles dans le système d’information de l’entreprise.

D’un domaine fonctionnel à haute valeur ajoutée : la plupart des services de l’entreprise ont

besoin des informations de commande et de facturation. Il est d’ailleurs aujourd’hui assez

difficile de les réconcilier quand il s’agit d’échanger les chiffres : chaque service et chaque site

dispose de ses propres données. Les comités de direction tournent souvent à l’affrontement pour

savoir qui a raison et qui dispose du chiffre exact. La qualité et la compréhension de cette

information sont donc cruciales.

Pour chacun des lots, la démarche de travail sera alors toujours identique :

Conditions générales d'utilisation Copyright - ©Editions ENI

On commencera par travailler en atelier avec le service fonctionnel concerné pour définir le

modèle final.

Nous vous suggérons vivement de faire vivre le modèle avec des jeux de test (cf. chapitre Réaliser

son premier système décisionnel). L’idée n’est pas de réaliser le modèle avec les véritables

données de votre système d’information. Cela vous prendrait effectivement vraiment trop de

temps. Cependant, vous ne devez pas non plus rester uniquement sur des spécifications papier,

souvent illisibles et incompréhensibles par les fonctionnels car ce serait prendre le risque que

lorsque le modèle sera réalisé à données réelles, les incompréhensions remonteraient alors d’un

bloc et mettraient alors à mal le projet lors de la recette.

Lors de cette phase, il est important que vous maîtrisiez le concept de matrice dimensionnelle et

les concepts de modélisation d’entrepôt de données. Le chapitre La modélisation dimensionnelle

vous assistera à cet effet.

Lorsque le modèle final est validé par les analystes et décideurs du service fonctionnel concerné,

le projet technique commence : il s’agit alors de réaliser en toute sérénité les flux ETL pour

alimenter le modèle préalablement défini et validé.

Au chapitre Alimenter l’entrepôt de données avec SSIS, nous aborderons l’architecture ainsi que

les bonnes pratiques d’alimentation de données.

C’est aussi au cours de cette phase que nous identifierons les données de référence de l’entreprise. Et

si elles n’existent pas, l’équipe projet se chargera de les faire émerger.

Au chapitre Gérer les données de référence avec MDS, nous aborderons la mise en œuvre ainsi

que les bonnes pratiques d’utilisation de la solution de MDM de Microsoft.

En parallèle de l’alimentation des données, un membre de l’équipe projet peut commencer à

travailler avec le service fonctionnel pour travailler sur la restitution :

Identifier et définir si besoin les rapports de masse.

Définir et concevoir les tableaux de bord.

Préparer les analystes des services fonctionnels concernés au changement : formation aux

outils de restitution et accompagnement à la réalisation des premières analyses pour s’assurer que

les outils soient correctement employés.

Le chapitre Restituer les données décisionnelles vous apportera quelques éclairages sur quelques

outils et leur bon emploi.

Vous constaterez que les chapitres de l’ouvrage sont organisés pour suivre le déroulement

chronologique du projet décisionnel de Distrisys.

Vous pourrez toutefois aborder un chapitre indépendamment du précédent. Vous aurez alors besoin de

télécharger depuis la page Informations générales l’état du projet laissé au précédent chapitre.

Dans le chapitre suivant, nous aborderons les préalables du projet : architecture serveur, licences et

prise de connaissance des consoles de SQL Server.

Conditions générales d'utilisation Copyright - ©Editions ENI

Quiz

Accéder au Quiz sur : Introduction

Conditions générales d'utilisation Copyright - ©Editions ENI

Installation et découverte des outils SQL Server

Le choix des licences

La réalisation d’un système décisionnel avec la suite Microsoft BI (Business Intelligence) demande

généralement moins d’investissement que les solutions concurrentes, mais demande toutefois de

disposer des bonnes éditions et si possible de la totalité de la suite. La mise en place d’un système

décisionnel avec Microsoft n’est pas gratuite.

Nous avons vu au chapitre précédent que la mise en place globale de la solution décisionnelle

Microsoft nécessite trois licences distinctes. Dans leurs versions les plus récentes à ce jour, ces

licences sont :

SQL Server 2019

Office 365

Power BI

Voyons dans le détail quelles sont les éditions nécessaires.

Nous n’entrerons pas dans les considérations de tarifs. Sur ce sujet, prenez contact directement

avec votre revendeur ou avec votre commercial Microsoft pour une estimation précise.

1. SQL Server 2019

Le discours et les plaquettes commerciales de Microsoft vantent la disponibilité des outils

décisionnels de la suite SQL Server dès l’édition Standard.

Dans la réalité, mettre en place une solution décisionnelle avec SQL Server nécessite de disposer de

l’édition Enterprise. Or la différence de coût entre l’édition Standard et Enterprise est vraiment

substantielle.

L’édition Enterprise est à privilégier, car au-delà des considérations de haute disponibilité ou de

montée en charge, cette édition dispose de fonctionnalités décrites de manière assez obscure dans les

plaquettes commerciales ou de comparaison de versions, qui se révèlent malgré tout essentielles.

Nous verrons notamment au chapitre La modélisation dimensionnelle que pour modéliser

correctement notre entrepôt de données, nous aurons besoin de deux fonctionnalités incontournables :

La semi-additivité : entre autres raisons, sans cette fonctionnalité, votre entrepôt de données sera

amputé de toutes les tables de faits de type photo. Il existe trois types de tables de faits et ce

dernier type est celui qui apporte la plus grande valeur ajoutée par rapport à des systèmes

opérationnels classiques.

Les perspectives : il s’agit de la fonctionnalité permettant de réaliser un entrepôt de données

conforme en toute sérénité. La perspective décrit des contextes cohérents d’analyse de données.

Sans cette fonctionnalité, le principe de l’entrepôt de données, exposé au travers d’Analysis

Services, est mis à mal.

Une dernière fonctionnalité est essentielle pour assurer la pérennité de votre système décisionnel :

Conditions générales d'utilisation Copyright - ©Editions ENI

L’intelligence financière : nous ne l’aborderons pas dans cet ouvrage, mais l’intelligence

financière est la fonctionnalité ouvrant Analysis Services au Management de la Performance et à

toutes les problématiques des services financiers et de contrôle de gestion. L’ultime finalité du

décisionnel est tout de même de donner les moyens de gérer la performance. Il serait dommage

de se priver des moyens techniques.

Conditions générales d'utilisation Copyright - ©Editions ENI

En fait, la différence entre l’édition Standard et Enterprise se fait sur ces nombreux petits détails. Les

quelques éléments donnés en exemple ci-dessus ne concernent que Analysis Services. La différence

de fonctionnalités entre les versions touche bien évidemment aussi Integration Services et Reporting

Services.

En conclusion, sauf après étude et contexte spécifique, la mise en œuvre de la solution BI Microsoft

nécessite SQL Server en édition Enterprise.

À noter aussi que c’est la licence SQL Server 2019 qui permet de détenir et d’installer le Power BI

Report Server. La licence Power BI Premium est uniquement requise dans le cas de l’utilisation cloud

des services Power BI.

2. Office 365/Office 2019

Office est maintenant décliné en deux éditions. Il est vendu en logiciel classique sous le nom d’Office

2019 et il est vendu sous forme de services sous l’appellation Office 365.

Quelle que soit son édition, dans la licence Office, le décisionnel s’intéresse surtout à Excel. Et dans

toutes les éditions d’Excel, vous aurez la possibilité de faire des tableaux croisés dynamiques

nativement et d’exploiter le contenu des cubes Analysis Services.

3. SharePoint 2019

L’étude de SharePoint n’est pas abordée dans cet ouvrage. Il n’en reste pas moins que la solution était

jusqu’à présent nécessaire pour bénéficier de la suite décisionnelle complète. Il y a encore deux ans,

nous vous aurions conseillé vivement de l’intégrer dans vos estimations de coûts prévisionnels.

Cependant, Microsoft ne maintient plus les services décisionnels associés à SharePoint. Ces services

utilisent des technologies en obsolescence comme Silverlight et leurs performances ne sont plus à la

hauteur des nouveaux enjeux. Microsoft déconseille donc leur utilisation. Nous vous le déconseillons

également. Il n’y a donc plus de portail ou de réceptacle évident au système décisionnel chez

Microsoft permettant de piloter la performance d’une organisation.

Pour pouvoir centraliser les contenus BI, vous aurez donc, soit la possibilité de développer votre

propre portail web ou application mobile appelant ces mêmes contenus Power BI ou Reporting

Services, soit la possibilité de mettre en place le serveur de rapports Power BI. C’est la solution que je

vous propose dans cet ouvrage. Pour plus de détails référez-vous au chapitre Restituer les données

décisionnelles - Power BI.

Conditions générales d'utilisation Copyright - ©Editions ENI

Découverte des outils SQL Server

Avant de vous lancer dans les chapitres pratiques qui vont suivre, nous vous proposons une petite