Académique Documents

Professionnel Documents

Culture Documents

Chap7 Echantillonnage Estimation Ponctuelle (3) - Copie

Transféré par

Davila AlomgbaTitre original

Copyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

Chap7 Echantillonnage Estimation Ponctuelle (3) - Copie

Transféré par

Davila AlomgbaDroits d'auteur :

Formats disponibles

Contents

CHAPITRE 7 - ÉCHANTILLONNAGE ET THÉORÈME LIMITE CENTRAL (TLC) ............ 2

7.1 Généralités ............................................................................................................... 2

7.2 Les méthodes d’échantillonnage ................................................................................. 3

7.2.1 Les méthodes empiriques :................................................................................... 3

7.2.2 Les méthodes aléatoires : ..................................................................................... 3

7.3 Echantillon aléatoire d’une suite de n variables indépendamment et identiquement

distribuées (iid) .............................................................................................................. 4

7.3.1 Echantillon aléatoire 1 : 𝑿𝟏 ; 𝑿𝟐 ; … ; 𝑿𝒏 𝒊𝒊𝒅 avec 𝑿𝒊 ↝ 𝒎; 𝝈 ............................ 4

7.3.2 Echantillon aléatoire 2 : 𝑿𝟏 ; 𝑿𝟐 ; … ; 𝑿𝒏𝒊𝒊𝒅 avec 𝑿𝒊 ↝ 𝓑𝟏 ; 𝒑𝒍𝒐𝒊 𝒅𝒆 𝑩𝒆𝒓𝒏𝒐𝒖𝒍𝒍𝒊

................................................................................................................................. 4

7.3.3 Exemples de variables d’échantillon ou estimateurs ........................................... 5

7.4 Les paramètres de la population et les estimateurs (ou statistiques) d’échantillon ............. 8

7.5. Tableau des paramètres θ usuels : leurs estimateurs 𝜽 usuels et leurs estimations

ponctuelles .................................................................................................................... 9

7.5 - QUALITÉS D’UN BON ESTIMATEUR : 𝜽 ........................................................... 10

7.5.1 Absence de biais: ............................................................................................. 10

7.5.2 Convergence : ............................................................................................. 10

7.5.3 Efficacité : .................................................................................................. 10

7.6 - Exemple d’estimateurs non biaisés (sans biais) et convergents : 𝑿, 𝑭 et 𝑺′𝟐 ........ 10

7.6.1 Montrons que 𝑭 est un estimateur non biaisé et convergent de la proportion p d’une

population ................................................................................................................ 10

7.6.2 Montrons que 𝒎 = 𝑿 = 𝒊 = 𝟏𝒊 = 𝒏𝑿𝒊𝒏 est un estimateur non biaisé et convergent

de la moyenne m d’une population ............................................................................. 10

7.6.3 𝑺𝟐 est un estimateur biaisé de 𝝈𝟐 ...................................................................... 11

7.6.4 𝑺′𝟐 est un estimateur non biaisé de 𝝈𝟐 ............................................................ 11

7.6.5 L’estimateur sans biais de 𝝈𝟐 𝒆𝒔𝒕 𝑺′𝟐 = 𝑿𝒊 − 𝑿𝟐𝒏 − 𝟏. ................................... 11

7.7 Exercices d’application : Estimation ponctuelle de la moyenne (m) et l’écart-type (𝝈)

d’une population ....................................................................................................... 11

7.8 Théorème central limite ........................................................................................... 16

7.8.1 Théorème central limite 𝒏 > 𝟑𝟎 et loi de distribution de 𝑭 ................................... 16

7.8.2 Théorème central limite 𝒏 > 𝟑𝟎 et loi de distribution de 𝑿 ................................... 17

7.8.3 loi de distribution de 𝑿 lorsque 𝒏 ≤ 𝟑𝟎 .............................................................. 17

7.8.5 loi de distribution de 𝐒′𝟐 ................................................................................. 17

Notes Dr MAHOP Page 1 of 24

7.8.7 théorème central limite et approximations d’autres lois par la loi normale ............... 17

7.8.8 Autres approximations de lois ............................................................................ 18

7.9 Tableau des propriétés de la moyenne et de la fréquence d’échantillon en situations

« avec remise » ou « sans remise » ............................................................................. 19

7.10 formules simples et pondérées de la variance d’échantillon 𝒔𝟐 et la variance corrigée

d’échantillon 𝒔′𝟐 .................................................................................................... 20

7.11 Tableau des distributions d’échantillonnages ........................................................ 21

7.11.3 Distribution d’échantillonnage de la fréquence d’échantillon (𝑭) pour 𝒏 > 𝟑𝟎 : avec ou

sans remise .................................................................................................................. 23

CHAPITRE 7 - ÉCHANTILLONNAGE ET THÉORÈME LIMITE CENTRAL (TLC)

7.1 Généralités

Un échantillon aléatoire est un sous ensemble représentatif de la population.

Un échantillonnage ou un sondage est une sélection ou un prélèvement d’échantillons dans la

population.

La taille de la population (N), c’est l’effectif total des éléments ou unités statistiques de la

population.

Un échantillon aléatoire de taille n est un sous-ensemble de la population composé d’une suite de

n variables aléatoires (𝑋1 ; 𝑋2 ; … ; 𝑋𝑛 ).

On ne dispose pas souvent de données ou d’informations sur la population qui nous intéresse. On

devra alors déduire l’information désirée sur la population en choisissant adéquatement un sous-

ensemble représentatif de celle-ci, nommé échantillon, et en analysant les données qu’il contient.

La théorie de l’échantillonnage est l’étude des liaisons existant entre une population et les

échantillons de cette population. Elle est fondamentale à deux titres :

* estimer les paramètres de la population (e.g. moyenne, variance, proportion) à partir des

estimateurs correspondant de l’échantillon ;

* savoir si les différences observées entre deux échantillons sont dues au hasard ou réellement

significatives.

Les méthodes d’échantillonnage c’est l’ensemble des méthodes permettant de réaliser un

sondage ou de prélever un échantillon de données au sein d’une population ; de manière à

reproduire un échantillon aussi représentatif que possible de cette population.

Il existe différentes méthodes d’échantillonnage pour sélectionner les unités statistiques de la

population qui seront incluses dans l’échantillon.

Notes Dr MAHOP Page 2 of 24

7.2 Les méthodes d’échantillonnage

7.2.1 Les méthodes empiriques :

Les plus utilisées par les instituts de sondage. Leur précision ne peut pas être calculée et leur

réussite dépend de l’expertise des enquêteurs.

7.2.1.1 Echantillonnage sur la base du jugement :

Ce sont des échantillons prélevés à partir d’avis d’experts, qui connaissent bien la population et

sont capable de dire quelles sont les entités représentatives. L’inconvénient est que l’avis des

experts est subjectif.

7.2.1.2 Echantillonnage par la méthode des quotas :

Ce sont des échantillons prélevés librement à condition de respecter une composition donnée à

l’avance (sexe, âge, CSP, etc.). L’inconvénient est qu’il repose sur la pertinence des catégories

retenues.

7.2.2 Les méthodes aléatoires :

Reposent sur le tirage au hasard d’échantillons et sur le calcul des probabilités.

7.2.2.1 Echantillonnage aléatoire simple :

On prélève dans la population, des individus au hasard, avec remise : tous les individus ont la

même probabilité d’être prélevés, et ils le sont indépendamment les uns des autres.

7.2.2.2 Echantillonnage aléatoire stratifié :

7.2.2.2.1 Echantillonnage aléatoire stratifié :

On suppose que la population soit stratifiée, i.e. constituée de sous-populations homogènes, les

strates. (ex : stratification par tranche d’âge). Dans chaque strate, on fait un échantillonnage

aléatoire simple, de taille proportionnelle à la taille de strate dans la population (échantillon

représentatif). Les individus de la population n’ont pas tous la même probabilité d’être tirés.

Cette méthode nécessite une homogénéité des strates. Mais elle augmente la précision des

estimations.

7.2.2.2.2 Echantillonnage par grappe :

On tire au hasard des grappes ou familles d’individus, et on examine tous les individus de la

grappe (ex: on tire des immeubles puis on interroge tous les habitants). La méthode est d’autant

meilleure que les grappes se ressemblent et que les individus d’une même grappe sont différents,

contrairement aux strates.

Il est à noter que la manière de recueillir les données de l’échantillon est fondamental pour que

celui-ci soit représentatif de la population étudiée. A titre d’exemple, un sondage réalisé dans la

rue sera le plus souvent biaisé si l’enquêteur a tendance à interroger les personnes qui lui

semblent le plus aimable. Pour que l’échantillon soit représentatif, il devra être aléatoire. Un

échantillon est qualifié d’aléatoire lorsque chaque élément de la population a une probabilité

connue et non nulle d’appartenir à la population.

Dans le cadre de ce cours, nous nous référerons exclusivement à un échantillonnage

aléatoire simple. Cette méthode consiste à prélever au hasard et de façon indépendante n unités

d’échantillonnage d’une population de N éléments. Chaque élément de la population possède

Notes Dr MAHOP Page 3 of 24

ainsi la même probabilité d’appartenir à l’échantillon. Ceci pourra être réalisé en numérotant les

éléments de la population de 1 à N puis en utilisant une table des nombres aléatoires.

7.3 Echantillon aléatoire d’une suite de n variables indépendamment et identiquement

distribuées (iid)

7.3.1 Echantillon aléatoire 1 : (𝑿𝟏 ; 𝑿𝟐 ; … ; 𝑿𝒏 ) 𝒊𝒊𝒅 avec 𝑿𝒊 ↝ (𝒎; 𝝈)

𝐸(𝑋) = 𝑚 (𝑜𝑢 𝜇)

2

- Soit X une variable aléatoire dont la distribution est telle que : { 𝑉(𝑋) = 𝜎

𝜎(𝑋) = √𝑉(𝑋) = 𝜎

On dit que X suit une loi de paramètres 𝑚 𝑒𝑡 𝜎 ; on écrit : 𝑋 ↝ (𝑚; 𝜎).

NB : Dans l’échantillon 1, la loi de X n’est pas spécifiée mais on connaît son espérance

mathématique et son écart-type.

- Soit un échantillon composé d’une suite de n variables aléatoires (𝑋1 ; 𝑋2 ; … ; 𝑋𝑛 )

indépendamment et identiquement distribuées ⏟ 𝑠𝑒𝑙𝑜𝑛 𝑙𝑎 𝑙𝑜𝑖 𝑑𝑒 𝑋. on a :

𝑚ê𝑚𝑒 𝑙𝑜𝑖 𝑞𝑢𝑒 𝑋

𝐸(𝑋1 ) = 𝐸(𝑋2 ) = ⋯ = 𝐸(𝑋𝑛 ) = 𝐸(𝑋) = 𝑚

2

i. (𝑋

⏟ 1 ; 𝑋2 ; … ; 𝑋𝑛 ) ⇔ { 𝑉(𝑋1 ) = 𝑉(𝑋2 ) = ⋯ = 𝑉(𝑋𝑛 ) = 𝑉(𝑋) = 𝜎

𝑖𝑑𝑒𝑛𝑡𝑖𝑞𝑢𝑒𝑚𝑒𝑛𝑡 𝑑𝑖𝑠𝑡𝑟𝑖𝑏𝑢é𝑒𝑠 𝑠𝑒𝑙𝑜𝑛 𝑙𝑎 𝑙𝑜𝑖 𝑑𝑒 𝑋 𝜎(𝑋1 ) = 𝜎(𝑋2 ) = ⋯ = 𝜎(𝑋𝑛 ) = √𝑉(𝑋) = 𝜎

⇔𝑋𝑖 𝑠𝑢𝑖𝑡 𝑙𝑎 𝑚ê𝑚𝑒 𝑙𝑜𝑖 𝑞𝑢𝑒 𝑋

ii. (𝑋

⏟ 1 ; 𝑋2 ; … ; 𝑋𝑛 ) 𝑎𝑙𝑜𝑟𝑠 𝑐𝑜𝑣(𝑋

⏟ 𝑖 ; 𝑋𝑗 ) = 0

𝑚𝑢𝑡𝑢𝑒𝑙𝑙𝑒𝑚𝑒𝑛𝑡 𝑖𝑛𝑑é𝑝𝑒𝑛𝑑𝑎𝑛𝑡𝑠⇔𝑋𝑖 ∩𝑋𝑗 =∅ 𝑝𝑜𝑢𝑟 𝑖≠𝑗

iii. (𝑋

⏟ 1 ; 𝑋2 ; … ; 𝑋𝑛 ) ⏟ 𝑖 + 𝑋𝑗 ) = 𝑉(𝑋𝑖 ) + 2 𝑐𝑜𝑣(𝑋

𝑎𝑙𝑜𝑟𝑠 𝑉(𝑋 ⏟ 𝑖 ; 𝑋𝑗 ) + 𝑉(𝑋𝑗 ) = 𝑉(𝑋𝑖 ) +

𝑚𝑢𝑡𝑢𝑒𝑙𝑙𝑒𝑚𝑒𝑛𝑡 𝑖𝑛𝑑é𝑝𝑒𝑛𝑑𝑎𝑛𝑡𝑠 𝑝𝑜𝑢𝑟 𝑖≠𝑗 0

𝑉(𝑋𝑗 ) = 𝜎 2 + 𝜎 2 = 2𝜎 2

iv. (𝑋

⏟ 1 ; 𝑋2 ; … ; 𝑋𝑛 ) 𝑉(𝑋𝑖 − 𝑋𝑗 ) = 𝑉(𝑋𝑖 ) − ⏟

𝑎𝑙𝑜𝑟𝑠 ⏟ 2𝑐𝑜𝑣(𝑋𝑖 ; 𝑋𝑗 ) + 𝑉(𝑋𝑗 ) = 𝑉(𝑋𝑖 ) +

𝑚𝑢𝑡𝑢𝑒𝑙𝑙𝑒𝑚𝑒𝑛𝑡 𝑖𝑛𝑑é𝑝𝑒𝑛𝑑𝑎𝑛𝑡𝑠 𝑝𝑜𝑢𝑟 𝑖≠𝑗 0

𝑉(𝑋𝑗 ) = 𝜎 2 + 𝜎 2 = 2𝜎 2

7.3.2 Echantillon aléatoire 2 : (𝑿𝟏 ; 𝑿𝟐 ; … ; 𝑿𝒏 ) 𝒊𝒊𝒅 avec 𝑿𝒊 ↝ 𝓑(𝟏 ; 𝒑)

⏟

𝒍𝒐𝒊 𝒅𝒆 𝑩𝒆𝒓𝒏𝒐𝒖𝒍𝒍𝒊

- Soit X une variable aléatoire qui suit une distribution de Bernoulli de paramètres 1 et p :

𝐸(𝑋) = 𝑝 (𝑜𝑢 𝜋)

𝑋↝ ⏟ ℬ(1 ; 𝑝) 𝑎𝑣𝑒𝑐 { 𝑉(𝑋) = 𝑝𝑞 = 𝑝(1 − 𝑝)

𝑙𝑜𝑖 𝑑𝑒 𝐵𝑒𝑟𝑛𝑜𝑢𝑙𝑙𝑖 𝜎(𝑋) = √𝑉(𝑋) = √𝑝𝑞 = √𝑝(1 − 𝑝)

Notes Dr MAHOP Page 4 of 24

- Soit un échantillon composé d’une suite de n variables aléatoires (𝑋1 ; 𝑋2 ; … ; 𝑋𝑛 )

indépendamment et identiquement distribuées selon la loi de X. on a :

𝐸(𝑋1 ) = 𝐸(𝑋2 ) = ⋯ = 𝐸(𝑋𝑛 ) = 𝐸(𝑋) = 𝑝

(𝑋1 ; 𝑋2 ; … ; 𝑋𝑛 )

⏟ ⇔ { 𝑉(𝑋1 ) = 𝑉(𝑋2 ) = ⋯ = 𝑉(𝑋𝑛 ) = 𝑉(𝑋) = 𝑝𝑞

𝑖𝑑𝑒𝑛𝑡𝑖𝑞𝑢𝑒𝑚𝑒𝑛𝑡 𝑑𝑖𝑠𝑡𝑟𝑖𝑏𝑢é𝑒𝑠 𝑠𝑒𝑙𝑜𝑛 𝑙𝑎 𝑙𝑜𝑖 𝑑𝑒 𝑋 𝜎(𝑋1 ) = 𝜎(𝑋2 ) = ⋯ = 𝜎(𝑋𝑛 ) = 𝜎(𝑋) = √𝑝𝑞

⇔𝑋𝑖 𝑠𝑢𝑖𝑡 𝑙𝑎 𝑚ê𝑚𝑒 𝑙𝑜𝑖 𝑞𝑢𝑒 𝑋

i. (𝑋1 ; 𝑋2 ; … ; 𝑋𝑛 )

⏟ 𝑎𝑙𝑜𝑟𝑠 𝑐𝑜𝑣(𝑋

⏟ 𝑖 ; 𝑋𝑗 ) = 0

𝑚𝑢𝑡𝑢𝑒𝑙𝑙𝑒𝑚𝑒𝑛𝑡 𝑖𝑛𝑑é𝑝𝑒𝑛𝑑𝑎𝑛𝑡𝑠⇔𝑋𝑖 ∩𝑋𝑗 =∅ 𝑝𝑜𝑢𝑟 𝑖≠𝑗

ii. (𝑋1 ; 𝑋2 ; … ; 𝑋𝑛 )

⏟

𝑚𝑢𝑡𝑢𝑒𝑙𝑙𝑒𝑚𝑒𝑛𝑡 𝑖𝑛𝑑é𝑝𝑒𝑛𝑑𝑎𝑛𝑡𝑠

⏟ 𝑖 + 𝑋𝑗 ) = 𝑉(𝑋𝑖 ) + 2 𝑐𝑜𝑣(𝑋

𝑎𝑙𝑜𝑟𝑠 𝑉(𝑋 ⏟ 𝑖 ; 𝑋𝑗 ) + 𝑉(𝑋𝑗 ) = 𝑉(𝑋𝑖 ) + 𝑉(𝑋𝑗 ) = 𝑝𝑞 + 𝑝𝑞 = 2𝑝𝑞 =

𝑝𝑜𝑢𝑟 𝑖≠𝑗 0

2𝑝(1 − 𝑝)

iii. (𝑋

⏟ 1 ; 𝑋2 ; … ; 𝑋𝑛 ) ⏟ 𝑖 − 𝑋𝑗 ) = 𝑉(𝑋𝑖 ) − 2 𝑐𝑜𝑣(𝑋

𝑎𝑙𝑜𝑟𝑠 𝑉(𝑋 ⏟ 𝑖 ; 𝑋𝑗 ) + 𝑉(𝑋𝑗 ) = 𝑉(𝑋𝑖 ) +

𝑚𝑢𝑡𝑢𝑒𝑙𝑙𝑒𝑚𝑒𝑛𝑡 𝑖𝑛𝑑é𝑝𝑒𝑛𝑑𝑎𝑛𝑡𝑠 𝑝𝑜𝑢𝑟 𝑖≠𝑗 0

𝑉(𝑋𝑗 ) = 𝑝𝑞 + 𝑝𝑞 = 2𝑝𝑞

7.3.3 Exemples de variables d’échantillon ou estimateurs

7.3.3.1 Fréquence empirique ou fréquence d’échantillon : F

𝐸(𝑋𝑖 ) = 𝑝

Soit un échantillon aléatoire (𝑋1 , 𝑋2 , … , 𝑋𝑛 ) 𝑖𝑖𝑑 et 𝑋𝑖 ↝ ⏟

ℬ(1; 𝑝) avec {

𝑉(𝑋𝑖 ) = 𝑝𝑞 = 𝑝(1 − 𝑝)

𝐵𝑒𝑟𝑛𝑜𝑢𝑙𝑙𝑖

Soit K une variable aléatoire telle que :

𝑖=𝑛

𝐾 = ∑ 𝑋𝑖 = 𝑋1 + 𝑋2 + ⋯ + 𝑋𝑛 = somme de n variables indépendantes de Bernoulli

𝑖=1

On note que : K suit la loi binomiale de paramètres n et p :

𝐸(𝐾) = 𝑛𝑝

⇒𝐾↝ ⏟ ℬ(𝑛; 𝑝) 𝑎𝑣𝑒𝑐 {

𝑉(𝐾) = 𝑛𝑝𝑞 = 𝑛𝑝(1 − 𝑝)

𝑙𝑜𝑖 𝐵𝑖𝑛𝑜𝑚𝑖𝑎𝑙𝑒

La fréquence d’échantillon ou fréquence empirique est la variable aléatoire F telle que :

𝐾 𝑋1 + 𝑋2 + ⋯ + 𝑋𝑛 n=taille de l'échantillon

𝐹= = = 𝑎𝑣𝑒𝑐 { K=nombre de succès dans l'échantillon

𝑛 𝑛 F=fréquence de succès dans l'échantillon

Calcul de 𝑬(𝑭) et de 𝑽(𝑭)

Il est montré que :

𝑝𝑞 𝑝𝑞 𝑝(1 − 𝑝)

𝐸(𝐹) = 𝑝; 𝑉(𝐹) = 𝑒𝑡 𝜎(𝐹) = √ = √

𝑛 𝑛 𝑛

𝐾 1 1

𝐸(𝐹) = 𝐸 ( 𝑛 ) = 𝑛 𝐸(𝐾) = 𝑛 × 𝑛𝑝 = 𝑝

Notes Dr MAHOP Page 5 of 24

𝐾 1 1 2 1 1 𝑝𝑞 𝑝(1−𝑝)

𝑉(𝐹) = 𝑉 ( 𝑛 ) = 𝑉 (𝑛 𝐾) = (𝑛) 𝑉(𝐾) = 𝑛2 × 𝑛𝑝𝑞 = 𝑛 × 𝑝𝑞 = =

𝑛 𝑛

𝑝𝑞

La fréquence d’échantillon 𝐹 suit une distribution de paramètres p et √ 𝑛 , on note :

𝐸(𝐹) = 𝑝

𝑝𝑞

𝑝𝑞 𝑉(𝐹) =

𝑿𝒊 ↝ ⏟ (𝑋1 , 𝑋2 , … , 𝑋𝑛 ) 𝑖𝑖𝑑 𝑠𝑒𝑙𝑜𝑛 𝑋𝑖 ⇒ 𝐹 ↝ (𝑝 ; √ ) , 𝑎𝑣𝑒𝑐

𝑩(𝟏 ; 𝒑) 𝑒𝑡 ⏟ 𝑛

𝑛 𝑝𝑞

𝑩𝒆𝒓𝒏𝒐𝒖𝒍𝒍𝒊 é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛

𝜎(𝐹) = √

{ 𝑛

̅

7.3.3.2 Moyenne empirique ou moyenne d’échantillon : 𝑿

𝐸(𝑋𝑖 ) = 𝑚

Soit un échantillon aléatoire (𝑋1 , 𝑋2 , … , 𝑋𝑛 ) 𝑖𝑖𝑑 et 𝑋𝑖 ↝ (𝑚 ; 𝜎) avec {

𝑉(𝑋𝑖 ) = 𝜎 2

∑𝑖=𝑛

𝑖=1 𝑋𝑖 𝑋1 + 𝑋2 + ⋯ + 𝑋𝑛

𝑋̅ ==

𝑛 𝑛

𝜎2 𝜎

̅ ̅ ̅

Il est montré que : ⇒ 𝐸(𝑋) = 𝑚; 𝑉(𝑋) = 𝑛 𝑒𝑡 𝜎(𝑋) = 𝑛

√

∑𝑖=𝑛

𝑖=1 𝑋𝑖 1 1 1 1

𝐸(𝑋̅) = 𝐸 ( ) = 𝐸(∑𝑖=𝑛 𝑖=𝑛

𝑖=1 𝑋𝑖 ) = 𝑛 𝐸(𝑋1 + 𝑋2 + ⋯ + 𝑋𝑛 ) = 𝑛 ∑𝑖=1 𝐸(𝑋𝑖 ) = 𝑛 × 𝑛𝐸(𝑋) =

𝑛 𝑛

1

× 𝑛 × 𝑚 = 𝑚 ⇒ 𝐸(𝑋̅) = 𝑚

𝑛

∑ 𝑖=𝑛

𝑋𝑖 1 2 1 1 1 𝜎 2

𝑉(𝑋̅) = 𝑉 ( 𝑖=1 ) = ( ) 𝑉(∑𝑖=𝑛 𝑖=𝑛 2

𝑖=1 𝑋𝑖 ) = 𝑛2 ∑𝑖=1 𝑉(𝑋𝑖 ) = 𝑛2 × 𝑛𝑉(𝑋) = 𝑛2 × 𝑛𝜎 = 𝑛

𝑛 𝑛

𝜎

La moyenne d’échantillon 𝑋̅ suit une distribution non précisée de paramètres m et 𝑛, on note :

√

𝐸(𝑋̅) = 𝑚

𝜎 𝜎2

̅

𝑋𝑖 ↝ (𝑚 ; 𝜎) 𝑒𝑡 ⏟ (𝑋1 , 𝑋2 , … , 𝑋𝑛 ) 𝑖𝑖𝑑 ⇒ 𝑋̅ ↝ (𝑚 ; ) , 𝑎𝑣𝑒𝑐 𝑉(𝑋) = 𝑛

é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛 √𝑛 𝜎

𝜎(𝑋̅) =

{ √𝑛

7.3.3.3 Variance empirique ou variance d’échantillon : 𝑺𝟐

𝐸(𝑋𝑖 ) = 𝑚

Soit l’échantillon aléatoire (𝑋1 , 𝑋2 , … , 𝑋𝑛 ) 𝑖𝑖𝑑 et 𝑋𝑖 ↝ (𝑚 ; 𝜎) avec {

𝑉(𝑋𝑖 ) = 𝜎

La variance d’échantillon ou variance empirique est la variable aléatoire 𝑆 2 telle que :

∑𝑖=𝑛 ̅ 2

𝑖=1 (𝑋𝑖 − 𝑋 ) ∑ 𝑋𝑖2

𝑆2 = =[ ] − 𝑋̅ 2

𝑛 𝑛

2

∑(𝑋𝑖 − 𝑋̅) 1 ∑ 𝑋𝑖2 2𝑋̅ 1

𝑆 = 2

= ∑(𝑋𝑖2 − 2𝑋𝑖 𝑋̅ + 𝑋̅ 2 ) = − ∑ 𝑋𝑖 + ∑ 𝑋̅ 2

𝑛 𝑛 𝑛 𝑛 𝑛

1

̅

Or 𝑋 = 𝑛 ∑ 𝑋𝑖 , on tire que ∑ 𝑋𝑖 = 𝑛 𝑋̅

𝑖=𝑛 ̅ 2 ̅2

∑𝑖=𝑛

𝑖=1 𝑎 = 𝑛𝑎 et donc ∑𝑖=1 𝑋 = 𝑛𝑋

2

∑(𝑋𝑖 − 𝑋̅) ∑ 𝑋𝑖2 2𝑋̅ 1 ∑ 𝑋𝑖2 ∑ 𝑋𝑖2

2

𝑆 = = − 𝑛 𝑋̅ + . 𝑛𝑋̅ 2 = − 2𝑋̅ 2 + 𝑋̅ 2 = − 𝑋̅ 2

𝑛 𝑛 𝑛 𝑛 𝑛 𝑛

Notes Dr MAHOP Page 6 of 24

𝑛−1 2

𝑎𝑣𝑒𝑐 𝐸(𝑆 2 ) = 𝜎

𝑛

7.3.3.4 Variance corrigée d’échantillon, Quasi-Variance empirique ou Quasi-variance

d’échantillon : 𝑺′𝟐

La quasi-variance empirique ou quasi-variance d’échantillon ou variance corrigée d’échantillon

est la variable aléatoire 𝑆′2 telle que :

∑𝑖=𝑛 ̅ 2

𝑖=1 (𝑋𝑖 − 𝑋 ) ∑ 𝑋𝑖2 𝑛

2

𝑆′ = =[ ]−( ) 𝑋̅ 2

𝑛−1 𝑛−1 𝑛−1

𝐸(𝑆′2 ) = 𝜎 2

7.3.3.5 Relation 𝑺𝟐 et 𝑺′𝟐

2 2

∑(𝑋𝑖 −𝑋̅) ∑(𝑋𝑖 −𝑋̅ ) 2 2

𝑆2 = et 𝑆′2 = on tire : ∑(𝑋𝑖 − 𝑋̅) = 𝑛𝑆 2 et ∑(𝑋𝑖 − 𝑋̅) = (𝑛 − 1)𝑆′2

𝑛 𝑛−1

2

∑(𝑋𝑖 − 𝑋̅) = 𝑛𝑆 2 (1)

{ 2

∑(𝑋𝑖 − 𝑋̅) = (𝑛 − 1)𝑆′2 (2)

(1) et (2) donnent : 𝑛𝑆 2 = (𝑛 − 1)𝑆′2

𝑛𝑆 2 = (𝑛 − 1)𝑆′2 (1)

𝑛−1 2

S2 = S′ (2)

𝑛

𝑛

S′2 = S2 (3)

𝑛−1

7.3.3.6 écart-type d’échantillon : 𝑺

∑(𝑋𝑖 − 𝑋̅)2 ∑ 𝑋𝑖2

𝑆=√ = √( ) − 𝑋̅ 2

𝑛 𝑛

7.3.3.7 Ecart-type corrigé d’échantillon : 𝑺′

∑(𝑋𝑖 − 𝑋̅)2 ∑ 𝑋𝑖2 𝑛

S'=√ = √( )−( ) 𝑋̅ 2

𝑛−1 𝑛−1 𝑛−1

7.3.3.8 relation S et 𝑺′

√𝑛𝑆 = √(𝑛 − 1)𝑆 ′ (1)

𝑛−1 ′

𝑜𝑢 𝑆 = √ 𝑆 (2)

𝑛

𝑛

𝑜𝑢 𝑆 ′ = √ 𝑆 (3)

𝑛−1

Notes Dr MAHOP Page 7 of 24

7.4 Les paramètres de la population et les estimateurs (ou statistiques) d’échantillon

Les paramètres de la population, notés 𝜃, sont des données ou des informations sur la

population ; ces paramètres sont souvent inconnus.

Exemples de paramètres usuels de la population (𝜃) :

i. Moyenne de la population : 𝜃 = 𝑚 (𝑜𝑢 𝜇)

ii. Variance de la population : 𝜃 = 𝜎 2

iii. Proportion de la population : 𝜃 = 𝑝 (𝑜𝑢 𝜋)

Un estimateur 𝜃̂ du paramètre 𝜃 de la population statistique est une variable aléatoire qui est

fonction d’une suite de n variables aléatoires représentant l’échantillon :

𝜃̂𝑛 = 𝑓(𝑋1 ; 𝑋2 ; … ; 𝑋𝑛 )

Une statistique est un estimateur. Une statistique est une variable aléatoire fonction de

l’échantillon de variables aléatoires (𝑋1 ; 𝑋2 ; … ; 𝑋𝑛 )

Notes Dr MAHOP Page 8 of 24

̂ usuels et leurs estimations ponctuelles

7.5. Tableau des paramètres θ usuels : leurs estimateurs 𝜽

𝜽 ̂

𝜽 Estimation ponctuelle

Paramètre de la population Estimateur de l’échantillon (ou valeur de l’estimateur)

Les estimateurs sont des Les estimations sont écrites en lettres minuscules :

variables écrites en lettres ̅, 𝒔𝟐 , 𝒔′𝟐 , 𝒇, 𝒔; 𝒔′

𝒙

̅ , 𝑺𝟐 , 𝑺′𝟐 , 𝑭

capitales : 𝑿

Taille 𝑁 𝑛

Proportion Proportion de succès dans Fréquence d’échantillon Estimation ponctuelle de la proportion p

une population : p 𝑲 k

̂=𝒑

𝜽 ̂=𝑭= ̂=f=

𝒑

𝜽 = 𝑝 (ou 𝜋) 𝒏 n

Moyenne Moyenne de la population Moyenne d’échantillon Estimation ponctuelle de la moyenne m

𝜽 = 𝑚 (ou 𝜇) ∑ 𝑿𝒊 ∑ 𝑥𝑖

̂=𝒎

𝜽 ̂ =𝑿 ̅= ̂ = 𝑥̅ =

𝒎

𝒏 𝑛

Variance Variance de la population : Variance corrigée d’échantillon 2 ̂ ∑(𝑥𝑖 −𝑥̅ )2 ∑ 𝑥2 𝑛

Estimation de 𝜎 : 𝜎 = 𝑠′ = 𝑛−1 = (𝑛−1𝑖 ) − (𝑛−1) 𝑥̅ 2

2 2

𝜽 = 𝜎2 ∑(𝑋𝑖 − 𝑋̅)2

̂2 = 𝑆′2 =

𝜎 ∑(𝑥𝑖 −𝑥̅ )2 ∑ 𝑥2 𝑛

𝑛−1 Estimation de 𝜎: 𝜎̂ = 𝑠 ′ = √ = √(𝑛−1𝑖 ) − (𝑛−1) 𝑥̅ 2

Écart-type Écart-type de la 𝑛−1

population : Variance d’échantillon Autre méthode d’estimation de 𝜎 : 2 ̂2 = 𝑠′2 = 𝑛 𝑠 2

𝜎 𝑛−1

𝜽=𝜎 ∑(𝑋𝑖 − 𝑋̅)2

̂2

𝜎 =𝑆 =2 𝑛

𝑛 Autre méthode d’estimation de 𝜎: 𝜎̂ = 𝑠′ = √𝑛−1 𝑠

Avec

∑(𝑥𝑖 −𝑥̅ )2 ∑ 𝑥𝑖2

𝑠2 = =( ) − 𝑥̅ 2

𝑛 𝑛

∑(𝑥𝑖 −𝑥̅ )2 ∑ 𝑥𝑖2

𝑠=√ = √( ) − 𝑥̅ 2

𝑛 𝑛

Notes Dr MAHOP Page 9 of 24

7.5 - QUALITÉS D’UN BON ESTIMATEUR : 𝜽 ̂

Voici les principales qualités que devrait avoir un estimateur :

7.5.1 Absence de biais (sans biais ou non biaisé) :

On dit qu’un estimateur 𝜃̂ est non biaisé si sa valeur espérée 𝐸(𝜃̂) est égale au paramètre à

estimer. 𝜽̂ 𝑒𝑠𝑡 𝑠𝑎𝑛𝑠 𝑏𝑖𝑎𝑖𝑠 si 𝑬(𝜽̂) = 𝜽

𝜽̂ 𝑒𝑠𝑡 𝑎𝑠𝑦𝑚𝑝𝑡𝑜𝑡𝑖𝑞𝑢𝑒𝑚𝑒𝑛𝑡 𝑠𝑎𝑛𝑠 𝑏𝑖𝑎𝑖𝑠 𝑠𝑖 lim 𝑬(𝜽

̂) = 𝜽

𝑛→+∞

7.5.2 Convergence :

On dit qu’un estimateur non biaisé 𝜃̂ est convergent si sa distribution tend à se concentrer de

plus en plus autour du paramètre à estimer, lorsque la taille de l’échantillon augmente.

̂ 𝑒𝑠𝑡 𝑐𝑜𝑛𝑣𝑒𝑟𝑔𝑒𝑛𝑡 𝑠𝑖 lim 𝑉(𝜃̂) = 𝟎

𝜽

𝑛→∞

7.5.3 Efficacité :

Dans la classe de tous les estimateurs non biaisés et convergents d’un paramètre, le plus

efficace est celui qui possède la plus petite variance.

̂𝟏 𝑒𝑡 𝜽

Soient : 𝜽 ̂𝟐 si 𝑉(𝜽 ̂𝟐 ) < 𝑉(𝜽̂𝟏 ) alors 𝜽

̂𝟐 est l’estimateur le plus efficace des deux

estimateurs de 𝜽.

̂ est l’estimateur obtenu par la méthode du maximum de vraisemblance (EMV), 𝜽

Si 𝜽 ̂ est

𝝏𝟐 𝑳𝒏(𝑳) 𝟏

̂ ) = −𝑬 ⟦

efficace si 𝑰𝒏 (𝜽 ⟧ =

𝝏𝜽𝟐 ̂

𝜽=𝜽 ̂)

𝑽(𝜽

𝜕2 𝐿𝑛(𝐿)

Où 𝐼𝑛 (𝜃̂) = −𝐸 ⟦ ⟧ est appelé la quantité d’information de Fisher.

𝜕𝜃2 ̂

𝜃=𝜃

̅ , 𝑭 et 𝑺′𝟐

7.6 - Exemple d’estimateurs non biaisés (sans biais) et convergents : 𝑿

7.6.1 Montrons que 𝑭 est un estimateur non biaisé et convergent de la proportion p d’une

population

✓ 𝐹 𝑒𝑠𝑡 𝑢𝑛 𝑒𝑠𝑡𝑖𝑚𝑎𝑡𝑒𝑢𝑟 𝑠𝑎𝑛𝑠 𝑏𝑖𝑎𝑖𝑠 𝑑𝑒 𝑝 𝑠𝑖 𝐸(𝐹) = 𝑝

𝐸(𝑝̂ ) = ⏟

𝐸(𝐹) = 𝑝 ⇒ 𝐸(𝐹) = 𝑝 donc F est un estimateur sans biais de p.

𝑑é𝑗à 𝑑é𝑚𝑜𝑛𝑡𝑟é

✓ 𝐹 est un estimateur convergent de p si lim 𝑉(𝐹) = 0

𝑛→∞

𝑝𝑞 𝑝(1−𝑝) 𝑝(1−𝑝)

𝑉(𝑝̂ ) = 𝑉(𝐹)

⏟ = = ⇒ lim 𝑉(𝐹) = lim = 0; lim 𝑉(𝐹) = 0

𝑛 𝑛 𝑛→∞ 𝑛→∞ 𝑛 𝑛→∞

𝑑é𝑗à 𝑑é𝑚𝑜𝑛𝑡𝑟é

𝐹 est donc un estimateur convergent de p.

𝒊=𝒏

7.6.2 Montrons que 𝒎 ̂ =𝑿 ̅ = ∑𝒊=𝟏 𝑿𝒊 est un estimateur non biaisé et convergent de la

𝒏

moyenne m d’une population

𝐸(𝑋𝑖 ) = 𝑚

Soit l’échantillon aléatoire (𝑋1 , 𝑋2 , … , 𝑋𝑛 ) 𝑖𝑖𝑑 et 𝑋𝑖 ↝ (𝑚 ; 𝜎) avec {

𝑉(𝑋𝑖 ) = 𝜎

̅

✓ 𝑋 𝑒𝑠𝑡 𝑢𝑛 𝑒𝑠𝑡𝑖𝑚𝑎𝑡𝑒𝑢𝑟 𝑠𝑎𝑛𝑠 𝑏𝑖𝑎𝑖𝑠 𝑑𝑢 𝑝𝑎𝑟𝑎𝑚è𝑡𝑟𝑒 𝑚, 𝑠𝑖 𝐸(𝑋) = 𝑚 ̅

𝐸(𝑚̂ ) = 𝐸(𝑋⏟ ̅) = 𝑚 donc X̅ est un estimateur sans biais de m.

𝑑é𝑗à 𝑑é𝑚𝑜𝑛𝑡𝑟é

Notes Dr MAHOP Page 10 of 24

✓ 𝑋̅ est un estimateur convergent de m si lim 𝑉(𝑋̅) = 0

𝑛→∞

𝜎 2 𝜎 2

̅

̂ ) = 𝑉(𝑋 lim 𝑉(𝑋̅) = lim 𝑛 = 0 ⇒ lim 𝑉(𝑋̅) = 0

𝑉(𝑚 ⏟ ) = 𝑛 et 𝑛→∞ 𝑛→∞ 𝑛→∞

𝑑é𝑗à 𝑑é𝑚𝑜𝑛𝑡𝑟é

𝑋̅ est donc un estimateur convergent de m.

7.6.3 𝑺𝟐 est un estimateur biaisé de 𝝈𝟐

✓ En revanche, 𝑆 2 est un estimateur biaisé de 𝜎 2

2

Supposons que 𝜎̂2 = 𝑆 2 = ∑(𝑋𝑖 −𝑋̅)

𝑛

̂2 ) = 𝐸(𝑆 = 𝐸 (

2) ∑(𝑋𝑖 −𝑋̅)2 𝑛−1 𝑛−1

𝐸(𝜎 ) = 𝑛 𝜎 2 ⇒ 𝐸(𝑆 2 ) = 𝑛 𝜎 2

𝑛

𝑆 2 est un estimateur biaisé de 𝜎 2 .

𝑛−1 𝜎2

Le biais est : 𝐸(𝑆 2 ) − 𝜎 2 = 𝜎2 − 𝜎2 = −

𝑛 𝑛

7.6.4 𝑺′𝟐 est un estimateur non biaisé de 𝝈𝟐

✓ 𝑆′2 est un estimateur non biaisé de 𝜎 2

2

posons que 𝜎̂2 = 𝑆′2 = ∑(𝑋𝑖 −𝑋̅)

𝑛−1

′2

∑(𝑋𝑖 − 𝑋̅)2 𝑛 𝑛 𝑛 𝑛−1 2

̂ 2

𝐸(𝜎 ) = 𝐸(𝑆 ) = 𝐸 ( )= 𝐸( 𝑆 2) = 𝐸(𝑆 2 ) = ( ) 𝜎 = 𝜎2

𝑛−1 𝑛−1 𝑛−1 𝑛−1 𝑛

2

𝐸(𝑆 ′ ) = 𝜎 2 ⇒ 𝑆′2 est un estimateur sans biais de 𝜎 2 .

̅ )𝟐

∑(𝑿𝒊 −𝑿

7.6.5 L’estimateur sans biais de 𝝈𝟐 𝒆𝒔𝒕 𝑺′𝟐 = .

𝒏−𝟏

7.7 Exercices d’application : Estimation ponctuelle de la moyenne (m) et l’écart-type (𝝈)

d’une population

Exercice 1 :

Une entreprise fabrique un certain type de composants électroniques dont la durée de vie X,

exprimée en heures, est une variable aléatoire. Des mesures effectuées sur un échantillon

aléatoire de taille 50 ont donné les résultats suivants :

∑50 50 2

𝑖=1 𝑥𝑖 = 60 000 ; ∑𝑖=1 𝑥𝑖 = 74.10

6

a). Donner une estimation ponctuelle de la durée de vie moyenne des composants.

b). Donner une estimation ponctuelle de l'écart-type de cette durée de vie.

Corrigé exercice 1

1. Identifier la variable aléatoire X (unités) et sa loi si possible.

2. Sur le brouillon, repérer les paramètres de la population et les données d’échantillon

donnés par l’exercice.

Population : paramètres Echantillon : estimation

𝑁= 𝑛 = 50

𝑝= k

̂=f=

𝒑 n

𝑚= 𝒎̂ = 𝑥̅ =

2 ̂2 = 𝑠′2 =

𝜎 = 𝜎

𝜎= 𝜎̂ = 𝑠′ =

Notes Dr MAHOP Page 11 of 24

3. Puis procéder aux calculs exigés pour répondre aux questions.

X = la durée de vie des composants en heures. Et X↝ (m; ).

a) Estimation ponctuelle de m : n = 50

∑50

𝑖=1 𝑥𝑖 60000

̂ =𝑥̅ =

𝑚 = = 1200 ℎ𝑒𝑢𝑟𝑒𝑠

𝑛 50

∑(𝑥𝑖 −𝑥̅ )2 𝑛

b) Estimation ponctuelle de l'écart-type : 𝜎̂= s'=√ 𝑜𝑢 𝑠 ′ = √𝑛−1 𝑠 𝑒𝑡 𝑛 = 50

𝑛−1

∑(𝑥𝑖 −𝑥̅ )2 ∑ 𝑥𝑖2 𝑛 74000000 50

s'=√ = √(𝑛−1) − 𝑛−1 𝑥̅ 2 = √( ) − (50−1 × 12002 ) = 202,0305 ℎ𝑒𝑢𝑟𝑒𝑠

𝑛−1 50−1

𝜎̂= s'=202,03 heures

𝑛 ∑(𝑥𝑖 −𝑥̅ )2 ∑ 𝑥𝑖2

Autre méthode : 𝑠 ′ = √𝑛−1 𝑠 𝑎𝑣𝑒𝑐 𝑠 = √ = √( ) − 𝑥̅ 2

𝑛 𝑛

✓ Variance d’échantillon

∑50 2

𝑖=1 𝑥𝑖 ∑50 2

𝑖=1 𝑥𝑖 74.000.000

𝑠2 = [ ] − 𝑥̅ 2 = [ ] − 𝑥̅ 2 = [ ] − 12002 = 40.000

𝑛 50 50

✓ Ecart-type d’échantillon s : s=√40000 = 200

✓ Estimation ponctuelle de l'écart-type : 𝜎̂= s'

𝑛 50

𝜎̂= s'=√ 𝑠 = √ × 200 = 202,0305 ℎ𝑒𝑢𝑟𝑒𝑠

𝑛−1 49

Lorsque 𝑛 > 30, 𝑠′ ≈ 𝑠

Exercice 2. On prélève un échantillon de 50 copies d’examen ; et on trouve une note moyenne

d'échantillon de 12,3.

Sachant que ∑50 2

i=1(xi − x) = 384 On suppose que les notes sont normalement distribuées

a). Donner une estimation ponctuelle de la durée de vie moyenne des composants.

b). Donner une estimation ponctuelle de l'écart-type de cette durée de vie.

Indication de corrigé exercice 2

Population : paramètres Echantillon : estimation

𝑁= 𝑛 = 50

𝑚= 𝑥̅ = 12,3

2

𝜎 = ∑50 2

i=1(xi − x) = 384

𝜎= 𝜎̂ = 𝑠′ =

X = les notes. Et X↝ (m ; ).

a) Estimation ponctuelle de m : n = 50 𝑚̂ =𝑥̅ = 12,3

∑(𝑥𝑖 −𝑥̅ )2 384

b) Une estimation ponctuelle de l'écart-type : 𝜎̂ = 𝑠 ′ = √ = √50−1 = 2,799

𝑛−1

𝑛 𝑛 ∑(𝑥𝑖 −𝑥̅ )2 50 384

Autrement 𝜎̂ = 𝑠 ′ = √𝑛−1 𝑠 = √𝑛−1 × = √49 × = 2,799

𝑛 50

∑(𝑥𝑖 −𝑥̅ )2 384

𝑠=√ = √ 50 = 2,771

𝑛

Exercice 3 - Dans cette partie, on suppose que m et sont inconnus.

On a relevé dans le tableau suivant les résultats de 10 pesées d’un même objet :

Notes Dr MAHOP Page 12 of 24

Masse

72,20 72,24 72,26 72,30 72,36 72,39 72,42 72,48 72,50 72,54

(en g)

Les résultats seront arrondis au centième le plus proche.

1°) Calculer la moyenne et l’écart –type de cet échantillon

2°) En déduire les estimations ponctuelles de la moyenne m et de l’écart-type de la population.

Réponse - Exercice 3

1°) Calculer la moyenne et l’écart –type de cet échantillon

X : variable aléatoire, X = masse (ou poids) en g ; et 𝑥𝑖 : les différentes valeurs de X.

Moyenne de l’échantillon : 𝑥̅ Tableau de calcul

∑ 𝑥𝑖 723,6907 𝑥𝑖 𝑥𝑖2

𝑥̅ = = = 72,36907

𝑛 ⏟ 10 72,200 5212,840

𝑣𝑜𝑖𝑟 𝑙𝑒 𝑡𝑎𝑏𝑙𝑒𝑎𝑢 72,240 5218,618

𝑑𝑒 𝑐𝑎𝑙𝑐𝑢𝑙

72,260 5221,508

2

Variance de l’échantillon : 𝑠 72,300 5227,290

2 2

∑(𝑥 𝑖 − 𝑥̅ ) ∑ 𝑥 𝑖 72,360 5235,970

𝑠2 = =[ ] − 𝑥̅ 2

𝑛 𝑛 72,390 5240,312

52372,845 72,420 5244,656

𝑠2 = [ ] − 72,36907 = 0,01237

10 72,480 5253,350

72,500 5256,250

Écart –type d’échantillon : 72,540 5262,052

𝑠 = √0,01237 = 0,111 Total 2

∑ 𝑥𝑖 = 723, 6907 ∑ 𝑥𝑖 = 52372,845

2°) En déduire les estimations ponctuelles de la moyenne m et de l’écart-type de la population.

Estimation ponctuelle de la Estimation ponctuelle de l’écart-type de la population 𝜎:

moyenne d’échantillon m: 𝑚 ̂ = 𝑥̅ 𝑛 10

𝑚

̂ = 𝑥̅ = 72,36907 𝜎̂ = 𝑠′ = √𝑛−1 × 𝑠 = √ 9 × 0,111 = 0,117

Exercice 4 - On a contrôlé le dosage d’un produit dans un mélange à la sortie d’une chaîne de

conditionnement. Pour un échantillon de 100 lots de 5 kilogrammes de mélange analysés, on a

obtenu les résultats suivants, où xi représente la masse du produit exprimée en grammes et ni

l’effectif correspondant :

xi 142 144 146 148 150 152 154 156 158 160

ni 1 5 6 21 32 22 7 4 1 1

1. Calculer la moyenne et l’écart-type de l’échantillon.

2. Donner une estimation ponctuelle de la moyenne et de l’écart-type.

Corrigé exercice 4

1. Calculer la moyenne et l’écart-type de l’échantillon.

X = masse du produit en g

Formules et tableau de calcul

Tableau de calcul

La moyenne d’échantillon : 𝑥̅ xi ni 𝑛𝑖 𝑥𝑖 𝑛𝑖 𝑥𝑖2

∑ 𝑛𝑖 𝑥𝑖 15010

𝑥̅ = 𝑛 = 100 = 150,10 𝑔 142 1 142 20164

144 5 720 103680

L’écart-type de l’échantillon : s

Notes Dr MAHOP Page 13 of 24

∑ 𝑛𝑖 𝑥𝑖2 146 6 876 127896

𝑠 = √[ ] − (𝑥̅ )2

𝑛 148 21 3108 459984

2253932 150 32 4800 720000

𝑠 = √[ ] − (150,1)2 = 3,051

100

152 22 3344 508288

154 7 1078 166012

156 4 624 97344

158 1 158 24964

160 1 160 25600

Total ∑ 𝑛𝑖 = ∑ 𝑛𝑖 𝑥𝑖 = ∑ 𝑛𝑖 𝑥𝑖2 =

100 15010 2253932

2. Donner une estimation ponctuelle de la moyenne et de l’écart-type de la population.

Estimation ponctuelle de la moyenne de la population : 𝑚 ̂ = 𝑥̅ = 150,10 𝑔

Estimation ponctuelle de l’écart-type de la population : 𝜎̂ = s′

𝑛 100

𝜎̂ = s′ = √𝑛−1 × 𝑠 = √ 99 × 3,051 = 3,066 𝑔 𝜎̂ = s ′ = 3,066

Autre méthode :

∑ 𝑛𝑖 𝑥𝑖2 𝑛 2253932 100

𝑠 ′ = √( ) − (𝑛−1) 𝑥̅ 2 = √( ) − (100−1) (150,1)2 = 3,0666

𝑛−1 100−1

Exercice – Lors d’un sondage précédant des élections, 500 personnes ont été interrogées. Bien

que ce ne soit pas en pratique, on suppose pour simplifier les calculs que les 500 personnes

représentent un échantillon indépendant et identiquement distribué de la population.

Sur les 500 personnes, 150 ont répondu vouloir voter pour le candidat C1 et 140 pour le candidat

C2.

1. Donner une estimation ponctuelle des intentions de votes, sous forme de pourcentage.

2. Donner un intervalle de confiance à 95% pour les intentions des votes de chacun des

deux.

Solution – n=500 ; k1=150 ; k2=140

1- Estimation ponctuelle des intention de votes : il s’agit d’une estimation ponctuelle de la

proportion p des intentions de votes

Succès = intention de vote pour le candidat 𝐶𝑖 𝑖 ∈ {1; 2}

𝑘 = 𝑁𝑜𝑚𝑏𝑟𝑒 𝑑𝑒 𝑠𝑢𝑐𝑐è𝑠 𝑑𝑎𝑛𝑠 𝑙’é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛 𝑝𝑜𝑢𝑟 𝑙𝑒 𝑐𝑎𝑛𝑑𝑖𝑑𝑎𝑡 𝐶𝑖

𝑓 = 𝑓𝑟é𝑞𝑢𝑒𝑛𝑐𝑒 𝑑𝑒 𝑠𝑢𝑐𝑐è𝑠 𝑑𝑎𝑛𝑠 𝑙’é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛 𝑝𝑜𝑢𝑟 𝑙𝑒 𝑐𝑎𝑛𝑑𝑖𝑑𝑎𝑡 𝐶𝑖

𝑛 = 𝑡𝑎𝑖𝑙𝑙𝑒 𝑑𝑒 𝑙’é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛

𝑘

𝑝̂ = 𝑓 = 𝑛

Estimation de la proportion des intentions de votes pour le candidat 𝐶1

𝑘1 = 𝑁𝑜𝑚𝑏𝑟𝑒 𝑑𝑒 𝑠𝑢𝑐𝑐è𝑠 𝑑𝑎𝑛𝑠 𝑙’é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛 𝑝𝑜𝑢𝑟 𝑙𝑒 𝑐𝑎𝑛𝑑𝑖𝑑𝑎𝑡 𝐶1 = 150

𝑛 = 500 = 𝑡𝑎𝑖𝑙𝑙𝑒 𝑑𝑒 𝑙’é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛

𝑘1 150

𝑝

̂1 = 𝑓1 = = = 0,3 𝑠𝑜𝑖𝑡 30%

𝑛 500

Estimation de la proportion des intentions de votes pour le candidat 𝐶2

𝑘2 = 𝑁𝑜𝑚𝑏𝑟𝑒 𝑑𝑒 𝑠𝑢𝑐𝑐è𝑠 𝑑𝑎𝑛𝑠 𝑙’é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛 𝑝𝑜𝑢𝑟 𝑙𝑒 𝑐𝑎𝑛𝑑𝑖𝑑𝑎𝑡 𝐶2 = 140

Notes Dr MAHOP Page 14 of 24

𝑛 = 500 = 𝑡𝑎𝑖𝑙𝑙𝑒 𝑑𝑒 𝑙’é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛

𝑘2 140

𝑝

̂2 = 𝑓2 = = = 0,28 𝑠𝑜𝑖𝑡 28%

𝑛 500

𝐾

L’estimateur d’une proportion est la variable 𝑝̂ = 𝐹 = (fréquence d’échantillon) ; lorsque

𝑛

𝑝(1−𝑝)

n=500>30, F suit une loi 𝑁 (𝑝; √ ) ; et on obtient :

𝑛

𝑘 𝑘1 150

𝑝̂ = 𝑓 = ⇒ 𝑝̂1 = 𝑓1 = = = 0,3 ; soit 30% pour C1 ;

𝑛 𝑛 500

𝑘2 140

et 𝑝̂ 2 = 𝑓2 = = = 0,28 ; soit 28% pour C2 .

𝑛 500

2- Intervalles de confiance à 95% ; ils sont de la forme suivante :

𝑓(1−𝑓) 𝑓(1−𝑓)

𝑝𝑖 ∈ ]𝑓𝑖 − 𝑢1−𝛼/2 √ ; 𝑓𝑖 + 𝑢1−𝛼/2 √ [

𝑛 𝑛

1-𝛼=0,95 ⇒ 𝛼=0,05 ⇒ 𝑢1−𝛼/2 = 1,96

Pour le candidat C1

0,3 × 0,7 0,3 × 0,7

𝑝1 ∈ ]0,3 − 1,96√ ; 0,3 + 1,96√ [ avec 𝑝1 ∈ ]0,2598;0,3402[

500 500

Conclusion : Ainsi au niveau de confiance de 95%, les chances de C1 sont comprises entre

25,98% et 34,02 %.

Pour le candidat C2

0,28 × 0,72 0,28 × 0,72

𝑝2 ∈ ]0,28 − 1,96√ ; 0,28 + 1,96√ [ avec 𝑝2 ∈ ]0,2406;0,3194[

500 500

Conclusion : Ainsi au niveau de confiance de 95%, les chances de C2 sont comprises entre

24,06% et 31,94%.

Exercice - le gouvernement d’un pays démocratique souhaite connaître la proportion p

d’électeurs en accord avec un nouveau texte de loi (« le mariage pour tous » par exemple). Pour

cela il organise un sondage sur un échantillon aléatoire (X1, X2, . . .Xn ), et sur 100 personnes

interrogées, 80 pensent voter oui.

1. Proposer un estimateur sans biais de p.

2. Déterminer un intervalle de confiance pour p au niveau de confiance 95%.

Solution – Soit X la variable aléatoire définie par :

Estimation ponctuelle de p

Succès = électeurs en accord avec le nouveau texte de loi.

𝑘 = 𝑁𝑜𝑚𝑏𝑟𝑒 𝑑𝑒 𝑠𝑢𝑐𝑐è𝑠 𝑑𝑎𝑛𝑠 𝑙’é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛 = 80

𝑛 = 𝑡𝑎𝑖𝑙𝑙𝑒 𝑑𝑒 𝑙’é𝑐ℎ𝑎𝑛𝑡𝑖𝑙𝑙𝑜𝑛 = 100

𝑘 80

𝑝̂ = 𝑓 = 𝑛 = 100 = 0,8 𝑠𝑜𝑖𝑡 80%

Notes Dr MAHOP Page 15 of 24

𝑘 80

𝑓= = = 0,8

𝑛 100

1 si la personne est favorable

𝑋={ ; X suit une loi de Bernoulli. B(1 ; p).

0 si non

∑𝑛 𝑋𝑖 𝐾

1) Un estimateur de p est la fréquence d’échantillon 𝑝̂ = 𝐹 = 𝑖=1 =𝑛

𝑛

𝐾 1 1

F est sans biais ; en effet 𝐸(𝑝̂ ) = 𝐸(𝐹) = 𝐸 (𝑛 ) = 𝑛 𝐸(𝐾) = 𝑛 × 𝑛𝑝 = 𝑝

2) Intervalle de confiance pour p

n = 100>30, et k=80 ; 1-α = 0,95

𝑓(1−𝑓) 𝑓(1−𝑓)

𝑝 ∈ ]𝑓 − 𝑢1−𝛼 √ ; 𝑓 + 𝑢1−𝛼/2 √ [

2 𝑛 𝑛

𝑘 80

𝑓 = 𝑛 = 100 = 0,8 ; 1-𝛼=0,95 ⇒ 𝛼=0,05 ⇒ 𝑢1−𝛼/2 = 1,96

0,8(0,2) 0,8(0,2)

𝑝 ∈ ]0,8 − 1,96√ ; 0,8 + 1,96√ [ soit p ∈ ]0,7216; 0,8784[

100 100

Conclusion : Au niveau de confiance de 95%, le pourcentage des personnes favorables au

nouveau texte est compris entre 72,16% et 87,84%.

7.8 Théorème central limite

7.8.1 Théorème central limite (𝒏 > 𝟑𝟎) et loi de distribution de 𝑭

✓ Soit X une variable aléatoire suivant une loi de Bernoulli, 𝑋 ↝ ℬ(1; 𝑝), telle que :

𝐸(𝑋) = 𝑝, 𝑉(𝑋) = 𝑝𝑞 = 𝑝(1 − 𝑝) ;

✓ Soit un échantillon de n variables aléatoires (𝑋1 , 𝑋2 , … 𝑋𝑖 , … , 𝑋𝑛 ) indépendantes et

identiquement distribuées (iid) selon la loi de Bernoulli avec :

𝑋𝑖 ↝ ℬ(1; 𝑝) ⇒ 𝐸(𝑋𝑖 ) = 𝐸(𝑋) = 𝑝 et 𝑉(𝑋𝑖 ) = 𝑉(𝑋) = 𝑝𝑞 = 𝑝(1 − 𝑝).

𝑖=𝑛

✓ 𝐾= ∑ ⏟𝑖=1 𝑋𝑖 ⇒ 𝐾 ↝ ⏟ ℬ(𝑛; 𝑝)

𝑠𝑜𝑚𝑚𝑒 𝑑𝑒 𝑙𝑜𝑖

𝑛 𝑣𝑎𝑟𝑖𝑏𝑙𝑒𝑠 𝑏𝑖𝑛𝑜𝑚𝑖𝑎𝑙𝑒

𝑖𝑛𝑑é𝑝𝑒𝑛𝑑𝑎𝑛𝑡𝑒𝑠

𝑑𝑒 𝐵𝑒𝑟𝑛𝑜𝑢𝑙𝑙𝑖

Le théorème central limite (TCL) énonce que pour une taille d’échantillon n très grand, en

pratique pour 𝒏 > 𝟑𝟎, on a :

a. Approximation de la loi binomiale par la loi normale

𝐾 − 𝑛𝑝

𝑠𝑖 𝐾 ↝ ⏟

ℬ(𝑛; 𝑝) 𝑒𝑡 𝒏 > 𝟑𝟎 ⇒ 𝐾 ↝ 𝑁(𝑛𝑝 ; √𝑛𝑝(1 − 𝑝)) ⇒ 𝑈 = ↝ 𝑁(0 ; 1)

𝑙𝑜𝑖 √𝑛𝑝(1 − 𝑝)

𝑏𝑖𝑛𝑜𝑚𝑖𝑎𝑙𝑒

b. Loi de distribution de F

𝐾 𝑝(1 − 𝑝) 𝐹−𝑝

𝐹= 𝑒𝑡 𝒏 > 𝟑𝟎 ⇒ 𝐹 ↝ 𝑁 (𝑝 ; √ ) ⟹𝑈= ↝ 𝑁(0 ; 1)

𝑛 𝑛

√𝑝(1 − 𝑝)

𝑛

Notes Dr MAHOP Page 16 of 24

7.8.2 Théorème central limite (𝒏 > 𝟑𝟎) et loi de distribution de 𝑿 ̅

✓ Soit X une variable aléatoire dont la distribution est telle que :

𝐸(𝑋) = 𝑚, 𝑉(𝑋) = 𝜎 2 et 𝜎(𝑋) = 𝜎.

✓ Soit un échantillon de n variables aléatoires (𝑋1 , 𝑋2 , … , 𝑋𝑖 , … , 𝑋𝑛 ) indépendantes et

identiquement distribuées (iid) selon la loi de X avec :

✓ 𝐸(𝑋𝑖 ) = 𝐸(𝑋) = 𝑚 et 𝑉(𝑋𝑖 ) = 𝑉(𝑋) = 𝜎 2 .

Le théorème central limite (TCL) énonce que pour une taille d’échantillon n très grand, en

pratique pour 𝒏 > 𝟑𝟎, on a :

a. loi de distribution de 𝑋̅ si σ connu

𝜎 𝑋̅ − 𝑚

si σ connu ⇒ 𝑋̅ ↝ 𝑁 (𝑚 ; ) ⟹ 𝑈 = 𝜎 ↝ 𝑁(0 ; 1)

√𝑛

√𝑛

b. loi de distribution de 𝑋̅ si σ inconnu

𝑠′ 𝑋̅ − 𝑚

̂=s' ⇒ 𝑋̅ ↝ 𝑁 (𝑚 ;

si σ inconnu et σ ) ⟹𝑈= ↝ 𝑁(0 ; 1)

√𝑛 𝑠′

√𝑛

̅ lorsque 𝒏 ≤ 𝟑𝟎

7.8.3 loi de distribution de 𝑿

a. loi de distribution de 𝑋̅ si n≤30 et σ connu

𝜎 𝑋̅ − 𝑚

si n≤30 et 𝑋𝑖 ↝ 𝒩(𝑚; 𝜎) et σ connu ⇒ 𝑋̅ ↝ 𝑁 (𝑚 ; ) ⟹𝑈= 𝜎 ↝ 𝑁(0 ; 1)

√𝑛

√𝑛

b. loi de distribution de 𝑋̅ si n≤30 et σ inconnu et σ̂=s'

𝑠′ 𝑋̅ − 𝑚

si n≤30 et 𝑋𝑖 ↝ 𝒩(𝑚; σ ̂=s' ⇒ 𝑋̅ ↝ 𝑁 (𝑚 ;

̂) et σ inconnu et σ ) ⟹𝑇= ↝ 𝑇𝑛−1

√𝑛 𝑠′

√𝑛

𝑇𝑛−1 : 𝑙𝑜𝑖 𝑑𝑒 𝑆𝑡𝑢𝑑𝑒𝑛𝑡 à (𝑛 − 1) 𝑑é𝑔𝑟é𝑠 𝑑𝑒 𝑙𝑖𝑏𝑒𝑟𝑡é𝑠

𝟐

7.8.5 loi de distribution de 𝐒 ′

2

(𝑛−1)𝑆 ′

On montre aussi que la variable aléatoire 𝜎2

suit la loi de Khi 2 à (n-1) degrés de

liberté (ddl). Et on écrit :

𝐸(𝑊) = 𝑛 − 1

(𝑛 − 1)𝑆 ′ 2

𝑊= 2

2

↝ 𝜒𝑛−1 𝑎𝑣𝑒𝑐 { 𝑉(𝑊) = 2(𝑛 − 1)

𝜎

𝜎(𝑊) = √2(𝑛 − 1)

Conclusion

𝑌𝑖 ↝ 𝑁(𝑚 ; 𝜎) 𝑌 − 𝑌̅ 𝐸(𝑊) = 𝑛 − 1

𝑖 (𝑛 − 1)𝑆′2

𝑆𝑖 { 𝑒𝑡 𝑚 𝑖𝑛𝑐𝑜𝑛𝑛𝑢 ⇒ ↝ 𝑁(0 ; 1) ⇒ 2

↝ 𝜒𝑛−1 𝑎𝑣𝑒𝑐 { 𝑉(𝑊) = 2(𝑛 − 1)

𝜎 𝜎 2

𝑒𝑡 𝑚̂ = 𝑌̅ 𝜎(𝑊) = √2(𝑛 − 1)

7.8.7 théorème central limite et approximations d’autres lois par la loi normale

Approximation de la loi du Chi-deux (ou Khi-deux) à n degrés de liberté : 𝜒𝑛2

Notes Dr MAHOP Page 17 of 24

𝑋−𝑛

↝ 𝑁(0 ; 1)

𝑠𝑖 𝑋 ↝ 𝜒𝑛2 𝑒𝑡 𝑛 > 30 ⇒ 𝑋 ↝ 𝑁(𝑛 ; √2𝑛) ⟹ { √2𝑛

√2𝑋 − √2𝑛 − 1 ↝ 𝑁(0 ; 1), 𝑝𝑜𝑢𝑟 𝑛 𝑝𝑒𝑡𝑖𝑡

Approximation de la loi de Student à n degrés de liberté : 𝑇𝑛

𝑠𝑖 𝑋 ↝ 𝑇𝑛 𝑒𝑡 𝑛 > 30 ⇒ 𝑋 ↝ 𝑁(0 ; 1)

Approximation de la loi de Poisson par la loi normale

𝑋−𝜆

𝑠𝑖 𝑋 ↝ 𝒫(𝜆) 𝑒𝑡 𝑛 > 30 𝑒𝑡 𝜆 > 18 ⇒ 𝑋 ↝ 𝑁(𝜆 ; √𝜆) ⟹ ↝ 𝑁(0 ; 1)

√𝜆

7.8.8 Autres approximations de lois

Approximation de la loi hypergéométrique par la loi binomiale

𝑖=𝑛

𝑆𝑖 𝐾 = ∑ 𝑋𝑖 ↝ ℋ(𝑁, 𝑛; 𝑝) ⟹

⏟ 𝐾 ↝ ℬ(𝑛; 𝑝)

𝑛

𝑖=1 𝑠𝑖 <0,05 𝑒𝑡 𝑛>30 𝑒𝑡 𝑝<0,1 (𝑜𝑢 0<𝑛𝑝<10)

𝑁

Approximation de la loi binomiale par la loi de Poisson

𝑖=𝑛

𝑆𝑖 𝐾 = ∑ 𝑋𝑖 ↝ ℬ(𝑛; 𝑝) ⟹

⏟ 𝐾 ↝ 𝒫(𝜆 = 𝐸(𝐾) = 𝑛𝑝)

𝑖=1 𝑛>30 𝑒𝑡 𝑝<0,1 𝑒𝑡 0<𝑛𝑝<15

Notes Dr MAHOP Page 18 of 24

7.9 Tableau des propriétés de la moyenne et de la fréquence d’échantillon en situations « avec remise » ou « sans remise »

Estimateurs Formule Espérance Variance Ecart-type

d’échantillon mathématique Tirage avec remise= tirage indépendant Avec ou sans remise

(ou moyenne) Tirage sans remise = tirage non

independant

∑ 𝑿𝒊 ̅) = 𝑚 𝜎2 𝜎

Moyenne 𝐸(𝑿 ̅ ) = , avec remise

𝑉(𝑿 ̅) =

𝜎(𝑿 , avec remise

̅=

𝑿 √𝑛

d’échantillon 𝒏 𝑛

(Tirage indépendant, non exhaustif);

𝜎 𝑁−𝑛

(ou moyenne ̅) =

𝜎(𝑿 √( ), sans remise;

𝜎2 𝑁−𝑛 √𝑛 𝑁−1

empirique) 𝑉(𝑿̅) = ( ), sans remise ;

𝑛 𝑁−1

(Tirage non indépendant, exhaustif);

𝑲 𝑝𝑞

Fréquence 𝐸(𝑭) = 𝑝 𝑉(𝑭) = 𝑛 , avec remise; 𝑝𝑞

𝑭= 𝜎(𝐹) = √ 𝑛 , avec remise

d’échantillon 𝒏

𝑝(1−𝑝) 𝑁−𝑛 𝑝(1−𝑝) 𝑁−𝑛

𝑉(𝑭) = ( ) , sans remise; 𝜎(𝐹) = √ ( ), sans remise;

𝑛 𝑁−1 𝑛 𝑁−1

NB : Tirage avec remise ou indépendant

𝑛

Si N est très grand ou N inconnu ou si le taux de sondage 𝑁 < 0,05 on admet que le tirage se fait avec remise et est dit indépendant.

Notes Dr MAHOP Page 19 of 24

7.10 formules simples et pondérées de la variance d’échantillon (𝒔𝟐 ) et la variance corrigée d’échantillon 𝒔′𝟐

𝑥̅ 𝑠2 𝑠′2

Moyenne Variance d’échantillon Quasi-variance d’échantillon

d’échantillon

𝑠′2 permet une estimation ponctuelle de la variance 𝜎 2

inconnue de la population : 𝜎 ̂2 = 𝑠′2

Formule simple ∑ 𝑥𝑖 ∑(𝑥𝑖 − 𝑥̅ )2 ∑ 𝑥𝑖2 ∑(𝑥𝑖 − 𝑥̅ )2 ∑ 𝑥𝑖2 𝑛

𝑥̅ = 𝑠2 = =[ ] − 𝑥̅ 2 𝑠′2 = =( )−( ) 𝑥̅ 2

𝑛 𝑛 𝑛 𝑛−1 𝑛−1 𝑛−1

Formule pondérée par ∑ 𝑛𝑖 𝑥𝑖

2

∑ 𝑛𝑖 (𝑥𝑖 − 𝑥̅ )2 ∑ 𝑛𝑖 𝑥𝑖2 2 2

∑ 𝑛𝑖 (𝑥𝑖 − 𝑥̅ )2 ∑ 𝑛𝑖 𝑥𝑖2 𝑛

les effectifs (𝑛𝑖 ) 𝑥̅ = 𝑠 = = [ ] − 𝑥̅ 𝑠′ = = ( )−( ) 𝑥̅ 2

𝑛 𝑛 𝑛 𝑛−1 𝑛−1 𝑛−1

Formule pondérée par 𝑥̅ = ∑ 𝑓𝑖 𝑥𝑖 𝑠 2 = ∑ 𝑓𝑖 (𝑥𝑖 − 𝑥̅ )2 = [∑ 𝑓𝑖 𝑥𝑖2 ] − 𝑥̅ 2

les fréquences (𝑓𝑖 )

Notes Dr MAHOP Page 20 of 24

7.11 Tableau des distributions d’échantillonnages

̅ ) pour 𝒏 > 𝟑𝟎 : avec ou sans remise

7.11.1 Distribution d’échantillonnage de la moyenne d’échantillon (𝑿

̅

𝑛 > 30 Avec remise Loi de X 𝜎 : connu → 𝑋 ̅ ↝ 𝒩(𝑚; 𝜎 ) → U = X−m σ ↝ 𝒩(0; 1)

indépendant quelconque ⏟ √ 𝑛

√n

Application 𝑋𝑖 → (𝑚; 𝜎) 𝑛>30

du ∑𝑖=𝑛(𝑋 −𝑋̅)2 ̅ −m

𝒔′ X

théorème 𝜎 : inconnu → 𝜎̂ = 𝑠′ = √ 𝑖=1 𝑛𝑖 → 𝑋̅ ↝ 𝒩(𝑚; 𝒏) → U = 𝑆′ ↝ 𝒩(0; 1)

√

central √n

limite Sans remise Loi de X 𝜎 𝑁−𝑛 ̅ −m

X

Non quelconque 𝜎 : connu → 𝑋̅ ↝ 𝒩(𝑚; 𝑛 √ 𝑁−1) → U = σ 𝑁−𝑛 ↝ 𝒩(0; 1)

⏟ √ √

independance 𝑋𝑖 → (𝑚; 𝜎) 𝑛>30

√n 𝑁−1

∑𝑖=𝑛 ̅ 2

𝑖=1 (𝑋𝑖 −𝑋) 𝒔′ 𝑁−𝑛 ̅ −m

X

𝜎 : inconnu → 𝜎̂ = 𝑠′ = √ → 𝑋̅ ↝ 𝒩(𝑚; 𝑛 √ 𝑛−1 ) →U= ↝

𝑛 ⏟ √ 𝒔′ 𝑁−𝑛

√

√n 𝑛−1

𝑛>30

𝒩(0; 1)

Notes de cours Estimation Statistiques / Dr MAHOP Page 21/24

̅ ) pour 𝒏 ≤ 𝟑𝟎 : avec ou sans remise

7.11.2 Distribution d’échantillonnage de la moyenne d’échantillonnage (𝑿

𝑛 ≤ 30 Avec 𝑋𝑖 → 𝒩(𝑚; 𝜎) 𝜎 ̅ −m

X

𝜎 : connu → 𝑋̅ ↝ 𝒩(𝑚; 𝑛) → U = σ ↝ 𝒩(0; 1)

remise √

√n

Le théorème 𝑠′ ̅ −m

X

central 𝜎 : inconnu → 𝜎̂ = 𝑠′ → 𝑋̅ ↝ 𝒩(𝑚; 𝑛) → T = 𝑆′ ↝ 𝑇𝑛−1

√

limite est √n

inapplicable. T suit la loi de Student à (n-1) degrés de liberté (ddl).

Sans 𝑋𝑖 → 𝒩(𝑚; 𝜎) 𝜎 𝑁−𝑛 X̅ −m

remise 𝜎 : connu → 𝑋̅ ↝ 𝒩(𝑚; 𝑛 √ 𝑁−1) → U = 𝜎 𝑁−𝑛 ↝ 𝒩(0; 1)

√ √

√𝑛 𝑁−1

𝑺′ 𝑁−𝑛 ̅ −m

X

𝜎 : inconnu 𝜎̂ = 𝑠′ → 𝑋̅ ↝ 𝒩(𝑚; 𝒏 √ 𝑁−1) → T = ↝ 𝑇𝑛−1

√ 𝑺′ 𝑁−𝑛

( √ )

√𝒏 𝑁−1

T suit la loi de Student à (n-1) degrés de liberté (ddl).

Notes de cours Estimation Statistiques / Dr MAHOP Page 22/24

7.11.3 Distribution d’échantillonnage de la fréquence d’échantillon (𝑭) pour 𝒏 > 𝟑𝟎 : avec ou sans remise

𝑛 > 30 Avec 𝐸(𝑋𝑖 ) = 𝑝

remise 𝑋𝑖 ↝ ⏟ ℬ(1; 𝑝) 𝑎𝑣𝑒𝑐 { 𝑉(𝑋𝑖 ) = 𝑝𝑞 𝐹 → 𝒩 (𝑝; √𝑝(1−𝑝)) F−p

𝑈= ↝ 𝒩(0; 1)

𝑙𝑜𝑖 𝑑𝑒 𝐵𝑒𝑟𝑛𝑜𝑢𝑙𝑙𝑖 𝜎(𝑋𝑖 ) = √𝑝𝑞 𝑛 𝑝(1 − 𝑝)

√

𝐾 = ∑𝑖=𝑛 𝑋 ↝ 𝐵(𝑁;

⏟ 𝑛; 𝑝) 𝑛

𝑖=1 𝑖

𝑙𝑜𝑖 𝑏𝑖𝑛𝑜𝑚𝑖𝑎𝑙𝑒 F : la fréquence d’échantillon converge vers la

loi normale pour n>30.

𝐸(𝐾) = 𝑛𝑝

𝑎𝑣𝑒𝑐 { 𝑉(𝐾) = 𝑛𝑝𝑞 En pratique si : np>18 ou si n>30 ou p ≅ 0,5

𝜎(𝐾) = √𝑛𝑝𝑞

Sans 𝐾 = ∑𝑖=𝑛

𝑖=1 𝑋𝑖 ↝ ℋ(𝑁; 𝑛; 𝑝)

⏟

remise 𝑙𝑜𝑖 ℎ𝑦𝑝𝑒𝑟𝑔𝑒𝑜𝑚é𝑡𝑟𝑖𝑞𝑢𝑒 𝑝(1−𝑝) 𝑁−𝑛 F−p

𝐹 → 𝒩 (𝑝; √ ( 𝑁−1)) 𝑈=

𝑛

𝐸(𝐾) = 𝑛𝑝 √𝑝(1 − 𝑝) (𝑁 − 𝑛)

𝑛 𝑁−1

𝑁−𝑛

𝑉(𝐾) = 𝑛𝑝𝑞 ( 𝑁−1) si : np>18 ou si n>30 ou p ≅ 0,5

𝑎𝑣𝑒𝑐 𝑈 ↝ 𝒩(0; 1)

𝑁−𝑛

𝜎(𝐾) = √𝑛𝑝𝑞 ( 𝑁−1)

{

𝑛 ≤ 30 Si la taille de l’échantillon est faible, on a recours aux lois exactes : loi binomiale, loi de poisson, etc.

Notes de cours Estimation Statistiques / Dr MAHOP Page 23/24

Notes de cours Estimation Statistiques / Dr MAHOP Page 24/24

Vous aimerez peut-être aussi

- Chap7 Echantillonnage Estimation Ponctuelle (2) - CopieDocument23 pagesChap7 Echantillonnage Estimation Ponctuelle (2) - CopieDavila AlomgbaPas encore d'évaluation

- Chap7 Echantillonnage Chap8 Estimation Student2Document30 pagesChap7 Echantillonnage Chap8 Estimation Student2impactsignature.ciPas encore d'évaluation

- T2 EstimationDocument42 pagesT2 EstimationDiop Daouda100% (2)

- Statistiques AppliquéesDocument1 pageStatistiques AppliquéesjamiloiPas encore d'évaluation

- ÉchantillonnageDocument10 pagesÉchantillonnageLoudjeinePas encore d'évaluation

- Chap 7 StatDocument37 pagesChap 7 Statlebanese wise manPas encore d'évaluation

- 02 EchantillonnageDocument20 pages02 EchantillonnageMax Vainq100% (2)

- Chapitre 1 Introduction À L'analyse de DonnéesDocument15 pagesChapitre 1 Introduction À L'analyse de Donnéeszied.jamai88Pas encore d'évaluation

- Statistique Appliquee S5 Chapitre 1 EchaDocument18 pagesStatistique Appliquee S5 Chapitre 1 EchaOussama McPas encore d'évaluation

- Méthodes d'écantillonnagePPTDocument26 pagesMéthodes d'écantillonnagePPTOumayma TahiriPas encore d'évaluation

- Chapitre 2. Diustribution EchantillonnagevfDocument43 pagesChapitre 2. Diustribution EchantillonnagevfFiras BellakhelPas encore d'évaluation

- 4 EchantillonnageDocument49 pages4 EchantillonnageMohammed-Yassine Barnicha100% (1)

- Ps-Chap 3Document81 pagesPs-Chap 3Youssef FahmyPas encore d'évaluation

- Statistique Chapitre2Document39 pagesStatistique Chapitre2Oussama Hammani100% (1)

- 03 Estimation PDFDocument20 pages03 Estimation PDFBawba AbdallahPas encore d'évaluation

- Chapitre 1 Introduction À L'analyse Des DonnéesDocument14 pagesChapitre 1 Introduction À L'analyse Des DonnéesAziz Ifaa100% (1)

- Examan Analyse de DonnesDocument5 pagesExaman Analyse de DonnesZakaria belhassanePas encore d'évaluation

- 1711195540447_1711195309778_COURS-BIOSTAT-2024série1-2-3Document91 pages1711195540447_1711195309778_COURS-BIOSTAT-2024série1-2-3dtetgigfhuPas encore d'évaluation

- Cours Biométrie Forestire FOR3Document36 pagesCours Biométrie Forestire FOR3Rodrigue NtseckPas encore d'évaluation

- Cours Estimation TestDocument35 pagesCours Estimation TestMariama DIOUF100% (1)

- Échantillo 2Document34 pagesÉchantillo 2Chai mae AgnawPas encore d'évaluation

- Chapitre 2Document48 pagesChapitre 2Harold CarterPas encore d'évaluation

- Cours Biostatistique Partie 1Document12 pagesCours Biostatistique Partie 1Amira HassadPas encore d'évaluation

- Echantillonnage Aléatoir SimpleDocument21 pagesEchantillonnage Aléatoir SimpleMohammed ZoubaPas encore d'évaluation

- Chapitre 3 EchantillonnageDocument58 pagesChapitre 3 EchantillonnageFATIMA ZAHRA AIT HAMD-OUHSAIN100% (2)

- BiostatL3biotch MicrobDocument56 pagesBiostatL3biotch MicrobIsmail BoujridaPas encore d'évaluation

- Thème 6: L'échantillonnage Et L'enquêteDocument22 pagesThème 6: L'échantillonnage Et L'enquêteelbakkalim30Pas encore d'évaluation

- Séminaire 5 - EchantillonnageDocument36 pagesSéminaire 5 - EchantillonnageMohammed Amine Margoum100% (1)

- Cours + Exo Corrigés - PDF (Abdi) PDFDocument158 pagesCours + Exo Corrigés - PDF (Abdi) PDFChai mae AgnawPas encore d'évaluation

- Nar 7 FDocument13 pagesNar 7 FAbdoulaye NdongPas encore d'évaluation

- Biostatistiques. SakraniDocument77 pagesBiostatistiques. Sakraniamina aminaPas encore d'évaluation

- Support de Cours Seance 1Document4 pagesSupport de Cours Seance 1maverickberry705Pas encore d'évaluation

- Échantillonnage ProbabilisteDocument13 pagesÉchantillonnage ProbabilisteYacine Alioua100% (2)

- Polycope de Cours BiostatistiqueDocument83 pagesPolycope de Cours BiostatistiqueNada DaPas encore d'évaluation

- Echantionnage M1 QUALITEDocument50 pagesEchantionnage M1 QUALITEkorobade100% (1)

- Cours Statistique MR - El Haddaoui 21-22Document33 pagesCours Statistique MR - El Haddaoui 21-22abraham LincolnPas encore d'évaluation

- ppt_methodologie_VF[1][1]Document35 pagesppt_methodologie_VF[1][1]laila akrioPas encore d'évaluation

- Projet MamDocument12 pagesProjet Mammoussaibro03Pas encore d'évaluation

- Chap Echantillonnage Et EstimationDocument36 pagesChap Echantillonnage Et EstimationMohamed Nk100% (1)

- Polycop BioDocument57 pagesPolycop BioKa TiaPas encore d'évaluation

- ch3 EchantionnageDocument24 pagesch3 EchantionnageAkram BousetaPas encore d'évaluation

- Cours Statistique (1) - 1Document88 pagesCours Statistique (1) - 1Rajaa AyadPas encore d'évaluation

- Fi Chier 556Document53 pagesFi Chier 556luka alexPas encore d'évaluation

- Méthodes de Sondage À Choix RaisonnésDocument5 pagesMéthodes de Sondage À Choix RaisonnésNesrin souissi100% (1)

- Cours de Statistiques Inf PDFDocument28 pagesCours de Statistiques Inf PDFPatrice Clement MougnolPas encore d'évaluation

- Document3 Final Version Corrigée PDFDocument20 pagesDocument3 Final Version Corrigée PDFClark OberaPas encore d'évaluation

- Document 2 EQDocument19 pagesDocument 2 EQMichael TommyndilouPas encore d'évaluation

- 56-Methodes Statistiques GlobalesDocument19 pages56-Methodes Statistiques Globaleskonan innocent kouadioPas encore d'évaluation

- Analyse Données M1 2019 2020 2Document15 pagesAnalyse Données M1 2019 2020 2De Sales BoniPas encore d'évaluation

- Stats Seance 01 DocDocument12 pagesStats Seance 01 DocJean-Baptiste GAUTIER-FABIANIPas encore d'évaluation

- Echantillonnage Et EstimationDocument48 pagesEchantillonnage Et EstimationYohan NdongPas encore d'évaluation

- Echantillonnage PDFDocument18 pagesEchantillonnage PDFsamira HAMPas encore d'évaluation

- Cours-Statistique Descriptive - Cpfa-2022Document26 pagesCours-Statistique Descriptive - Cpfa-2022Amandine BationoPas encore d'évaluation

- Focus Tests HypothèsesDocument21 pagesFocus Tests Hypothèsesyassine l3tmaniPas encore d'évaluation

- Développer et interpréter une échelle de mesure: Applications du modèle de RaschD'EverandDévelopper et interpréter une échelle de mesure: Applications du modèle de RaschPas encore d'évaluation

- Appliquer le modèle de Rasch: Défis et pistes de solutionD'EverandAppliquer le modèle de Rasch: Défis et pistes de solutionPas encore d'évaluation

- Les erreurs fréquentes en Mathématiques du cycle secondaire: Enquête statistique - TOME IID'EverandLes erreurs fréquentes en Mathématiques du cycle secondaire: Enquête statistique - TOME IIPas encore d'évaluation

- 25 Choses À Savoir Pour Réussir Dans Le Marketing de RéseauDocument7 pages25 Choses À Savoir Pour Réussir Dans Le Marketing de RéseauDavila AlomgbaPas encore d'évaluation

- Application Variable ContinueDocument2 pagesApplication Variable ContinueDavila AlomgbaPas encore d'évaluation

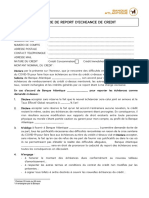

- Demande de Report D Echeance ParticulierDocument2 pagesDemande de Report D Echeance ParticulierDavila AlomgbaPas encore d'évaluation

- Analyse Financière Cours CompletDocument17 pagesAnalyse Financière Cours CompletkouyatePas encore d'évaluation

- Cca 061 0003Document5 pagesCca 061 0003Davila AlomgbaPas encore d'évaluation

- Table Des Matières: - Marion Del Sol Et - Sylvie Moisdon-ChataignerDocument14 pagesTable Des Matières: - Marion Del Sol Et - Sylvie Moisdon-ChataignerDavila AlomgbaPas encore d'évaluation

- Construire Son Reseau Dent RepriseDocument470 pagesConstruire Son Reseau Dent RepriseKane Ka100% (1)

- Gagner Perdre ArgentDocument1 pageGagner Perdre ArgentDavila AlomgbaPas encore d'évaluation

- Table Des Matières: - Marion Del Sol Et - Sylvie Moisdon-ChataignerDocument14 pagesTable Des Matières: - Marion Del Sol Et - Sylvie Moisdon-ChataignerDavila AlomgbaPas encore d'évaluation

- Gérard Kirady-Réussir Vos Entretiens D'examen, de Concours, de Recrutement... - Guide À L'usage Des Candidats Et Des Professionnels-Gereso (Éditions) (2010) - 2Document234 pagesGérard Kirady-Réussir Vos Entretiens D'examen, de Concours, de Recrutement... - Guide À L'usage Des Candidats Et Des Professionnels-Gereso (Éditions) (2010) - 2Thikule LouAnge100% (2)

- Sage 100 Comptabilite Manuel Pedagogique PDFDocument290 pagesSage 100 Comptabilite Manuel Pedagogique PDFDavila AlomgbaPas encore d'évaluation

- 4 6050725097398864150 PDFDocument14 pages4 6050725097398864150 PDFDavila AlomgbaPas encore d'évaluation

- Analyse Financière Gualino PDFDocument200 pagesAnalyse Financière Gualino PDFbellemalem chiraz100% (4)

- AgrobusinessLeguide 01Document17 pagesAgrobusinessLeguide 01Davila Alomgba100% (1)

- Cours Theorie Impo LfcomptDocument34 pagesCours Theorie Impo Lfcomptamira mouniaPas encore d'évaluation

- Support 02Document14 pagesSupport 02OSIRISPas encore d'évaluation

- L'essentiel: Droit International PublicDocument153 pagesL'essentiel: Droit International PublicDavila AlomgbaPas encore d'évaluation

- Le CoachingDocument369 pagesLe Coachinghicham0010100% (8)

- 120 Astuces Pour Gagner Du Temps VP J Louis 1 PDFDocument132 pages120 Astuces Pour Gagner Du Temps VP J Louis 1 PDFStéphanie100% (1)

- Table Des Matières: Cours: Droit Des Assurances Auteur: Didier Krajeski Leçon N° 7: Le SinistreDocument19 pagesTable Des Matières: Cours: Droit Des Assurances Auteur: Didier Krajeski Leçon N° 7: Le SinistreDavila AlomgbaPas encore d'évaluation

- Support 09Document13 pagesSupport 09OSIRISPas encore d'évaluation

- Table Des MatièresDocument16 pagesTable Des MatièresDavila AlomgbaPas encore d'évaluation

- Toute La Fonction Achats PDFDocument370 pagesToute La Fonction Achats PDFykourziPas encore d'évaluation

- Table Des Matières: Cours: Droit Des Assurances Auteur: Didier Krajeski Leçon N° 5: La PrimeDocument8 pagesTable Des Matières: Cours: Droit Des Assurances Auteur: Didier Krajeski Leçon N° 5: La PrimeDavila AlomgbaPas encore d'évaluation

- Comprendre La Finance Pour Les Non Financiers Et Les Étudiants Ce Que Signifient Vraiment Les Chiffres de LentrepriseDocument1 pageComprendre La Finance Pour Les Non Financiers Et Les Étudiants Ce Que Signifient Vraiment Les Chiffres de LentrepriseDavila Alomgba100% (1)

- Table Des Matières: - Marion Del Sol Et - Sylvie Moisdon-ChataignerDocument16 pagesTable Des Matières: - Marion Del Sol Et - Sylvie Moisdon-ChataignerDavila AlomgbaPas encore d'évaluation

- Introduction Au Droit Fiscal Général Et À La Théorie de L'impôtDocument322 pagesIntroduction Au Droit Fiscal Général Et À La Théorie de L'impôtDavidiumPas encore d'évaluation

- Introduction Au Droit Fiscal Général Et À La Théorie de L'impôtDocument322 pagesIntroduction Au Droit Fiscal Général Et À La Théorie de L'impôtDavidiumPas encore d'évaluation

- TP10 SolutionsDocument5 pagesTP10 SolutionsGemnPas encore d'évaluation

- Théorème Central LimiteDocument15 pagesThéorème Central LimiteAbdelaziz BEN KHALIFAPas encore d'évaluation

- STOP1 Inference PDFDocument4 pagesSTOP1 Inference PDFMamadou DialloPas encore d'évaluation

- Feuille 5: Transform Ees de Laplace, Fonctions Caract Eristiques, TH Eor' Emes LimitesDocument2 pagesFeuille 5: Transform Ees de Laplace, Fonctions Caract Eristiques, TH Eor' Emes Limitesazizd15Pas encore d'évaluation

- CHP 1-5 - DiaposDocument96 pagesCHP 1-5 - DiaposFabien LucienPas encore d'évaluation

- Résumé Cours Chap 1 2 3Document12 pagesRésumé Cours Chap 1 2 3torkitaherPas encore d'évaluation

- ECS1-05-Chapitre 0 Fonction CaracteristiqueDocument29 pagesECS1-05-Chapitre 0 Fonction Caracteristiquesaadisaousan043Pas encore d'évaluation

- Probabilités Et StatistiqueDocument187 pagesProbabilités Et StatistiqueYacine ZaouiPas encore d'évaluation

- Caractérisation Des Distributions À Queue Lourde Pour L'Analyse Des CruesDocument82 pagesCaractérisation Des Distributions À Queue Lourde Pour L'Analyse Des CruesTrésor DINPas encore d'évaluation

- Correction TD3Document9 pagesCorrection TD3Nouhaila Belegchour IIPas encore d'évaluation

- Polyproba PDFDocument18 pagesPolyproba PDFjean roland ebende pendaPas encore d'évaluation

- Introduction À L'actuariat - Partie1Document130 pagesIntroduction À L'actuariat - Partie1Ibtissam MEDARHRIPas encore d'évaluation

- Calcul D'incertitudes PDFDocument198 pagesCalcul D'incertitudes PDFOscar de Maltaire75% (4)

- Introduction À L'économétrie Pour DébuterDocument11 pagesIntroduction À L'économétrie Pour DébuterAndriatsirihasinaPas encore d'évaluation

- Formule de StirlingDocument7 pagesFormule de StirlingKamal ChaibPas encore d'évaluation

- Volatilité Des Indices Boursiers Islamiques Dans Le Contexte de La Crise FinancièreDocument186 pagesVolatilité Des Indices Boursiers Islamiques Dans Le Contexte de La Crise FinancièreChiadmi Med Salah100% (1)

- Exos Rappels Stats EnsaeDocument55 pagesExos Rappels Stats EnsaeZozo Zozo DiagnePas encore d'évaluation

- Maitrise Statistique Des Processus: F. RichardDocument89 pagesMaitrise Statistique Des Processus: F. RichardmanouminaPas encore d'évaluation

- Chapitre de ProbabilityDocument57 pagesChapitre de ProbabilityLet us DancePas encore d'évaluation

- Intro Actuariat SUPPORT ENCGS V1 230621 183258Document306 pagesIntro Actuariat SUPPORT ENCGS V1 230621 183258Othmane GhitaPas encore d'évaluation

- Livre Calcule Des Incertitude PDFDocument178 pagesLivre Calcule Des Incertitude PDFmoez100% (1)

- Test Hypothese Un Parametre Exercices CorrectionDocument13 pagesTest Hypothese Un Parametre Exercices Correctionzaaboul hergaouiPas encore d'évaluation

- Cours Estimation Et EchantillonnageDocument36 pagesCours Estimation Et EchantillonnageChaymæ AdmirPas encore d'évaluation

- Chapitre 2Document7 pagesChapitre 2fidaPas encore d'évaluation

- Loi Des Grands Nombres Et Theoreme Central LimiteDocument22 pagesLoi Des Grands Nombres Et Theoreme Central LimiteAnonymous Gh7ZPrPas encore d'évaluation

- Exercice Loi NormaleDocument3 pagesExercice Loi NormaleYassine Guisser100% (2)

- 1 M 02 TDDocument16 pages1 M 02 TDRadwane LourhmatiPas encore d'évaluation

- Cours GESTION DES PROJETS Prof NGANHOUDocument83 pagesCours GESTION DES PROJETS Prof NGANHOUVictor Fon EtotPas encore d'évaluation

- ExercicesDocument16 pagesExercicesZakaria mtklPas encore d'évaluation

- Progmaths AgregaDocument11 pagesProgmaths AgregaHaytem bossPas encore d'évaluation

![ppt_methodologie_VF[1][1]](https://imgv2-1-f.scribdassets.com/img/document/723767058/149x198/5a9363a601/1713314869?v=1)