Académique Documents

Professionnel Documents

Culture Documents

Exercices ch3

Transféré par

Eya Hmida0 évaluation0% ont trouvé ce document utile (0 vote)

54 vues5 pagesTitre original

exercices ch3

Copyright

© © All Rights Reserved

Formats disponibles

PDF, TXT ou lisez en ligne sur Scribd

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

© All Rights Reserved

Formats disponibles

Téléchargez comme PDF, TXT ou lisez en ligne sur Scribd

0 évaluation0% ont trouvé ce document utile (0 vote)

54 vues5 pagesExercices ch3

Transféré par

Eya HmidaDroits d'auteur :

© All Rights Reserved

Formats disponibles

Téléchargez comme PDF, TXT ou lisez en ligne sur Scribd

Vous êtes sur la page 1sur 5

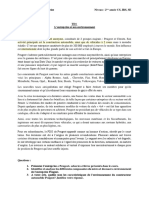

Considérons un corpus formé par les documents suivants :

D1= « Le modèle vectoriel représente les termes et les documents »

D2= « Le modèle booléen est meilleur que le modèle vectoriel »

D3= « Le modèle vectoriel est simple »

On considère la liste suivante des mots vides : « le, les, est, que, et »

1) Segmenter les textes des documents afin de trouver les termes d’indexation (en prenant en

considération tous les termes sauf les mots vides). Donner la liste des termes d’indexation

ordonnée par ordre alphabétique.

2) Calculer le tf=frequence(ti,dj) de chacun de ces termes pour chaque document

3) Calculer l’idf de chacun de ces termes

4) Créer la matrice de poids pour chaque terme et document (le produit de la pondération locale et

la pondération globale)

5) Que donnera le système de recherche d’information en réponse aux à la requête suivante (on ne

demande pas de calculer la similarité entre la requête et les documents):

Q= « booléen meilleur »

D1= « Le modèle vectoriel représente les termes et les documents »

D2= « Le modèle booléen est meilleur que le modèle vectoriel »

D3= « Le modèle vectoriel est simple »

Terme d'indexation freq freq freq

D1 D2 D3 dft idf tf*idf D1 tf*idf D2 tf*idf D3

booléen 0 1 0 1 0,477121 0 0,477121 0

documents 1 0 0 1 0,477121 0,477121 0 0

meilleur 0 1 0 1 0,477121 0 0,477121 0

modèle 1 2 1 3 0 0 0 0

représente 1 0 0 1 0,477121 0,477121 0 0

simple 0 0 1 1 0,477121 0 0 0,477121

termes 1 0 0 1 0,477121 0,477121 0 0

vectoriel 1 1 1 3 0 0 0 0

Considérons les textes suivants :

Document 1 : « Les professeurs parlent de la recherche d information textuelle. »

Document 2 : « La recherche des informations est un domaine de recherche qui s intéresse à de nombreux problèmes. »

Document 3 : « Le modèle vectoriel de recherche d information est un modèle simple à comprendre. »

1.En considérant la stop-list suivante :

{à, au, d, de, du, des, elle, elles, est, je, il, ils, le, la, les, lui, qui, son, s, sa, ses, tu, un, une}

Représenter l'ensemble des termes d'indexation de chacun des documents ci-dessus.

2.Dans le but de normaliser les termes d’indexation, on passe par une étape de racinisation qui utilise les deux règles suivantes :

s → NULL

ent → e

Extraire les termes d’indexation finaux.

3.Calculer le tf=freq(ti,dj) de chacun de ces termes pour chaque document.

4.Calculer l'idf=log10(N/dft) de chacun des termes présents dans les documents

5.En déduire la matrice de poids pour ce corpus sachant que poids(t,d)=tf(t,d)*idf(t,D)

6.Soit les requêtes suivantes :

Q0 : pomme de terre

Q1 : recherche d information

Q2 : recherche d information textuelle

Q3 : domaine du modèle vectoriel

Analyser les requêtes comme les documents (élimination des mots vides et racinisation), et utiliser une pondération des requêtes par le tf

uniquement

Document 1 : professeur (1/1/0.48), parle(1/1/0.48), recherche(1/3/0), information(1/3/0), textuelle(1/1/0.48).

Document 2 : recherche(2/3/0), information(1/3/0), domaine(1/1/0.48), intéresse(1/1/0.48), nombreux(1/1/0.48),

problème(1/1/0.48).

Document 3 : modèle(2/1/0.48), vectoriel(1/1/0.48), recherche(1/3/0), information(1/3/0), simple(1/1/0.48),

comprendre(1/1/0.48)

d1 d2 d3

T1

T2

T3

T4

T5

T6

T7

T8

T9

T10

T11

T12

T13

Vous aimerez peut-être aussi

- Chapitre 2 - VFDocument48 pagesChapitre 2 - VFEya HmidaPas encore d'évaluation

- Chapitre3 VFDocument52 pagesChapitre3 VFEya HmidaPas encore d'évaluation

- CHAPITRE05-ETL-Entrepot de DonnéesDocument42 pagesCHAPITRE05-ETL-Entrepot de DonnéesAbdelhalim BoudraaPas encore d'évaluation

- Chapitre1 VFDocument44 pagesChapitre1 VFEya Hmida100% (1)

- Test Logiciel: Pr. Aimad QAZDARDocument71 pagesTest Logiciel: Pr. Aimad QAZDARHamza HaPas encore d'évaluation

- Chapitre 3 - Analyse Syntaxique (Notions de Base)Document13 pagesChapitre 3 - Analyse Syntaxique (Notions de Base)achrafbouydmar10Pas encore d'évaluation

- Travail Pratique Objectif: Gestion Des Tablespaces Exercice 1Document4 pagesTravail Pratique Objectif: Gestion Des Tablespaces Exercice 1ouameur abderrahim100% (1)

- Diagramme de SéquenceDocument37 pagesDiagramme de SéquenceKaoutar AbPas encore d'évaluation

- Cours Compilation Chapitre 3Document12 pagesCours Compilation Chapitre 3Emma HcnPas encore d'évaluation

- Analyse Syntaxique AscendanteDocument7 pagesAnalyse Syntaxique AscendanteEya HmidaPas encore d'évaluation

- Ilovepdf MergedDocument99 pagesIlovepdf Mergedslim yaichPas encore d'évaluation

- Examen ASD MPI Janvier 2020Document3 pagesExamen ASD MPI Janvier 2020Mariem KsontiniPas encore d'évaluation

- Exercices ArchitDocument2 pagesExercices Architlok lok0% (1)

- Exercices RecursiviteDocument3 pagesExercices RecursiviteMed MohamedPas encore d'évaluation

- Chap 4. Diviser Pour Régner PDFDocument18 pagesChap 4. Diviser Pour Régner PDFMed YacinePas encore d'évaluation

- TD1. Arbre CouvrantDocument2 pagesTD1. Arbre Couvrantsafe selmi100% (1)

- Chap 4Document36 pagesChap 4olfa zorguiPas encore d'évaluation

- TD2 DiagClasses 2022 2023correctionDocument13 pagesTD2 DiagClasses 2022 2023correctionYosr AbdeladhimePas encore d'évaluation

- Cours DBDocument85 pagesCours DBMomedPas encore d'évaluation

- Design PatternDocument10 pagesDesign PatternMoustapha BERPas encore d'évaluation

- Chapitre4 MultimdDocument10 pagesChapitre4 Multimdwael zfPas encore d'évaluation

- TP1 Java PDFDocument2 pagesTP1 Java PDFNajeh TouilPas encore d'évaluation

- TD 03Document4 pagesTD 03satmaniaPas encore d'évaluation

- AlgoDocument30 pagesAlgoBessem BessemPas encore d'évaluation

- Untitled 1Document5 pagesUntitled 1TheoPas encore d'évaluation

- TD3 Big DataDocument2 pagesTD3 Big DataMohamed Sidi BrahimPas encore d'évaluation

- Gestion de La Mémoire Centrale Allocation de La Mémoire Physique Illustration Sous LinuxDocument41 pagesGestion de La Mémoire Centrale Allocation de La Mémoire Physique Illustration Sous LinuxColmain NassiriPas encore d'évaluation

- 1 - Les SI 2019-2020Document28 pages1 - Les SI 2019-2020Ķőőķie Šâm100% (1)

- Cours Patron Partie 4Document19 pagesCours Patron Partie 4Houda TekayaPas encore d'évaluation

- EXAMEN Tech Principal 2018Document4 pagesEXAMEN Tech Principal 2018PFE0% (1)

- Devoir de Synthese1 2si 2020 - 2021 PDFDocument8 pagesDevoir de Synthese1 2si 2020 - 2021 PDFMelek TalbiPas encore d'évaluation

- Chapitre1 GRAPHE ET OPTIMISATIONDocument57 pagesChapitre1 GRAPHE ET OPTIMISATIONwala mzPas encore d'évaluation

- v2-Sujet+Corrigé-Rattrapage de WebSemantique-2017-2018Document4 pagesv2-Sujet+Corrigé-Rattrapage de WebSemantique-2017-2018melazem rymPas encore d'évaluation

- Corrige GL 2021Document2 pagesCorrige GL 2021PapiPas encore d'évaluation

- Rattrapage SolutionsDocument3 pagesRattrapage SolutionsAbdallahi SidiPas encore d'évaluation

- Introduction À La Théorie Des Graphes: 1) OriginesDocument12 pagesIntroduction À La Théorie Des Graphes: 1) OriginesSwitch GangPas encore d'évaluation

- TD 1 JavaDocument3 pagesTD 1 JavaCurriculum Vitae100% (1)

- Examen 3Document8 pagesExamen 3Sofien HaddadPas encore d'évaluation

- Traitement Des ImagesDocument89 pagesTraitement Des ImagesRharif AnassPas encore d'évaluation

- TD EC Big DataDocument3 pagesTD EC Big DataMme et Mr LafonPas encore d'évaluation

- TD AlgoDocument11 pagesTD Algoamel100% (1)

- TD1 IngDocument3 pagesTD1 IngChouichi GhadaPas encore d'évaluation

- Examen15 16Document2 pagesExamen15 16zaydPas encore d'évaluation

- Exam Final 20187295833749988164015Document4 pagesExam Final 20187295833749988164015Yasmine ChihabPas encore d'évaluation

- TD OrdonnancementDocument4 pagesTD OrdonnancementZied Boudali0% (1)

- TPpythonDocument8 pagesTPpythonOumaima KammounPas encore d'évaluation

- Corrigé Type TD1Document7 pagesCorrigé Type TD1Walid YoucefiPas encore d'évaluation

- Les Piles Et Les Files en CDocument15 pagesLes Piles Et Les Files en Cabdelmadjid redjechtaPas encore d'évaluation

- Les Fonctions Standards 4Document3 pagesLes Fonctions Standards 4Denzel0% (1)

- Résumer Genie Logiciel-1Document4 pagesRésumer Genie Logiciel-1HathatPas encore d'évaluation

- TD 1 Ri 2Document2 pagesTD 1 Ri 2حكايات عربيةPas encore d'évaluation

- Intelligence Artificielle Sujet 04Document2 pagesIntelligence Artificielle Sujet 04Faralahy UlrichPas encore d'évaluation

- Cours Structures Des Donnees 4Document102 pagesCours Structures Des Donnees 4Khaled MhamediPas encore d'évaluation

- TD 1Document3 pagesTD 1Malek BouaziziPas encore d'évaluation

- Principal Cas 2021 MCW Final CorrigeDocument10 pagesPrincipal Cas 2021 MCW Final CorrigeMeryem RamdaniPas encore d'évaluation

- DS Sepc 20 11 2015Document9 pagesDS Sepc 20 11 2015Dhia BenkhaledPas encore d'évaluation

- TD 3 CorrectionDocument6 pagesTD 3 CorrectionAmineAmiinePas encore d'évaluation

- TD CorrigéDocument19 pagesTD Corrigéabdelaati wafaPas encore d'évaluation

- ConventionAlgorithmiqueAS2022 2023Document8 pagesConventionAlgorithmiqueAS2022 2023hiba hitanaPas encore d'évaluation

- Série TD2Document3 pagesSérie TD2Entertainment worldPas encore d'évaluation

- Les Techniques de Tests: Techniques Basées Sur Les Spécifications (Boite Noire)Document9 pagesLes Techniques de Tests: Techniques Basées Sur Les Spécifications (Boite Noire)Eya HmidaPas encore d'évaluation

- Analyse Syntaxique AscendanteDocument7 pagesAnalyse Syntaxique AscendanteEya HmidaPas encore d'évaluation

- Technique de Partition D'equivalenceDocument7 pagesTechnique de Partition D'equivalenceYosra YarmaniPas encore d'évaluation

- Les Techniques de Tests: Techniques Basées Sur Les Spécifications (Boite Noire)Document9 pagesLes Techniques de Tests: Techniques Basées Sur Les Spécifications (Boite Noire)Eya HmidaPas encore d'évaluation

- DSéquences 2021Document21 pagesDSéquences 2021Eya HmidaPas encore d'évaluation

- Les Techniques de Tests: Techniques Basées Sur Les Structures (Boite Blanche)Document20 pagesLes Techniques de Tests: Techniques Basées Sur Les Structures (Boite Blanche)Eya HmidaPas encore d'évaluation

- Fondamentaux Des Tests Tester Pendant Le Cycle Vie Les Techniques de Tests Gestion Des Tests Outils de Support Aux TestsDocument7 pagesFondamentaux Des Tests Tester Pendant Le Cycle Vie Les Techniques de Tests Gestion Des Tests Outils de Support Aux TestsEya HmidaPas encore d'évaluation

- CH 3Document34 pagesCH 3Eya HmidaPas encore d'évaluation

- Chap 1 UCDocument29 pagesChap 1 UCEya HmidaPas encore d'évaluation

- Chap 1 Axiomes de ProbabilitéDocument29 pagesChap 1 Axiomes de ProbabilitéEya HmidaPas encore d'évaluation

- CH 2Document53 pagesCH 2Eya HmidaPas encore d'évaluation

- IntroDocument17 pagesIntroEya HmidaPas encore d'évaluation

- TP2 Ing - BD L2CS S TPDocument3 pagesTP2 Ing - BD L2CS S TPEya HmidaPas encore d'évaluation

- Chapitre 4 - VLANDocument41 pagesChapitre 4 - VLANEya HmidaPas encore d'évaluation

- Chap 2 Initiation Réseaux CommutésDocument38 pagesChap 2 Initiation Réseaux CommutésEya HmidaPas encore d'évaluation

- CH 1Document28 pagesCH 1Eya HmidaPas encore d'évaluation

- Chap 3 Protocole STP Part1 2021Document52 pagesChap 3 Protocole STP Part1 2021Eya HmidaPas encore d'évaluation

- Chap1 Rappel ReseauxDocument23 pagesChap1 Rappel ReseauxEya HmidaPas encore d'évaluation

- TP2 Ing - BD L2CS S1 RessourceDocument6 pagesTP2 Ing - BD L2CS S1 RessourceEya HmidaPas encore d'évaluation

- Chapitre2 (P1)Document28 pagesChapitre2 (P1)Eya HmidaPas encore d'évaluation

- IBD 2CS-GLSI-Cours03Document16 pagesIBD 2CS-GLSI-Cours03Eya HmidaPas encore d'évaluation

- IBD 2CS-GLSI-Cours02 (Partie 1)Document25 pagesIBD 2CS-GLSI-Cours02 (Partie 1)Eya HmidaPas encore d'évaluation

- IBD 2CS-GLSI-Cours01Document16 pagesIBD 2CS-GLSI-Cours01Eya HmidaPas encore d'évaluation

- TD1 Entreprise EnvironnementDocument1 pageTD1 Entreprise EnvironnementEya HmidaPas encore d'évaluation

- Chapitre 1Document13 pagesChapitre 1Eya HmidaPas encore d'évaluation

- TD1 CorrectionDocument3 pagesTD1 CorrectionEya HmidaPas encore d'évaluation

- Module de Systemes DistribuesDocument50 pagesModule de Systemes Distribuesيوسف مرزوقPas encore d'évaluation

- Dgfip Metiers Informatique 29092021Document14 pagesDgfip Metiers Informatique 29092021romain.desriacPas encore d'évaluation

- Movavi Video Converter Premium 22.5.0 + PortableDocument2 pagesMovavi Video Converter Premium 22.5.0 + PortableCorbas CabanaPas encore d'évaluation

- Projet Gestion CabinetDocument3 pagesProjet Gestion Cabinetinfo bougarninePas encore d'évaluation

- Network Scangear GuideDocument46 pagesNetwork Scangear GuidetechniquePas encore d'évaluation

- Hymne de Gloire Du Peuple Bamileke (Ghomala)Document13 pagesHymne de Gloire Du Peuple Bamileke (Ghomala)Rodrigue Tchamna100% (2)

- CV Khalled FullStackDocument2 pagesCV Khalled FullStackkhalled meneoualiPas encore d'évaluation

- Cours BD Relationnelle CH1Document13 pagesCours BD Relationnelle CH1Meriem BenftimaPas encore d'évaluation

- S2 - Evaluation Pratique N°1Document1 pageS2 - Evaluation Pratique N°1Oumaima KasdiPas encore d'évaluation

- Correction tp2 PHPDocument7 pagesCorrection tp2 PHPImane OuPas encore d'évaluation

- Fiche Caneco Solar 042011 - FRBDocument2 pagesFiche Caneco Solar 042011 - FRBLino YETONGNONPas encore d'évaluation

- A 2 Bcef 525 B 390 DD 68 DF 7Document23 pagesA 2 Bcef 525 B 390 DD 68 DF 7api-722622622Pas encore d'évaluation

- 3.2.11 Lab - Exploring Processes Threads Handles and Windows Registry - FR FRDocument5 pages3.2.11 Lab - Exploring Processes Threads Handles and Windows Registry - FR FRJérémie BalulaPas encore d'évaluation

- Cours MicroservicesDocument18 pagesCours MicroservicesBochra ArfaouiPas encore d'évaluation

- TP4 - BD - Oracle ExpressDocument2 pagesTP4 - BD - Oracle ExpressImane LamdainePas encore d'évaluation

- TP 2 ApiDocument15 pagesTP 2 ApiYOUNES KABBAJ100% (1)

- RapportDeStageEsprit TechnicienDocument29 pagesRapportDeStageEsprit TechnicienTayeb AhmedPas encore d'évaluation

- HP500Document4 pagesHP500Ali BoudjeradaPas encore d'évaluation

- MemoireDocument91 pagesMemoireJulien KpPas encore d'évaluation

- Composant (Enregistrement Automatique)Document7 pagesComposant (Enregistrement Automatique)bouchtaoui imanePas encore d'évaluation

- 11 G7 Chariot Eleve PDFDocument12 pages11 G7 Chariot Eleve PDFEdmond OuattaraPas encore d'évaluation

- WWW Lucidchart Com Pages FR Bete A CornesDocument8 pagesWWW Lucidchart Com Pages FR Bete A CornesBouillaPas encore d'évaluation

- Cours Genie LogicielDocument67 pagesCours Genie Logicielbelkacem nabilaPas encore d'évaluation

- Tutorial Radio Turnigy 9xDocument8 pagesTutorial Radio Turnigy 9xyeeepaPas encore d'évaluation

- JEE7 4 Traitnavigation PDFDocument35 pagesJEE7 4 Traitnavigation PDFYassine NajmiPas encore d'évaluation

- tp1 PersistanceDocument3 pagestp1 PersistancenaasPas encore d'évaluation

- Chap3 ExercicesDocument3 pagesChap3 Exerciceschangi100% (1)

- Google Forms A QuoiDocument6 pagesGoogle Forms A QuoiXavier FéardPas encore d'évaluation

- TP N°4 Initiation À PowerPoint-part 1Document5 pagesTP N°4 Initiation À PowerPoint-part 1Samo SamoPas encore d'évaluation

- Cours3 L'architecture Globale de SQL ServerDocument4 pagesCours3 L'architecture Globale de SQL ServerAmel ourahmoune100% (1)