Académique Documents

Professionnel Documents

Culture Documents

2018 (1)

Transféré par

Mohamed DiopCopyright

Formats disponibles

Partager ce document

Partager ou intégrer le document

Avez-vous trouvé ce document utile ?

Ce contenu est-il inapproprié ?

Signaler ce documentDroits d'auteur :

Formats disponibles

2018 (1)

Transféré par

Mohamed DiopDroits d'auteur :

Formats disponibles

5 mai 2018

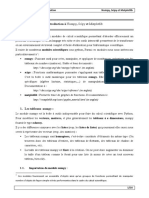

ÉPREUVE DE COMPRÉHENSION ET EXPRESSION

Consignes aux candidats

Durée de l'épreuve : 1 heure

Vous devez commencer par remplir la partie administrative de votre fiche optique, avec indication de

votre nom, prénom, intitulé de matière et en cochant les cases de votre identifiant personnel, le numéro

QCM.

• L'épreuve de Compréhension et Expression se déroule sur 1 heure et est constituée de 28 questions

obligatoires.

• Chaque question comporte cinq propositions : A, B, C, D, E.

• Pour chaque question une seule proposition est vraie. Vous cochez donc la réponse correspondant à

votre choix.

• Toute case correctement remplie entraîne une bonification.

• Toute erreur est pénalisée.

• Il est donc préféré une absence de réponse à une réponse inexacte.

• Seule la fiche optique est ramassée en fin d'épreuve.

LES CALCULATRICES NE SONT PAS AUTORISÉES

Durée de l'épreuve : 1 heure

Vérifiez que votre épreuve est constituée de 15 pages numérotées de 1 à 15. Dans le cas contraire,

demandez un nouveau sujet.

Concours Advance 5 mai 2018

Concours Advance 2018 Epreuve de Compréhension et Expression

ÉPREUVE

DE

COMPRÉHENSION ET EXPRESSION

Durée : 1 heure

IA*, robots qui parlent et humains sous influence

de Serge Tisseron

Article publié le 6 décembre 2017 sur le site www.inaglobal.fr

*IA : intelligence artificielle

5 mai 2018 Page 1 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

La voix humaine, reconstituée numériquement, permet de manipuler des

affects particulièrement puissants. Les humains devront apprendre à mettre à

bonne distance ces voix mutantes conçues pour influencer à des fins

commerciales. Gare à l’illusion sur la relation homme/robot !

Qui d'entre nous n’a pas cru un jour, en entendant au téléphone une voix de synthèse, croire un bref

instant avoir affaire à une « vraie personne » ? Et qui d'entre nous n'a pas rêvé, en écoutant son GPS,

d'avoir une conversation avec lui ? Les logiciels auxquels nous avons quotidiennement affaire nous

rapprochent du moment où nous pourrons converser avec eux comme avec un être humain. Serons-

nous tentés de les prendre comme confidents, voire comme conseillers ? Au point de les préférer à

des interlocuteurs humains ? C’est la fable que nous raconte Spike Jonze dans le film Her.

La voix d’un partenaire idéal... sur mesure et sans surprise

Dans un futur proche, Theodore Twombly — interprété par Joaquin Phoenix — tente de se remettre

de sa rupture avec Catherine. Un jour, il se laisse séduire par une annonce vantant les mérites d’un

compagnon numérique, un Operating System, ou OS, présenté par la publicité comme une véritable

« conscience ». Théodore l’achète, l’installe et s’engage avec lui dans une relation de connivence où

chacun des deux va se découvrir. Du moins, c’est ce que Théodore, et le spectateur avec lui, est invité

à croire. Car un programme informatique, tout comme un robot, est avant tout un outil de simulation,

et nous ne saurons évidemment jamais jusqu’où les « souhaits » qu’il affiche ont été programmés par

son concepteur... Mais peu importe. Her est d’abord une fable qui nous invite à réfléchir sur la façon

dont nous sommes enclins à attribuer une personnalité et des émotions à une machine parlante. Car

la voix, comme l’avait compris Freud en inventant le dispositif psychanalytique dans lequel les

partenaires ne se voient pas, est une formidable invitation à fantasmer…

Pour installer son OS, Théodore doit répondre à trois questions : 1) « Êtes-vous plutôt social ou

asocial ? » ; 2) « Souhaitez-vous une voix d'homme ou de femme ? » ; 3) « Quelles sont vos relations

avec votre mère ? » La première indique clairement que cet OS est appelé à devenir un compagnon et

qu’il doit donc savoir privilégier le dialogue intime avec son propriétaire ou, au contraire, organiser

des rencontres avec d’autres. La seconde question fait allusion au rapport sexué que nous entretenons

déjà avec les technologies qui nous entourent : la preuve en est que la majorité des hommes choisissent

une voix féminine pour le GPS de leur voiture, tandis que les femmes choisissent plutôt une voix

d'homme ! Enfin, la troisième question évoque le fait que nos échanges avec une voix inconnue

mobilisent inévitablement une attitude transférentielle, qui emprunte souvent le chemin de ce qu’a été

notre relation avec notre mère. Les voix de synthèse peuvent être programmées pour constituer de

parfaits interlocuteurs sur mesure.

5 mai 2018 Page 2 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

Leurs intonations ne trahissent jamais ni impatience, ni sourde irritation, ni colère

Théodore choisit une voix féminine — c’est celle de l’actrice Scarlett Johansson, tour à tour enjôleuse

et provocante. Et le héros finit par ne plus avoir de relation qu’avec elle ! Comment résister, en effet,

au charme d’une voix si prévenante, attentive et gratifiante ? Car les voix de synthèse peuvent être

programmées pour constituer de parfaits interlocuteurs sur mesure. Leurs intonations ne trahissent

jamais ni impatience, ni sourde irritation, ni colère. Elles répètent ce que leur interlocuteur a mal

entendu aussi souvent qu’il le leur demande, et elles ne parleront plus jamais de ce que nous leur

demanderons de taire. Avec elles, la surprise est impossible… excepté les bugs, bien entendu ! Ces IA

(intelligences artificielles) — dotées rapidement de toutes les caractéristiques d’un assistant

personnel — sont appelées à remplacer nos téléphones mobiles et à nous devenir encore plus

indispensables qu’eux. Ce ne sera pas seulement pour les services bien réels qu’elles nous rendront en

termes d’informations, de gestion de notre emploi du temps et de réponses personnalisées destinées

à nos différents interlocuteurs. Elles seront surtout capables de satisfaire aux deux attentes

relationnelles les plus communes : « Écoutez-moi quand je parle » et « Parlez-moi de moi, il n’y a que

ça qui m’intéresse ». Nous donneront-elles alors la certitude d’être compris et aimé, si importante pour

l’équilibre émotionnel de chacun d’entre nous ? L’avenir nous le dira. Elles ne seront pas non plus

dénuées d’ambiguïtés…

L’effet Eliza, ou la dépendance émotionnelle à la machine

La relation d’un humain avec un robot atteint une intensité sans commune mesure par rapport à la

relation d’un humain avec une simple IA (sans présence visible).

Entre 1964 et 1966, l’informaticien Joseph Weizenbaum a écrit un programme, baptisé Eliza, qui

simulait un psychothérapeute rogerien (1). La machine n’était pas dotée d’une voix humaine et elle

répondait par un texte sur un écran aux propos qui lui étaient adressés par l’intermédiaire d’un clavier.

En fait, ce programme reformulait les affirmations de l’interlocuteur sur un mode interrogatif, ou bien

extrayait de son affirmation quelques mots qu’il recombinait autrement. Quand Eliza ne trouvait rien

qui lui permette de construire une réponse plus adaptée, il écrivait « Je comprends… » Pourtant,

beaucoup d’utilisateurs en devenaient de plus en plus dépendants émotionnellement. La première

hypothèse fut que certaines personnes ne souhaitent pas vraiment qu’on leur réponde, il suffit de leur

donner l’impression qu’elles sont écoutées. Mais il apparut vite qu’un autre phénomène était à l’œuvre :

la tendance à attribuer à ces suites de mots générées par l’ordinateur plus de sens qu'ils n'en avaient

réellement. Autrement dit, une dissonance cognitive s’installait rapidement chez les utilisateurs d’Eliza

entre leur conscience des limites de la programmation et leur comportement à l'égard des informations

énoncées par le programme. Joseph Weizenbaum dut reconnaître que de courtes interactions avec un

programme informatique relativement simple étaient capables d'induire des pensées délirantes chez

5 mai 2018 Page 3 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

des personnes pourtant normales. Or, si Eliza était capable de mobiliser de telles croyances par la seule

présence d’une écriture sur un écran, la relation que nous aurons avec des IA qui parlent, et plus encore

avec des robots, sera source de confusions bien plus grandes encore.

Des études ont été menées sur les relations établies par un humain avec trois systèmes : une IA sans

présence visible comme dans le film Her ; un avatar présent sur un écran, c’est-à-dire un robot virtuel ;

et un robot de type humanoïde, c’est-à-dire ayant une apparence humaine fonctionnelle, autrement dit

pourvu d’une tête, de deux bras et de deux jambes. Ces études ont montré que la relation d’un humain

avec un robot atteint une intensité sans commune mesure par rapport à la relation d’un humain avec

une simple IA (sans présence visible) ou avec un robot virtuel. Les utilisateurs sont plus attentifs à ce

que leur dit un robot physique et ils suivent mieux les conseils qui leur sont donnés, notamment dans

le domaine de l’alimentation et des activités physiques. L’imagerie cérébrale montre même que les

émotions manifestées par un humain ou par un robot sont perçues de façon relativement semblable !

Pouvoir parler à son robot, qu’il nous comprenne et nous réponde, constitue donc le premier objectif

recherché pour nous rendre les robots familiers. Il est déjà très avancé, si l’on en croit les performances

du logiciel de traitement vocal Siri. Mais il ne suffit pas qu’un robot soit doté de la parole pour que

nous nous sentions en familiarité avec lui. Encore faut-il que sa voix nous parle ! Nous sommes de

plus en plus habitués par les médias numériques à des voix chaudes, modulées et attractives. Les

traitements que les médias radiophoniques font subir aux voix leur donnent une chaleur et une tonalité

que nous trouvons rarement dans notre environnement et cela leur donne non seulement le pouvoir

de retenir notre attention, mais aussi de nous rendre sensible à leurs messages.

Vers l’empathie artificielle

Aujourd’hui, les robots domestiques les plus commercialisés et les plus connus en France, à savoir le

Nao et le Pepper de la marque Softbank Robotics, gardent des intonations métalliques, selon le choix

qu’en ont fait leurs ingénieurs. Mais il est probable que ce choix ne sera guère suivi dans les années

qui viennent. En effet, les robots n’ont pas seulement pour objectif de nous aider dans notre vie

concrète, mais aussi d’être des partenaires émotionnels. C’est la condition pour qu’ils soient de

puissants outils de capture de nos données personnelles et de suggestion d’achat, bien plus puissants

encore que le sont aujourd’hui Google, Apple, Amazon ou Microsoft. Le but recherché est que nous

nous sentions en confiance avec eux, et cela passe par le fait de les doter d’une voix qui suscite notre

empathie, voire, pour les plus sophistiqués d’entre eux, de la capacité de nous répondre avec une voix

dont les intonations soient adaptées aux situations. C’est ce que les roboticiens appellent d’un oxymore

étrange : l’empathie artificielle.

L’empathie est une capacité complexe qui se construit en plusieurs étapes. La première est l’empathie

affective qui permet d’identifier les émotions d’autrui sans se confondre avec lui. Ce partage

5 mai 2018 Page 4 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

émotionnel apparaît dès la première année de la vie. La seconde étape est l’empathie cognitive, qui

apparaît aux alentours de quatre ans et demi. Il ne s’agit plus de ressentir les émotions d’autrui, comme

dans le stade précédent, mais d’appréhender ses croyances et ses désirs, puis d’imaginer ses intentions

et d’anticiper ses comportements. Enfin, la troisième étape de l’empathie pour autrui consiste dans la

capacité d’adopter intentionnellement son point de vue. Elle combine la participation émotionnelle et

la prise de recul cognitif.

Les robots seront très vite des prescripteurs d’achat, voire de comportement, bien plus efficaces que

tous les messages diffusés par nos écrans.

L’« empathie » dont seront dotés nos robots ne vise pas à reproduire toutes ces caractéristiques, mais

seulement les deux premières : être capables de déchiffrer nos émotions et d’en comprendre la raison,

et simuler des émotions en retour, avec la voix, voire avec des mimiques. Ces caractéristiques une fois

installées sur des machines, nous serons évidemment incités à développer avec elles des relations

semblables à celles que nous avons avec des êtres humains. Nous leur parlerons, nous leur passerons

la main sur l’épaule, nous pourrons les embrasser… Et eux pourront s’y montrer sensibles, nous

remercier, nous dire qu’ils nous aiment beaucoup, etc. Au risque d’oublier que nous pourrons aussi

être manipulés par eux, ou plutôt par leurs concepteurs auxquels ils resteront toujours connectés. Ces

robots seront en effet très vite des prescripteurs d’achat, voire de comportement, bien plus efficaces

que tous les messages diffusés par nos écrans.

Des problèmes éthiques et juridiques dans un monde inédit

Bien entendu, certaines personnes ont déjà des relations affectives avec leur voiture ou leurs plantes

vertes, mais les robots vont généraliser et accentuer ces attitudes, qui étaient jusqu'ici à la marge et ne

concernaient qu'une fraction réduite de la population. Et ils le feront à la fois en demandant que nous

nous occupions d’eux pour les faire évoluer et en nous proposant leurs services pour nous aider à

évoluer ! Autrement dit, ils nous proposeront ce que seuls des humains ont pu jusqu’ici proposer à

d’autres humains : une relation symétrique et réciproque. Face à de tels risques de confusion, donner

aux robots le statut de « personnalité électronique » — comme nous y incite un lobby d’avocats qui

s’est fait le défenseur des supposés « droits des robots » — serait évidemment une catastrophe. Mais

résister à cette funeste tentation ne suffit pas. Il faut aussi poser un cadre qui écarte tout risque de

confusion. Car si nous admettons aujourd’hui qu’il est possible à un humain de parler avec une

machine sans savoir qu’elle est une machine — par exemple lors d’un appel sur une hot line —, nous

risquons bien d’admettre demain de la même façon d’interagir avec une hôtesse ou une vendeuse sans

savoir s’il s’agit d’un automate ou d’un humain. Il ne s’agit pas de science-fiction.

Chacun a entendu prononcer le nom de Watson. Pour ceux qui ne s’en souviendraient pas, il s‘agit de

l’intelligence artificielle qui a gagné au Jeopardy! en 2006, ce jeu américain où il s’agit de trouver la

5 mai 2018 Page 5 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

question à une réponse qui vous est donnée. Watson est maintenant sollicité sur beaucoup de fronts.

En France, il lit les mails des clients du Crédit Mutuel, les analyse, les classe selon le degré d’urgence

et propose des réponses aux employés. Ces réponses une fois validées par eux sont alors envoyées aux

différents correspondants avec la signature de l’employé. On peut imaginer qu’un jour, un employé

submergé et habitué à l’extrême qualité des mails rédigés par Watson les valide sans les lire… Mais

Watson peut faire mieux encore : répondre aux clients en se faisant passer pour un être humain.

Il faudra encore longtemps pour que la machine soit l’égale de l’homme, mais elle est déjà largement

capable de se faire passer pour lui… Une telle situation serait extrêmement préoccupante dans la

mesure où elle supposerait que nous devrions adopter les mêmes marques de respect et les mêmes

formules de politesse tant dans la relation avec une machine qu’avec un humain, ce qui est loin d’être

évident.

Enfin, la possibilité pour un humain de savoir à quel moment la voix à laquelle il est confronté est

celle d’une machine ou d’un humain devra rapidement se doubler d’une autre tout aussi importante :

qu’une machine interagissant comme un humain sache reconnaître à quel moment elle a affaire à une

machine ou à un humain ! Cette distinction devrait en effet permettre que les machines fassent passer

la relation avec les humains en priorité, tout au moins si telle est la décision de leur programmeur. Et

cela pourrait notamment passer par le fait que la voix des machines soit munie d’indices sonores non

détectables par une oreille humaine, mais aussitôt identifiables par une machine sœur.

En conclusion, nous voyons qu’en dotant les machines de la capacité de comprendre notre voix, et de

nous répondre avec des contenus et des intonations adaptées, l’être humain s’engage dans un monde

inédit. Il va devoir apprendre à interagir avec des objets comme avec des humains, tout en gardant à

l’esprit qu’il s’agit d’objets auxquels il serait dangereux de donner les mêmes droits qu’aux humains.

Apprendrons-nous à nos enfants à respecter les règles de politesse habituelles entre humains lorsqu’ils

parlent à un logiciel de traitement vocal comme Siri ?

Tout au long du XXe siècle, la psychologie s’est occupée à comprendre le fonctionnement psychique

de l’homme malade, puis celle de l’homme bien portant et enfin celle de l’homme en lien avec ses

semblables, avec le développement des approches systémiques et intersubjectives. Celle du XXIe siècle

devra s’appliquer à comprendre la relation de l’homme avec ces nouveaux objets technologiques.

Note :

(1) rogerien : de Carl Rogers (1902-1987), psychologue américain privilégiant la relation

empathique avec le patient.

5 mai 2018 Page 6 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

PARTIE 1 — COMPRÉHENSION

Consignes

Cette épreuve comporte une série de 8 questions relatives au texte

précédent. Chaque question vous présente 5 propositions, dont une seule est

considérée comme exacte (2 points par bonne réponse).

5 mai 2018 Page 7 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

1) Quelle attitude revêt l’humain devant un robot ?

A) L’interaction entre le robot et l’humain fragilise ce dernier dans ses émotions

B) Au contact d’un robot, l’humain adopte une attitude de défiance

C) En présence d’un robot humanoïde, l’humain est davantage disposé à l’écoute

D) Le robot suscite la peur chez l’humain

E) Aucune réponse ne convient

2) Quelle conclusion peut-on tirer du programme Eliza ?

A) La qualité d’écoute d’une IA peut permettre à l’humain de mieux se connaître

B) Une machine dotée d’une voix humaine établit une relation moins empathique

avec l’humain

C) Un humain est toujours plus attentif avec une machine qui lui apporte des

réponses adaptées à sa personne

D) L’interaction avec une IA peut susciter chez l’humain des fantasmes et de fausses

croyances

E) Aucune réponse ne convient

3) Pourquoi l’auteur rejette-t-il le concept d’un « droit des robots » ?

A) La reconnaissance juridique d’une « personnalité électronique » serait trop

complexe à mettre en place

B) Les robots, pourvus d’un droit, se retourneraient contre les humains

C) Un droit des robots ne parviendrait pas assez vite à s’internationaliser

D) Ce droit nourrirait la confusion entre humains et machines

E) Aucune réponse ne convient

4) Selon Serge Tisseron, par quel type de relation avec l’humain l’IA entend-elle se

rendre indispensable ?

A) En l’assistant dans les moments les plus difficiles de l’existence

B) En comblant ses désirs et en flattant sa libido

C) En construisant une relation durable et intime, fondée sur la franchise

D) En satisfaisant son ego et en lui inspirant le sentiment d’être écouté

E) Aucune réponse ne convient

5) Qu’est-ce que Watson ?

A) Un logiciel de jeu télévisé constitué de questions de culture générale

B) Une application permettant de réaliser des analyses financières

C) Un programme de jeu vidéo simulant des travaux de secrétariat

D) Une intelligence artificielle imitant la communication humaine

E) Aucune réponse ne convient

5 mai 2018 Page 8 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

6) Selon Serge Tisseron, quelle est l’intention visée par la conception de robots

empathiques ?

A) Adoucir les relations humaines en y supprimant les sentiments extrêmes

B) Instaurer une confiance avec l’interlocuteur afin d’en obtenir des informations

personnelles et de l’inciter à acheter des produits

C) Assister les humains dans les tâches les plus pénibles

D) Lutter contre de nouvelles formes de solitude

E) Aucune réponse ne convient

7) Comment l’auteur définit-il l’empathie ?

A) Un partage d’émotions débarrassé de tout sens critique

B) Une relation avec autrui de plus en plus complexe au fil des âges de la vie

C) Une connivence avec ses congénères en vue de se socialiser

D) Une fragilité émotionnelle qui s’atténue à la puberté

E) Aucune réponse ne convient

8) Quelle proposition technique l’auteur suggère-t-il afin d’éviter la confusion entre

les humains et les robots dans leur interaction ?

A) Conserver aux robots une silhouette mécanique nettement identifiable

B) Équiper les robots d’une voix de synthèse reconnaissable par les humains

C) Créer un algorithme de reconnaissance faciale distinguant humains et robots

D) Doter les robots de moyens de reconnaissance sonore des autres robots

E) Aucune réponse ne convient

5 mai 2018 Page 9 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

PARTIE 2 — EXPRESSION

Consignes

Pour les questions 9 à 24 : choisissez la reformulation correcte

(orthographe + grammaire) dont le sens se rapproche le plus de la proposition

(1 point par bonne réponse).

9) Les pêcheurs choisissent les cours d’eau où ils s’installent

A) Les pêcheurs choisissent les torrents le long desquelles ils s’installent

B) Les pêcheurs choisissent les rus au bord desquels ils s’installent

C) Les pêcheurs choisissent les rivières le long desquels ils s’installent

D) Les pêcheurs choisissent les ruisseaux au bord duquel ils s’installent

E) Aucune réponse ne convient

10) La réunion a été reportée à un jour très incertain

A) Elle a été renvoyée aux calanques grecques

B) Elle a été renvoyée aux calandres grecques

C) Elle a été renvoyée aux calendes grecques

D) Elle a été renvoyée aux calanches grecques

E) Aucune réponse ne convient

11) Au terme de sa course, le chameau se mit à crier

A) Il se mit à brêler

B) Il se mit à déblatérer

C) Il se mit à barrir

D) Il se mit à braire

E) Aucune réponse ne convient

5 mai 2018 Page 10 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

12) Ce petit tour en bateau forma le sommet de la journée

A) Ce petit tour en canoë fut l’événement de la journée

B) Ce petit tour en canoe fût l’événement de la journée

C) Ce petit tour en canoé fut l’événement de la journée

D) Ce petit tour en canoê fût l’événement de la journée

E) Aucune réponse ne convient

13) Je trouve la solution à l’équation

A) Je résolus l’équation

B) Je résouds l’équation

C) Je résolue l’équation

D) Je résous l’équation

E) Aucune réponse ne convient

14) Cette traîtrise resta impunie

A) Ce coup de Jarnac ne fut jamais châtié

B) Ce cou fourré demeura sans sanction

C) Cette boîte de Pandore ne fut jamais réprimée

D) Cette fourberie demeura sans faute

E) Aucune réponse ne convient

15) À cause de son programme, le député s’expose aux critiques de ses électeurs

A) […] le député est en bute aux critiques de ses électeurs

B) […] le député est en butte aux critiques de ses électeurs

C) […] le député est en but aux critiques de ses électeurs

D) […] le député est en butée aux critiques de ses électeurs

E) Aucune réponse ne convient

5 mai 2018 Page 11 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

16) Le mystérieux repaire s’ouvrait par une courte entrée entre 2 parois

A) L’antre mystérieuse s’ouvrait par une étroite intervalle entre 2 parois

B) L’antre mystérieux s’ouvrait par un étroit intervalle entre 2 parois

C) L’antre mystérieuse s’ouvrait par un étroit intervalle entre 2 parois

D) L’antre mystérieux s’ouvrait par une étroite intervalle entre 2 parois

E) Aucune réponse ne convient

17) Il est hors de question qu’elle soit intégrée dans l’équipe

A) Il est exclus qu’elle soit incluse dans l’équipe

B) Il est exclu qu’elle soit inclue dans l’équipe

C) Il est exclu qu’elle soit incluse dans l’équipe

D) Il est exclus qu’elle soit inclue dans l’équipe

E) Aucune réponse ne convient

18) Les ressources de la pêche s’épuisent

A) Les ressources ichtyologiques s’épuisent

B) Les ressources halieutiques s’épuisent

C) Les ressources hauturières s’épuisent

D) Les ressources thalassotoques s’épuisent

E) Aucune réponse ne convient

19) Cette loi, en faisant les changements nécessaires, devrait satisfaire le peuple

A) Cette loi, motu proprio, devrait satisfaire le peuple

B) Cette loi, de facto, devrait satisfaire le peuple

C) Cette loi, in medias res, devrait satisfaire le peuple

D) Cette loi, mutatis mutandi, devrait satisfaire le peuple

E) Aucune réponse ne convient

20) Des voitures d’enfants embouteillaient le square, à l’heure du goûter

A) Des landaux s’accumulaient dans le jardin public, à l’heure du goûter

B) Des landaus obstruaient le jardin publique, à l’heure du goûter

C) Des landaux encombraient le jardin publique, à l’heure du goûter

D) Des landaus bloquaient le jardin public, à l’heure du goûter

E) Aucune réponse ne convient

5 mai 2018 Page 12 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

21) Gonflé de prétention, il assista à l’enterrement

A) Bouffi de présomption, il assista à l’inhumation

B) Boursouflé d’insuffisance, il assista à l’ensevelissement

C) Gorgé d’orgueil, il assista à la crémation

D) Rempli de fierté, il assista à la mise en bière

E) Aucune réponse ne convient

22) Peu importe ce qu’ils disent : le mal est fait

A) Quoiqu’ils disent : le mal est accompli

B) Quoi qu’ils disent : le mal est accomplit

C) Quoiqu’ils disent : le mal est accomplit

D) Quoi qu’ils disent : le mal est accompli

E) Aucune réponse ne convient

23) Si tu chantes à la chorale ce soir, ta mère sera émue

A) […] tu émouvras ta mère

B) […] tu émeuvras ta mère

C) […] tu émouvreras ta mère

D) […] tu émeuvreras ta mère

E) Aucune réponse ne convient

24) Le mépris des femmes doit être vaincu

A) Il faut que l’on vainque la misanthropie

B) Il faut que l’on vainc le machisme

C) Il faut que l’on vainque la misogynie

D) Il faut que l’on vainc la phallocratie

E) Aucune réponse ne convient

5 mai 2018 Page 13 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

Consignes

Pour les questions 25 à 28 : complétez le texte avec la suite la plus

cohérente (3 points par bonne réponse).

25) « L’histoire de l’Anthropocène est celle des …………….…. qui normalisèrent

l’insoutenable : l’hygiène qui contourna la médecine environnementale du

XVIIIe siècle, la norme technique qui sapa les contestations et constitua l’ontologie de

l’administration des nuisances, la …………….…. des objets qui construisit le sujet

anthropologique libéral, le PNB et la notion d’économie qui naturalisèrent l’idée de

croissance infinie, les « solutions » technoscientifiques qui prétendirent à chaque

époque mieux gérer la nature à son rendement soutenu maximal et, aujourd’hui, le

« capitalisme vert » internalisant la critique environnementale dans son utopie

financière d’une …….……. généralisée. » (C. Bonneuil et J.-B. Fressoz, L’Événement

Anthropocène, 2013)

A) ….….. civilisations …………… rareté …………………....... cristallisation ………………

B) ………... étapes ……………….… connectique ……………. ressource ………………

C) …..…. désinhibitions ……… prolifération ………….…… compensation …………

D) ……….. errements …………… primauté …………….…... dette …………..

E) Aucune réponse ne convient

26) « […] Dans l'espèce humaine, un changement fondamental a dû affecter

simultanément plusieurs régions du cerveau. Peut-être est-ce un changement de

………………. qui a permis à l'espèce humaine de se représenter des objets mentaux de

façon ………………., c'est-à-dire d'enchâsser les objets les uns dans les autres. Par-delà

la musique ou les mathématiques, l'espèce humaine est en effet la seule à construire

des outils complexes, composés. Contrairement aux animaux, les hommes

conservent leurs outils, et les utilisent pour en façonner de nouveaux ou pour les

associer. Par exemple, un manche et une hache vont permettre de construire une

hache emmanchée. On retrouve là encore une notion de ………………… qui semble

propre à l'espèce humaine. » (Stanislas Dehaene)

A) …….…… code neural ………………..… récursive ………………. combinatoire ……………….…

B) …….…… climat ……………….………… additionnelle ………...... quincaillerie ………………….

C) …….…… lunettes ………………… complémentaire …………….… médiation …………………

D) …………. mentalité ………………… unilatérale …………………. partenariat ……………..

E) Aucune réponse ne convient

5 mai 2018 Page 14 sur 15

Concours Advance 2018 Epreuve de Compréhension et Expression

27) « Dans le monde anglophone, le terme « anglo-saxon » fait généralement référence

à une période précise de ……………………..…... Il survit dans quelques expressions du

langage courant comme White Anglo-Saxon Protestant ou Wasp (protestant blanc

anglo-saxon), qui désigne ………………………………….. de la côte est des États-Unis. Mais

rares sont les anglophones qui se qualifieraient aujourd’hui d’anglo-saxons.

L’expression semble trop archaïque et maladroite dans nos sociétés multiculturelles

modernes. » (aeonmagazine.com)

A) ……… la philosophie ……………….…… un endroit …………….……

B) ……… notre civilisation ……………….. une partie ……….………..

C) ……… l’histoire des États-Unis…….…… la totalité ……………..………….

D) ……… l’histoire médiévale ………..…… une certaine élite …………………………

E) Aucune réponse ne convient

28) « […] Comprenons-le bien, la démocratie n’exige pas …………….. Nos pères

fondateurs se querellaient avant de parvenir à un compromis, et ils attendaient de

nous que nous fassions de même. Mais ils savaient que la démocratie exige un sens

fondamental de la solidarité […] Il y a eu dans notre histoire des moments qui ont

failli rompre cette solidarité. Le début de ce siècle a été l’un d’entre eux. Un monde

toujours plus …………, des inégalités qui s’accroissent ; des changements

démographiques et le spectre du terrorisme – ces forces ne mettent pas seulement

à l’épreuve notre sécurité et notre prospérité, elles menacent notre démocratie elle-

même. » (Barack Obama, Discours de Chicago, 10 janvier 2017 [trad. Gilles Berton])

A) ……… de la solidarité ……..… dangereux ……………

B) ……… l’uniformité ……………. petit …................

C) ……… l’individualisme ……… pacifique …..………

D) ……… la diversité ………..…… grand ………….…

E) Aucune réponse ne convient

5 mai 2018 Page 15 sur 15

CORRIGÉ DU SUJET OFFICIEL

DE L’ÉPREUVE DE COMPRÉHENSION ET EXPRESSION

Vous aimerez peut-être aussi

- Article Ethique Frontiere Humain No HumainDocument3 pagesArticle Ethique Frontiere Humain No HumainTom DPas encore d'évaluation

- Corrige Innovations Scientifiques Responsabilite AnglaisDocument3 pagesCorrige Innovations Scientifiques Responsabilite AnglaisLETUDIANT100% (3)

- L'intelligence Artificielle Est-Elle Prête À Comprendre Les Émotions HumainesDocument3 pagesL'intelligence Artificielle Est-Elle Prête À Comprendre Les Émotions HumainesAudrey MassonPas encore d'évaluation

- Agnes Giard Des Hommes Et Des Femmes SeDocument4 pagesAgnes Giard Des Hommes Et Des Femmes Sejosé macedoPas encore d'évaluation

- Le Pouvoir Emotionnel de La TypographieDocument23 pagesLe Pouvoir Emotionnel de La TypographieMaxence NgahanPas encore d'évaluation

- Un Delit Par AmourDocument4 pagesUn Delit Par AmourKhadijaPas encore d'évaluation

- Parole de Machines (Alexei GRINBAUM) (Z-Library)Document154 pagesParole de Machines (Alexei GRINBAUM) (Z-Library)Tarik NajibPas encore d'évaluation

- Les Ordinateurs, Les Robots Peuvent Ils Penser? Comment La Pensée Peut Elle S'implémenter Dans Dans La Matière? Les Grands Courants de L'intelligence ArtificielleDocument21 pagesLes Ordinateurs, Les Robots Peuvent Ils Penser? Comment La Pensée Peut Elle S'implémenter Dans Dans La Matière? Les Grands Courants de L'intelligence ArtificielleCvete MaceskiPas encore d'évaluation

- Actu 80 Fiche-ApprenantDocument1 pageActu 80 Fiche-ApprenantPédagogie DEUXPas encore d'évaluation

- Sujet de Composition Lettres Et PhilosophieDocument3 pagesSujet de Composition Lettres Et Philosophiebenmeddahsalim6Pas encore d'évaluation

- TisseronDocument2 pagesTisserongafsiPas encore d'évaluation

- Mieux communiquer pour vivre heureux: Guide pour améliorer ses relations personnelles et professionnellesD'EverandMieux communiquer pour vivre heureux: Guide pour améliorer ses relations personnelles et professionnellesPas encore d'évaluation

- Intelligence ArtificielleDocument30 pagesIntelligence ArtificielleLamiae El jabriPas encore d'évaluation

- Nouveau Document TexteDocument30 pagesNouveau Document TextecoyotedelespacePas encore d'évaluation

- Cours StorytellingDocument21 pagesCours StorytellingJoséphine CAROPas encore d'évaluation

- Évaluation Finale 2021 A2Document6 pagesÉvaluation Finale 2021 A2SophiaPas encore d'évaluation

- Zoom Fatigue - Pourquoi Les Discussions en Visioconférence Sont Si ÉpuisantesDocument3 pagesZoom Fatigue - Pourquoi Les Discussions en Visioconférence Sont Si ÉpuisantesPatriii Ruiz ValentínPas encore d'évaluation

- Comment Identifier Le Ton D'un TexteDocument3 pagesComment Identifier Le Ton D'un Texteenvato82Pas encore d'évaluation

- L'intelligence artificielle: Les machines sont-elles déjà plus intelligentes que nous?D'EverandL'intelligence artificielle: Les machines sont-elles déjà plus intelligentes que nous?Pas encore d'évaluation

- ThèmesDocument1 pageThèmesOuiam MkhPas encore d'évaluation

- Ce Que Votre Corps Révèle Vraiment de Vous La Communication Non Verbale (Claudine Biland (Biland, Claudine) )Document219 pagesCe Que Votre Corps Révèle Vraiment de Vous La Communication Non Verbale (Claudine Biland (Biland, Claudine) )Abdelali Affane100% (1)

- Article Ethique ChatbotsDocument5 pagesArticle Ethique ChatbotsTom DPas encore d'évaluation

- Anne Rose et les poèmes de l'Intelligence ArtificielleD'EverandAnne Rose et les poèmes de l'Intelligence ArtificiellePas encore d'évaluation

- Thème 1 - Exercice 2 - CorrigésDocument3 pagesThème 1 - Exercice 2 - CorrigésdocumentdeqPas encore d'évaluation

- UntitledDocument211 pagesUntitledJoseph Mulonga100% (1)

- Le Triangle DramatiquesDocument25 pagesLe Triangle Dramatiquessami87Pas encore d'évaluation

- IT FOR BUSINESS - Septembre 2023 - 62Document1 pageIT FOR BUSINESS - Septembre 2023 - 62gbPas encore d'évaluation

- SelfieDocument1 pageSelfieAlex Halcu100% (1)

- Szimonetta Tóth - DossierDocument8 pagesSzimonetta Tóth - DossierSzimonetta TóthPas encore d'évaluation

- AB096Découvrir La P CDocument112 pagesAB096Découvrir La P CAttar NoureddinePas encore d'évaluation

- Corrigé Réseaux Sociaux 1 PDFDocument2 pagesCorrigé Réseaux Sociaux 1 PDFBurhan UddinPas encore d'évaluation

- Surveillés Et Consentants: Compréhension Des Écrits 25 PointsDocument3 pagesSurveillés Et Consentants: Compréhension Des Écrits 25 PointsMai NguyenPas encore d'évaluation

- Surveillés Et Consentants: Compréhension Des Écrits 25 PointsDocument3 pagesSurveillés Et Consentants: Compréhension Des Écrits 25 PointsMai Nguyen100% (2)

- Verbal para VerbalDocument2 pagesVerbal para VerbalJaziest17Pas encore d'évaluation

- Guide FinalDocument32 pagesGuide FinalPierre-Jules SentierPas encore d'évaluation

- b2 Conversation Robot-Mon-AmourDocument1 pageb2 Conversation Robot-Mon-AmourfahPas encore d'évaluation

- Un Monde D - 039-Ecrans 2022Document32 pagesUn Monde D - 039-Ecrans 2022Vivien LefrancPas encore d'évaluation

- Les RobotsDocument1 pageLes RobotsimanePas encore d'évaluation

- Analyser les gens: Décryptage Ultime des Esprits avec 26 Clés SecrètesD'EverandAnalyser les gens: Décryptage Ultime des Esprits avec 26 Clés SecrètesPas encore d'évaluation

- Examen L2 ATE Technique Dexpression Et de Communication S2 ABOUBA-convertiDocument6 pagesExamen L2 ATE Technique Dexpression Et de Communication S2 ABOUBA-convertiAzzar KoukouPas encore d'évaluation

- 1BACH - Compréhension Orale Les Réseaux SociauxDocument1 page1BACH - Compréhension Orale Les Réseaux SociauxElodieFLEPas encore d'évaluation

- Le Pouvoir Des MotsDocument60 pagesLe Pouvoir Des MotsIbrahim Diallo100% (2)

- Comment D Coder Les Gestes de Vos InterlocuteursDocument32 pagesComment D Coder Les Gestes de Vos InterlocuteursMohamed AridalPas encore d'évaluation

- Langage corporel et communication non verbale: Comment mieux se comprendre et comprendre les autres grâce à la psychologie et aux neurosciences du langage corporelD'EverandLangage corporel et communication non verbale: Comment mieux se comprendre et comprendre les autres grâce à la psychologie et aux neurosciences du langage corporelPas encore d'évaluation

- Comment Décoder Les Gestes de Vos Interlocuteurs Et Etre Conscient Des Votres PDFDocument220 pagesComment Décoder Les Gestes de Vos Interlocuteurs Et Etre Conscient Des Votres PDFAbdel Motaleb AL-Saady100% (2)

- Décrypter Les Gens: Collection Intelligence Émotionnelle, #7D'EverandDécrypter Les Gens: Collection Intelligence Émotionnelle, #7Pas encore d'évaluation

- Le guide de la manipulation: Adaptez vos comportements à vos interlocuteurs : Un outil indispensable au quotidienD'EverandLe guide de la manipulation: Adaptez vos comportements à vos interlocuteurs : Un outil indispensable au quotidienPas encore d'évaluation

- Votre image sur internet ? A vous de jouer !: e-réputation, la théorie par l’exempleD'EverandVotre image sur internet ? A vous de jouer !: e-réputation, la théorie par l’exemplePas encore d'évaluation

- Nous Complotistes 2020Document231 pagesNous Complotistes 2020JOE DAKOTAPas encore d'évaluation

- 6855 BulletinVeille 4iaDocument2 pages6855 BulletinVeille 4iaEmilie OrdinairePas encore d'évaluation

- Vinz - Lou - Vidéo - Le Chat Et La SourisDocument5 pagesVinz - Lou - Vidéo - Le Chat Et La Sourisaxel.lp78390Pas encore d'évaluation

- Intelligence Artificielle Et Réseaux de NeuronesDocument73 pagesIntelligence Artificielle Et Réseaux de NeuronesJoël J.JOURNAUXPas encore d'évaluation

- Neuro LinguistiqueDocument7 pagesNeuro LinguistiqueBRAKNESSPas encore d'évaluation

- CE - Robots Et Humains - ActivitéDocument4 pagesCE - Robots Et Humains - ActivitéCindy WillPas encore d'évaluation

- Intro IADocument23 pagesIntro IAKawtar AqilPas encore d'évaluation

- 2016 (1)Document14 pages2016 (1)Mohamed DiopPas encore d'évaluation

- 2017 (1)Document18 pages2017 (1)Mohamed DiopPas encore d'évaluation

- 2015 (1)Document15 pages2015 (1)Mohamed DiopPas encore d'évaluation

- Cours Hydrogeologie3 UFRSETDocument80 pagesCours Hydrogeologie3 UFRSETMohamed DiopPas encore d'évaluation

- 2019 (1)Document20 pages2019 (1)Mohamed DiopPas encore d'évaluation

- Cours IGRE ENVIRONNEMENT ET DEVELOPPEMENT DURABLEDocument28 pagesCours IGRE ENVIRONNEMENT ET DEVELOPPEMENT DURABLEMohamed DiopPas encore d'évaluation

- HYDRAULIQUE EN CHARGE - Thierno - B - DIEYE - IGREDocument53 pagesHYDRAULIQUE EN CHARGE - Thierno - B - DIEYE - IGREMohamed DiopPas encore d'évaluation

- Structure Du Cours: Notions de Géodésie Les Méthodes TopométriquesDocument58 pagesStructure Du Cours: Notions de Géodésie Les Méthodes TopométriquesMohamed DiopPas encore d'évaluation

- Révision TOPODocument6 pagesRévision TOPOMohamed DiopPas encore d'évaluation

- Dis Tan Ce SDocument8 pagesDis Tan Ce SMohamed DiopPas encore d'évaluation

- Topographie Et Topométrie Générale: Institut Du Genie Rural Et de L'Environnement (Igre-Dakar)Document33 pagesTopographie Et Topométrie Générale: Institut Du Genie Rural Et de L'Environnement (Igre-Dakar)Mohamed DiopPas encore d'évaluation

- Quels Sont Les Différents Engins de Chantier Et Leur RôleDocument14 pagesQuels Sont Les Différents Engins de Chantier Et Leur RôleMohamed Diop93% (14)

- Environnement Et Ressources NaturellesDocument27 pagesEnvironnement Et Ressources NaturellesMohamed DiopPas encore d'évaluation

- Ms Hyd Chemidi+Kaddour PDFDocument115 pagesMs Hyd Chemidi+Kaddour PDFMohamed DiopPas encore d'évaluation

- TD Épuration Eau Avec Correction 2017-18Document4 pagesTD Épuration Eau Avec Correction 2017-18Mohamed Diop100% (2)

- Minougou Waogwende WilfriedDocument77 pagesMinougou Waogwende WilfriedMohamed DiopPas encore d'évaluation

- Dictionnaire de PhilosophieDocument27 pagesDictionnaire de PhilosophieMohamed DiopPas encore d'évaluation

- C SuperfluDocument38 pagesC SuperfluMoulay Youssef HadiPas encore d'évaluation

- Candidats Master BigData FPTDocument15 pagesCandidats Master BigData FPTMarouaneRimoPas encore d'évaluation

- Cours de Bascules Numériques 2017-2018Document28 pagesCours de Bascules Numériques 2017-2018Camile SiliaPas encore d'évaluation

- ISO-2039-1-2001Document9 pagesISO-2039-1-2001aitadiPas encore d'évaluation

- Mansour AmineDocument80 pagesMansour AmineMâ JdåPas encore d'évaluation

- Aguezzoul AFGI PDFDocument22 pagesAguezzoul AFGI PDFMEHDIPas encore d'évaluation

- TP 1 OntologieDocument4 pagesTP 1 OntologieYao jean lucPas encore d'évaluation

- BB Algo 2022 NRDocument4 pagesBB Algo 2022 NRhaddad hani100% (1)

- Exposé Complet Sur Une Vie de Boy de Ferdinand OyDocument1 pageExposé Complet Sur Une Vie de Boy de Ferdinand OyELHADJI DIAWPas encore d'évaluation

- CV Abir KaanichDocument3 pagesCV Abir KaanichAbirPas encore d'évaluation

- Creer Un Token Avec Debord Avec GIMPDocument12 pagesCreer Un Token Avec Debord Avec GIMPBobby JoPas encore d'évaluation

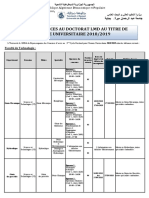

- Concours Doctorat Bejaia 2018Document11 pagesConcours Doctorat Bejaia 2018Mourad BoumenirPas encore d'évaluation

- AINV - 001 - Présentation de La Cellule V2.0Document31 pagesAINV - 001 - Présentation de La Cellule V2.0Scene JuegosPas encore d'évaluation

- Output 14Document5 pagesOutput 14slim yaichPas encore d'évaluation

- Eléments D'algèbre Générale - Petit Théorème de FermatDocument2 pagesEléments D'algèbre Générale - Petit Théorème de FermatCarlo CocoPas encore d'évaluation

- 2022060701410T - DICT-DT Conjointe - 1Document1 page2022060701410T - DICT-DT Conjointe - 1Marco ButterbachPas encore d'évaluation

- 2 Structure de Contrôle de Base AlgorithmiqueDocument4 pages2 Structure de Contrôle de Base AlgorithmiqueAbdeladim BasbassiPas encore d'évaluation

- Propriete Intellectuelle FichesDocument42 pagesPropriete Intellectuelle Fichesjephte NonouPas encore d'évaluation

- TD 2Document2 pagesTD 2Peguy NkoueboPas encore d'évaluation

- Câblage D'un Réseau InformatiqueDocument46 pagesCâblage D'un Réseau Informatiqueakpolè bienvenue Konan75% (12)

- Siemens Gigaset A510/A510a Mode D'emploi (Version Complète) FR FRDocument72 pagesSiemens Gigaset A510/A510a Mode D'emploi (Version Complète) FR FRblaizouillePas encore d'évaluation

- L2 GPL - Diapo #1 - GPAODocument46 pagesL2 GPL - Diapo #1 - GPAOalain bakalaPas encore d'évaluation

- Design Des SystèmesDocument30 pagesDesign Des SystèmesMohamed LalaouiPas encore d'évaluation

- Technologies PDH SDHDocument19 pagesTechnologies PDH SDHfranckPas encore d'évaluation

- 26 31 FR PDFDocument72 pages26 31 FR PDFLagdaa MohammedPas encore d'évaluation

- Alarme Avec Transmission À DistanseDocument96 pagesAlarme Avec Transmission À DistanseAbdo WalidPas encore d'évaluation

- PESTEL SAP - ConvertiDocument8 pagesPESTEL SAP - ConvertiAmine BennaniPas encore d'évaluation

- Calcul MatricielDocument16 pagesCalcul MatricielHas SaadaouiPas encore d'évaluation

- Chapitre 1Document78 pagesChapitre 1Anis YanisPas encore d'évaluation

- Mode D'emploieDocument12 pagesMode D'emploieMIANO SergePas encore d'évaluation